Simulating Human-Like Learning Dynamics with LLM-Empowered Agents

作者: Yu Yuan, Lili Zhao, Wei Chen, Guangting Zheng, Kai Zhang, Mengdi Zhang, Qi Liu

分类: cs.AI

发布日期: 2025-08-07

💡 一句话要点

提出LearnerAgent,利用LLM模拟人类学习动态,揭示LLM的认知局限性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 多智能体系统 人类学习模拟 认知建模 教育应用

📋 核心要点

- 现有方法难以捕捉学习动态、跟踪长期进展,以及提供可解释性,限制了对人类学习行为的深入理解。

- LearnerAgent利用LLM构建多智能体框架,模拟教学环境,并赋予智能体不同的心理学角色,以模拟真实学习过程。

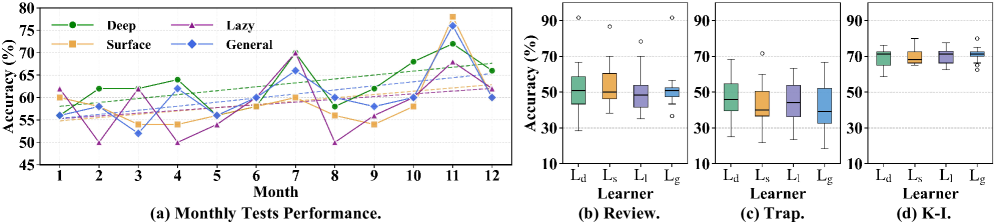

- 实验表明,不同角色智能体的学习行为与心理学设定一致,并揭示了基础LLM作为“勤奋但脆弱的表面学习者”的认知局限。

📝 摘要(中文)

本文提出了一种基于大型语言模型(LLM)的多智能体框架LearnerAgent,用于模拟真实的教学环境,探索类人学习动态。该框架构建了具有心理学基础的学习者角色,如深度学习者、表面学习者和懒惰学习者,以及一个无角色设定的通用学习者,以考察基础LLM的默认行为。通过每周的知识获取、每月的策略选择、定期的测试和同伴互动,可以跟踪个体学习者在为期一年的学习过程中的动态学习进展。研究发现,只有深度学习者实现了持续的认知增长;专门设计的“陷阱问题”有效诊断了表面学习者的浅层知识;不同学习者的行为和认知模式与其心理特征密切相关;学习者的自我概念评分也呈现出真实的演变;基础LLM的默认状态是一个“勤奋但脆弱的表面学习者”,模仿优秀学生的行为,但缺乏真正的、可泛化的理解。大量的模拟实验表明,LearnerAgent与真实场景高度吻合,并对LLM的行为产生了更深刻的见解。

🔬 方法详解

问题定义:现有基于深度学习的方法在捕捉人类学习行为时,面临难以模拟学习动态、无法有效跟踪长期学习进展以及缺乏可解释性的问题。这些问题阻碍了我们深入理解人类认知过程,并限制了智能系统在教育和个性化学习方面的应用。

核心思路:本文的核心思路是利用大型语言模型(LLM)的强大能力,构建一个多智能体框架,模拟真实的教学环境,并通过赋予智能体不同的心理学角色,来模拟不同类型的学习者。通过观察这些智能体在长期学习过程中的行为和认知变化,可以更深入地理解人类学习动态,并揭示LLM自身的认知局限性。

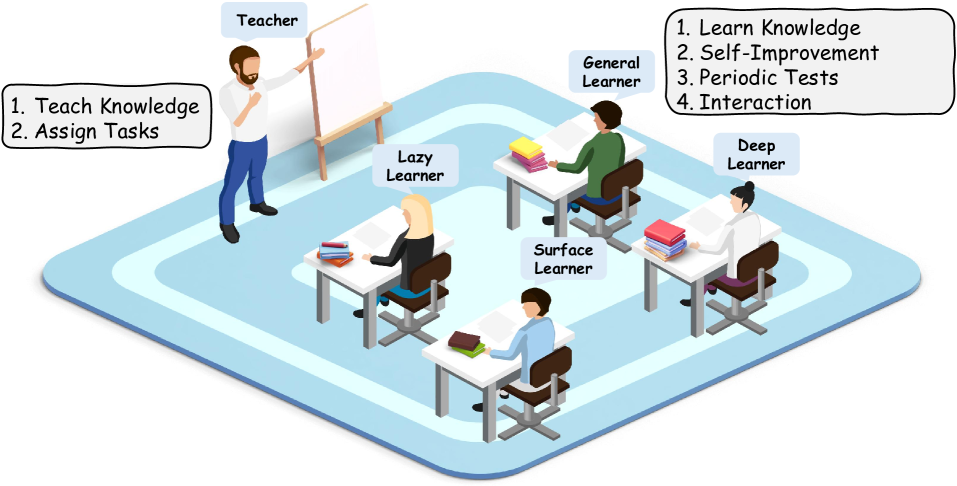

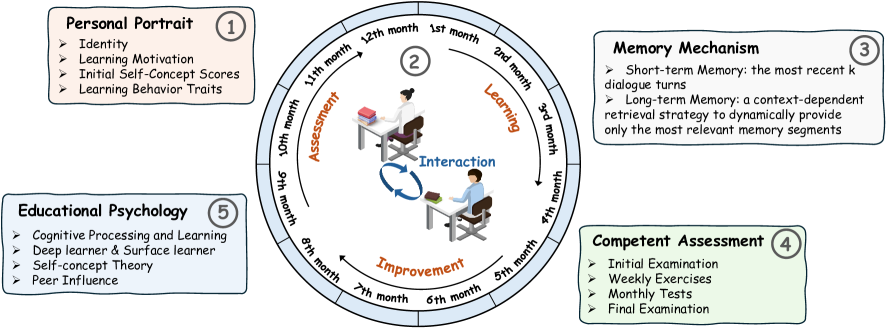

技术框架:LearnerAgent框架包含多个具有不同心理学特征的学习者智能体(如深度学习者、表面学习者、懒惰学习者和通用学习者)。这些智能体在一个模拟的教学环境中进行学习,学习过程包括每周的知识获取、每月的策略选择、定期的测试和同伴互动。通过跟踪这些智能体在为期一年的学习过程中的学习进展、行为模式和认知变化,可以分析不同学习者的学习动态。

关键创新:该论文的关键创新在于将LLM应用于模拟人类学习过程,并构建了具有心理学基础的学习者角色。这种方法不仅可以更真实地模拟人类学习行为,还可以通过观察不同角色的智能体在学习过程中的表现,来揭示LLM自身的认知局限性。此外,专门设计的“陷阱问题”能够有效诊断表面学习者的浅层知识。

关键设计:LearnerAgent框架的关键设计包括:1) 基于心理学理论构建的学习者角色,确保智能体的行为和认知模式与真实人类学习者相似;2) 模拟真实的教学环境,包括知识获取、策略选择、测试和同伴互动等环节;3) 长期学习过程的模拟,以便观察学习者的动态学习进展;4) 专门设计的“陷阱问题”,用于诊断表面学习者的浅层知识;5) 对学习者的自我概念进行评分,以跟踪其认知变化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,只有深度学习者能够实现持续的认知增长,而表面学习者容易陷入浅层知识的陷阱。通用学习者虽然认知能力有限,但表现出较高的自我效能感。最重要的是,研究发现基础LLM的默认状态是一个“勤奋但脆弱的表面学习者”,这表明LLM在理解和泛化知识方面存在局限性。这些发现对LLM在教育领域的应用具有重要的指导意义。

🎯 应用场景

LearnerAgent框架可应用于教育领域,例如个性化学习系统设计、教学策略优化和学习行为分析。通过模拟不同学习者的学习过程,可以更好地理解学生的学习需求和认知特点,从而制定更有效的教学方案。此外,该框架还可以用于评估和改进LLM在教育领域的应用,例如智能辅导系统和自动评分系统。

📄 摘要(原文)

Capturing human learning behavior based on deep learning methods has become a major research focus in both psychology and intelligent systems. Recent approaches rely on controlled experiments or rule-based models to explore cognitive processes. However, they struggle to capture learning dynamics, track progress over time, or provide explainability. To address these challenges, we introduce LearnerAgent, a novel multi-agent framework based on Large Language Models (LLMs) to simulate a realistic teaching environment. To explore human-like learning dynamics, we construct learners with psychologically grounded profiles-such as Deep, Surface, and Lazy-as well as a persona-free General Learner to inspect the base LLM's default behavior. Through weekly knowledge acquisition, monthly strategic choices, periodic tests, and peer interaction, we can track the dynamic learning progress of individual learners over a full-year journey. Our findings are fourfold: 1) Longitudinal analysis reveals that only Deep Learner achieves sustained cognitive growth. Our specially designed "trap questions" effectively diagnose Surface Learner's shallow knowledge. 2) The behavioral and cognitive patterns of distinct learners align closely with their psychological profiles. 3) Learners' self-concept scores evolve realistically, with the General Learner developing surprisingly high self-efficacy despite its cognitive limitations. 4) Critically, the default profile of base LLM is a "diligent but brittle Surface Learner"-an agent that mimics the behaviors of a good student but lacks true, generalizable understanding. Extensive simulation experiments demonstrate that LearnerAgent aligns well with real scenarios, yielding more insightful findings about LLMs' behavior.