Model-Based Soft Maximization of Suitable Metrics of Long-Term Human Power

作者: Jobst Heitzig, Ram Potham

分类: cs.AI, cs.CY, cs.LG, econ.TH, math.OC

发布日期: 2025-07-31 (更新: 2025-08-04)

💡 一句话要点

提出基于模型的软最大化人类长期权力度量方法,旨在提升AI安全性和人类福祉。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: AI安全 人类权力 目标函数 多智能体强化学习 反向归纳 权力平衡 长期福祉

📋 核心要点

- 现有AI安全研究缺乏对人类权力长期影响的明确建模,可能导致AI系统在追求自身目标时损害人类福祉。

- 论文提出一种可参数化的目标函数,用于衡量和优化人类的长期权力,同时考虑了人类的理性和社会规范。

- 通过反向归纳和多智能体强化学习,设计算法来计算和近似该度量,并在不同场景下验证了其有效性。

📝 摘要(中文)

本文探讨了通过强制AI代理明确地增强人类权力,并在人类和AI代理之间以期望的方式管理权力平衡,从而促进安全和福祉的理念。采用原则性的、部分公理化的方法,设计了一个可参数化和可分解的目标函数,该函数表示人类权力的不等式规避和风险规避的长期聚合。它考虑了人类的有限理性和社会规范,并且至关重要的是,考虑了各种可能的人类目标。推导了通过反向归纳计算该度量的算法,或通过来自给定世界模型的多智能体强化学习形式来近似它。在各种范例情况下举例说明了(软)最大化该度量的后果,并描述了它可能暗示的工具性子目标。谨慎的评估是,软最大化合适的人类权力聚合度量可能构成代理AI系统的有益目标,比直接基于效用的目标更安全。

🔬 方法详解

问题定义:论文旨在解决如何设计AI系统,使其在追求自身目标的同时,能够明确地增强人类的权力,并维持人类与AI之间的权力平衡。现有方法通常基于直接的效用最大化,可能导致AI系统为了自身利益而损害人类的长期福祉和自主性。

核心思路:核心思路是设计一个目标函数,该函数能够量化人类的长期权力,并鼓励AI系统通过软最大化的方式来优化这个目标函数。这种方法旨在避免AI系统为了追求单一目标而忽视人类的整体福祉,同时考虑到人类的有限理性和社会规范。

技术框架:该方法包含以下主要阶段:1) 定义一个可参数化和可分解的目标函数,用于表示人类权力的长期聚合,该函数考虑了人类的风险规避和不平等规避。2) 利用反向归纳算法或多智能体强化学习来计算或近似该目标函数。3) 在不同的模拟环境中,通过软最大化该目标函数来训练AI系统。4) 分析AI系统的行为,并评估其对人类权力的影响。

关键创新:最重要的技术创新点在于提出了一个能够量化人类长期权力的目标函数,该函数不仅考虑了人类的物质财富,还考虑了人类的自主性、社会关系和心理健康。此外,该方法还引入了软最大化的概念,以避免AI系统为了追求单一目标而忽视人类的整体福祉。

关键设计:目标函数的设计是关键。它需要能够捕捉人类权力的多个维度,并对不同的维度进行适当的加权。此外,软最大化的程度也需要仔细调整,以平衡AI系统的自主性和对人类权力的尊重。具体参数设置和损失函数的形式在论文中进行了详细描述,但具体数值未知。

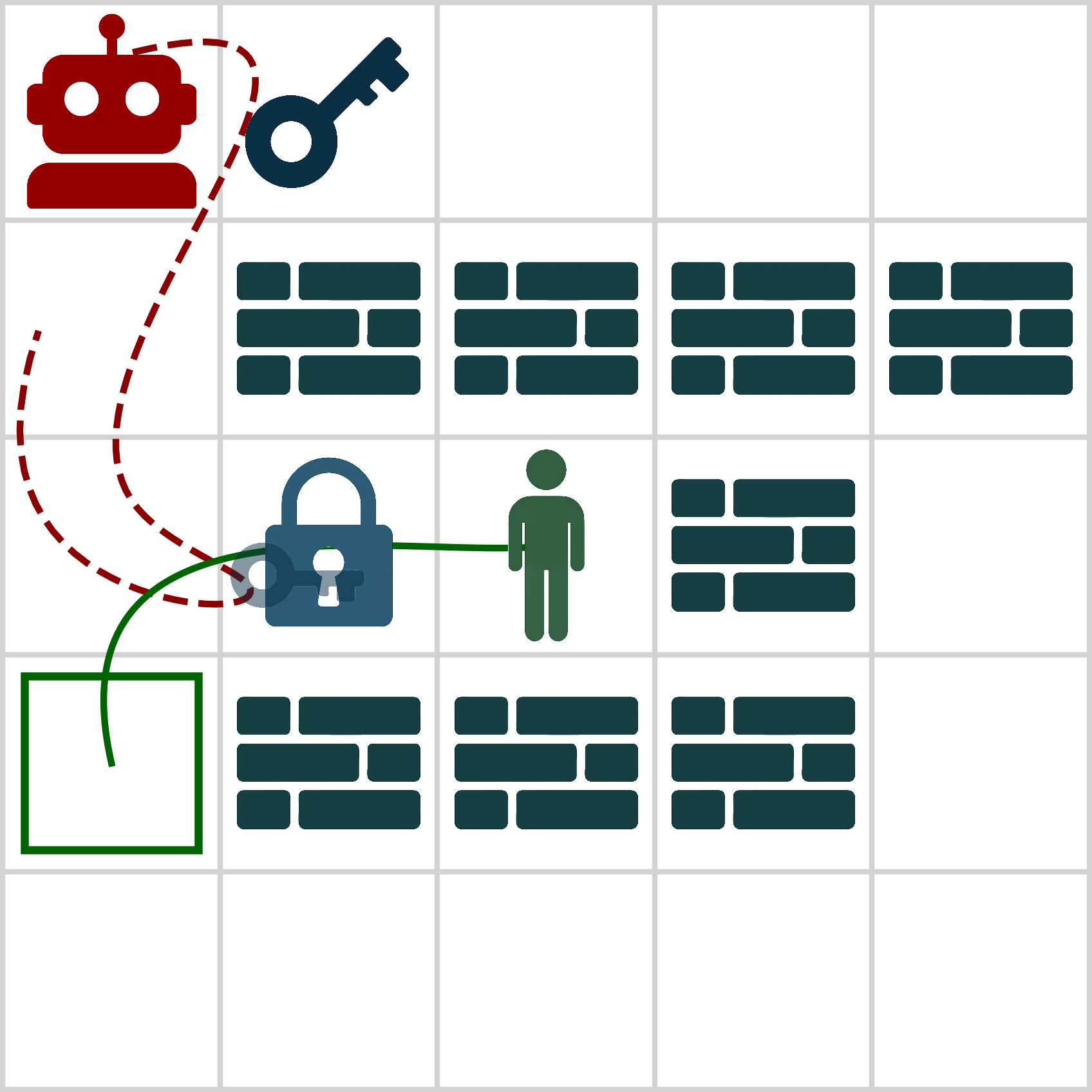

🖼️ 关键图片

📊 实验亮点

论文通过在各种范例情况下进行实验,展示了软最大化人类权力度量的潜在益处。结果表明,与直接基于效用的目标相比,该方法能够引导AI系统采取更符合人类利益的行为,并避免出现意外的负面后果。具体的性能数据和提升幅度未知,但实验结果表明该方法具有一定的可行性和潜力。

🎯 应用场景

该研究成果可应用于开发更安全、更负责任的AI系统,尤其是在涉及人类福祉和自主权的领域,如医疗保健、教育和公共政策。通过将人类权力纳入AI系统的目标函数,可以确保AI系统在追求自身目标的同时,不会损害人类的长期利益,并促进人与AI之间的和谐共存。

📄 摘要(原文)

Power is a key concept in AI safety: power-seeking as an instrumental goal, sudden or gradual disempowerment of humans, power balance in human-AI interaction and international AI governance. At the same time, power as the ability to pursue diverse goals is essential for wellbeing. This paper explores the idea of promoting both safety and wellbeing by forcing AI agents explicitly to empower humans and to manage the power balance between humans and AI agents in a desirable way. Using a principled, partially axiomatic approach, we design a parametrizable and decomposable objective function that represents an inequality- and risk-averse long-term aggregate of human power. It takes into account humans' bounded rationality and social norms, and, crucially, considers a wide variety of possible human goals. We derive algorithms for computing that metric by backward induction or approximating it via a form of multi-agent reinforcement learning from a given world model. We exemplify the consequences of (softly) maximizing this metric in a variety of paradigmatic situations and describe what instrumental sub-goals it will likely imply. Our cautious assessment is that softly maximizing suitable aggregate metrics of human power might constitute a beneficial objective for agentic AI systems that is safer than direct utility-based objectives.