Teaching Language Models To Gather Information Proactively

作者: Tenghao Huang, Sihao Chen, Muhao Chen, Jonathan May, Longqi Yang, Mengting Wan, Pei Zhou

分类: cs.AI, cs.CL

发布日期: 2025-07-28

💡 一句话要点

提出主动信息收集框架,提升LLM在复杂任务中作为协作伙伴的能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 主动信息收集 强化学习 任务型对话 人机协作

📋 核心要点

- 现有LLM在面对不完整或模糊的提示时,缺乏主动收集信息的能力,导致解决复杂问题的效果不佳。

- 论文提出一种主动信息收集的任务范式,通过提问策略性地引出用户隐性知识,弥补信息差距。

- 通过强化微调训练Qwen-2.5-7B模型,实验表明该模型在自动评估和人工评估中均优于基线模型。

📝 摘要(中文)

大型语言模型(LLM)越来越多地被期望作为协作伙伴,通过来回对话解决复杂、模糊的问题。然而,当前的LLM在实际环境中常常表现不佳,面对不完整或欠明确的提示时,通常会采取被动响应或狭隘的澄清,未能主动收集对于高质量解决方案至关重要的缺失信息。本文介绍了一种新的任务范式:主动信息收集,其中LLM必须识别提供的上下文中的差距,并通过有针对性的问题策略性地引出用户的隐性知识。为了系统地研究和训练这种能力,我们设计了一个可扩展的框架,该框架生成部分指定的真实世界任务,掩盖关键信息并模拟真实的模糊性。在此设置中,我们的核心创新是一种强化微调策略,该策略奖励那些引出真正新的、隐性用户信息的提问——例如隐藏的领域专业知识或细粒度的需求——否则这些信息将不会被表达出来。实验表明,我们训练的Qwen-2.5-7B模型在自动评估指标上显著优于o3-mini 18%。更重要的是,人工评估显示,我们的模型生成的澄清问题和最终大纲分别受到人工标注者的42%和28%的青睐。总之,这些结果突出了主动澄清在将LLM从被动文本生成器提升为真正的协作思考伙伴方面的价值。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在作为协作伙伴解决复杂问题时,缺乏主动信息收集能力的问题。现有LLM面对不完整或欠明确的提示时,通常被动响应,无法主动识别并获取缺失的关键信息,从而影响最终解决方案的质量。

核心思路:论文的核心思路是让LLM学会主动提问,通过有针对性的提问策略性地引出用户的隐性知识,从而弥补信息差距。这种主动信息收集能力使得LLM能够更好地理解用户需求,并生成更符合用户期望的解决方案。

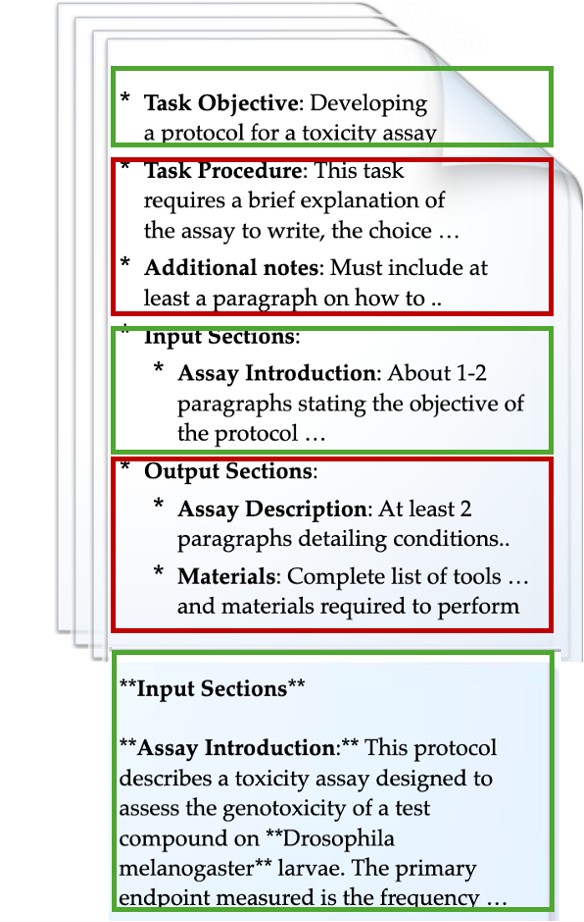

技术框架:论文设计了一个可扩展的框架,用于生成部分指定的真实世界任务,模拟真实场景中的信息不完整性。该框架通过掩盖关键信息来制造模糊性,并鼓励LLM通过提问来获取这些信息。整体流程包括:任务生成、LLM提问、用户回答、LLM根据回答更新信息、最终生成解决方案。

关键创新:论文的关键创新在于提出了一种强化微调策略,该策略奖励那些能够引出真正新的、隐性用户信息的提问。这种奖励机制鼓励LLM不仅仅是进行简单的澄清,而是深入挖掘用户的领域专业知识或细粒度需求,从而获取更有价值的信息。

关键设计:论文使用强化学习来微调LLM,奖励函数的设计至关重要。奖励函数需要能够区分有价值的提问和无意义的提问,例如,奖励那些能够引出用户之前未提及的信息的提问。具体的技术细节,如强化学习算法的选择、奖励函数的具体形式、以及模型的训练参数等,论文中可能有所描述,但具体细节未知。

🖼️ 关键图片

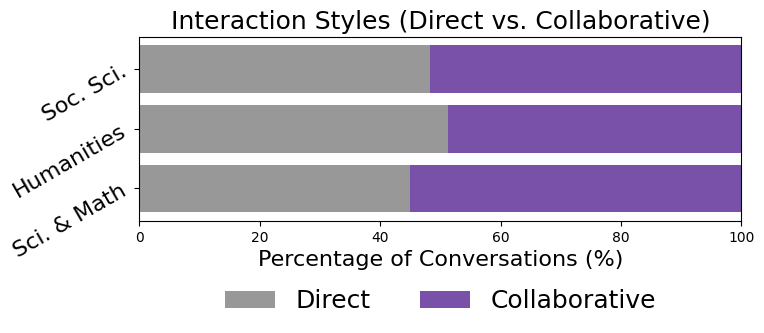

📊 实验亮点

实验结果表明,经过强化微调的Qwen-2.5-7B模型在自动评估指标上显著优于o3-mini 18%。更重要的是,人工评估显示,该模型生成的澄清问题和最终大纲分别受到人工标注者的42%和28%的青睐,表明其在主动信息收集和问题解决方面具有显著优势。

🎯 应用场景

该研究成果可应用于智能客服、智能助手、任务型对话系统等领域,提升LLM在复杂任务中的协作能力。通过主动信息收集,LLM能够更好地理解用户需求,提供更个性化、更有效的解决方案,从而提高用户满意度。

📄 摘要(原文)

Large language models (LLMs) are increasingly expected to function as collaborative partners, engaging in back-and-forth dialogue to solve complex, ambiguous problems. However, current LLMs often falter in real-world settings, defaulting to passive responses or narrow clarifications when faced with incomplete or under-specified prompts, falling short of proactively gathering the missing information that is crucial for high-quality solutions. In this work, we introduce a new task paradigm: proactive information gathering, where LLMs must identify gaps in the provided context and strategically elicit implicit user knowledge through targeted questions. To systematically study and train this capability, we design a scalable framework that generates partially specified, real-world tasks, masking key information and simulating authentic ambiguity. Within this setup, our core innovation is a reinforcement finetuning strategy that rewards questions that elicit genuinely new, implicit user information -- such as hidden domain expertise or fine-grained requirements -- that would otherwise remain unspoken. Experiments demonstrate that our trained Qwen-2.5-7B model significantly outperforms o3-mini by 18% on automatic evaluation metrics. More importantly, human evaluation reveals that clarification questions and final outlines generated by our model are favored by human annotators by 42% and 28% respectively. Together, these results highlight the value of proactive clarification in elevating LLMs from passive text generators to genuinely collaborative thought partners.