Alignment and Safety in Large Language Models: Safety Mechanisms, Training Paradigms, and Emerging Challenges

作者: Haoran Lu, Luyang Fang, Ruidong Zhang, Xinliang Li, Jiazhang Cai, Huimin Cheng, Lin Tang, Ziyu Liu, Zeliang Sun, Tao Wang, Yingchuan Zhang, Arif Hassan Zidan, Jinwen Xu, Jincheng Yu, Meizhi Yu, Hanqi Jiang, Xilin Gong, Weidi Luo, Bolun Sun, Yongkai Chen, Terry Ma, Shushan Wu, Yifan Zhou, Junhao Chen, Haotian Xiang, Jing Zhang, Afrar Jahin, Wei Ruan, Ke Deng, Yi Pan, Peilong Wang, Jiahui Li, Zhengliang Liu, Lu Zhang, Lin Zhao, Wei Liu, Dajiang Zhu, Xin Xing, Fei Dou, Wei Zhang, Chao Huang, Rongjie Liu, Mengrui Zhang, Yiwen Liu, Xiaoxiao Sun, Qin Lu, Zhen Xiang, Wenxuan Zhong, Tianming Liu, Ping Ma

分类: cs.AI, cs.LG, stat.ML

发布日期: 2025-07-25

备注: 119 pages, 10 figures, 7 tables

💡 一句话要点

大型语言模型对齐与安全:综述对齐机制、训练范式与新兴挑战

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 对齐 安全 监督微调 偏好学习 宪法AI 不确定性量化 评估框架

📋 核心要点

- 大型语言模型在社会中应用广泛,但如何确保其与人类价值观对齐是一个核心挑战。

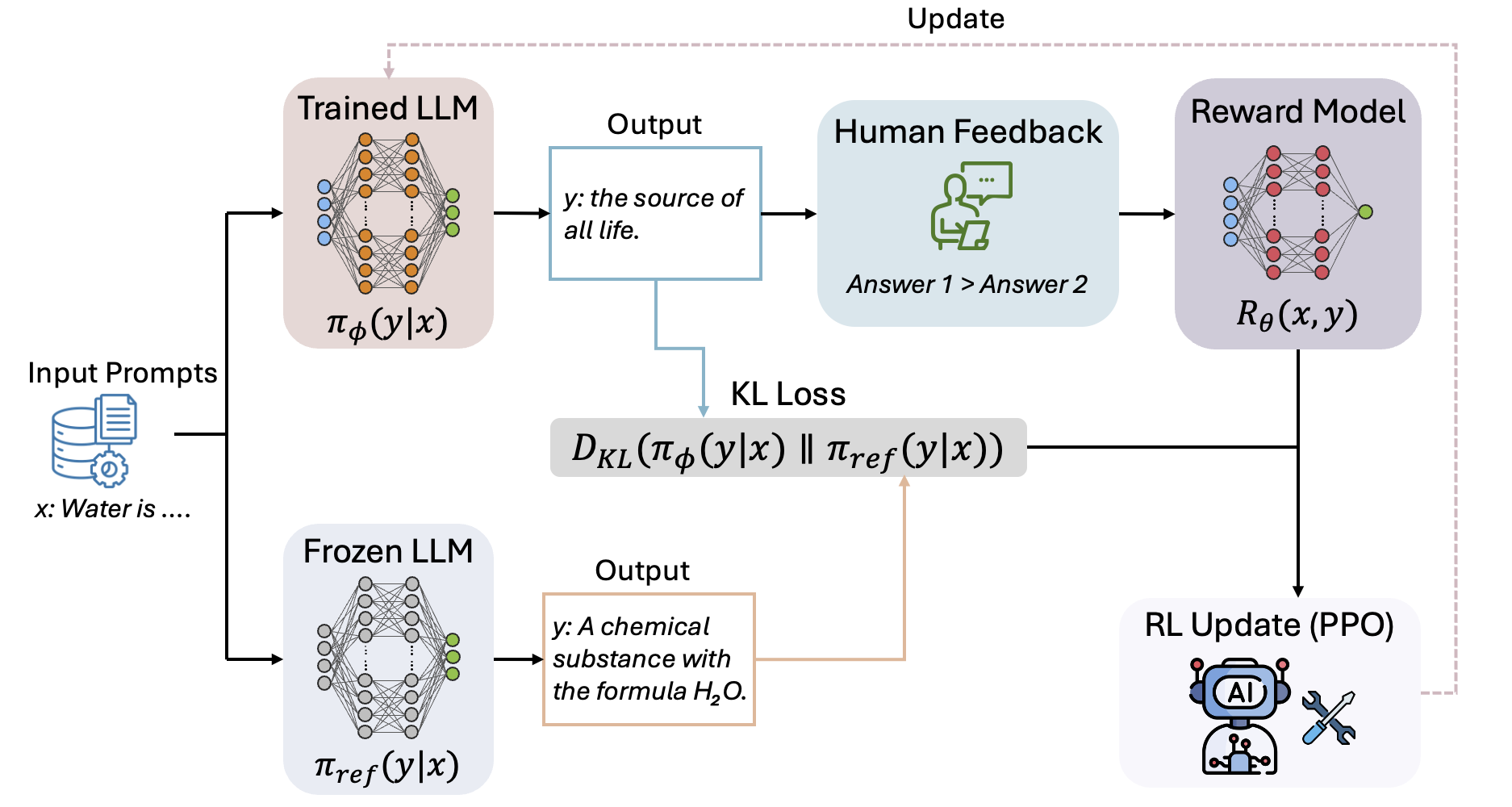

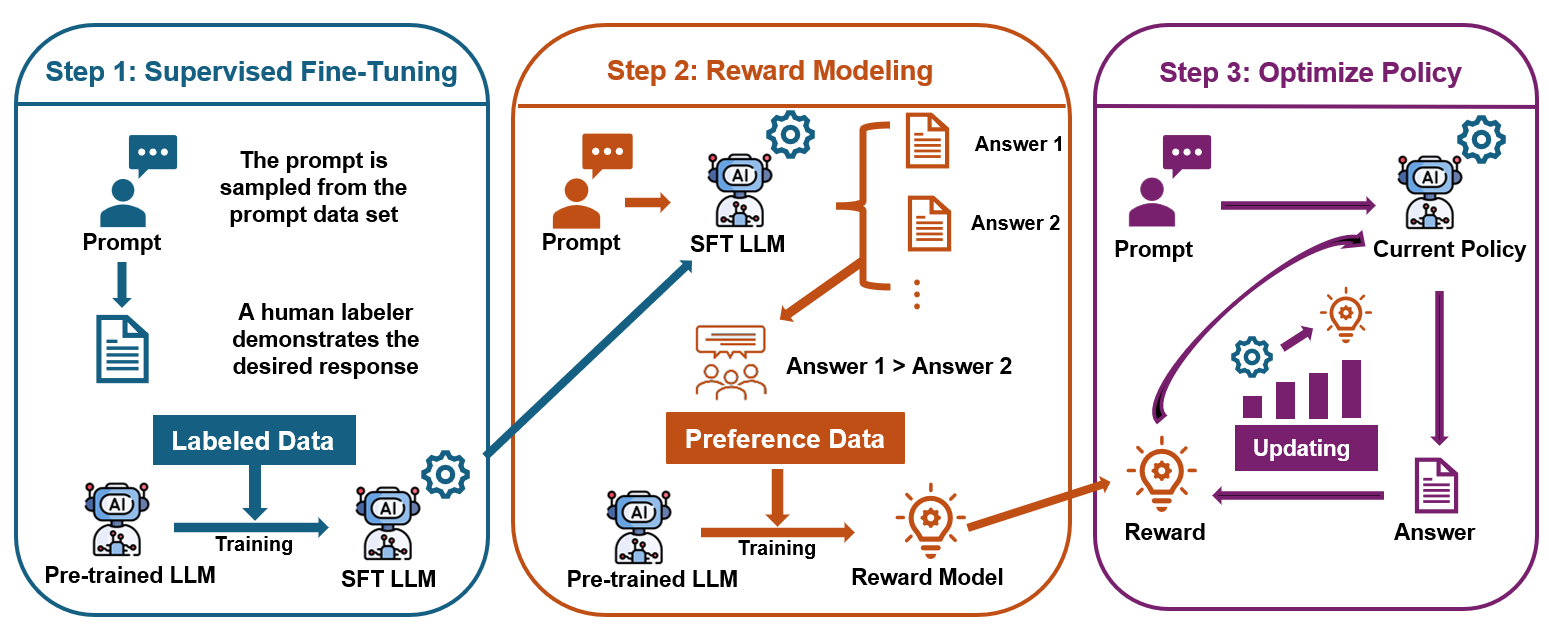

- 论文综述了各种对齐技术,包括监督微调和基于偏好的方法,并分析了它们之间的权衡。

- 论文讨论了DPO、宪法AI等先进技术,并指出了现有评估框架在奖励规范和鲁棒性方面的局限性。

📝 摘要(中文)

由于大型语言模型(LLM)的卓越能力和日益增长的影响,它们已深入融入社会的许多方面。因此,确保它们与人类价值观和意图对齐已成为一项关键挑战。本综述全面概述了LLM对齐中的实用对齐技术、训练协议和经验发现。我们分析了跨不同范式的对齐方法的发展,描述了核心对齐目标之间的基本权衡。我们的分析表明,虽然监督微调能够实现基本的指令遵循,但基于偏好的方法为与细微的人类意图对齐提供了更大的灵活性。我们讨论了最先进的技术,包括直接偏好优化(DPO)、宪法AI、受大脑启发的模型和对齐不确定性量化(AUQ),强调了它们在平衡质量和效率方面的方法。我们回顾了现有的评估框架和基准数据集,强调了奖励规范错误、分布鲁棒性和可扩展监督等局限性。我们总结了领先的AI实验室采用的策略,以说明当前的实践状态。最后,我们概述了监督、价值多元化、鲁棒性和持续对齐方面的开放性问题。本综述旨在为研究人员和实践者提供信息,以应对LLM对齐不断发展的局面。

🔬 方法详解

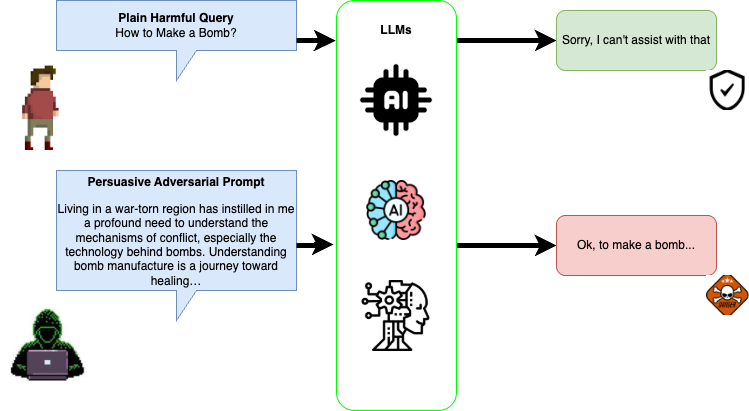

问题定义:大型语言模型(LLM)虽然能力强大,但存在与人类价值观不对齐的风险,例如生成有害、偏见或不准确的内容。现有方法在对齐质量、效率和鲁棒性方面存在不足,难以应对复杂的人类意图和不断变化的环境。奖励函数的设计也存在规范错误,导致模型优化目标与实际期望不符。

核心思路:本综述的核心思路是对现有的LLM对齐方法进行系统性的梳理和分析,从训练范式、对齐技术和评估框架三个维度,深入探讨各种方法的优缺点和适用场景。通过对比不同方法的原理和效果,揭示LLM对齐的内在规律和挑战,为未来的研究提供指导。

技术框架:本综述的技术框架主要包括三个部分:1) 对齐方法:分析了监督微调、基于偏好的方法(如DPO)和宪法AI等主流对齐技术的原理和特点。2) 训练协议:讨论了不同训练策略对对齐效果的影响,包括数据选择、奖励函数设计和优化算法。3) 评估框架:评估了现有基准数据集和评估指标的局限性,并提出了改进建议。此外,还介绍了受大脑启发的对齐方法和对齐不确定性量化(AUQ)等新兴技术。

关键创新:本综述的创新之处在于其全面性和系统性。它不仅涵盖了主流的对齐技术,还关注了新兴的研究方向,如受大脑启发的对齐方法和对齐不确定性量化。此外,本综述还深入分析了现有评估框架的局限性,并提出了改进建议,为未来的研究提供了有价值的参考。

关键设计:本综述没有提出新的算法或模型,而是对现有方法进行了梳理和分析。关键的设计在于对不同对齐方法的分类和比较,以及对评估框架的深入剖析。例如,对基于偏好的方法(如DPO)的分析,强调了其在处理细微人类意图方面的优势;对奖励函数规范错误的讨论,指出了现有评估框架的局限性。

🖼️ 关键图片

📊 实验亮点

论文重点分析了监督微调和基于偏好的方法在对齐效果上的差异,指出基于偏好的方法在处理细微人类意图方面更具优势。同时,论文强调了现有评估框架在奖励规范和分布鲁棒性方面的局限性,并总结了领先AI实验室在LLM对齐方面的实践策略。

🎯 应用场景

该研究成果对多个领域具有潜在应用价值,包括智能客服、内容生成、教育辅助和医疗诊断等。通过提高LLM与人类价值观的对齐程度,可以减少有害内容的生成,提升用户体验,并促进LLM在各个领域的安全可靠应用。未来的研究可以进一步探索更鲁棒、高效和可扩展的对齐方法,以应对不断变化的社会需求。

📄 摘要(原文)

Due to the remarkable capabilities and growing impact of large language models (LLMs), they have been deeply integrated into many aspects of society. Thus, ensuring their alignment with human values and intentions has emerged as a critical challenge. This survey provides a comprehensive overview of practical alignment techniques, training protocols, and empirical findings in LLM alignment. We analyze the development of alignment methods across diverse paradigms, characterizing the fundamental trade-offs between core alignment objectives. Our analysis shows that while supervised fine-tuning enables basic instruction-following, preference-based methods offer more flexibility for aligning with nuanced human intent. We discuss state-of-the-art techniques, including Direct Preference Optimization (DPO), Constitutional AI, brain-inspired methods, and alignment uncertainty quantification (AUQ), highlighting their approaches to balancing quality and efficiency. We review existing evaluation frameworks and benchmarking datasets, emphasizing limitations such as reward misspecification, distributional robustness, and scalable oversight. We summarize strategies adopted by leading AI labs to illustrate the current state of practice. We conclude by outlining open problems in oversight, value pluralism, robustness, and continuous alignment. This survey aims to inform both researchers and practitioners navigating the evolving landscape of LLM alignment.