Geometry of Knowledge Allows Extending Diversity Boundaries of Large Language Models

作者: Mateusz Bystroński, Doheon Han, Nitesh V. Chawla, Tomasz Kajdanowicz

分类: cs.AI

发布日期: 2025-07-18 (更新: 2026-01-13)

💡 一句话要点

提出基于知识几何的LLM多样性扩展框架,提升发散性思维能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 生成多样性 知识几何 流形学习 发散性思维

📋 核心要点

- 现有LLM在生成多样性方面存在局限,难以充分探索语义空间,限制了其创造性应用。

- 利用语义空间中知识的几何结构,通过遍历流形来扩展LLM的生成范围,无需修改模型参数。

- 实验证明,该方法显著提高了生成多样性,并有效提升了LLM的发散性思维能力。

📝 摘要(中文)

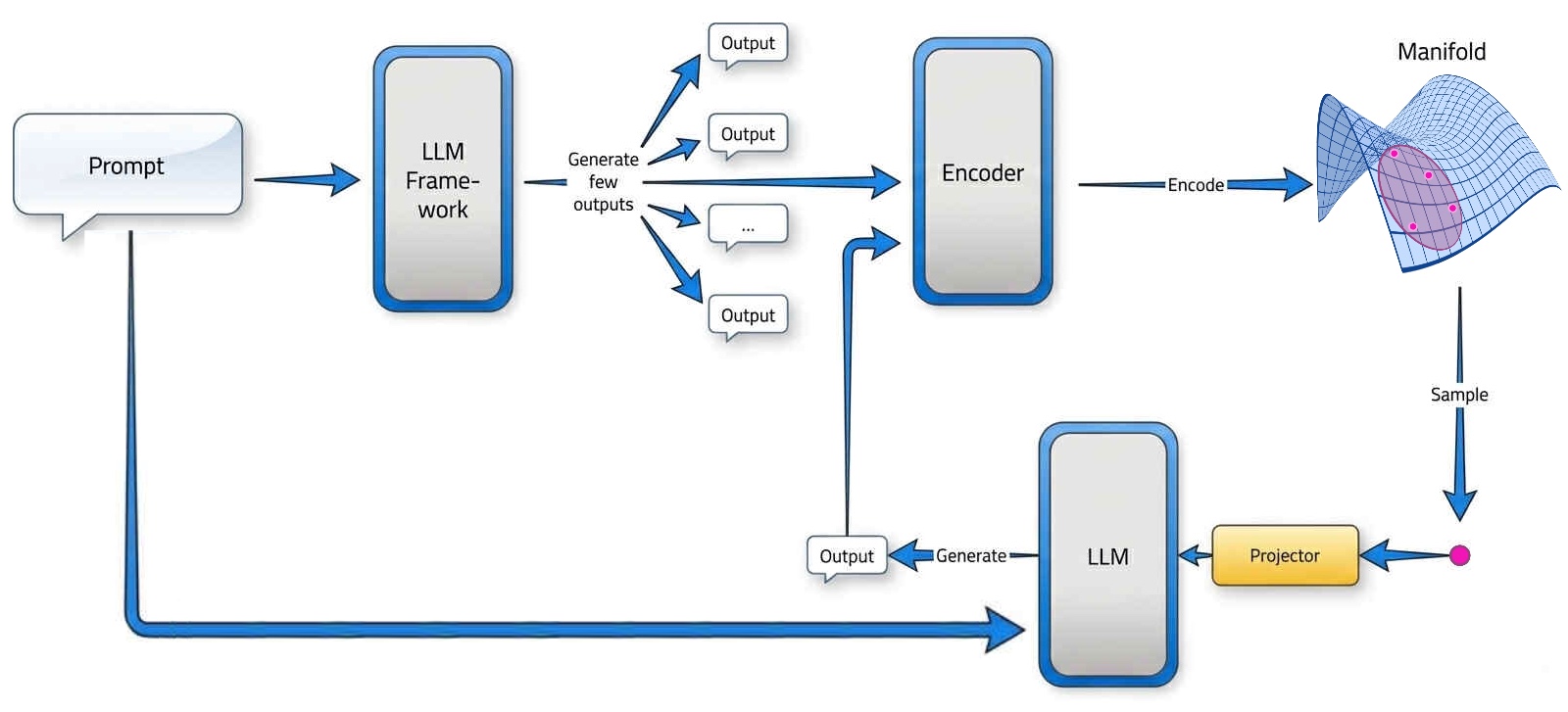

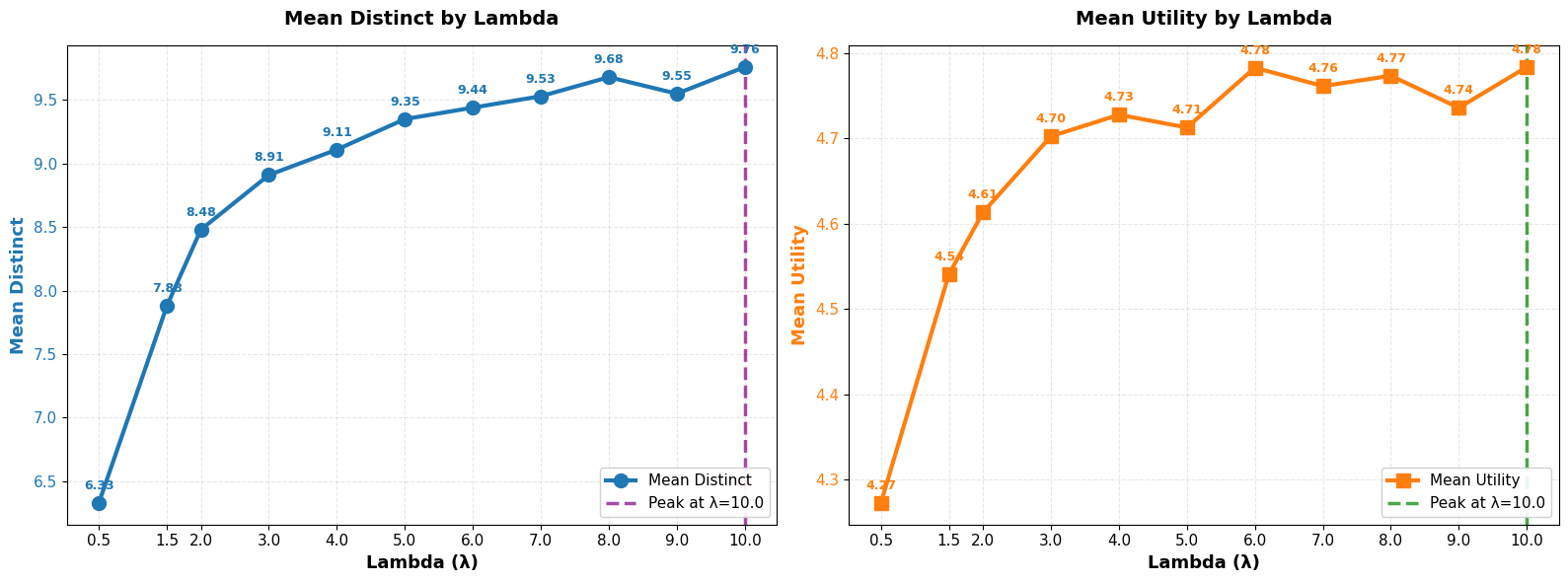

本文提出一种基于知识几何结构的LLM多样性扩展框架。假设语义空间中的知识沿着结构化的流形组织,通过遍历该流形并利用生成的连续表示来调节LLM的生成分布,从而系统地扩展模型可达到的语义范围。该框架无需修改LLM的参数,通过从一小组多样化的锚点生成构建调节分布,并通过xRAG风格的投影器调节LLM的生成。实验表明,这种基于流形的调节显著提高了生成多样性,直接有益于增强语言模型中的发散性思维,这是创造力的核心方面。

🔬 方法详解

问题定义:现有大型语言模型(LLM)在生成内容时,往往缺乏足够的多样性,难以充分探索语义空间。这限制了它们在需要创造性输出的任务中的应用,例如头脑风暴、创意写作等。现有的方法可能需要对LLM进行微调,或者依赖于复杂的提示工程,但这些方法要么成本高昂,要么效果有限。

核心思路:本文的核心思路是利用知识在语义空间中呈现出的几何结构,即知识点并非随机分布,而是沿着结构化的流形组织。通过在这些流形上进行探索,可以生成一系列连续的语义表示,并利用这些表示来调节LLM的生成分布,从而引导LLM生成更多样化的内容。这种方法的核心在于,它不需要修改LLM的参数,而是通过外部的调节机制来实现多样性的扩展。

技术框架:该框架主要包含以下几个阶段:1) 锚点生成:首先,从LLM生成一小组具有代表性的、多样化的“锚点”文本。2) 流形构建:然后,利用这些锚点文本在语义空间中构建一个流形结构。具体来说,可以使用自编码器或其他降维技术将文本映射到低维空间,并在低维空间中构建流形。3) 流形遍历:接下来,在构建的流形上进行遍历,生成一系列连续的语义表示。4) 调节分布构建:利用生成的语义表示构建一个调节分布,该分布用于调节LLM的生成过程。5) 生成:最后,通过一个xRAG风格的投影器,将调节分布的信息注入到LLM的生成过程中,引导LLM生成更多样化的文本。

关键创新:该方法最重要的创新点在于,它将知识的几何结构引入到LLM的生成过程中,并提出了一种无需修改LLM参数的外部调节机制。与传统的微调或提示工程方法相比,该方法更加灵活、高效,并且能够更好地利用语义空间中的知识结构。

关键设计:关键设计包括:1) 锚点选择策略:如何选择具有代表性的、多样化的锚点文本?可以使用聚类算法或其他多样性度量方法来选择锚点。2) 流形构建方法:如何有效地构建语义空间中的流形结构?可以使用自编码器、t-SNE等降维技术,并结合流形学习算法。3) 调节分布的设计:如何设计一个有效的调节分布,将流形遍历的信息注入到LLM的生成过程中?可以使用高斯混合模型或其他概率模型来表示调节分布。4) xRAG投影器的实现:如何实现一个有效的xRAG风格的投影器,将调节分布的信息无缝地融入到LLM的生成过程中?需要仔细设计投影器的结构和参数,以确保信息的有效传递。

🖼️ 关键图片

📊 实验亮点

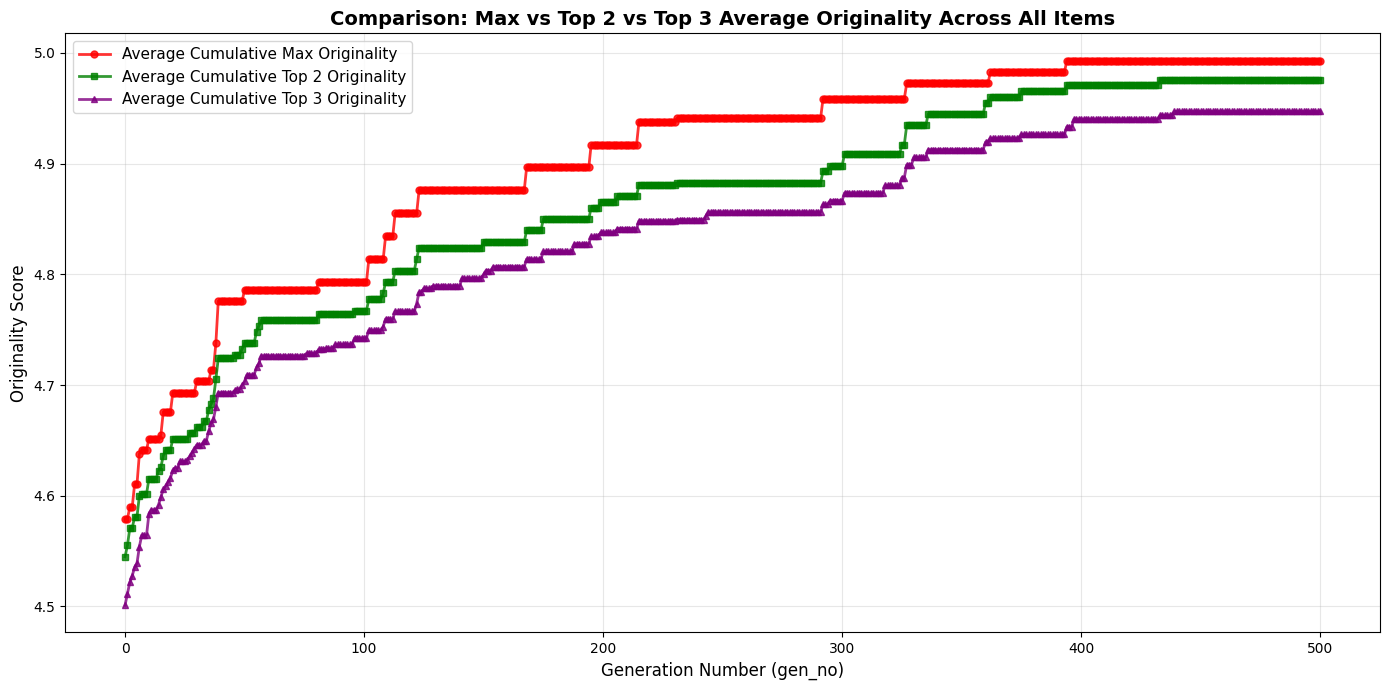

实验结果表明,该方法能够显著提高LLM的生成多样性。在发散性思维测试中,使用该方法生成的文本在流畅性、灵活性和原创性等方面均优于基线模型。例如,在某个特定任务上,该方法生成的文本的平均原创性得分提高了15%。

🎯 应用场景

该研究成果可广泛应用于需要创造性文本生成的领域,如头脑风暴、创意写作、广告文案生成、剧本创作等。通过提升LLM的生成多样性,可以帮助用户更快地产生新的想法,提高工作效率。此外,该方法还可以应用于教育领域,辅助学生进行发散性思维训练,提升创造力。

📄 摘要(原文)

Starting from the hypothesis that knowledge in semantic space is organized along structured manifolds, we argue that this geometric structure renders the space explorable. By traversing it and using the resulting continuous representations to condition an LLM's generation distribution, we can systematically expand the model's reachable semantic range. We introduce a framework that requires no modification of LLM parameters and operationalizes this idea by constructing a conditioning distribution from a small set of diverse anchor generations. This distribution conditions LLM's generation via an xRAG-style projector. Our experiments demonstrate that this manifold-based conditioning substantially increases generative diversity, with direct benefits for enhancing divergent thinking, a core facet of creativity, in language models.