Modeling the Economic Impacts of AI Openness Regulation

作者: Tori Qiu, Benjamin Laufer, Jon Kleinberg, Hoda Heidari

分类: cs.GT, cs.AI, cs.CY

发布日期: 2025-07-14 (更新: 2025-10-24)

💡 一句话要点

构建AI开放性监管的经济影响模型,评估不同开放标准对开发者激励的影响

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: AI开放性监管 博弈论模型 开源标准 经济激励 AI治理

📋 核心要点

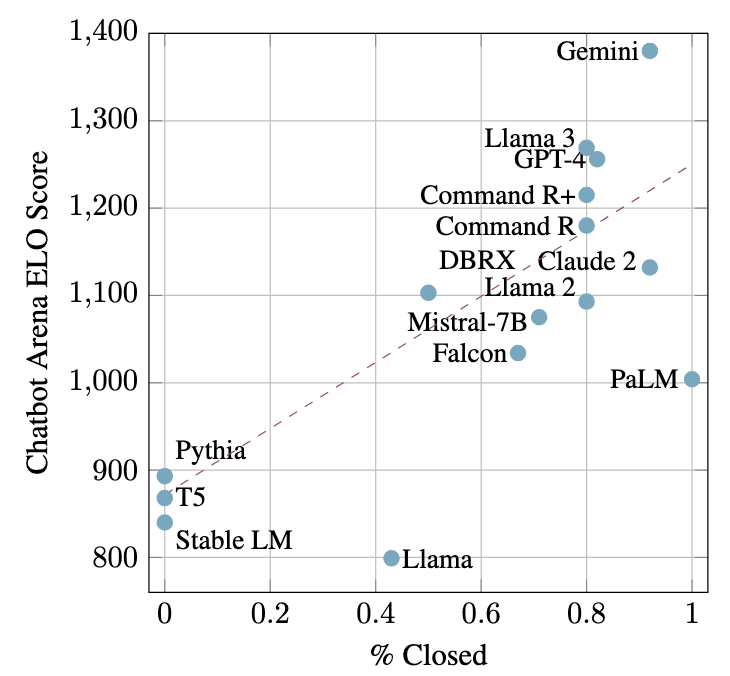

- 现有AI监管框架对开源AI模型的定义模糊,影响了开发者对开放策略的决策。

- 论文构建了一个通用模型创建者和微调者之间的博弈模型,分析不同开放标准下的市场均衡。

- 研究结果表明,模型的基线性能是影响监管处罚和开源阈值效果的关键因素。

📝 摘要(中文)

本研究针对欧盟AI法案等鼓励通用AI模型开放的监管框架,特别是对“开源”模型提供法律豁免的情况,构建了一个模型来分析AI开放性监管的经济影响。由于开源基础模型的定义仍然模糊,本文模拟了通用模型创建者(通才)和将通用模型微调到特定领域或任务的实体(专家)之间的战略互动,以应对模型开放性的监管要求。我们提出了一个规范化的监管者选择开源定义的模型,以评估哪种AI开放标准将为开发者建立适当的经济激励。研究结果描述了各种开放性监管下的市场均衡,特别是上游模型发布决策和下游微调工作,并提出了一系列有效的监管处罚和开源阈值。总体而言,我们发现模型的基线性能决定了何时增加监管处罚与开源阈值将显著改变通才的发布策略。我们的模型为围绕开放性的AI治理决策提供了理论基础,并能够评估和改进实际的开源策略。

🔬 方法详解

问题定义:论文旨在解决AI开放性监管政策如何影响通用AI模型(general-purpose AI models)的开发者和下游微调者(fine-tuners)的经济激励问题。现有方法缺乏对不同开放标准下市场均衡的建模,无法有效评估监管政策的效果。特别是,开源定义的不明确性导致开发者难以判断是否应该开放模型,以及如何开放模型才能最大化自身利益。

核心思路:论文的核心思路是构建一个博弈论模型,模拟通用模型创建者(generalist)和下游微调者(specialist)在不同开放性监管下的战略互动。通过分析市场均衡,研究不同开放标准(例如,不同的开源阈值和监管处罚)对开发者发布策略和微调努力的影响。该模型允许评估不同监管政策对开发者激励的有效性,并为AI治理决策提供理论基础。

技术框架:该模型包含以下主要组成部分:1) 通用模型创建者(generalist),其目标是最大化模型发布后的收益,需要决定是否以及如何开放模型。2) 下游微调者(specialist),其目标是利用通用模型进行微调,以适应特定领域或任务,并从中获利。3) 监管者,其目标是制定合适的开放标准,以促进AI创新和公平竞争。模型通过博弈论框架分析这三个参与者之间的战略互动,并求解市场均衡。

关键创新:论文的关键创新在于将经济学模型应用于AI开放性监管问题,并提出了一个规范化的模型来评估不同开放标准的影响。该模型考虑了通用模型创建者和下游微调者之间的战略互动,以及监管政策对开发者激励的影响。此外,该模型还强调了模型基线性能在决定监管政策效果中的重要作用。

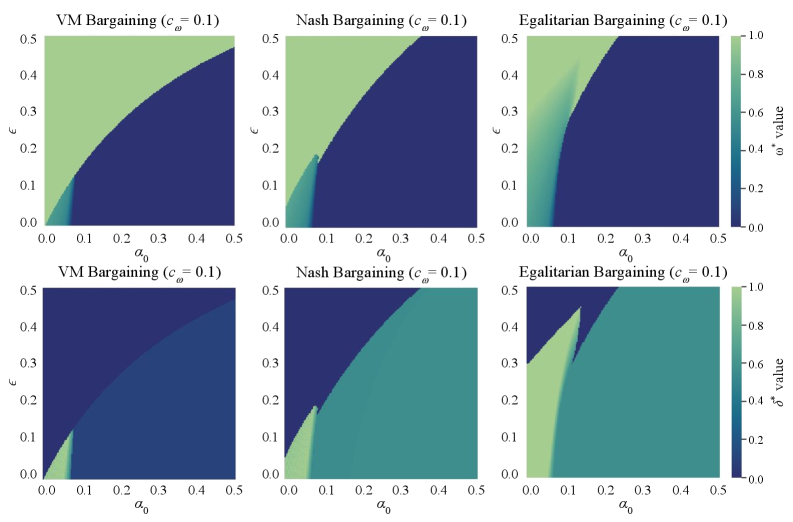

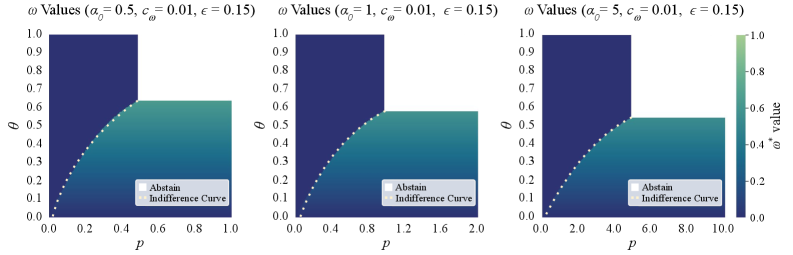

关键设计:模型中涉及的关键参数包括:1) 开源阈值,定义了模型开放的程度。2) 监管处罚,对不符合开放标准的行为进行惩罚。3) 模型的基线性能,影响了下游微调的难度和收益。4) 通用模型创建者和下游微调者的成本函数,描述了开发和微调模型的成本。模型通过求解博弈均衡,分析这些参数对开发者发布策略和微调努力的影响。

🖼️ 关键图片

📊 实验亮点

研究结果表明,模型的基线性能是影响监管政策效果的关键因素。当模型基线性能较低时,增加监管处罚比提高开源阈值更能有效改变通用模型创建者的发布策略。该模型还量化了不同开放标准下的市场均衡,为AI监管政策的制定提供了数据支持。

🎯 应用场景

该研究成果可应用于AI监管政策的制定,帮助监管者选择合适的开放标准,以促进AI创新和公平竞争。此外,该模型还可以为AI开发者提供决策支持,帮助他们判断是否应该开放模型,以及如何开放模型才能最大化自身利益。该研究对开源AI模型的治理和发展具有重要意义。

📄 摘要(原文)

Regulatory frameworks, such as the EU AI Act, encourage openness of general-purpose AI models by offering legal exemptions for "open-source" models. Despite this legislative attention on openness, the definition of open-source foundation models remains ambiguous. This paper models the strategic interactions among the creator of a general-purpose model (the generalist) and the entity that fine-tunes the general-purpose model to a specialized domain or task (the specialist), in response to regulatory requirements on model openness. We present a stylized model of the regulator's choice of an open-source definition to evaluate which AI openness standards will establish appropriate economic incentives for developers. Our results characterize market equilibria -- specifically, upstream model release decisions and downstream fine-tuning efforts -- under various openness regulations and present a range of effective regulatory penalties and open-source thresholds. Overall, we find the model's baseline performance determines when increasing the regulatory penalty vs. the open-source threshold will significantly alter the generalist's release strategy. Our model provides a theoretical foundation for AI governance decisions around openness and enables evaluation and refinement of practical open-source policies.