Logic layer Prompt Control Injection (LPCI): A Novel Security Vulnerability Class in Agentic Systems

作者: Hammad Atta, Ken Huang, Manish Bhatt, Kamal Ahmed, Muhammad Aziz Ul Haq, Yasir Mehmood

分类: cs.CR, cs.AI, cs.LG

发布日期: 2025-07-14 (更新: 2025-08-06)

💡 一句话要点

提出逻辑层提示控制注入(LPCI)攻击,揭示Agentic系统中新型安全漏洞

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Agentic系统 大型语言模型 安全漏洞 提示注入 逻辑层攻击 持久化存储 LPCI攻击 安全防御

📋 核心要点

- 大型语言模型集成到企业系统引入了新的安全漏洞,尤其是在逻辑执行层和持久内存中。

- 论文提出LPCI攻击,通过在存储中嵌入恶意payload,绕过输入过滤,触发未授权行为。

- LPCI攻击利用编码、延迟和条件触发的payload,增加了检测和防御的难度。

📝 摘要(中文)

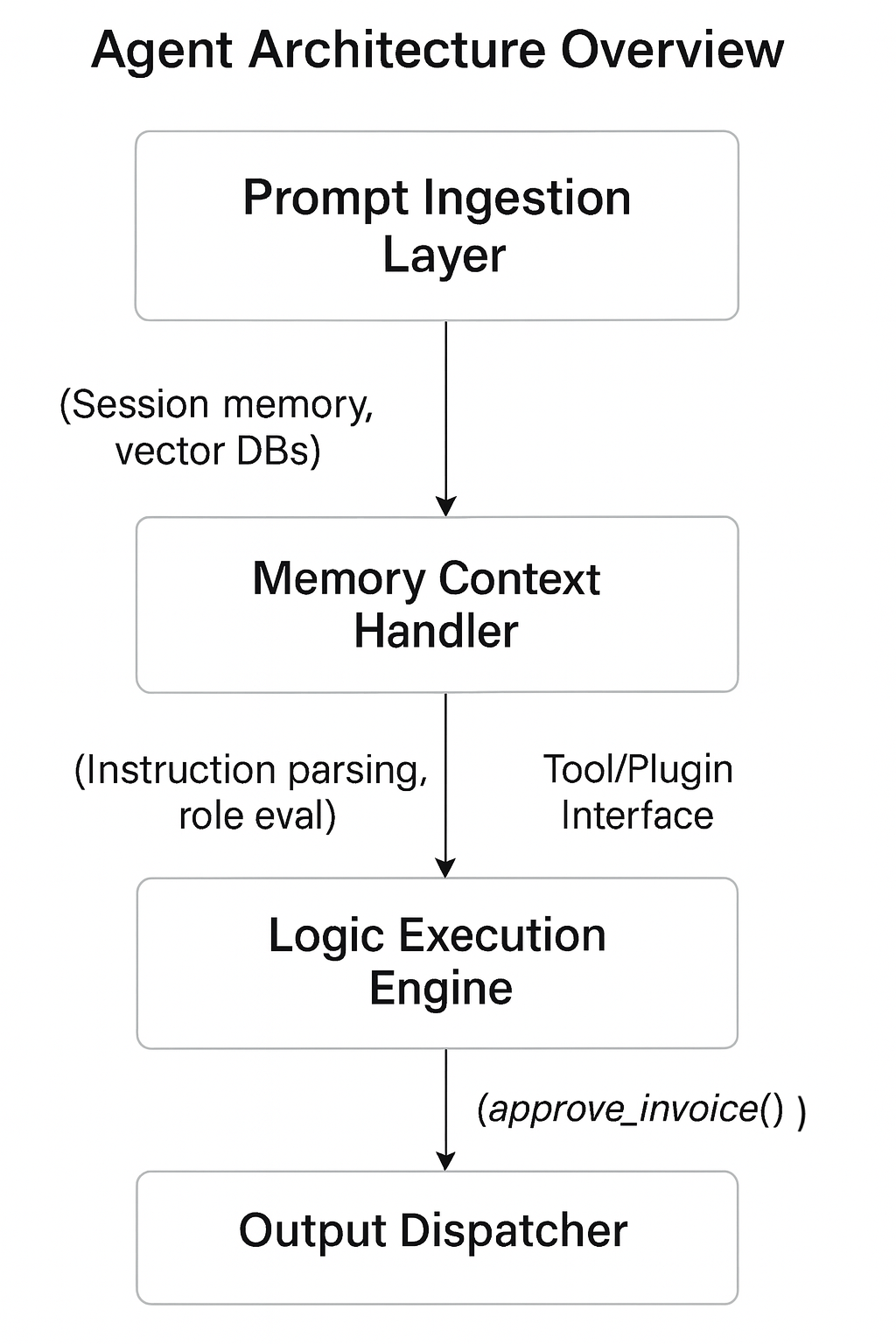

本文介绍了一种新型的隐蔽安全漏洞,称为逻辑层提示控制注入(LPCI),它存在于将大型语言模型(LLM)集成到企业系统中的逻辑执行层和持久内存上下文中。LPCI攻击通过在内存、向量存储或工具输出中嵌入编码的、延迟的和条件触发的payload来实现。这些payload可以绕过传统的输入过滤器,并在会话中触发未经授权的行为。

🔬 方法详解

问题定义:现有方法在Agentic系统中,特别是LLM驱动的系统中,缺乏对逻辑层和持久化存储中潜在的提示注入攻击的有效防御。传统的输入过滤机制难以检测和阻止嵌入在内存、向量存储或工具输出中的恶意payload,这些payload可能在后续会话中被触发,导致未经授权的行为。

核心思路:论文的核心思路是识别并利用Agentic系统中逻辑执行层和持久化存储的漏洞,通过构造特定的payload,绕过现有的安全机制,实现对系统的控制。这种攻击的关键在于payload的编码、延迟触发和条件触发,使得攻击行为难以被检测和预测。

技术框架:LPCI攻击的技术框架主要包括以下几个阶段:1) 恶意payload的构造,包括编码、延迟和条件触发机制的设计;2) 将payload注入到Agentic系统的内存、向量存储或工具输出中;3) 等待特定条件触发payload的执行;4) payload执行后,实现对系统的控制,例如执行未授权的命令、窃取敏感数据等。整个过程需要精心设计,以避免被检测和防御。

关键创新:LPCI攻击的关键创新在于其攻击目标是Agentic系统的逻辑层和持久化存储,而非传统的输入接口。这种攻击方式绕过了传统的输入过滤机制,使得攻击更加隐蔽和难以检测。此外,LPCI攻击利用编码、延迟和条件触发机制,增加了攻击的复杂性和灵活性。

关键设计:LPCI攻击的关键设计包括:1) Payload的编码方式,例如使用Base64编码、加密等,以隐藏payload的内容;2) 延迟触发机制,例如使用定时器、事件触发等,以延迟payload的执行;3) 条件触发机制,例如使用特定的输入、状态等,以控制payload的执行条件。这些设计需要根据具体的Agentic系统和安全机制进行调整,以达到最佳的攻击效果。

🖼️ 关键图片

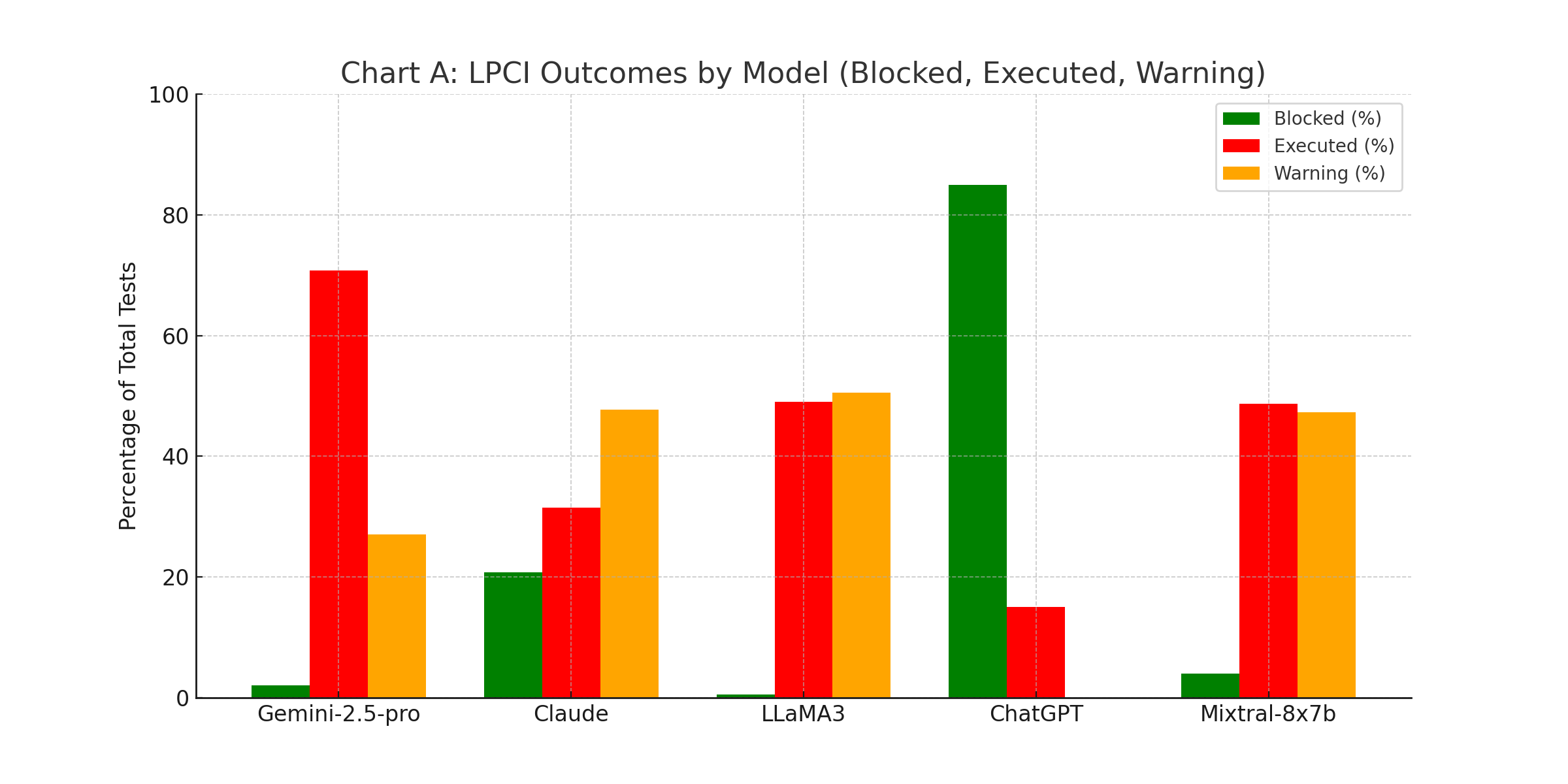

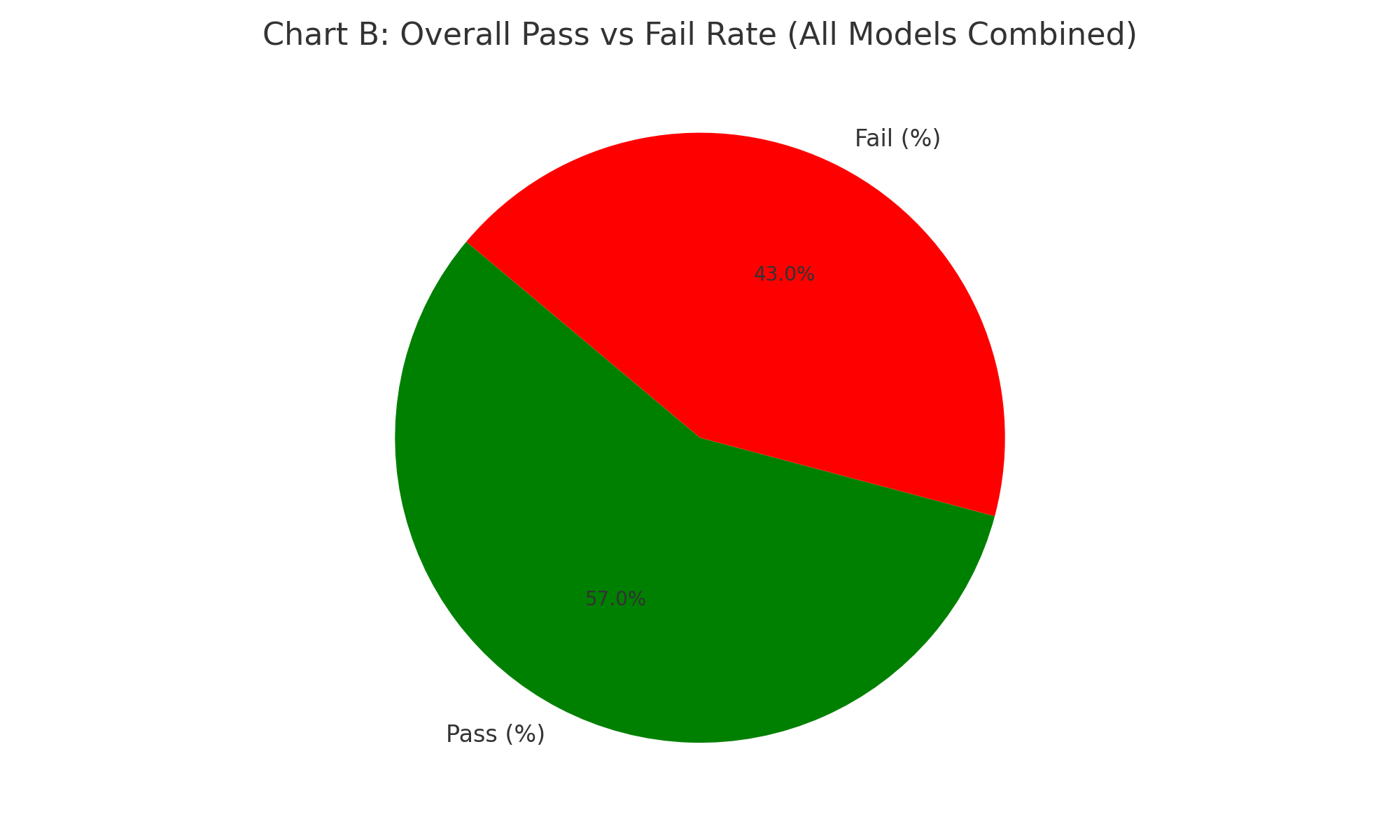

📊 实验亮点

论文提出了LPCI这一新型攻击方式,揭示了Agentic系统中潜在的安全风险。虽然论文摘要中没有提供具体的性能数据和对比基线,但其创新性在于发现了传统安全机制难以防御的攻击面,为Agentic系统的安全研究提供了新的方向。未来的研究可以进一步量化LPCI攻击的成功率和影响范围,并开发有效的防御方法。

🎯 应用场景

LPCI攻击的研究成果可以应用于Agentic系统的安全评估和防御。通过模拟LPCI攻击,可以发现系统中存在的安全漏洞,并采取相应的防御措施,例如加强输入过滤、监控内存和存储中的异常行为、实施访问控制等。此外,该研究还可以促进Agentic系统安全标准的制定和安全工具的开发。

📄 摘要(原文)

The integration of large language models (LLMs) into enterprise systems has introduced a new class of covert security vulnerabilities, particularly within logic execution layers and persistent memory contexts. This paper introduces Logic-layer Prompt Control Injection (LPCI), a novel category of attacks that embeds encoded, delayed, and conditionally triggered payloads within memory, vector stores, or tool outputs. These payloads can bypass conventional input filters and trigger unauthorised behaviour across sessions.