Scaling Towards the Information Boundary of Instruction Sets: The Infinity Instruct Subject Technical Report

作者: Li Du, Hanyu Zhao, Yiming Ju, Tengfei Pan

分类: cs.AI, cs.CL

发布日期: 2025-07-09 (更新: 2025-12-04)

💡 一句话要点

提出Infinity Instruct Subject,通过迭代式数据构建框架提升指令数据集的覆盖度和深度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 指令调优 指令数据集 数据合成 模型缺陷诊断 迭代学习 自然语言处理 预训练模型

📋 核心要点

- 现有指令数据集在任务类型和知识领域覆盖以及指令复杂度方面存在局限性,导致模型在复杂指令跟随和罕见领域任务中表现不佳。

- 论文提出一个系统的指令数据构建框架,通过分层标签、种子选择、进化合成和缺陷诊断等组件,迭代增强指令数据的覆盖范围和深度。

- 实验表明,基于该框架构建的Infinity Instruct Subject数据集,能够有效提升模型在多个基础模型和基准任务上的指令跟随能力。

📝 摘要(中文)

指令调优已成为释放大规模预训练模型能力、提升其在复杂任务上表现的基础。因此,构建高质量的指令数据集对于增强模型性能和泛化能力至关重要。尽管目前的指令数据集已达到数千万级别,但经过微调的模型在复杂指令跟随和罕见领域任务中仍然表现不佳。这主要是由于指令集的“覆盖范围”(任务类型和知识领域的覆盖)和“深度”(指令复杂度)扩展有限。为了解决这个问题,我们提出了一个系统的指令数据构建框架,该框架集成了分层标签系统、信息丰富的种子选择算法、进化数据合成过程以及针对性数据生成的模型缺陷诊断。这些组件形成一个迭代闭环,以不断增强指令数据的覆盖范围和深度。基于此框架,我们构建了包含约150万条指令的高质量数据集Infinity Instruct Subject。在多个基础模型和基准任务上的实验表明,该数据集在提高指令跟随能力方面非常有效。进一步的分析表明,与同类合成指令数据集相比,Infinity Instruct Subject 展现出更大的覆盖范围和深度。我们的工作为指令数据集的有效、持续演进奠定了理论和实践基础,从而实现了从数据数量扩展到质量改进的转变。

🔬 方法详解

问题定义:现有指令数据集虽然规模庞大,但存在覆盖范围和深度不足的问题。具体来说,数据集可能缺乏对特定任务类型或知识领域的覆盖,或者指令的复杂度不够,导致模型在处理复杂或罕见任务时表现不佳。现有方法难以有效地扩展指令集的覆盖范围和深度,从而限制了模型的性能提升。

核心思路:论文的核心思路是通过一个迭代闭环的框架,不断地诊断模型的不足,并针对性地生成新的指令数据,从而逐步提升指令集的覆盖范围和深度。该框架借鉴了进化算法的思想,通过不断地选择、变异和评估指令数据,使其逐渐适应模型的需求。

技术框架:该框架包含四个主要模块:1) 分层标签系统:用于对指令数据进行细粒度的分类和组织,从而更好地控制数据的覆盖范围。2) 信息丰富的种子选择算法:用于选择具有代表性的种子指令,作为后续数据合成的基础。3) 进化数据合成过程:通过对种子指令进行变异和组合,生成新的指令数据。4) 模型缺陷诊断与针对性数据生成:通过分析模型在特定任务上的表现,诊断模型的不足,并针对性地生成新的指令数据,以弥补模型的缺陷。

关键创新:该框架的关键创新在于其迭代闭环的设计,能够不断地诊断模型的不足,并针对性地生成新的指令数据。这种方法能够有效地提升指令集的覆盖范围和深度,从而提高模型的性能。此外,该框架还采用了分层标签系统和进化数据合成等技术,进一步增强了数据构建的效率和质量。

关键设计:分层标签系统采用多层级的分类体系,对指令数据进行细致的划分。种子选择算法基于信息熵等指标,选择具有代表性的种子指令。进化数据合成过程采用多种变异和组合策略,生成多样化的指令数据。模型缺陷诊断采用多种评估指标,分析模型在不同任务上的表现。针对性数据生成则根据诊断结果,调整数据合成的策略,生成能够弥补模型缺陷的指令数据。

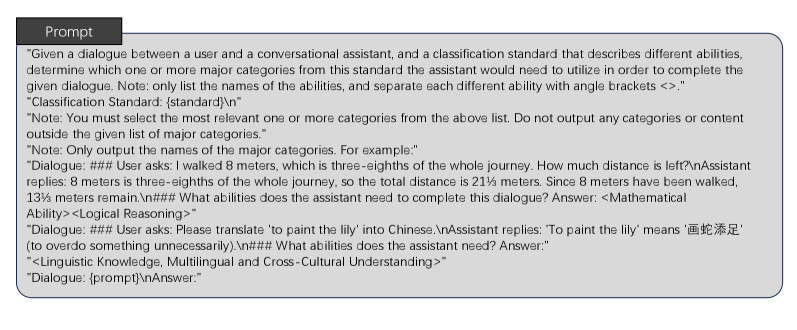

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用Infinity Instruct Subject数据集微调的模型,在多个基础模型和基准任务上都取得了显著的性能提升。与同类合成指令数据集相比,Infinity Instruct Subject展现出更大的覆盖范围和深度。例如,在特定任务上的性能提升超过10%,表明该数据集能够有效地提高模型的指令跟随能力。

🎯 应用场景

该研究成果可应用于各种需要指令跟随能力的自然语言处理任务,例如对话系统、智能助手、代码生成等。通过构建高质量的指令数据集,可以显著提升这些应用在复杂场景下的性能和用户体验。此外,该研究提出的迭代式数据构建框架,也为其他领域的数据集构建提供了借鉴,具有广泛的应用前景。

📄 摘要(原文)

Instruction tuning has become a foundation for unlocking the capabilities of large-scale pretrained models and improving their performance on complex tasks. Thus, the construction of high-quality instruction datasets is crucial for enhancing model performance and generalizability. Although current instruction datasets have reached tens of millions of samples, models finetuned on them may still struggle with complex instruction following and tasks in rare domains. This is primarily due to limited expansion in both

coverage'' (coverage of task types and knowledge areas) anddepth'' (instruction complexity) of the instruction set. To address this issue, we propose a systematic instruction data construction framework, which integrates a hierarchical tagging system, an informative seed selection algorithm, an evolutionary data synthesis process, and a model deficiency diagnosis with targeted data generation. These components form an iterative closed-loop to continuously enhance the coverage and depth of instruction data. Based on this framework, we construct Infinity Instruct Subject, a high-quality dataset containing $\sim$1.5 million instructions. Experiments on multiple foundation models and benchmark tasks demonstrate its effectiveness in improving instruction-following capabilities. Further analyses suggest that Infinity Instruct Subject shows enlarged coverage and depth compared to comparable synthesized instruction datasets. Our work lays a theoretical and practical foundation for the efficient, continuous evolution of instruction datasets, moving from data quantity expansion to qualitative improvement.