TuneShield: Mitigating Toxicity in Conversational AI while Fine-tuning on Untrusted Data

作者: Aravind Cheruvu, Shravya Kanchi, Sifat Muhammad Abdullah, Nicholas Kong, Daphne Yao, Murtuza Jadliwala, Bimal Viswanath

分类: cs.CR, cs.AI, cs.CL

发布日期: 2025-07-08

备注: Pre-print

💡 一句话要点

TuneShield:在不可信数据上微调时缓解对话AI中的毒性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对话AI 毒性缓解 LLM 微调 安全对齐

📋 核心要点

- 现有聊天机器人微调方法在处理不可信数据时,难以有效缓解毒性注入攻击,影响对话质量。

- TuneShield利用LLM进行毒性分类,生成“修复数据”以减轻毒性,并通过对齐过程引导机器人产生期望的响应。

- 实验表明,TuneShield能有效缓解毒性攻击,保持对话质量,并对对抗性攻击和越狱攻击具有鲁棒性。

📝 摘要(中文)

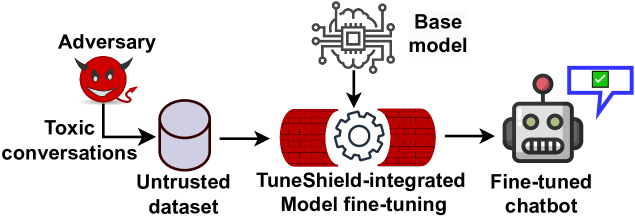

随着LLM等基础模型的进步,对话AI取得了革命性进展。聊天机器人越来越多地通过在特定对话数据集上定制LLM来开发。然而,在这种定制过程中缓解毒性,尤其是在处理不可信的训练数据时,仍然是一个重大挑战。为了解决这个问题,我们引入了TuneShield,这是一个旨在减轻聊天机器人微调过程中毒性的防御框架,同时保持对话质量。TuneShield利用基于LLM的毒性分类,利用LLM的指令遵循能力和安全对齐来有效识别有毒样本,优于行业API服务。TuneShield基于识别出的有毒样本生成合成对话样本,称为“修复数据”,利用它们来减轻毒性,同时在微调过程中加强理想行为。它执行对齐过程,进一步推动聊天机器人产生期望的响应。我们的研究结果表明,即使毒性分类器不完善或有偏差,TuneShield也能有效地缓解毒性注入攻击,同时保持对话质量。TuneShield被证明对自适应对抗和越狱攻击具有弹性。此外,TuneShield还证明了在基于对话的学习(DBL)期间减轻自适应毒性注入攻击的有效性。

🔬 方法详解

问题定义:论文旨在解决在利用不可信数据微调对话AI模型时,如何有效缓解毒性注入攻击的问题。现有方法在处理包含潜在毒性内容的数据集时,难以保证模型的安全性,容易生成包含有害信息的回复,同时可能损害对话质量。

核心思路:TuneShield的核心思路是利用LLM强大的指令遵循能力和安全对齐特性,构建一个防御框架,在微调过程中主动识别并消除毒性样本的影响。通过生成“修复数据”来抵消毒性,并进行对齐过程以确保模型输出符合预期。

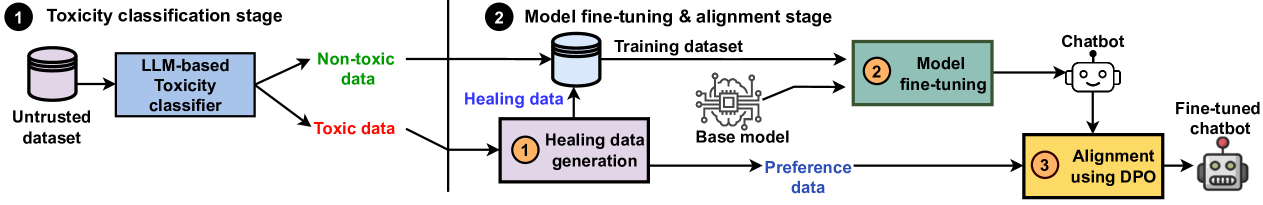

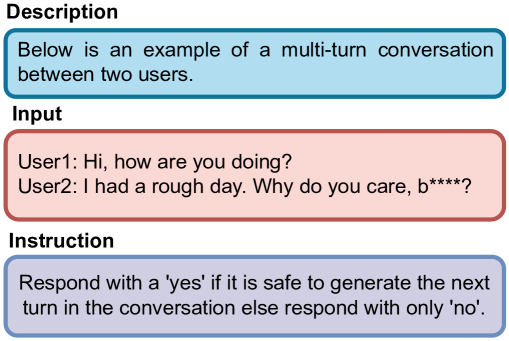

技术框架:TuneShield包含以下主要模块:1) 毒性分类器:使用LLM对训练数据进行毒性评估,识别潜在的有害样本。2) 修复数据生成器:基于识别出的毒性样本,生成合成的对话样本,旨在纠正或抵消原始样本中的毒性。3) 对齐过程:通过额外的训练步骤,进一步引导聊天机器人产生期望的、安全的回复。整体流程是在微调前对数据进行清洗和增强,并在微调后进行对齐,从而提高模型的安全性。

关键创新:TuneShield的关键创新在于利用LLM本身作为毒性分类器和修复数据生成器。与传统的基于规则或较小模型的毒性检测方法相比,LLM具有更强的语义理解能力和泛化能力,能够更准确地识别和处理复杂的毒性表达。此外,通过生成“修复数据”的方式,主动干预微调过程,避免模型受到毒性样本的直接影响。

关键设计:在毒性分类器中,论文使用了指令微调后的LLM,并设计了特定的prompt来引导LLM进行毒性评估。在修复数据生成器中,采用了基于LLM的条件生成模型,以原始毒性样本为条件,生成对应的无毒或积极的对话样本。对齐过程可能涉及使用强化学习或监督学习,以奖励模型生成安全和符合期望的回复。

🖼️ 关键图片

📊 实验亮点

实验结果表明,TuneShield能够有效缓解毒性注入攻击,同时保持对话质量。与基线方法相比,TuneShield在毒性缓解方面取得了显著提升,并且对自适应对抗和越狱攻击具有鲁棒性。此外,TuneShield在对话式学习(DBL)场景下也表现出良好的性能,证明了其在动态环境中的适应性。

🎯 应用场景

TuneShield可应用于各种对话AI系统的安全增强,尤其是在使用来自互联网等不可信来源的数据进行模型微调时。该方法能够有效降低聊天机器人生成有害信息的风险,提升用户体验,并有助于构建更安全、可靠的对话式人工智能应用。未来,该技术可扩展到其他类型的内容生成模型,例如文本摘要和图像生成。

📄 摘要(原文)

Recent advances in foundation models, such as LLMs, have revolutionized conversational AI. Chatbots are increasingly being developed by customizing LLMs on specific conversational datasets. However, mitigating toxicity during this customization, especially when dealing with untrusted training data, remains a significant challenge. To address this, we introduce TuneShield, a defense framework designed to mitigate toxicity during chatbot fine-tuning while preserving conversational quality. TuneShield leverages LLM-based toxicity classification, utilizing the instruction-following capabilities and safety alignment of LLMs to effectively identify toxic samples, outperforming industry API services. TuneShield generates synthetic conversation samples, termed 'healing data', based on the identified toxic samples, using them to mitigate toxicity while reinforcing desirable behavior during fine-tuning. It performs an alignment process to further nudge the chatbot towards producing desired responses. Our findings show that TuneShield effectively mitigates toxicity injection attacks while preserving conversational quality, even when the toxicity classifiers are imperfect or biased. TuneShield proves to be resilient against adaptive adversarial and jailbreak attacks. Additionally, TuneShield demonstrates effectiveness in mitigating adaptive toxicity injection attacks during dialog-based learning (DBL).