A Query-Aware Multi-Path Knowledge Graph Fusion Approach for Enhancing Retrieval-Augmented Generation in Large Language Models

作者: Qikai Wei, Huansheng Ning, Chunlong Han, Jianguo Ding

分类: cs.IR, cs.AI, cs.CL

发布日期: 2025-07-07

💡 一句话要点

提出QMKGF,通过查询感知的多路径知识图谱融合增强大语言模型的检索增强生成效果。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强生成 知识图谱 多路径融合 查询感知 大语言模型

📋 核心要点

- 现有RAG方法侧重于检索孤立片段,忽略了片段间的内在联系,限制了生成质量。

- QMKGF方法构建查询感知的多路径知识图谱,融合一跳、多跳和重要性关系,提升语义相关性。

- 实验表明,QMKGF在HotpotQA数据集上ROUGE-1得分达到64.98%,显著优于BGE-Rerank方法。

📝 摘要(中文)

检索增强生成(RAG)已逐渐成为提高大型语言模型(LLM)生成内容的准确性和事实一致性的有前景的范例。然而,现有的RAG研究主要集中在使用基于相似性的匹配方法检索孤立的片段,而忽略了它们之间的内在联系,这限制了RAG任务的性能。为了解决这个问题,我们提出了QMKGF,一种查询感知的多路径知识图谱融合方法,用于增强检索增强生成。首先,我们设计提示模板,并利用通用LLM来提取实体和关系,从而高效地生成知识图谱(KG)。基于构建的KG,我们引入了一种多路径子图构建策略,该策略结合了一跳关系、多跳关系和基于重要性的关系,旨在提高检索到的文档和用户查询之间的语义相关性。随后,我们设计了一个查询感知的注意力奖励模型,该模型根据子图三元组与查询的语义相关性对其进行评分。然后,我们选择得分最高的子图,并使用来自其他与查询高度语义相关的子图的附加三元组来丰富子图。最后,更新后的子图中的实体、关系和三元组被用来扩展原始查询,从而增强其语义表示并提高LLM的生成质量。我们在SQuAD、IIRC、Culture、HotpotQA和MuSiQue数据集上评估QMKGF。在HotpotQA数据集上,我们的方法达到了64.98%的ROUGE-1得分,超过了BGE-Rerank方法9.72个百分点(从55.26%到64.98%)。实验结果证明了QMKGF方法的有效性和优越性。

🔬 方法详解

问题定义:现有检索增强生成(RAG)方法主要依赖于相似度匹配来检索文档片段,忽略了文档片段之间的内在联系,导致检索结果的语义完整性不足,进而影响大语言模型生成内容的质量和准确性。现有方法难以有效利用知识图谱中蕴含的丰富关系信息,无法充分理解用户查询的深层语义。

核心思路:QMKGF的核心思路是构建一个查询感知的多路径知识图谱,并利用该知识图谱来增强检索过程。通过提取实体和关系构建知识图谱,并设计多路径子图构建策略,将一跳、多跳和基于重要性的关系纳入考虑,从而提升检索文档与用户查询之间的语义相关性。利用查询感知的注意力奖励模型对子图三元组进行评分,选择并丰富子图,最终利用更新后的子图来扩展原始查询,提升查询的语义表达能力。

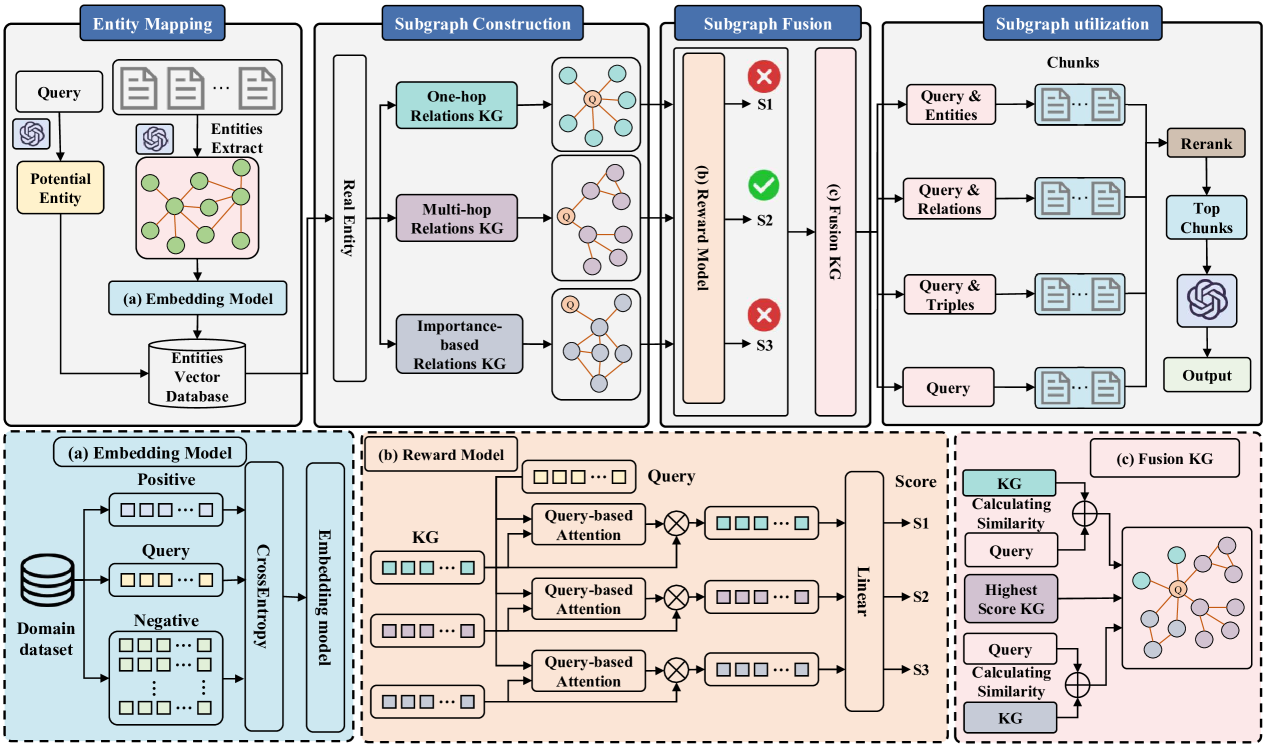

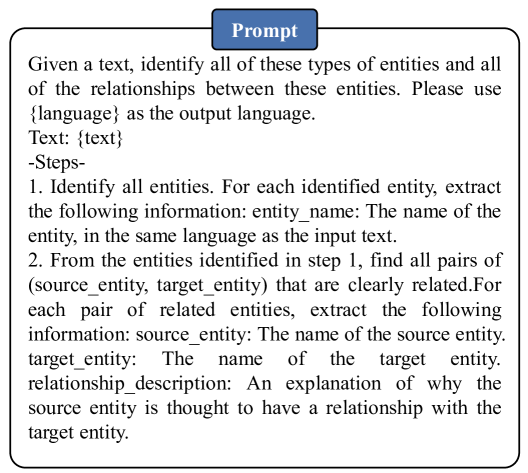

技术框架:QMKGF方法包含以下几个主要阶段: 1. 知识图谱构建:利用提示模板和通用大语言模型提取实体和关系,构建知识图谱。 2. 多路径子图构建:基于知识图谱,构建包含一跳、多跳和重要性关系的多路径子图。 3. 子图评分与选择:设计查询感知的注意力奖励模型,对子图三元组进行评分,选择得分最高的子图。 4. 子图丰富:使用来自其他与查询高度语义相关的子图的附加三元组来丰富选定的子图。 5. 查询扩展:利用更新后的子图中的实体、关系和三元组来扩展原始查询。

关键创新:QMKGF的关键创新在于: 1. 提出了多路径子图构建策略,综合考虑了一跳、多跳和基于重要性的关系,更全面地捕捉了知识图谱中的语义信息。 2. 设计了查询感知的注意力奖励模型,能够根据查询的语义相关性对子图三元组进行评分,从而更准确地选择与查询相关的子图。 3. 通过子图丰富和查询扩展,有效提升了查询的语义表达能力,从而改善了检索增强生成的效果。

关键设计: * 提示模板设计:设计合适的提示模板,引导大语言模型准确地提取实体和关系。 * 多路径子图构建策略:确定一跳、多跳和重要性关系的具体计算方法和阈值。 * 注意力奖励模型:设计合适的注意力机制和奖励函数,以准确评估子图三元组与查询的语义相关性。 * 子图丰富策略:选择合适的语义相似度度量方法,确定用于丰富子图的附加三元组的数量。

🖼️ 关键图片

📊 实验亮点

QMKGF方法在HotpotQA数据集上取得了显著的性能提升,ROUGE-1得分达到64.98%,相比于BGE-Rerank方法提升了9.72个百分点。实验结果表明,QMKGF方法能够有效利用知识图谱中的关系信息,提升检索增强生成的效果,并在多个数据集上验证了其有效性和优越性。

🎯 应用场景

QMKGF方法可应用于问答系统、对话生成、信息检索等领域。通过增强检索结果的语义完整性和相关性,可以提高大语言模型生成内容的质量和准确性,从而提升用户体验。该方法在需要利用知识图谱进行推理和知识增强的场景下具有广泛的应用前景。

📄 摘要(原文)

Retrieval Augmented Generation (RAG) has gradually emerged as a promising paradigm for enhancing the accuracy and factual consistency of content generated by large language models (LLMs). However, existing RAG studies primarily focus on retrieving isolated segments using similarity-based matching methods, while overlooking the intrinsic connections between them. This limitation hampers performance in RAG tasks. To address this, we propose QMKGF, a Query-Aware Multi-Path Knowledge Graph Fusion Approach for Enhancing Retrieval Augmented Generation. First, we design prompt templates and employ general-purpose LLMs to extract entities and relations, thereby generating a knowledge graph (KG) efficiently. Based on the constructed KG, we introduce a multi-path subgraph construction strategy that incorporates one-hop relations, multi-hop relations, and importance-based relations, aiming to improve the semantic relevance between the retrieved documents and the user query. Subsequently, we designed a query-aware attention reward model that scores subgraph triples based on their semantic relevance to the query. Then, we select the highest score subgraph and enrich subgraph with additional triples from other subgraphs that are highly semantically relevant to the query. Finally, the entities, relations, and triples within the updated subgraph are utilised to expand the original query, thereby enhancing its semantic representation and improving the quality of LLMs' generation. We evaluate QMKGF on the SQuAD, IIRC, Culture, HotpotQA, and MuSiQue datasets. On the HotpotQA dataset, our method achieves a ROUGE-1 score of 64.98\%, surpassing the BGE-Rerank approach by 9.72 percentage points (from 55.26\% to 64.98\%). Experimental results demonstrate the effectiveness and superiority of the QMKGF approach.