AI Mother Tongue: Self-Emergent Communication in MARL via Endogenous Symbol Systems

作者: Hung Ming Liu

分类: cs.AI, cs.GT, cs.LG, cs.MA, cs.NE

发布日期: 2025-07-07

备注: 30 pages, 4 figures

💡 一句话要点

提出基于内生符号系统的AI母语框架,解决MARL中的涌现通信难题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱四:生成式动作 (Generative Motion) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多智能体强化学习 涌现通信 内生符号系统 向量量化变分自编码器 自主学习 语义压缩 纳什均衡

📋 核心要点

- 现有MARL方法依赖人工归纳偏置促进通信涌现,可能导致过度工程和泛化性不足。

- 提出AI母语(AIM)框架,利用VQ-VAE赋予智能体内生符号系统,实现自主语义压缩和收敛。

- 实验表明,AIM无需外部归纳偏置即可实现有效符号通信,并具备更强的通用性和效率。

📝 摘要(中文)

在去中心化多智能体强化学习(MARL)中,涌现通信的发展长期受到“联合探索困境”的限制,导致智能体陷入“通信真空均衡”。传统方法通过引入归纳偏置来促进通信的涌现。本研究从根本上质疑这种人为的归纳偏置是否过度设计。通过基于向量量化变分自编码器(VQ-VAE)的“AI母语”(AIM)框架的实验,我们证明,当智能体拥有内生符号系统时,它们的神经表征自然表现出自主的语义压缩和纳什均衡驱动的语义收敛,从而在没有外部归纳偏置的情况下实现有效的符号通信。这与最近的神经科学发现(即人脑并不直接使用人类语言进行内部思考)以及大型语言模型(LLM)中的“软思考”能力研究相呼应。与传统的显式通信方法相比,AIM表现出更强的通用性和效率。本研究开发的可解释分析工具包证实,符号使用呈现出显著的幂律分布,从而产生了三个主要的理论见解:“神经通信假说”、“工具优先原则”和“语义可解释性范式”。未来的研究将探索集成分层量化变分自编码器(HQ-VAE)以增强AIM的复杂表达能力,并研究“强化学习(RL)低级预训练”的潜力。这一发现为连接符号主义和连接主义提供了新的途径。

🔬 方法详解

问题定义:在去中心化多智能体强化学习(MARL)中,智能体之间如何有效地进行通信是一个关键问题。传统的涌现通信方法通常依赖于人工设计的归纳偏置,例如预定义的通信协议或共享的词汇表。然而,这些方法可能限制了智能体的探索能力,导致它们陷入“通信真空均衡”,并且泛化能力较差。论文旨在解决如何在没有人工归纳偏置的情况下,使智能体能够自主地学习和发展有效的通信协议。

核心思路:论文的核心思路是赋予智能体内生的符号系统,使其能够自主地进行语义压缩和收敛。通过使用向量量化变分自编码器(VQ-VAE),智能体可以将连续的神经表征映射到离散的符号空间,从而形成自己的“母语”。这种内生的符号系统允许智能体在没有外部干预的情况下,通过强化学习来优化其通信策略。

技术框架:AIM框架主要包含以下几个模块:1)感知模块:智能体通过感知环境获取信息;2)编码器:将感知信息编码为连续的神经表征;3)VQ-VAE:将连续表征量化为离散的符号;4)解码器:将离散符号解码为动作;5)强化学习模块:根据环境反馈调整编码器、解码器和通信策略。整个流程是智能体首先感知环境,然后通过编码器和VQ-VAE将感知信息转化为离散的符号,接着通过解码器将符号转化为动作,最后通过强化学习来优化整个过程。

关键创新:论文最重要的技术创新点在于提出了基于内生符号系统的涌现通信方法。与传统的显式通信方法相比,AIM不需要预定义的通信协议或共享的词汇表,而是允许智能体自主地学习和发展自己的通信方式。这种方法更具通用性和灵活性,并且能够更好地适应不同的环境和任务。

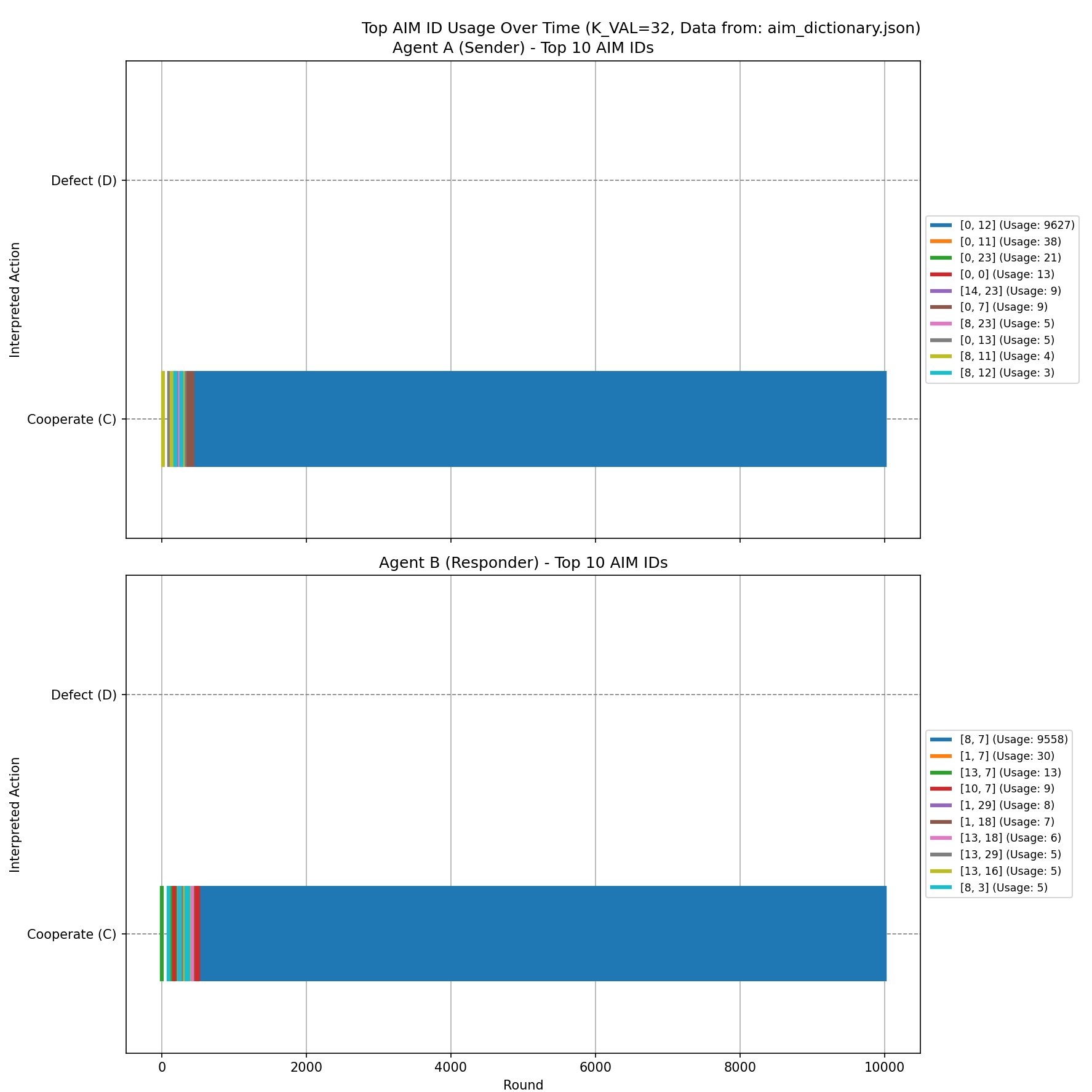

关键设计:在VQ-VAE的设计中,codebook size是一个关键参数,它决定了符号空间的容量。论文通过实验发现,合适的codebook size可以有效地平衡表达能力和泛化能力。此外,论文还设计了一个可解释分析工具包,用于分析智能体的符号使用情况,并验证了符号使用呈现出显著的幂律分布。

🖼️ 关键图片

📊 实验亮点

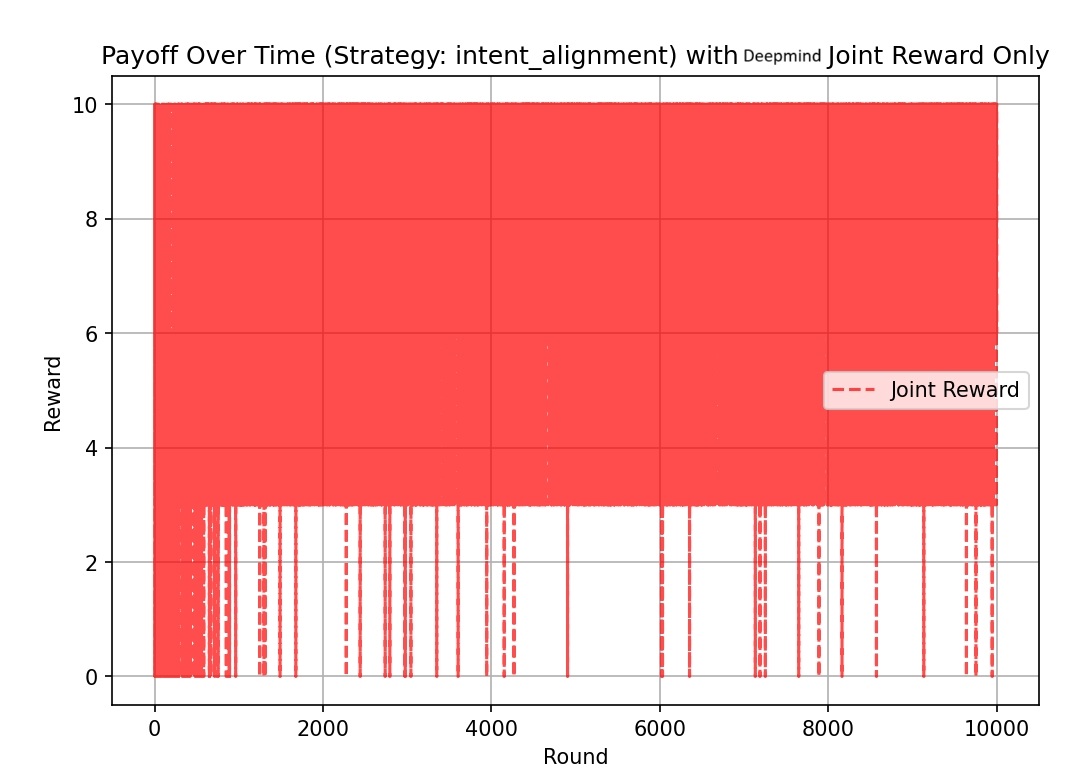

实验结果表明,AIM框架在没有外部归纳偏置的情况下,能够实现有效的符号通信,并且表现出更强的通用性和效率。与传统的显式通信方法相比,AIM在多个任务上取得了显著的性能提升。此外,可解释分析工具包证实,符号使用呈现出显著的幂律分布,验证了“神经通信假说”、“工具优先原则”和“语义可解释性范式”。

🎯 应用场景

该研究成果可应用于机器人协作、自动驾驶、智能交通等领域。通过使智能体自主学习通信协议,可以提高系统的鲁棒性和适应性,降低人工干预成本。此外,该研究对于理解人类语言的起源和发展也具有一定的理论价值,有助于探索符号主义和连接主义的融合。

📄 摘要(原文)

In Decentralized Multi-Agent Reinforcement Learning (MARL), the development of Emergent Communication has long been constrained by the

Joint Exploration Dilemma'', leading agents to fall into aCommunication Vacuum Equilibrium'' . Traditional methods address this by introducing inductive biases to facilitate communication emergence . This study fundamentally questions whether such artificial inductive biases are, in fact, over-engineering. Through experiments with theAI Mother Tongue'' (AIM) framework, based on a Vector Quantized Variational Autoencoder (VQ-VAE), we demonstrate that when agents possess an endogenous symbol system, their neural representations naturally exhibit spontaneous semantic compression and Nash equilibrium-driven semantic convergence, achieving effective symbolic communication without external inductive biases. This aligns with recent neuroscience findings suggesting that the human brain does not directly use human language for internal thought , and resonates with research onsoft thinking'' capabilities in Large Language Models (LLMs) . Compared to traditional explicit communication methods, AIM demonstrates stronger generality and efficiency. The interpretable analysis toolkit developed in this study confirms that symbol usage exhibits a significant power-law distribution, leading to three major theoretical insights: theNeural Communication Hypothesis'', theTool-First Principle'', and theSemantic Interpretability Paradigm''. Future research will explore the integration of Hierarchical Quantized Variational Autoencoders (HQ-VAE) to enhance AIM's complex expressive capabilities and investigate the potential forReinforcement Learning (RL) Low-Level Pre-training''. This discovery offers new avenues for bridging symbolism and connectionism.