Can Prompt Difficulty be Online Predicted for Accelerating RL Finetuning of Reasoning Models?

作者: Yun Qu, Qi Wang, Yixiu Mao, Vincent Tao Hu, Björn Ommer, Xiangyang Ji

分类: cs.AI, cs.LG

发布日期: 2025-07-07 (更新: 2026-01-10)

🔗 代码/项目: GITHUB

💡 一句话要点

提出MoPPS,在线预测Prompt难度,加速推理模型RL微调。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 强化学习微调 Prompt选择 在线学习 贝叶斯推理 多臂老虎机

📋 核心要点

- 强化学习微调可以提升大型语言模型的推理能力,但需要大量迭代,计算成本高昂。

- MoPPS通过贝叶斯风险预测框架在线估计Prompt难度,无需频繁的LLM交互,降低计算成本。

- 实验表明,MoPPS能有效预测Prompt难度,并显著减少LLM rollout,加速训练过程。

📝 摘要(中文)

本文研究了如何迭代近似评估任意Prompt,并提出了模型预测Prompt选择(MoPPS),这是一个贝叶斯风险预测框架,可以在线估计Prompt难度,而无需昂贵的LLM交互。MoPPS将每个Prompt的成功率建模为一个潜在变量,执行流式贝叶斯推理,并在构建的多臂老虎机中采用后验抽样,从而实现样本高效和自适应的Prompt选择。在数学、规划和基于视觉的几何任务上的大量实验表明,MoPPS能够可靠地预测Prompt难度,并通过显著减少LLM rollout来加速训练。代码已开源。

🔬 方法详解

问题定义:现有方法在利用强化学习微调大型语言模型时,需要对大量Prompt进行评估和选择,这导致了频繁的LLM推理调用,计算开销巨大。现有的在线Prompt选择方法虽然减少了迭代步骤,但仍然依赖于详尽的Prompt评估和子集选择,无法避免高昂的计算成本。

核心思路:本文的核心思路是通过构建一个模型来预测Prompt的难度,从而避免对所有Prompt进行实际评估。具体来说,将每个Prompt的成功率建模为一个潜在变量,并使用贝叶斯推理来估计这个潜在变量。通过预测Prompt的难度,可以优先选择信息量大的Prompt进行训练,从而加速强化学习微调的过程。

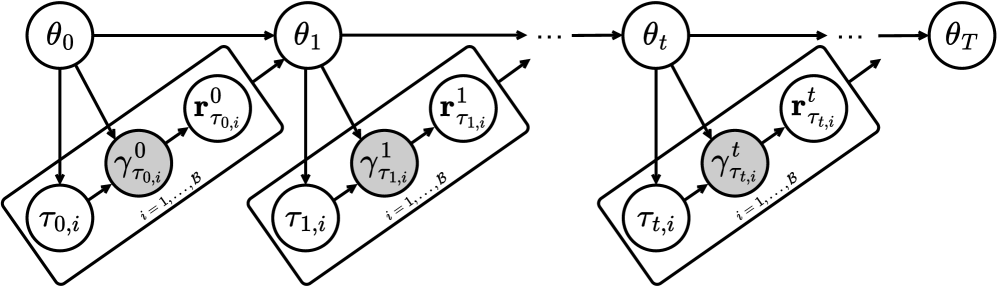

技术框架:MoPPS框架包含以下几个主要模块:1) Prompt成功率建模:将每个Prompt的成功率建模为一个潜在变量。2) 流式贝叶斯推理:使用流式贝叶斯推理来更新Prompt成功率的后验分布。3) 多臂老虎机:构建一个多臂老虎机,其中每个臂代表一个Prompt,臂的奖励基于Prompt成功率的后验分布进行采样。4) Prompt选择:使用多臂老虎机算法选择下一个要评估的Prompt。

关键创新:MoPPS的关键创新在于它能够在线预测Prompt的难度,而无需进行实际的LLM交互。这与现有的直接评估然后选择的方案不同,后者需要对所有Prompt进行评估,计算成本很高。MoPPS通过贝叶斯推理和多臂老虎机算法,实现了样本高效和自适应的Prompt选择。

关键设计:MoPPS使用Beta分布作为Prompt成功率的先验分布,并使用共轭先验的性质来简化贝叶斯推理的过程。在多臂老虎机中,MoPPS使用Thompson Sampling算法来选择Prompt。此外,MoPPS还设计了一个奖励函数,用于衡量Prompt的信息量,并将其用于多臂老虎机的奖励计算。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MoPPS在数学、规划和基于视觉的几何任务上均能可靠地预测Prompt难度,并显著减少LLM rollout。与基线方法相比,MoPPS能够在更少的LLM交互次数下达到相同的性能水平,从而加速了训练过程。具体性能数据在论文中详细展示,证明了MoPPS的有效性和优越性。

🎯 应用场景

MoPPS可应用于各种需要强化学习微调大型语言模型的场景,例如数学问题求解、规划任务和视觉几何推理。该方法可以显著降低计算成本,提高训练效率,使得在资源有限的条件下也能有效地提升LLM的推理能力。未来,MoPPS可以扩展到其他类型的任务和模型,并与其他Prompt工程技术相结合,进一步提升LLM的性能。

📄 摘要(原文)

Recent advances have witnessed the effectiveness of reinforcement learning (RL) finetuning in enhancing the reasoning capabilities of large language models (LLMs). The optimization process often requires numerous iterations to achieve satisfactory performance, resulting in high computational costs due to the need for frequent prompt evaluations under intensive LLM interactions and repeated policy updates. Appropriate online prompt selection methods reduce iteration steps by prioritizing informative prompts during training, while the pipeline's reliance on exhaustive prompt evaluation and subset selection for optimization still incurs substantial computational overhead due to frequent LLM inference calls. Distinguished from these direct evaluate-then-select schemes, this work investigates iterative approximate evaluation for arbitrary prompts and introduces Model Predictive Prompt Selection (MoPPS), a Bayesian risk-predictive framework that online estimates prompt difficulty without requiring costly LLM interactions. Technically, MoPPS models each prompt's success rate as a latent variable, performs streaming Bayesian inference, and employs posterior sampling in a constructed multi-armed bandit machine, enabling sample efficient and adaptive prompt selection. Extensive experiments across mathematics, planning, and vision-based geometry tasks show that MoPPS reliably predicts prompt difficulty and accelerates training with significantly reduced LLM rollouts. Our code is available at https://github.com/thu-rllab/MoPPS.