LLM4Hint: Leveraging Large Language Models for Hint Recommendation in Offline Query Optimization

作者: Suchen Liu, Jun Gao, Yinjun Han, Yang Lin

分类: cs.DB, cs.AI

发布日期: 2025-07-04

💡 一句话要点

LLM4Hint:利用大语言模型为离线查询优化推荐提示,提升泛化性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 查询优化 大型语言模型 提示学习 离线优化 数据库管理系统

📋 核心要点

- 现有查询优化器在处理复杂SQL查询时,面临手动调优繁琐和学习方法泛化性不足的挑战。

- LLM4Hint利用中等规模LLM,通过软提示、查询重写和显式匹配提示,为离线查询优化推荐提示。

- 实验结果表明,LLM4Hint在查询优化效果和泛化能力上均优于现有学习优化器。

📝 摘要(中文)

查询优化对于数据库管理系统(DBMS)中高效的SQL查询执行至关重要,并且随着数据量的增长和硬件的进步,查询优化一直备受关注。现有的传统优化器在处理复杂工作负载时需要繁琐的手动调整,而基于学习的方法在确保泛化性方面面临限制。鉴于大型语言模型(LLM)在各种下游任务中取得了巨大成功,本文探讨了如何将LLM纳入以增强学习优化器的泛化能力。尽管前景广阔,但这种结合仍然存在挑战,主要包括高模型推理延迟,以及由于LLM中的token序列与具有丰富数值特征的结构化SQL执行计划之间存在固有差异而导致的大量微调成本和次优性能。在本文中,我们专注于离线优化中的重复查询,以缓解高推理延迟的问题,并提出LLM4Hint,它利用中等规模的骨干LLM来推荐查询优化提示。LLM4Hint通过以下方式实现目标:(i)集成一个轻量级模型来生成软提示,该软提示捕获DBMS中的数据分布和SQL谓词,以提供足够的优化特征,同时减少输入到LLM的上下文长度,(ii)设计一种使用更大的商业LLM的查询重写策略,以便简化骨干LLM的SQL语义并降低微调成本,以及(iii)引入显式匹配提示以促进LLM和轻量级模型之间的对齐,从而可以加速组合模型的收敛。实验表明,LLM4Hint通过利用LLM更强的理解查询语句的能力,在有效性和泛化性方面均优于最先进的学习优化器。

🔬 方法详解

问题定义:论文旨在解决数据库查询优化中,现有优化器在面对复杂查询时需要大量人工调优,以及基于学习的优化器泛化能力不足的问题。传统优化器难以适应不断变化的数据分布和查询模式,而直接应用大型语言模型进行查询优化又面临推理延迟高和微调成本大的挑战。

核心思路:论文的核心思路是利用大型语言模型(LLM)强大的语义理解能力,结合轻量级模型提取查询特征,为查询优化推荐合适的提示(Hint)。通过软提示、查询重写和显式匹配提示等技术,降低LLM的推理成本和微调难度,提高优化效果和泛化能力。

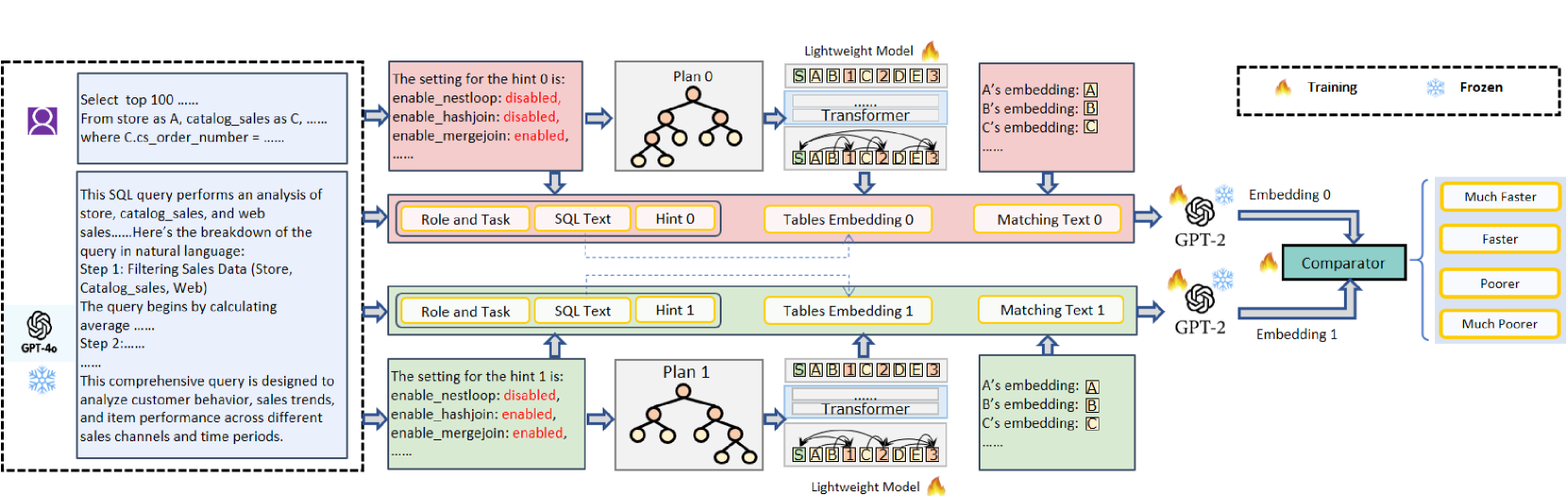

技术框架:LLM4Hint的整体框架包含以下几个主要模块:1) 轻量级模型:用于提取SQL查询中的数据分布和谓词信息,生成软提示,降低输入LLM的上下文长度。2) 查询重写模块:利用大型商业LLM对SQL查询进行语义简化,降低骨干LLM的理解难度。3) 骨干LLM:接收软提示和重写后的查询语句,推荐查询优化提示。4) 显式匹配提示:用于对齐轻量级模型和骨干LLM,加速模型收敛。

关键创新:论文的关键创新在于:1) 提出了软提示机制,有效降低了LLM的输入长度,提高了推理效率。2) 引入了查询重写策略,简化了SQL语义,降低了LLM的微调成本。3) 设计了显式匹配提示,加速了轻量级模型和LLM的对齐,提高了模型性能。

关键设计:论文的关键设计包括:1) 轻量级模型的选择和训练,需要能够有效提取查询特征,并与LLM的输入格式兼容。2) 查询重写策略的设计,需要在保证查询语义不变的前提下,尽可能简化查询语句。3) 显式匹配提示的设计,需要能够有效引导LLM学习轻量级模型提取的特征。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM4Hint在查询优化效果和泛化能力上均优于现有学习优化器。具体而言,LLM4Hint在多个benchmark数据集上取得了显著的性能提升,并且在面对新的查询和数据分布时,表现出更强的鲁棒性。这些结果验证了LLM4Hint的有效性和实用性。

🎯 应用场景

LLM4Hint可应用于各种数据库管理系统(DBMS)的查询优化场景,尤其适用于需要处理大量重复查询的离线优化任务。该方法可以显著减少人工调优的工作量,提高查询执行效率,降低数据库运维成本。未来,该技术有望扩展到在线查询优化,实现更智能、更高效的数据库管理。

📄 摘要(原文)

Query optimization is essential for efficient SQL query execution in DBMS, and remains attractive over time due to the growth of data volumes and advances in hardware. Existing traditional optimizers struggle with the cumbersome hand-tuning required for complex workloads, and the learning-based methods face limitations in ensuring generalization. With the great success of Large Language Model (LLM) across diverse downstream tasks, this paper explores how LLMs can be incorporated to enhance the generalization of learned optimizers. Though promising, such an incorporation still presents challenges, mainly including high model inference latency, and the substantial fine-tuning cost and suboptimal performance due to inherent discrepancy between the token sequences in LLM and structured SQL execution plans with rich numerical features. In this paper, we focus on recurring queries in offline optimization to alleviate the issue of high inference latency, and propose \textbf{LLM4Hint} that leverages moderate-sized backbone LLMs to recommend query optimization hints. LLM4Hint achieves the goals through: (i) integrating a lightweight model to produce a soft prompt, which captures the data distribution in DBMS and the SQL predicates to provide sufficient optimization features while simultaneously reducing the context length fed to the LLM, (ii) devising a query rewriting strategy using a larger commercial LLM, so as to simplify SQL semantics for the backbone LLM and reduce fine-tuning costs, and (iii) introducing an explicit matching prompt to facilitate alignment between the LLM and the lightweight model, which can accelerate convergence of the combined model. Experiments show that LLM4Hint, by leveraging the LLM's stronger capability to understand the query statement, can outperform the state-of-the-art learned optimizers in terms of both effectiveness and generalization.