SPEAR: Structured Pruning for Spiking Neural Networks via Synaptic Operation Estimation and Reinforcement Learning

作者: Hui Xie, Yuhe Liu, Shaoqi Yang, Jinyang Guo, Yufei Guo, Yuqing Ma, Jiaxin Chen, Jiaheng Liu, Xianglong Liu

分类: cs.NE, cs.AI, cs.LG

发布日期: 2025-06-28

💡 一句话要点

提出SPEAR框架,通过强化学习和突触操作估计实现脉冲神经网络的结构化剪枝。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 脉冲神经网络 结构化剪枝 强化学习 突触操作 神经形态计算

📋 核心要点

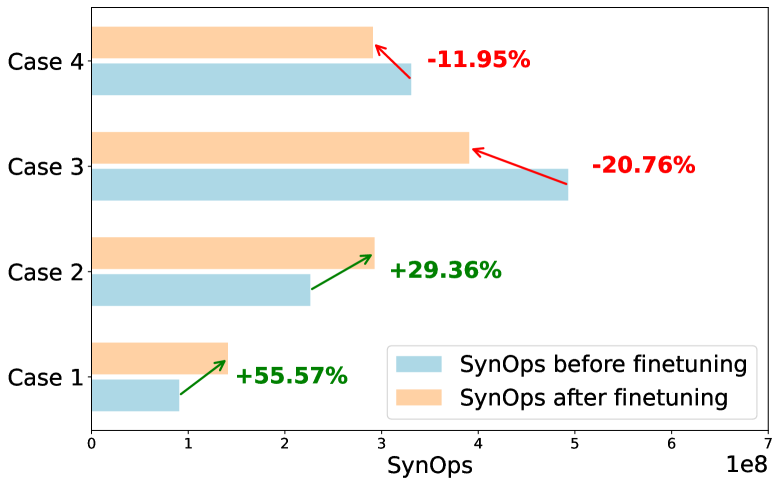

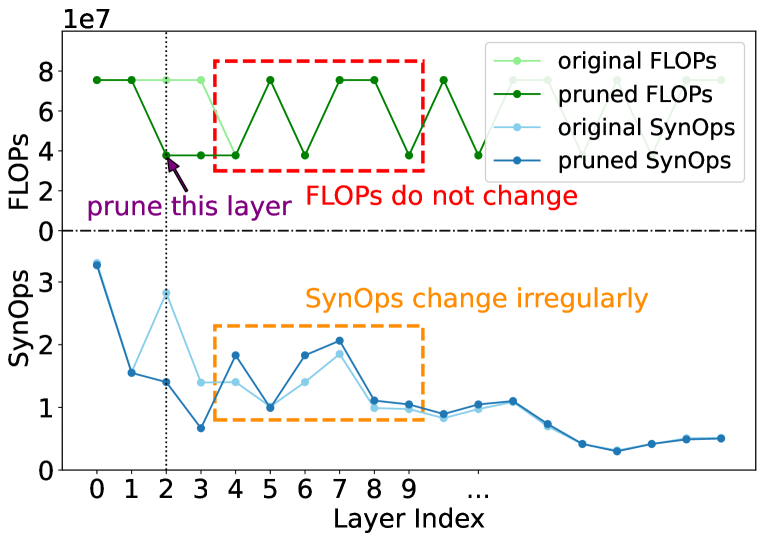

- 现有基于搜索的SNN剪枝方法难以直接将动态变化的突触操作数(SynOps)作为约束,导致剪枝后的网络不满足SynOps目标。

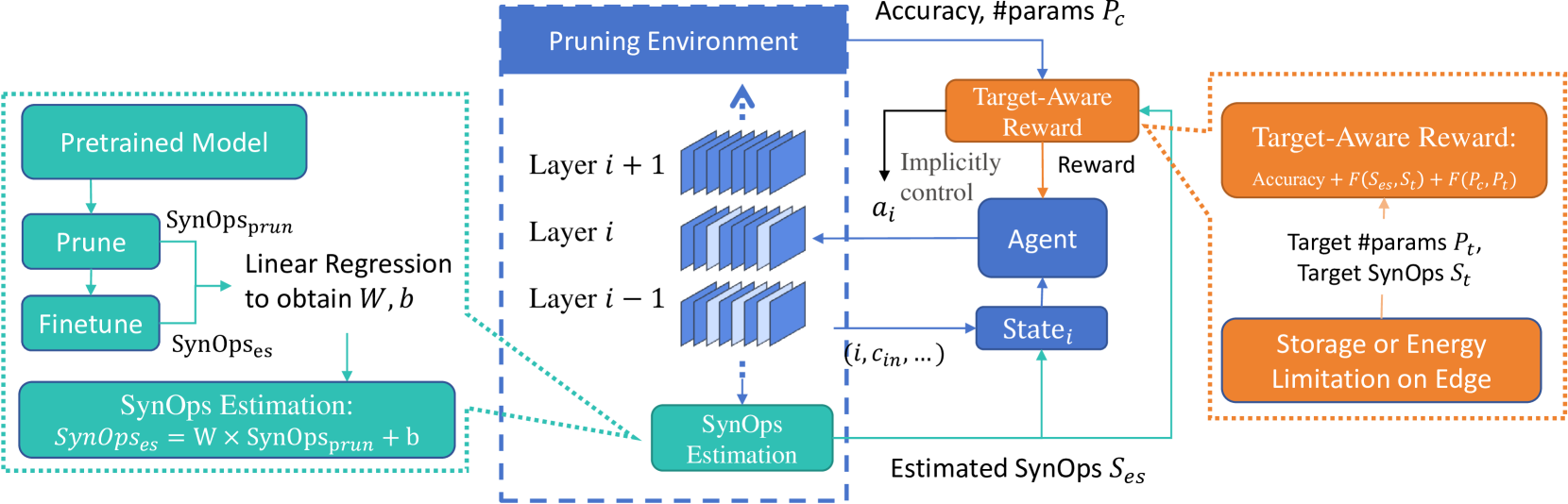

- SPEAR框架利用强化学习,并结合SynOps预测机制LRE和新型奖励TAR,实现了在特定SynOps约束下对SNN的有效剪枝。

- 实验结果表明,SPEAR框架能够在特定SynOps约束下有效地压缩SNN,验证了其在SNN结构化剪枝方面的有效性。

📝 摘要(中文)

深度脉冲神经网络(SNNs)虽然表现出卓越的性能,但其在资源受限的神经形态硬件上的部署仍然具有挑战性。网络剪枝通过减少参数和突触操作(SynOps)为SNNs的边缘部署提供了一个可行的解决方案,其中基于搜索的剪枝方法在剪枝后搜索SNNs的结构。然而,现有的基于搜索的方法未能直接使用SynOps作为约束,因为它在搜索过程中会动态变化,导致最终搜索到的网络违反预期的SynOps目标。在本文中,我们介绍了一种名为SPEAR的新型SNN剪枝框架,该框架利用强化学习(RL)技术直接使用SynOps作为搜索约束。为了避免违反SynOps要求,我们首先提出了一种名为LRE的SynOps预测机制,以准确预测搜索后的最终SynOps。观察到SynOps无法显式计算并添加到RL中以约束动作,我们提出了一种名为TAR的新型奖励来稳定搜索。大量的实验表明,我们的SPEAR框架可以有效地压缩特定SynOps约束下的SNN。

🔬 方法详解

问题定义:现有基于搜索的SNN剪枝方法无法直接将SynOps作为约束,因为SynOps在搜索过程中动态变化,导致最终剪枝后的网络违反SynOps目标。这限制了SNN在资源受限设备上的部署。

核心思路:SPEAR的核心思路是利用强化学习(RL)直接将SynOps作为搜索约束。为了解决SynOps动态变化的问题,SPEAR引入了SynOps预测机制LRE,用于预测剪枝后的SynOps。同时,设计了一种新型奖励函数TAR,以稳定RL的搜索过程。

技术框架:SPEAR框架主要包含以下几个模块:1) SynOps预测模块(LRE):用于预测剪枝后的SynOps,为RL提供指导。2) 强化学习模块:使用RL算法搜索最优的SNN结构,以满足SynOps约束。3) 奖励函数(TAR):设计新型奖励函数,稳定RL的训练过程。整体流程是,首先使用LRE预测SynOps,然后RL根据预测的SynOps和奖励函数进行搜索,最终得到满足SynOps约束的剪枝后的SNN。

关键创新:SPEAR的关键创新在于:1) 提出了一种SynOps预测机制LRE,能够准确预测剪枝后的SynOps。2) 设计了一种新型奖励函数TAR,能够稳定RL的搜索过程。3) 将强化学习应用于SNN的结构化剪枝,并直接将SynOps作为约束。

关键设计:LRE的具体实现细节未知,但其目标是准确预测剪枝后的SynOps。TAR奖励函数的设计需要考虑SynOps约束和网络性能,具体形式未知。RL算法的选择也需要根据具体情况进行调整。网络结构的选择和剪枝策略的设计也会影响最终的剪枝效果。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了SPEAR框架在SNN剪枝方面的有效性。具体性能数据和对比基线未知,但论文强调SPEAR能够在特定SynOps约束下有效地压缩SNN。实验结果表明,SPEAR能够找到满足SynOps约束且性能良好的SNN结构,验证了LRE和TAR的有效性。

🎯 应用场景

SPEAR框架可应用于资源受限的神经形态硬件平台,例如移动设备、嵌入式系统和物联网设备。通过对SNN进行高效压缩,SPEAR能够降低SNN的计算复杂度和功耗,使其更易于部署在边缘设备上,从而实现低功耗、高性能的边缘智能应用,例如智能传感器、机器人控制和实时图像处理。

📄 摘要(原文)

While deep spiking neural networks (SNNs) demonstrate superior performance, their deployment on resource-constrained neuromorphic hardware still remains challenging. Network pruning offers a viable solution by reducing both parameters and synaptic operations (SynOps) to facilitate the edge deployment of SNNs, among which search-based pruning methods search for the SNNs structure after pruning. However, existing search-based methods fail to directly use SynOps as the constraint because it will dynamically change in the searching process, resulting in the final searched network violating the expected SynOps target. In this paper, we introduce a novel SNN pruning framework called SPEAR, which leverages reinforcement learning (RL) technique to directly use SynOps as the searching constraint. To avoid the violation of SynOps requirements, we first propose a SynOps prediction mechanism called LRE to accurately predict the final SynOps after search. Observing SynOps cannot be explicitly calculated and added to constrain the action in RL, we propose a novel reward called TAR to stabilize the searching. Extensive experiments show that our SPEAR framework can effectively compress SNN under specific SynOps constraint.