Meta-Adaptive Prompt Distillation for Few-Shot Visual Question Answering

作者: Akash Gupta, Amos Storkey, Mirella Lapata

分类: cs.AI, cs.CL, cs.CV, cs.LG

发布日期: 2025-06-07 (更新: 2025-06-10)

💡 一句话要点

提出元自适应Prompt蒸馏方法,提升小模型在Few-Shot VQA任务上的性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉问答 Few-Shot学习 元学习 Prompt蒸馏 多模态学习

📋 核心要点

- 现有ICL方法在小规模LMMs上表现不稳定,且性能提升不随示例数量单调增长,原因是模型易被图像嵌入中的冗余信息干扰。

- 提出元自适应Prompt蒸馏方法,从任务相关的图像特征中提炼软提示,并在测试时通过少量样本进行调整,提升模型泛化能力。

- 实验表明,该方法在VL-ICL Bench上优于ICL及相关Prompt调优方法,即使在图像扰动下,也能提升视觉问答任务的性能。

📝 摘要(中文)

大型多模态模型(LMMs)通常依赖于上下文学习(ICL)以在最少监督下执行新任务。然而,ICL的性能,尤其是在较小的LMMs中,是不稳定的,并且并不总是随着示例数量的增加而单调提高。我们假设这是由于LMM被图像嵌入中存在的额外信息所淹没,而这些信息对于下游任务来说是不需要的。为了解决这个问题,我们提出了一种元学习方法,该方法提供了一种替代方案,用于在LMMs中诱导Few-Shot能力,使用一组固定的软提示,这些软提示是从任务相关的图像特征中提炼出来的,并且可以在测试时使用一些示例进行调整。为了促进这种蒸馏,我们引入了一个注意力映射模块,该模块可以很容易地与流行的LLaVA v1.5架构集成,并与软提示联合学习,从而在低数据情况下仅需几个梯度步骤即可在LMMs中实现任务适应。在VL-ICL Bench上的评估表明,我们的方法始终优于ICL和相关的Prompt调优方法,即使在图像扰动下,也能改善跨视觉问答任务的任务归纳和推理。

🔬 方法详解

问题定义:论文旨在解决大型多模态模型在Few-Shot视觉问答任务中,由于上下文学习(ICL)性能不稳定,且易受图像嵌入中无关信息干扰的问题。现有方法,特别是直接使用ICL或简单的Prompt调优,在小规模模型上表现不佳,无法有效利用少量样本进行任务适应。

核心思路:论文的核心思路是通过元学习的方式,预先学习一组对任务敏感的软提示(soft prompts),这些软提示是从图像特征中蒸馏而来,并在测试时利用少量样本进行自适应调整。这种方法旨在减少模型对图像中无关信息的依赖,并提高在低数据情况下的泛化能力。

技术框架:整体框架包含预训练阶段和适应阶段。在预训练阶段,使用一个注意力映射模块(attention-mapper module)与LLaVA v1.5架构集成,联合学习软提示和注意力映射。注意力映射模块负责从图像特征中提取任务相关的信息,用于生成软提示。在适应阶段,使用少量样本对软提示进行微调,以适应特定的视觉问答任务。

关键创新:该方法的关键创新在于引入了元自适应Prompt蒸馏,通过预训练阶段学习任务相关的软提示,并在适应阶段进行微调,从而实现了在低数据情况下的高效任务适应。与传统的ICL方法相比,该方法减少了对大量示例的依赖,并提高了模型的泛化能力。与简单的Prompt调优方法相比,该方法通过注意力机制更好地提取了图像中的任务相关信息。

关键设计:注意力映射模块的具体结构未知,但其作用是从图像特征中提取任务相关的信息。软提示是一组可学习的参数,用于引导模型的注意力。损失函数的设计目标是使软提示能够有效地提取任务相关的信息,并在适应阶段能够快速地适应新的任务。具体的参数设置和损失函数细节在论文中可能有所描述,但此处未知。

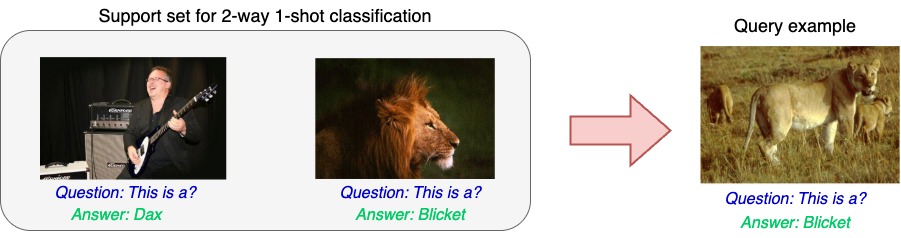

🖼️ 关键图片

📊 实验亮点

该方法在VL-ICL Bench上取得了显著的性能提升,优于ICL和相关的Prompt调优方法。即使在图像受到扰动的情况下,该方法仍然能够保持较高的性能,表明其具有较强的鲁棒性。具体的性能数据和提升幅度在论文中应该有详细的描述,但此处未知。

🎯 应用场景

该研究成果可应用于各种需要快速适应新任务的视觉问答场景,例如智能客服、机器人助手、图像检索等。通过少量样本即可使模型适应新的视觉问答任务,降低了模型部署和维护的成本,并提高了模型的灵活性和实用性。未来可进一步扩展到其他多模态任务,如视觉对话、图像描述等。

📄 摘要(原文)

Large Multimodal Models (LMMs) often rely on in-context learning (ICL) to perform new tasks with minimal supervision. However, ICL performance, especially in smaller LMMs, is inconsistent and does not always improve monotonically with increasing examples. We hypothesize that this occurs due to the LMM being overwhelmed by additional information present in the image embeddings, which is not required for the downstream task. To address this, we propose a meta-learning approach that provides an alternative for inducing few-shot capabilities in LMMs, using a fixed set of soft prompts that are distilled from task-relevant image features and can be adapted at test time using a few examples. To facilitate this distillation, we introduce an attention-mapper module that can be easily integrated with the popular LLaVA v1.5 architecture and is jointly learned with soft prompts, enabling task adaptation in LMMs under low-data regimes with just a few gradient steps. Evaluation on the VL-ICL Bench shows that our method consistently outperforms ICL and related prompt-tuning approaches, even under image perturbations, improving task induction and reasoning across visual question answering tasks.