United Minds or Isolated Agents? Exploring Coordination of LLMs under Cognitive Load Theory

作者: HaoYang Shang, Xuan Liu, Zi Liang, Jie Zhang, Haibo Hu, Song Guo

分类: cs.AI

发布日期: 2025-06-07 (更新: 2025-09-25)

💡 一句话要点

提出CoThinker框架,利用认知负荷理论提升LLM在复杂任务中的协同能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 认知负荷理论 多智能体系统 协同问题解决 认知计算

📋 核心要点

- 现有LLM在复杂任务中难以整合信息和满足多重约束,存在认知负荷过高的问题。

- CoThinker框架通过智能体分工和结构化通信,模拟认知负荷理论,降低单个LLM的认知负担。

- 实验表明,CoThinker在复杂问题解决和高认知负荷场景下,优于现有方法,提升了解题质量和效率。

📝 摘要(中文)

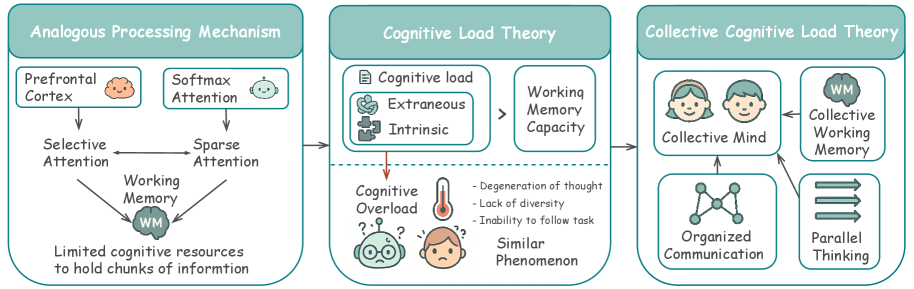

大型语言模型(LLM)在复杂、多方面的任务中表现出明显的性能瓶颈,它们常常无法整合不同的信息或遵守多个约束。我们认为,这种限制源于任务的需求超过了LLM的有效认知负荷能力。这种解释与认知科学中的认知负荷理论(CLT)有很强的相似性,该理论解释了人类思维中类似的性能边界,并且新兴证据表明LLM具有有限的工作记忆特征,进一步支持了这一观点。基于这种基于CLT的理解,我们引入了CoThinker,这是一个新颖的基于LLM的多智能体框架,旨在减轻认知超载并增强协作解决问题的能力。CoThinker通过智能体专业化来分配内在认知负荷,并通过结构化通信和集体工作记忆来管理事务性负荷,从而实现CLT原则。我们在复杂的解决问题任务和人为制造的高认知负荷场景中对CoThinker进行了实证验证,证明了其在解决方案质量和效率方面优于现有的多智能体基线。我们的分析揭示了特征性的交互模式,从而深入了解了集体认知的出现和有效的负荷管理,从而为克服LLM性能瓶颈提供了一种有原则的方法。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在处理复杂、多方面任务时表现出的性能瓶颈问题。现有的LLM方法在整合多样信息和满足多重约束方面存在困难,这主要是因为单个LLM的认知负荷超过了其处理能力。这种认知负荷过高导致LLM难以有效地执行复杂任务。

核心思路:论文的核心思路是借鉴认知科学中的认知负荷理论(CLT),将复杂任务分解为多个子任务,并分配给不同的LLM智能体。通过智能体之间的专业化分工和结构化通信,降低每个智能体的认知负荷,从而提高整体的解决问题能力。这种方法模拟了人类团队协作解决问题的模式,其中每个成员专注于特定的任务,并通过有效的沟通协调来实现共同目标。

技术框架:CoThinker框架包含以下主要模块:1) 任务分解模块:将复杂任务分解为多个子任务。2) 智能体分配模块:将子任务分配给不同的LLM智能体,每个智能体负责特定的任务。3) 智能体执行模块:每个智能体独立执行其分配的子任务。4) 通信协调模块:智能体之间通过结构化的通信协议进行信息交换和协调。5) 集成模块:将各个智能体的结果进行整合,得到最终的解决方案。框架使用一个集体工作记忆来存储和共享信息,从而促进智能体之间的协作。

关键创新:CoThinker的关键创新在于将认知负荷理论应用于LLM的多智能体协作框架设计。通过模拟人类认知过程中的负荷管理机制,有效地降低了单个LLM的认知负担,从而提高了整体的解决问题能力。与传统的LLM方法相比,CoThinker能够更好地处理复杂、多方面的任务,并能够更好地整合不同的信息和满足多个约束。

关键设计:CoThinker的关键设计包括:1) 智能体专业化:根据任务的特点,为每个智能体分配特定的角色和职责。2) 结构化通信协议:定义了智能体之间进行信息交换和协调的规则和格式。3) 集体工作记忆:用于存储和共享智能体之间的信息,促进协作。4) 动态负荷平衡:根据智能体的表现,动态调整任务的分配,以实现最佳的负荷平衡。具体的参数设置和网络结构取决于所使用的LLM模型和任务的特点,论文中可能未详细说明。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CoThinker在复杂问题解决任务和人为制造的高认知负荷场景中,显著优于现有的多智能体基线方法。具体而言,CoThinker在解决方案的质量和效率方面均有提升,并且能够更好地处理多重约束条件。论文分析了智能体之间的交互模式,揭示了集体认知的出现和有效负荷管理的关键因素。具体的性能提升数据未知,需要在论文中查找。

🎯 应用场景

该研究成果可应用于需要复杂推理和多方面信息整合的领域,如智能客服、金融分析、医疗诊断、法律咨询等。通过降低LLM的认知负荷,可以提升其在这些领域的应用效果,实现更高效、更准确的决策支持。未来,该研究有望推动LLM在更广泛领域的应用,并促进人机协作的进一步发展。

📄 摘要(原文)

Large Language Models (LLMs) exhibit a notable performance ceiling on complex, multi-faceted tasks, as they often fail to integrate diverse information or adhere to multiple constraints. We posit that such limitation arises when the demands of a task exceed the LLM's effective cognitive load capacity. This interpretation draws a strong analogy to Cognitive Load Theory (CLT) in cognitive science, which explains similar performance boundaries in the human mind, and is further supported by emerging evidence that reveals LLMs have bounded working memory characteristics. Building upon this CLT-grounded understanding, we introduce CoThinker, a novel LLM-based multi-agent framework designed to mitigate cognitive overload and enhance collaborative problem-solving abilities. CoThinker operationalizes CLT principles by distributing intrinsic cognitive load through agent specialization and managing transactional load via structured communication and a collective working memory. We empirically validate CoThinker on complex problem-solving tasks and fabricated high cognitive load scenarios, demonstrating improvements over existing multi-agent baselines in solution quality and efficiency. Our analysis reveals characteristic interaction patterns, providing insights into the emergence of collective cognition and effective load management, thus offering a principled approach to overcoming LLM performance ceilings.