SafeGenes: Evaluating the Adversarial Robustness of Genomic Foundation Models

作者: Huixin Zhan, Clovis Barbour, Jason H. Moore

分类: cs.CR, cs.AI

发布日期: 2025-06-01 (更新: 2025-12-02)

💡 一句话要点

SafeGenes框架:评估基因组基础模型对抗对抗攻击的鲁棒性

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 基因组基础模型 对抗攻击 对抗鲁棒性 变异效应预测 快速梯度符号法

📋 核心要点

- 基因组基础模型在变异效应预测中表现出色,但其对抗攻击的鲁棒性有待研究。

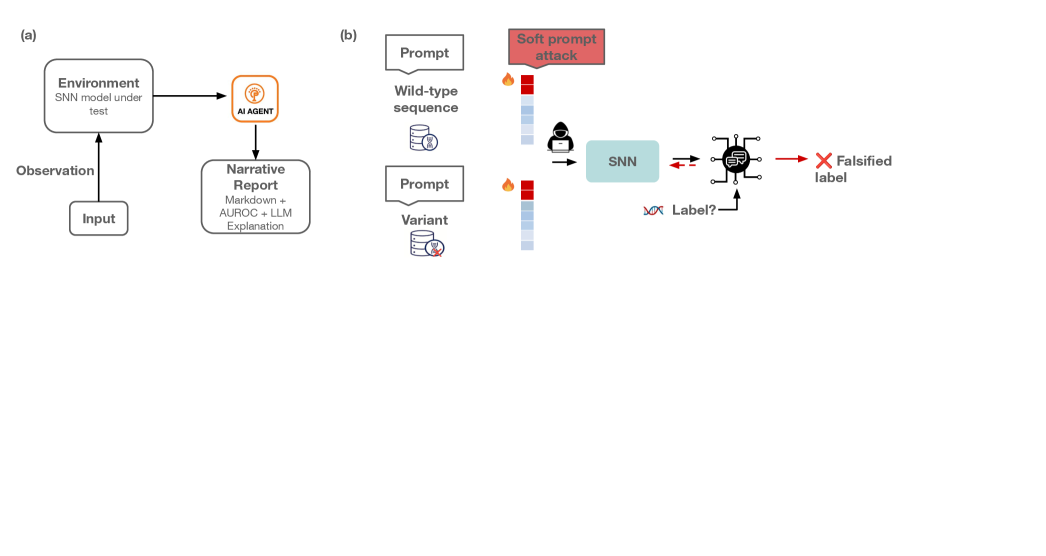

- SafeGenes框架通过对抗攻击评估基因组基础模型,包括序列扰动和嵌入空间操纵。

- 实验表明,软提示攻击能有效降低模型性能,揭示了现有模型在对抗环境下的脆弱性。

📝 摘要(中文)

基因组基础模型(GFMs),如进化尺度建模(ESM),在变异效应预测方面表现出显著的成功。然而,它们的对抗鲁棒性在很大程度上仍未被探索。为了解决这个差距,我们提出了SafeGenes:一个用于基因组基础模型安全分析的框架,利用对抗攻击来评估模型对工程化的近乎相同的对抗基因和嵌入空间操纵的鲁棒性。在这项研究中,我们使用两种方法评估GFMs的对抗脆弱性:快速梯度符号法(FGSM)和软提示攻击。FGSM对输入序列引入最小的扰动,而软提示攻击优化连续嵌入以操纵模型预测,而不修改输入token。通过结合这些技术,SafeGenes提供了对GFM易受对抗操纵影响的全面评估。有针对性的软提示攻击导致基于MLM的浅层架构(如ProteinBERT)的严重退化,同时即使在高容量基础模型(如ESM1b和ESM1v)中也产生了大量的失效模式。这些发现揭示了当前基础模型中的关键漏洞,为改进其在变异效应预测等高风险基因组应用中的安全性和鲁棒性开辟了新的研究方向。

🔬 方法详解

问题定义:基因组基础模型在变异效应预测等任务中取得了显著进展,但现有研究缺乏对其对抗鲁棒性的系统评估。模型容易受到微小扰动的影响,导致预测结果出现偏差,这在高风险应用中是不可接受的。现有方法难以有效评估模型在面对恶意设计的对抗样本时的安全性。

核心思路:SafeGenes框架的核心思路是通过设计不同的对抗攻击方法,系统性地评估基因组基础模型在面对恶意输入时的鲁棒性。通过模拟真实场景中可能出现的攻击,揭示模型的潜在漏洞,并为后续的防御策略提供指导。该框架旨在全面评估模型在序列空间和嵌入空间中的脆弱性。

技术框架:SafeGenes框架包含两个主要的攻击模块:一是基于快速梯度符号法(FGSM)的序列扰动攻击,通过对输入序列添加微小扰动来欺骗模型;二是软提示攻击,通过优化连续嵌入空间中的向量来操纵模型预测,而无需修改原始输入序列。该框架首先对目标模型进行预测,然后使用FGSM或软提示攻击生成对抗样本,最后将对抗样本输入模型,观察预测结果的变化,从而评估模型的鲁棒性。

关键创新:SafeGenes的关键创新在于结合了序列扰动和嵌入空间操纵两种攻击方式,从而更全面地评估基因组基础模型的对抗鲁棒性。软提示攻击是一种新型的攻击方法,它不直接修改输入序列,而是通过优化嵌入向量来影响模型的预测结果,这使得攻击更加隐蔽和有效。此外,SafeGenes框架提供了一个通用的评估平台,可以方便地应用于不同的基因组基础模型。

关键设计:在FGSM攻击中,扰动的大小由一个超参数控制,需要根据模型的敏感度进行调整。在软提示攻击中,需要设计合适的损失函数来指导嵌入向量的优化过程,例如可以使用交叉熵损失函数来最大化对抗样本的预测误差。此外,还需要选择合适的优化算法,例如Adam,来更新嵌入向量。对于不同的基因组基础模型,可能需要调整攻击参数以达到最佳攻击效果。

🖼️ 关键图片

📊 实验亮点

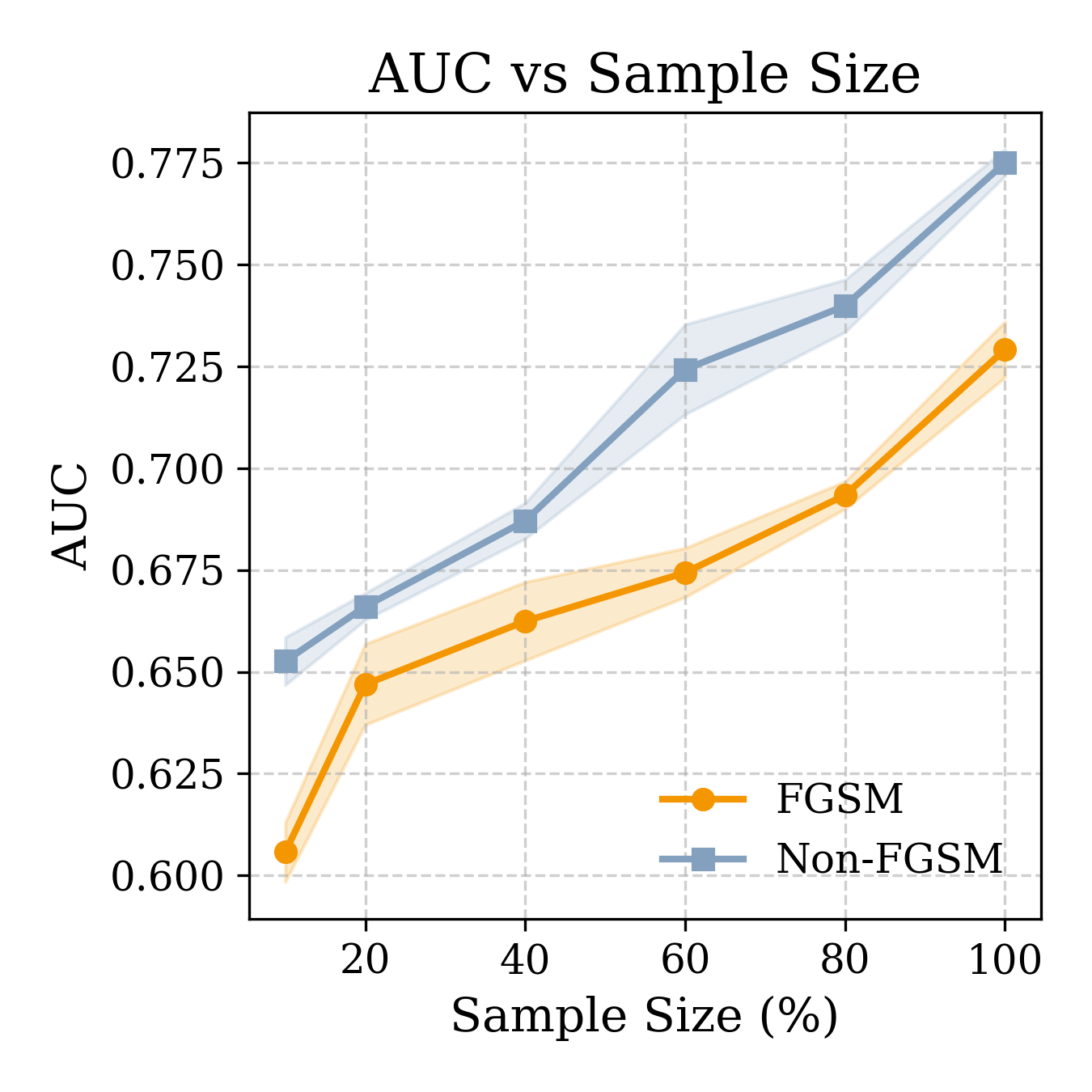

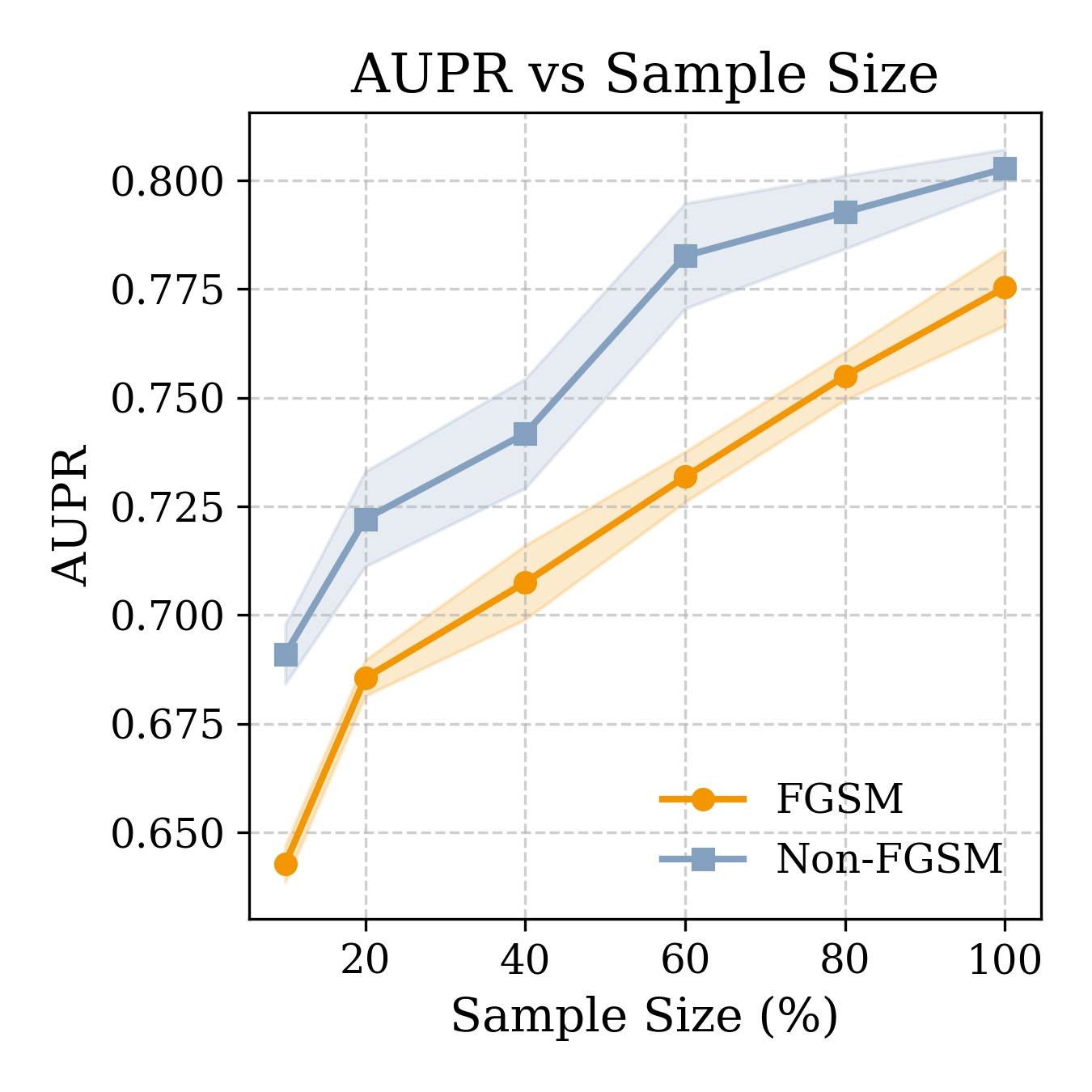

实验结果表明,SafeGenes框架能够有效地评估基因组基础模型的对抗鲁棒性。针对ProteinBERT的软提示攻击导致模型性能显著下降,而即使是高容量模型如ESM1b和ESM1v也存在明显的失效模式。这些结果表明,现有的基因组基础模型在面对对抗攻击时存在严重的脆弱性,需要进一步的研究来提高其鲁棒性。

🎯 应用场景

SafeGenes的研究成果可应用于基因组数据安全、药物研发和精准医疗等领域。通过评估和提升基因组基础模型的鲁棒性,可以减少模型在实际应用中因对抗攻击而产生的错误预测,提高基因组分析的可靠性,从而保障患者安全,加速药物研发进程,并促进精准医疗的发展。该研究为开发更安全可靠的基因组分析工具奠定了基础。

📄 摘要(原文)

Genomic Foundation Models (GFMs), such as Evolutionary Scale Modeling (ESM), have demonstrated significant success in variant effect prediction. However, their adversarial robustness remains largely unexplored. To address this gap, we propose SafeGenes: a framework for Secure analysis of genomic foundation models, leveraging adversarial attacks to evaluate robustness against both engineered near-identical adversarial Genes and embedding-space manipulations. In this study, we assess the adversarial vulnerabilities of GFMs using two approaches: the Fast Gradient Sign Method (FGSM) and a soft prompt attack. FGSM introduces minimal perturbations to input sequences, while the soft prompt attack optimizes continuous embeddings to manipulate model predictions without modifying the input tokens. By combining these techniques, SafeGenes provides a comprehensive assessment of GFM susceptibility to adversarial manipulation. Targeted soft prompt attacks induced severe degradation in MLM-based shallow architectures such as ProteinBERT, while still producing substantial failure modes even in high-capacity foundation models such as ESM1b and ESM1v. These findings expose critical vulnerabilities in current foundation models, opening new research directions toward improving their security and robustness in high-stakes genomic applications such as variant effect prediction.