GeoChain: Multimodal Chain-of-Thought for Geographic Reasoning

作者: Sahiti Yerramilli, Nilay Pande, Rynaa Grover, Jayant Sravan Tamarapalli

分类: cs.AI, cs.CV, cs.LG

发布日期: 2025-06-01 (更新: 2025-09-09)

💡 一句话要点

GeoChain:用于地理推理的多模态思维链基准

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 地理推理 多模态学习 思维链 大型语言模型 街景图像 基准测试 视觉定位

📋 核心要点

- 现有MLLM在地理推理方面存在不足,尤其是在视觉信息理解和复杂推理链的构建上。

- GeoChain通过构建大规模多模态数据集,提供逐步推理的思维链,引导模型进行地理定位。

- 实验表明,现有MLLM在GeoChain基准上表现出视觉基础薄弱、推理不稳定和定位精度不足等问题。

📝 摘要(中文)

本文提出了GeoChain,一个大规模基准,用于评估多模态大型语言模型(MLLM)中逐步地理推理能力。GeoChain利用146万张Mapillary街景图像,将每张图像与一个21步的思维链(CoT)问题序列(超过3000万个问答对)配对。这些序列指导模型从粗略属性到精细定位,涵盖视觉、空间、文化和精确地理定位四个推理类别,并标注了难度。图像还通过语义分割(150个类别)和视觉可定位性得分进行丰富。对现有MLLM(GPT-4.1变体、Claude 3.7、Gemini 2.5变体)在包含2088张图像的多样化子集上进行基准测试表明,模型在视觉基础、推理连贯性和精确定位方面面临持续挑战,尤其是在推理复杂度增加时。GeoChain提供了一种强大的诊断方法,对于促进MLLM中复杂地理推理的重大进步至关重要。

🔬 方法详解

问题定义:现有方法在地理推理任务中,尤其是在处理视觉信息和进行多步骤推理时,存在准确性和可靠性问题。痛点在于模型难以将视觉信息与地理知识有效结合,并且在复杂推理链中容易出现错误累积。

核心思路:GeoChain的核心思路是通过构建一个包含大量街景图像和对应思维链问答序列的数据集,来训练和评估MLLM的地理推理能力。这种逐步推理的方式能够引导模型从粗略到精细地进行定位,并暴露模型在不同推理阶段的弱点。

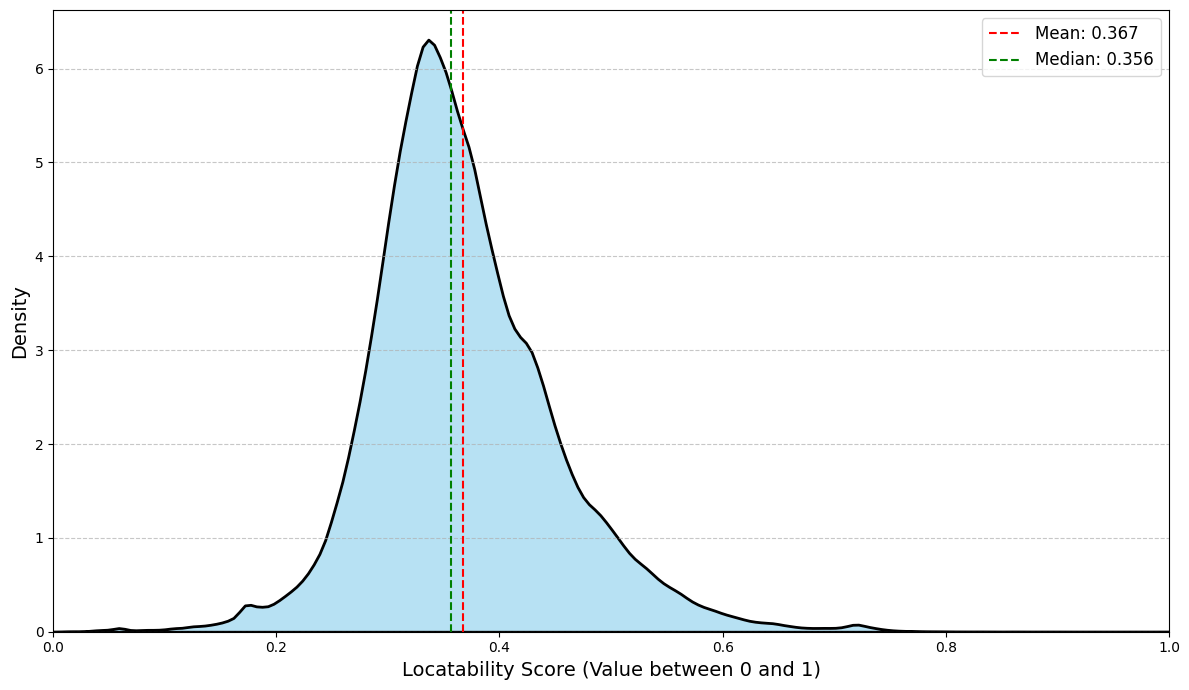

技术框架:GeoChain数据集构建流程包括:1)收集Mapillary街景图像;2)为每张图像生成一个21步的思维链问答序列,涵盖视觉、空间、文化和精确地理定位四个推理类别;3)对图像进行语义分割,并计算视觉可定位性得分;4)构建包含2088张图像的测试集,用于评估MLLM的性能。

关键创新:GeoChain的关键创新在于其大规模、多模态和逐步推理的特性。与以往的地理推理数据集相比,GeoChain提供了更丰富的视觉信息和更详细的推理步骤,能够更全面地评估MLLM的地理推理能力。此外,难度分级标注也使得可以针对不同难度的推理任务评估模型性能。

关键设计:GeoChain的思维链问答序列设计是关键。每个序列包含21个问题,逐步引导模型从图像的粗略属性(例如,是否存在特定类型的建筑物)到精细的地理位置(例如,经纬度坐标)。问题的设计涵盖了视觉、空间、文化等多个方面,以考察模型的多模态推理能力。语义分割使用150个类别,提供更细粒度的视觉信息。

🖼️ 关键图片

📊 实验亮点

在GeoChain基准测试中,GPT-4.1变体、Claude 3.7和Gemini 2.5变体等先进MLLM在视觉基础、推理连贯性和精确定位方面均表现出不足。尤其是在推理复杂度增加时,模型的性能显著下降。这些结果表明,现有MLLM在复杂地理推理方面仍有很大的提升空间,GeoChain为未来的研究提供了重要的诊断工具。

🎯 应用场景

GeoChain的研究成果可应用于自动驾驶、机器人导航、城市规划、地理信息系统等领域。通过提高MLLM的地理推理能力,可以实现更精确的定位、更智能的导航和更全面的地理信息分析。未来,该研究还可扩展到其他领域,例如,灾害救援和环境监测。

📄 摘要(原文)

This paper introduces GeoChain, a large-scale benchmark for evaluating step-by-step geographic reasoning in multimodal large language models (MLLMs). Leveraging 1.46 million Mapillary street-level images, GeoChain pairs each image with a 21-step chain-of-thought (CoT) question sequence (over 30 million Q&A pairs). These sequences guide models from coarse attributes to fine-grained localization across four reasoning categories - visual, spatial, cultural, and precise geolocation - annotated by difficulty. Images are also enriched with semantic segmentation (150 classes) and a visual locatability score. Our benchmarking of contemporary MLLMs (GPT-4.1 variants, Claude 3.7, Gemini 2.5 variants) on a diverse 2,088-image subset reveals consistent challenges: models frequently exhibit weaknesses in visual grounding, display erratic reasoning, and struggle to achieve accurate localization, especially as the reasoning complexity escalates. GeoChain offers a robust diagnostic methodology, critical for fostering significant advancements in complex geographic reasoning within MLLMs.