A "Wenlu" Brain System for Multimodal Cognition and Embodied Decision-Making: A Secure New Architecture for Deep Integration of Foundation Models and Domain Knowledge

作者: Liang Geng

分类: cs.AI

发布日期: 2025-05-31

💡 一句话要点

提出“文lu”多模态认知与具身决策系统,安全融合知识与模型,赋能行业应用。

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态认知 具身决策 知识融合 隐私安全 闭环控制 代码生成 脑启发 行业应用

📋 核心要点

- 现有方法难以有效整合大型语言模型的理解能力与特定领域的知识库,限制了其在复杂现实场景中的应用。

- “文lu”系统通过大脑启发的记忆机制,安全融合私有知识和公共模型,实现多模态数据统一处理和闭环决策。

- “文lu”在多模态处理、隐私安全和端到端硬件控制代码生成等方面优于现有方案,并具备自学习和可持续更新能力。

📝 摘要(中文)

本文提出了一种名为“文lu”的多模态认知与具身决策脑系统,旨在实现私有知识和公共模型的安全融合,统一处理图像和语音等多模态数据,并实现从认知到硬件级代码自动生成的闭环决策。该系统引入了受大脑启发的记忆标记和重放机制,无缝集成了用户私有数据、行业特定知识和通用语言模型。它为企业决策支持、医疗分析、自动驾驶、机器人控制等领域提供精确高效的多模态服务。与现有解决方案相比,“文lu”在多模态处理、隐私安全、端到端硬件控制代码生成、自学习和可持续更新方面表现出显著优势,为构建下一代智能核心奠定了坚实的基础。

🔬 方法详解

问题定义:现有方法在将大型语言模型的通用知识应用于特定领域时,面临着知识融合不安全、多模态数据处理能力不足、以及难以实现从认知到执行的闭环控制等问题。尤其是在需要保护用户隐私的场景下,如何安全地利用私有数据和行业知识成为一个关键挑战。

核心思路:论文的核心思路是构建一个受大脑启发的认知系统,通过记忆标记和重放机制,将用户私有数据、行业知识和通用语言模型进行无缝集成。这种设计允许系统在利用通用知识的同时,保护用户隐私,并能够根据特定任务的需求,灵活地调用和组合不同的知识源。

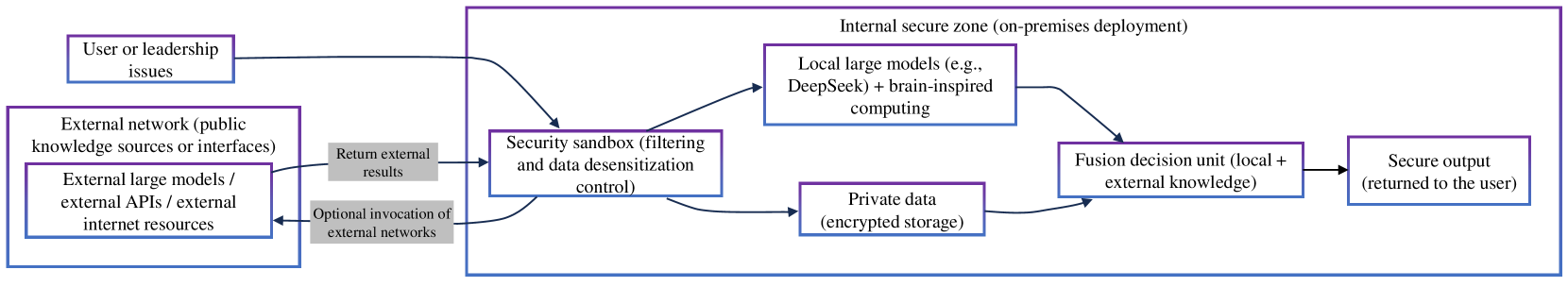

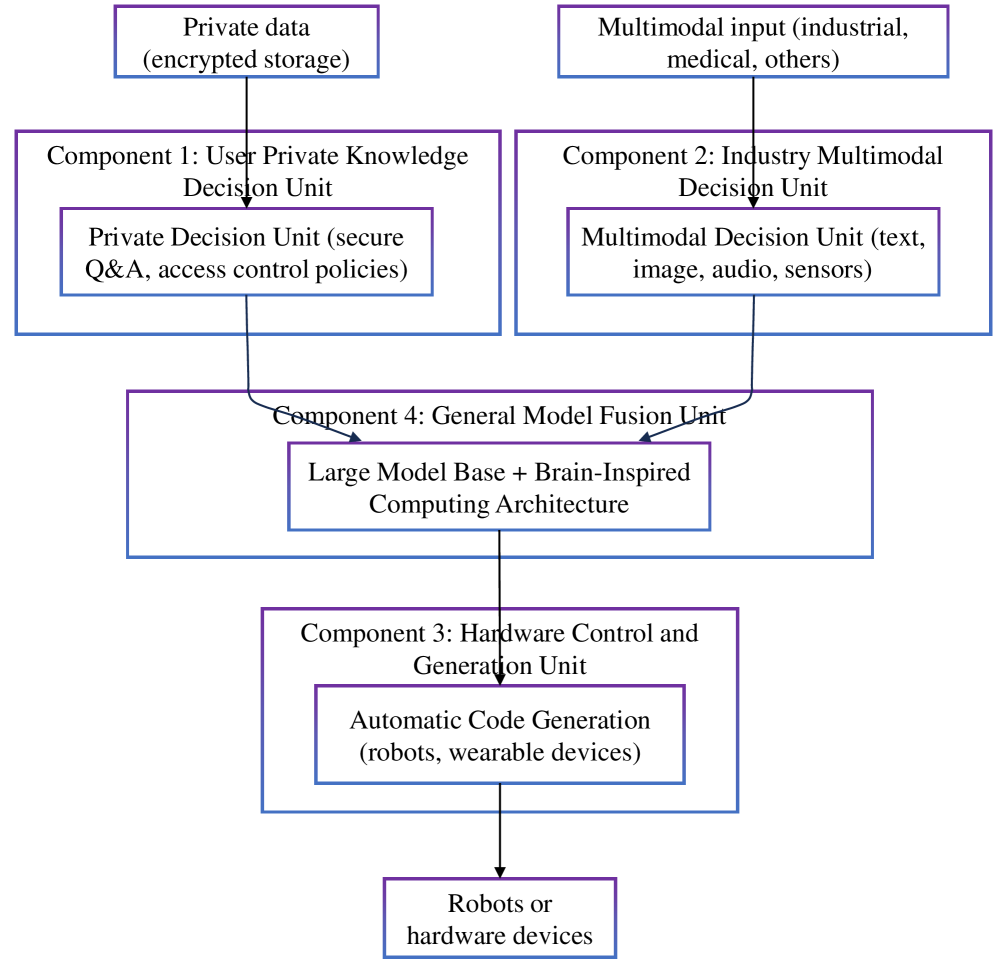

技术框架:“文lu”系统的整体架构包含以下几个主要模块:1) 多模态数据输入模块,用于接收图像、语音等多种类型的数据;2) 知识融合模块,通过记忆标记和重放机制,将用户私有数据、行业知识和通用语言模型进行融合;3) 决策模块,基于融合后的知识,进行推理和决策;4) 代码生成模块,将决策结果转化为硬件可执行的代码;5) 安全模块,确保用户数据的隐私和安全。

关键创新:该论文最重要的技术创新点在于其受大脑启发的记忆标记和重放机制,该机制能够安全地融合私有知识和公共模型,并实现多模态数据的统一处理。与现有方法相比,该机制能够在保护用户隐私的前提下,更有效地利用知识,并实现从认知到执行的闭环控制。

关键设计:具体的参数设置、损失函数和网络结构等技术细节在论文中未详细描述,属于未知信息。但可以推测,记忆标记和重放机制可能涉及到注意力机制、知识图谱嵌入等技术,并通过特定的损失函数来优化知识融合的效果。代码生成模块可能采用基于规则或基于学习的方法,将决策结果转化为硬件可执行的代码。

🖼️ 关键图片

📊 实验亮点

论文摘要中提到,“文lu”系统在多模态处理、隐私安全、端到端硬件控制代码生成、自学习和可持续更新方面表现出显著优势。但具体的性能数据、对比基线和提升幅度等实验结果未在摘要中给出,属于未知信息。需要查阅论文全文才能获取更详细的实验结果。

🎯 应用场景

“文lu”系统具有广泛的应用前景,包括企业决策支持、医疗分析、自动驾驶、机器人控制等领域。它可以帮助企业更高效地利用数据进行决策,辅助医生进行疾病诊断,提升自动驾驶系统的安全性和可靠性,以及实现更智能的机器人控制。该研究有望推动人工智能在各行业的深入应用,并为构建下一代智能系统提供新的思路。

📄 摘要(原文)

With the rapid penetration of artificial intelligence across industries and scenarios, a key challenge in building the next-generation intelligent core lies in effectively integrating the language understanding capabilities of foundation models with domain-specific knowledge bases in complex real-world applications. This paper proposes a multimodal cognition and embodied decision-making brain system,

Wenlu", designed to enable secure fusion of private knowledge and public models, unified processing of multimodal data such as images and speech, and closed-loop decision-making from cognition to automatic generation of hardware-level code. The system introduces a brain-inspired memory tagging and replay mechanism, seamlessly integrating user-private data, industry-specific knowledge, and general-purpose language models. It provides precise and efficient multimodal services for enterprise decision support, medical analysis, autonomous driving, robotic control, and more. Compared with existing solutions,Wenlu" demonstrates significant advantages in multimodal processing, privacy security, end-to-end hardware control code generation, self-learning, and sustainable updates, thus laying a solid foundation for constructing the next-generation intelligent core.