Evaluation of LLMs for mathematical problem solving

作者: Ruonan Wang, Runxi Wang, Yunwen Shen, Chengfeng Wu, Qinglin Zhou, Rohitash Chandra

分类: cs.AI

发布日期: 2025-05-30 (更新: 2025-06-28)

💡 一句话要点

评估大型语言模型在数学问题求解中的能力,揭示不同模型优劣势。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 数学问题求解 结构化思维链 模型评估 教育应用

📋 核心要点

- 现有研究对LLM在数学问题求解方面的能力评估不足,缺乏系统性的对比分析。

- 采用结构化思维链(SCoT)框架,从五个维度全面评估LLM的数学问题求解能力。

- 实验结果表明,GPT-4o在稳定性和一致性方面表现最佳,DeepSeek-V3在优化问题上具有竞争力,Gemini-2.0在语言理解方面表现出色。

📝 摘要(中文)

本研究评估了大型语言模型(LLMs)在解决数学问题方面的潜力,这些模型在各种教育任务中表现出了令人印象深刻的性能,但在这方面的研究仍然不足。我们比较了三个著名的LLM,包括GPT-4o、DeepSeek-V3和Gemini-2.0,使用了三个不同复杂度的数学数据集(GSM8K、MATH500和MIT开放课程数据集)。我们采用基于结构化思维链(SCoT)框架的五维方法来评估最终答案的正确性、步骤的完整性、步骤的有效性、中间计算的准确性和问题理解能力。结果表明,GPT-4o在所有数据集中表现最为稳定和一致,尤其是在MIT开放课程数据集的高级问题中表现出色。DeepSeek-V3在优化等结构化领域具有很强的竞争力,但在统计推断任务中准确率波动较大。Gemini-2.0在结构化问题中表现出强大的语言理解能力和清晰度,但在多步骤推理和符号逻辑方面表现不佳。我们的错误分析揭示了每个模型的具体缺陷:GPT-4o有时缺乏足够的解释或精确性;DeepSeek-V3遗漏了中间步骤;Gemini-2.0在更高维度上的数学推理中不够灵活。

🔬 方法详解

问题定义:论文旨在评估和比较不同大型语言模型(LLMs)在解决数学问题方面的能力。现有方法缺乏对LLM在数学问题求解过程中各个环节的细致评估,难以发现不同模型之间的优劣势和潜在缺陷。

核心思路:论文的核心思路是采用结构化思维链(SCoT)框架,将数学问题求解过程分解为多个维度进行评估,包括最终答案的正确性、步骤的完整性、步骤的有效性、中间计算的准确性和问题理解能力。通过这种多维度的评估,可以更全面地了解LLM在数学问题求解方面的能力,并发现不同模型之间的差异。

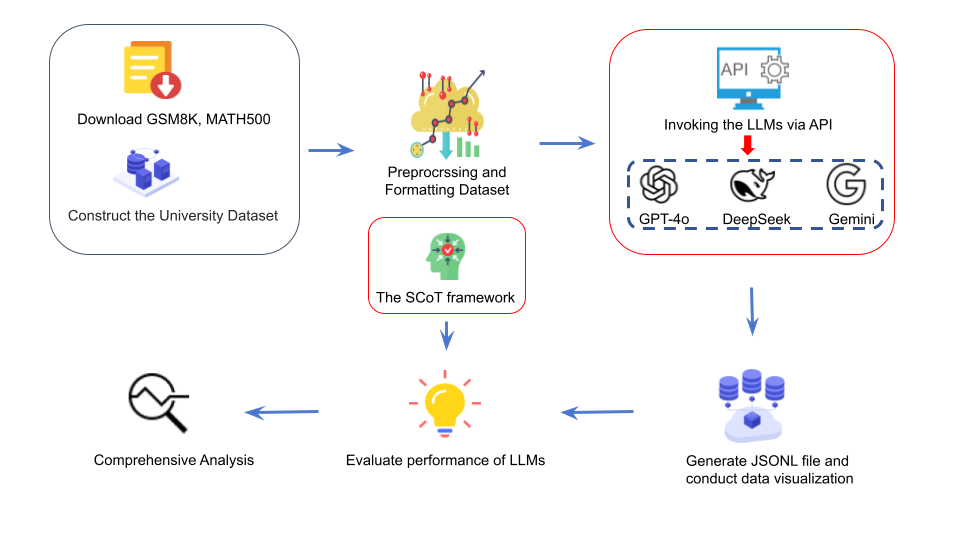

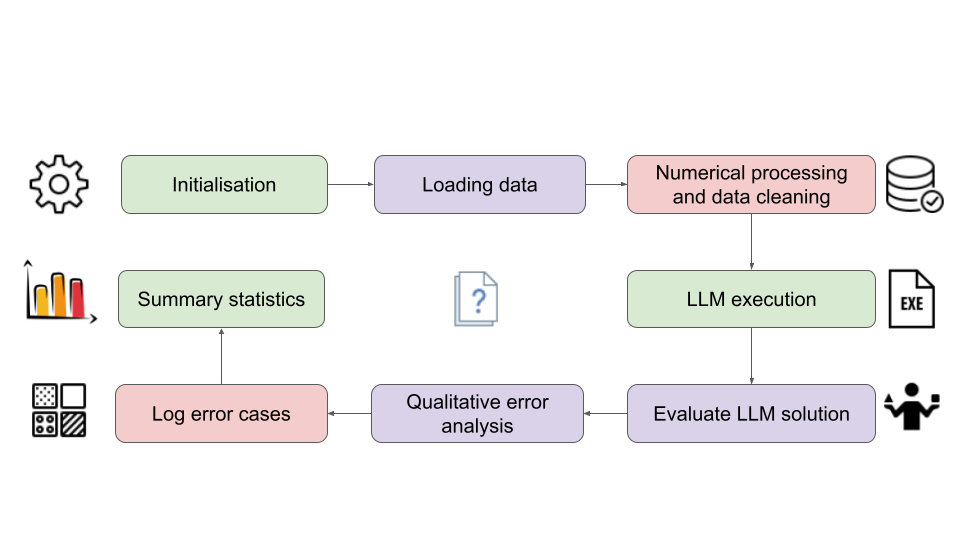

技术框架:论文的技术框架主要包括以下几个步骤:1) 选择三个具有不同复杂度的数学数据集(GSM8K、MATH500和MIT开放课程数据集);2) 选择三个主流的LLM(GPT-4o、DeepSeek-V3和Gemini-2.0);3) 采用SCoT框架,对LLM的数学问题求解过程进行五维评估;4) 对评估结果进行统计分析和错误分析,揭示不同模型的优劣势和潜在缺陷。

关键创新:论文的关键创新在于采用了结构化思维链(SCoT)框架,对LLM的数学问题求解过程进行多维度的评估。这种评估方法不仅可以评估最终答案的正确性,还可以评估中间步骤的完整性、有效性和准确性,从而更全面地了解LLM在数学问题求解方面的能力。

关键设计:论文的关键设计包括:1) 选择具有不同复杂度的数学数据集,以评估LLM在不同难度级别的问题上的表现;2) 选择主流的LLM,以保证评估结果的代表性;3) 采用SCoT框架,将数学问题求解过程分解为多个维度进行评估,并设计相应的评估指标;4) 对评估结果进行统计分析和错误分析,以揭示不同模型的优劣势和潜在缺陷。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GPT-4o在所有数据集中表现最为稳定和一致,尤其是在MIT开放课程数据集的高级问题中表现出色。DeepSeek-V3在优化等结构化领域具有很强的竞争力,但Gemini-2.0在多步骤推理和符号逻辑方面表现不佳。错误分析揭示了每个模型的具体缺陷,为后续模型改进提供了方向。

🎯 应用场景

该研究成果可应用于教育领域,帮助学生更好地利用LLM进行数学学习和问题求解。同时,该研究也为LLM的开发和优化提供了指导,可以促进LLM在数学领域的应用。

📄 摘要(原文)

Large Language Models (LLMs) have shown impressive performance on a range of educational tasks, but are still understudied for their potential to solve mathematical problems. In this study, we compare three prominent LLMs, including GPT-4o, DeepSeek-V3, and Gemini-2.0, on three mathematics datasets of varying complexities (GSM8K, MATH500, and MIT Open Courseware datasets). We take a five-dimensional approach based on the Structured Chain-of-Thought (SCoT) framework to assess final answer correctness, step completeness, step validity, intermediate calculation accuracy, and problem comprehension. The results show that GPT-4o is the most stable and consistent in performance across all the datasets, but particularly it performs outstandingly in high-level questions of the MIT Open Courseware dataset. DeepSeek-V3 is competitively strong in well-structured domains such as optimisation, but suffers from fluctuations in accuracy in statistical inference tasks. Gemini-2.0 shows strong linguistic understanding and clarity in well-structured problems but performs poorly in multi-step reasoning and symbolic logic. Our error analysis reveals particular deficits in each model: GPT-4o is at times lacking in sufficient explanation or precision; DeepSeek-V3 leaves out intermediate steps; and Gemini-2.0 is less flexible in mathematical reasoning in higher dimensions.