Chances and Challenges of the Model Context Protocol in Digital Forensics and Incident Response

作者: Jan-Niclas Hilgert, Carlo Jakobs, Michael Külper, Martin Lambertz, Axel Mahr, Elmar Padilla

分类: cs.CR, cs.AI

发布日期: 2025-05-30

💡 一句话要点

探索模型上下文协议在数字取证与事件响应中的应用,提升LLM透明性与可复现性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 数字取证 事件响应 大型语言模型 模型上下文协议 透明性 可解释性 可复现性

📋 核心要点

- 现有数字取证方法在利用LLM时,面临透明性、可解释性和可复现性不足的挑战。

- 论文提出利用模型上下文协议(MCP)来解决上述问题,增强LLM在取证流程中的可控性和可追溯性。

- 分析表明,MCP能加强现有取证工作流程,并扩展LLM在取证领域的应用,同时提升自动化水平。

📝 摘要(中文)

大型语言模型在支持取证调查方面具有巨大潜力,但缺乏透明性、可解释性和可复现性阻碍了其广泛应用。本文探讨了新兴的模型上下文协议(MCP)如何应对这些挑战,并支持LLM在数字取证中的有效使用。通过理论分析,我们研究了MCP如何集成到各种取证场景中,从工件分析到生成可解释的报告。我们还概述了在取证环境中部署MCP服务器的技术和概念性考虑因素。我们的分析揭示了广泛的用例,其中MCP不仅加强了现有的取证工作流程,而且促进了LLM在以前使用受限的取证领域的应用。此外,我们引入了推理约束级别的概念,这是一种表征特定MCP设计选择如何有意识地约束模型行为的方式,从而增强可审计性和可追溯性。我们的见解表明,MCP具有作为开发LLM辅助取证工作流程的基础组件的巨大潜力,这些工作流程不仅更透明、可复现且在法律上更具防御性,而且代表着数字取证分析自动化程度的提高。然而,我们也强调了采用MCP可能在未来给数字取证带来的潜在挑战。

🔬 方法详解

问题定义:当前数字取证领域利用大型语言模型(LLM)时,面临着模型行为不透明、推理过程难以解释、结果难以复现等问题。这些问题限制了LLM在数字取证中的广泛应用,尤其是在需要严格审计和法律辩护的场景下。现有方法缺乏对LLM行为的有效控制和记录,难以保证取证结果的可靠性和公正性。

核心思路:论文的核心思路是引入模型上下文协议(Model Context Protocol, MCP),通过该协议来规范LLM在取证过程中的行为,记录模型的输入、输出和推理过程,从而提高LLM的透明性、可解释性和可复现性。MCP的设计目标是允许取证人员对LLM的行为进行约束,例如限制模型使用的知识范围、控制模型的推理路径等。

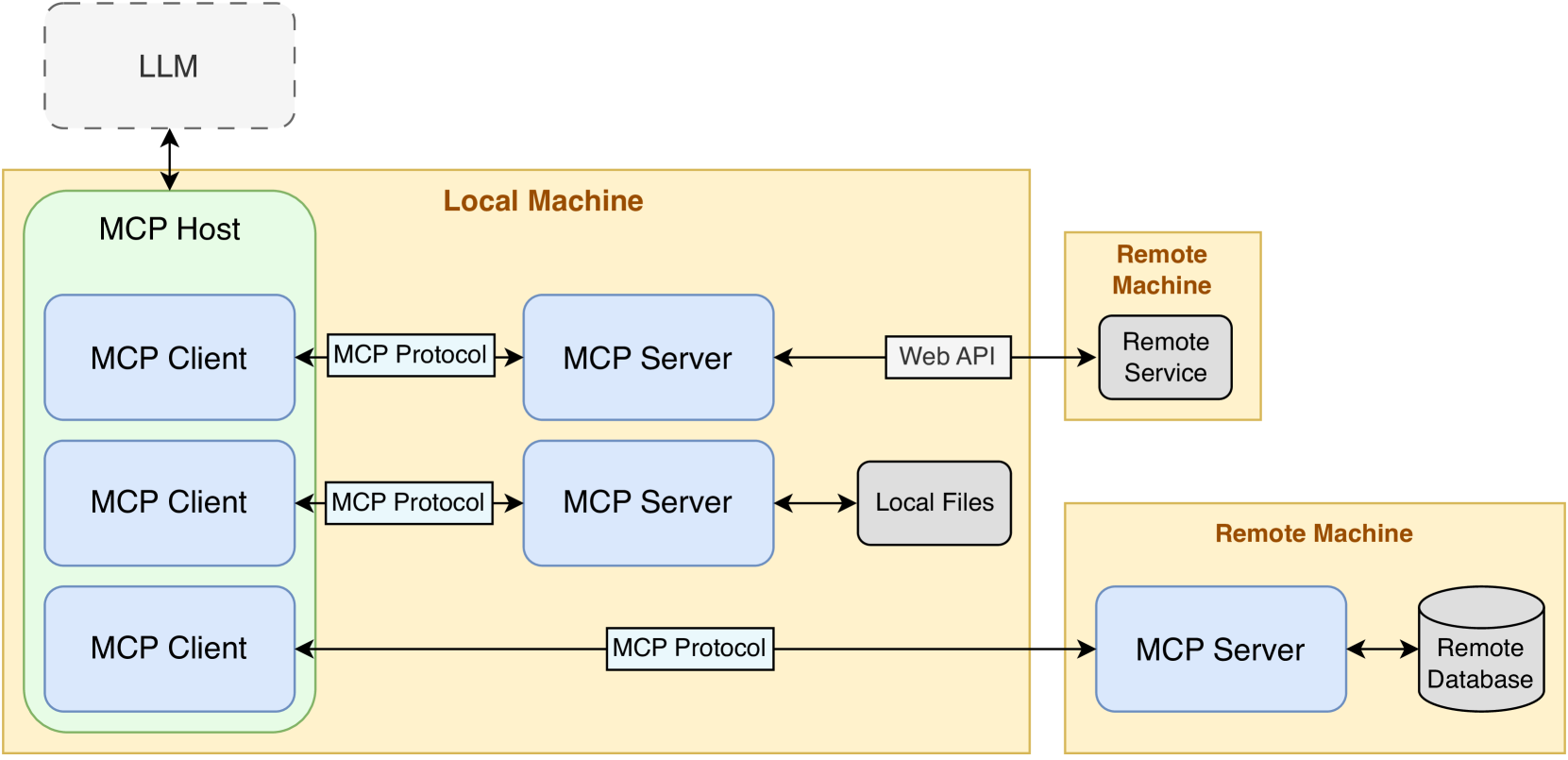

技术框架:论文提出的技术框架主要包括以下几个部分:1) MCP服务器:负责管理和维护模型上下文信息,接收来自取证工具的请求,并与LLM进行交互。2) 取证工具:集成MCP客户端,负责将取证数据和任务提交给MCP服务器,并接收LLM的分析结果。3) LLM:通过MCP服务器接收取证任务,并根据MCP的约束进行推理。4) 推理约束级别:定义了对LLM行为约束的程度,例如可以限制模型使用的知识范围、控制模型的推理路径等。

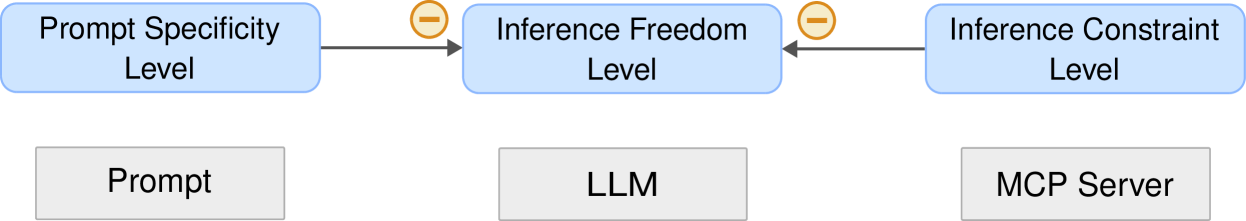

关键创新:论文的关键创新在于提出了模型上下文协议(MCP)的概念,并将其应用于数字取证领域。MCP通过规范LLM的行为,记录模型的输入、输出和推理过程,从而提高了LLM的透明性、可解释性和可复现性。此外,论文还提出了推理约束级别的概念,允许取证人员根据不同的取证场景,对LLM的行为进行不同程度的约束。

关键设计:MCP的关键设计包括:1) 上下文信息的表示:如何有效地表示取证数据和任务,以便LLM能够理解和处理。2) 约束策略的定义:如何定义对LLM行为的约束策略,例如限制模型使用的知识范围、控制模型的推理路径等。3) 交互协议的设计:如何设计MCP服务器和取证工具之间的交互协议,以便实现高效的数据传输和任务调度。4) 推理约束级别的划分:如何划分不同的推理约束级别,以便取证人员根据不同的取证场景选择合适的约束级别。

🖼️ 关键图片

📊 实验亮点

论文通过理论分析和案例研究,展示了MCP在提高LLM透明性、可解释性和可复现性方面的潜力。论文提出了推理约束级别的概念,并分析了不同约束级别对LLM行为的影响。虽然没有提供具体的性能数据,但论文强调了MCP在加强现有取证工作流程和扩展LLM应用领域方面的优势。

🎯 应用场景

该研究成果可应用于各种数字取证场景,例如恶意软件分析、入侵检测、数据恢复等。通过MCP,可以提高LLM在取证分析中的可靠性和可信度,并为法律诉讼提供更强的证据支持。未来,MCP有望成为LLM辅助取证分析的基础设施,促进数字取证的自动化和智能化。

📄 摘要(原文)

Large language models hold considerable promise for supporting forensic investigations, but their widespread adoption is hindered by a lack of transparency, explainability, and reproducibility. This paper explores how the emerging Model Context Protocol can address these challenges and support the meaningful use of LLMs in digital forensics. Through a theoretical analysis, we examine how MCP can be integrated across various forensic scenarios - ranging from artifact analysis to the generation of interpretable reports. We also outline both technical and conceptual considerations for deploying an MCP server in forensic environments. Our analysis reveals a wide range of use cases in which MCP not only strengthens existing forensic workflows but also facilitates the application of LLMs to areas of forensics where their use was previously limited. Furthermore, we introduce the concept of the inference constraint level - a way of characterizing how specific MCP design choices can deliberately constrain model behavior, thereby enhancing both auditability and traceability. Our insights demonstrate that MCP has significant potential as a foundational component for developing LLM-assisted forensic workflows that are not only more transparent, reproducible, and legally defensible, but also represent a step toward increased automation in digital forensic analysis. However, we also highlight potential challenges that the adoption of MCP may pose for digital forensics in the future.