Intrinsic Goals for Autonomous Agents: Model-Based Exploration in Virtual Zebrafish Predicts Ethological Behavior and Whole-Brain Dynamics

作者: Reece Keller, Alyn Kirsch, Felix Pei, Xaq Pitkow, Leo Kozachkov, Aran Nayebi

分类: q-bio.NC, cs.AI, cs.LG, cs.RO

发布日期: 2025-05-30 (更新: 2025-10-24)

备注: 17 pages, 7 figures

💡 一句话要点

提出3M-Progress模型,通过自监督学习预测斑马鱼行为和全脑动态,实现类动物自主探索。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 自主探索 内在动机 模型预测控制 神经胶质动力学 斑马鱼 自监督学习

📋 核心要点

- 现有强化学习方法在无奖励探索中表现不一致,无法捕捉动物的自主行为,且系统神经科学较少关注自主性的神经基础。

- 论文提出3M-Progress模型,通过追踪在线世界模型与生态位先验的差异,模拟动物的自主探索行为。

- 实验表明,3M-Progress模型能预测斑马鱼的行为模式和全脑神经胶质动力学,无需任何行为或神经训练数据。

📝 摘要(中文)

自主性是动物智能的标志,它使动物能够在复杂的环境中进行适应性和智能行为,而无需依赖外部奖励或任务结构。现有的强化学习方法在无奖励环境中的探索,包括一类被称为基于模型的内在动机的方法,表现出不一致的探索模式,并且不收敛到探索性策略,因此未能捕捉到动物中观察到的鲁棒的自主行为。此外,系统神经科学在很大程度上忽略了自主性的神经基础,而是专注于动物受到外部奖励驱动的实验范式,而不是参与伦理学、自然主义和独立于任务的行为。为了弥合这些差距,我们引入了一种新颖的基于模型的内在驱动,该驱动是根据动物自主探索的原则明确设计的。我们的方法(3M-Progress)通过跟踪在线世界模型与从生态位学习到的固定先验之间的差异来实现类似动物的探索。据我们所知,我们引入了第一个自主具身智能体,该智能体完全通过内在目标的自监督优化来预测大脑数据——没有任何行为或神经训练数据——证明了3M-Progress智能体捕获了从自主行为的幼虫斑马鱼记录的行为模式和全脑神经胶质动力学中的可解释方差,从而提供了第一个目标驱动的神经胶质计算的群体水平模型。我们的发现建立了一个计算框架,将基于模型的内在动机与自然行为联系起来,为构建具有类似动物自主性的人工智能体奠定了基础。

🔬 方法详解

问题定义:现有基于模型的内在动机方法在无奖励环境中进行探索时,存在探索模式不一致和无法收敛到有效探索策略的问题。此外,系统神经科学对自主行为的神经机制研究不足,主要关注外部奖励驱动的行为。因此,需要一种能够模拟动物自主探索行为并解释其神经基础的方法。

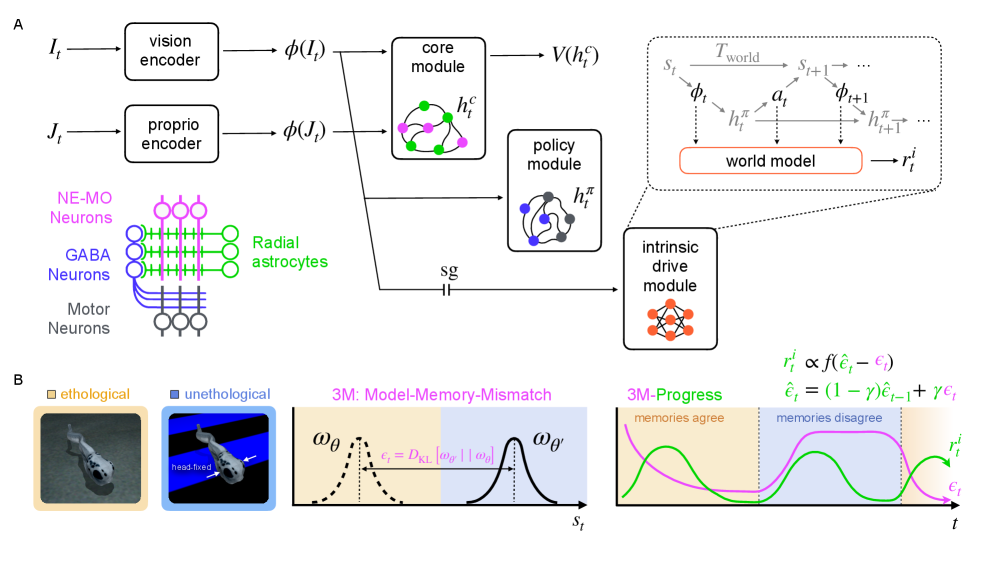

核心思路:论文的核心思路是设计一种基于模型的内在驱动,该驱动能够模拟动物在生态位中的自主探索行为。通过跟踪智能体在线学习的世界模型与从生态位学习到的固定先验之间的差异,鼓励智能体探索未知区域,从而实现类似动物的探索模式。这种差异可以被视为一种“进步”信号,驱动智能体不断学习和适应环境。

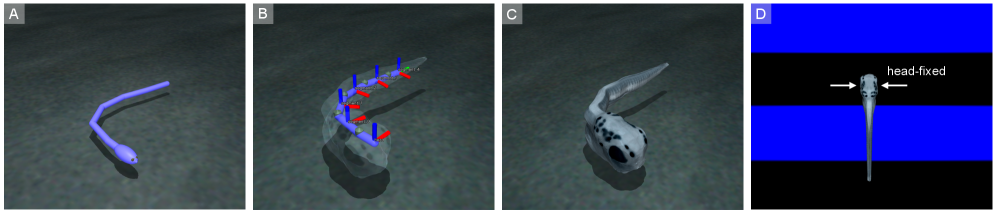

技术框架:3M-Progress模型包含以下主要模块:1)一个在线世界模型,用于预测环境的动态;2)一个从生态位学习到的固定先验,代表智能体对环境的初始理解;3)一个差异度量模块,用于计算在线世界模型与固定先验之间的差异;4)一个优化器,用于根据差异度量调整智能体的行为策略。智能体通过与环境交互,不断更新其在线世界模型,并根据与固定先验的差异调整其行为,从而实现自主探索。

关键创新:该方法的主要创新在于其内在动机的设计,它基于在线世界模型与固定先验之间的差异,而不是传统的奖励函数。这种设计更符合动物的自主探索行为,并且能够避免奖励函数带来的偏差。此外,该方法首次实现了通过自监督学习预测斑马鱼行为和全脑动态,无需任何行为或神经训练数据。

关键设计:关键设计包括:1)在线世界模型的选择,需要能够准确预测环境的动态;2)固定先验的学习方法,需要能够代表智能体对环境的初始理解;3)差异度量的选择,需要能够有效衡量在线世界模型与固定先验之间的差异;4)优化器的选择,需要能够有效地调整智能体的行为策略。论文中具体使用了哪些模型结构和参数设置未知。

🖼️ 关键图片

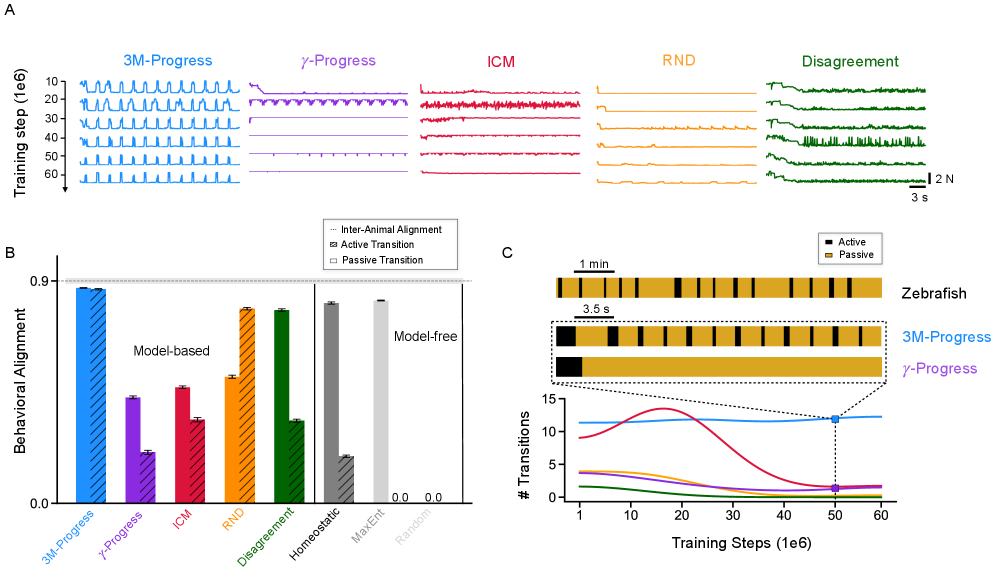

📊 实验亮点

3M-Progress模型能够仅通过自监督学习,无需任何行为或神经训练数据,即可预测斑马鱼的行为模式和全脑神经胶质动力学。该模型捕获了斑马鱼行为和神经活动中的可解释方差,为理解自主行为的神经基础提供了新的视角。具体的性能数据和对比基线未知。

🎯 应用场景

该研究成果可应用于开发具有类动物自主性的机器人和人工智能体,例如在未知环境中进行自主探索的机器人、用于生物行为研究的虚拟环境等。此外,该研究也为理解动物的自主行为和神经机制提供了新的计算模型,有助于神经科学的研究。

📄 摘要(原文)

Autonomy is a hallmark of animal intelligence, enabling adaptive and intelligent behavior in complex environments without relying on external reward or task structure. Existing reinforcement learning approaches to exploration in reward-free environments, including a class of methods known as model-based intrinsic motivation, exhibit inconsistent exploration patterns and do not converge to an exploratory policy, thus failing to capture robust autonomous behaviors observed in animals. Moreover, systems neuroscience has largely overlooked the neural basis of autonomy, focusing instead on experimental paradigms where animals are motivated by external reward rather than engaging in ethological, naturalistic and task-independent behavior. To bridge these gaps, we introduce a novel model-based intrinsic drive explicitly designed after the principles of autonomous exploration in animals. Our method (3M-Progress) achieves animal-like exploration by tracking divergence between an online world model and a fixed prior learned from an ecological niche. To the best of our knowledge, we introduce the first autonomous embodied agent that predicts brain data entirely from self-supervised optimization of an intrinsic goal -- without any behavioral or neural training data -- demonstrating that 3M-Progress agents capture the explainable variance in behavioral patterns and whole-brain neural-glial dynamics recorded from autonomously behaving larval zebrafish, thereby providing the first goal-driven, population-level model of neural-glial computation. Our findings establish a computational framework connecting model-based intrinsic motivation to naturalistic behavior, providing a foundation for building artificial agents with animal-like autonomy.