Privacy-Preserving Chest X-ray Report Generation via Multimodal Federated Learning with ViT and GPT-2

作者: Md. Zahid Hossain, Mustofa Ahmed, Most. Sharmin Sultana Samu, Md. Rakibul Islam

分类: eess.IV, cs.AI, cs.CV

发布日期: 2025-05-27

备注: Preprint, manuscript under-review

💡 一句话要点

提出基于ViT和GPT-2的多模态联邦学习框架,用于保护隐私的胸部X光报告生成。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 联邦学习 胸部X光 报告生成 ViT GPT-2 多模态学习 隐私保护

📋 核心要点

- 传统胸部X光报告生成方法依赖中心化数据,存在患者隐私泄露风险,阻碍了医疗AI的协作发展。

- 论文提出一种基于联邦学习的框架,利用ViT和GPT-2,在不共享原始数据的前提下进行模型训练。

- 实验结果表明,该联邦学习框架在报告生成质量上可与中心化模型媲美,且Krum聚合策略表现最佳。

📝 摘要(中文)

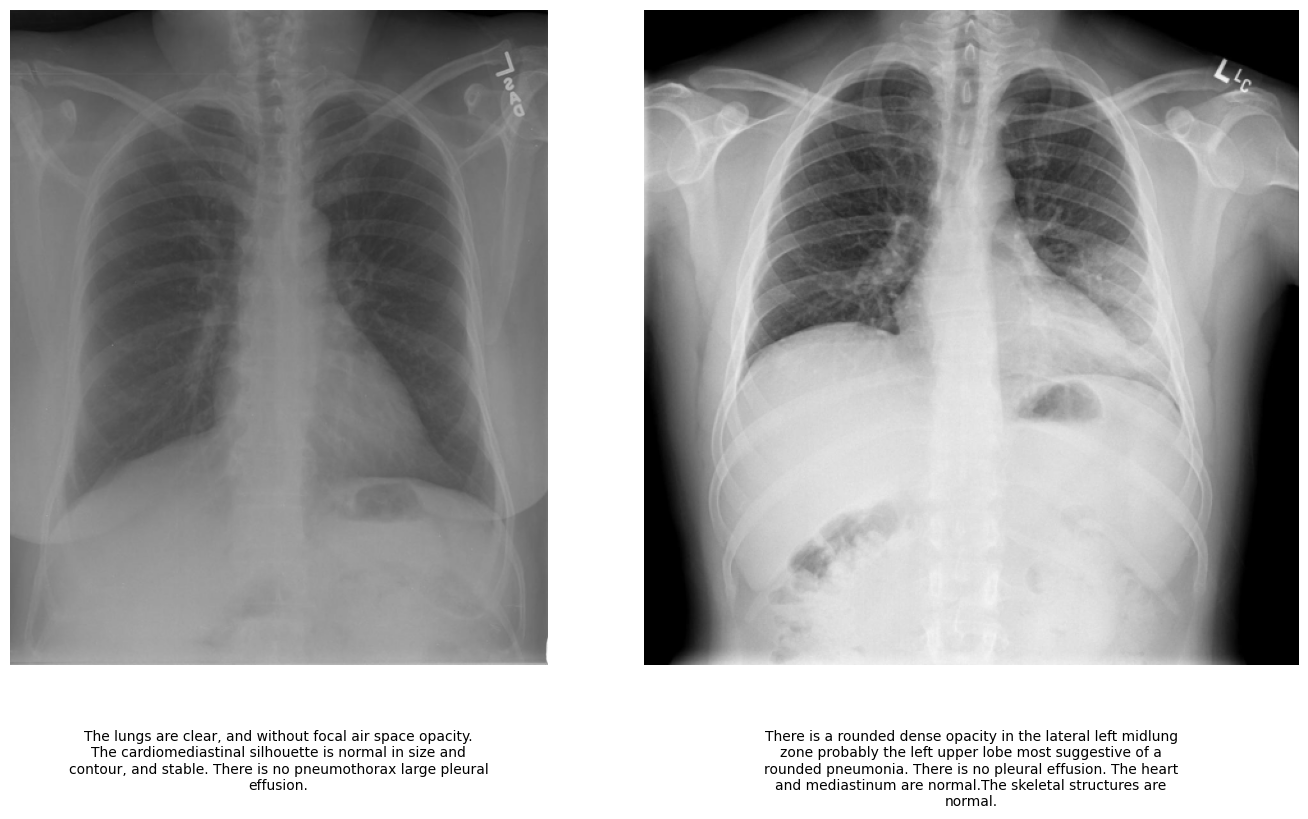

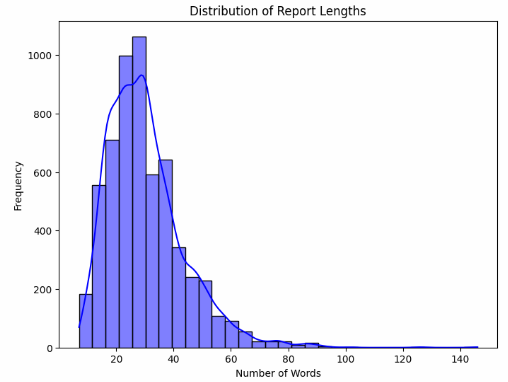

本研究提出了一种多模态联邦学习框架,用于从胸部X光图像中自动生成放射学报告,旨在增强诊断工作流程并保护患者隐私。传统的中心化方法需要传输敏感数据,存在隐私问题。该框架使用IU-Xray数据集,利用Vision Transformer (ViT)作为编码器,GPT-2作为报告生成器,实现去中心化训练,无需共享原始数据。研究评估了三种联邦学习聚合策略:FedAvg、Krum聚合和一种新的损失感知联邦平均(L-FedAvg)。结果表明,Krum聚合在ROUGE、BLEU、BERTScore和RaTEScore等词汇和语义评估指标上表现最佳。联邦学习能够匹配甚至超过中心化模型,生成临床相关且语义丰富的放射学报告。这种轻量级且保护隐私的框架为协作医疗AI开发铺平了道路,且不损害数据机密性。

🔬 方法详解

问题定义:论文旨在解决胸部X光报告自动生成过程中,因数据集中化带来的患者隐私泄露问题。现有方法需要将所有数据上传到中心服务器进行训练,这使得患者的敏感医疗信息面临风险,同时也限制了不同医疗机构之间的数据共享与协作。

核心思路:论文的核心思路是利用联邦学习,将模型训练过程分散到各个医疗机构本地进行,每个机构使用本地数据训练模型,然后将模型参数的更新上传到中心服务器进行聚合,从而在不共享原始数据的前提下,实现模型的全局优化。这样既能利用各机构的数据,又能保护患者隐私。

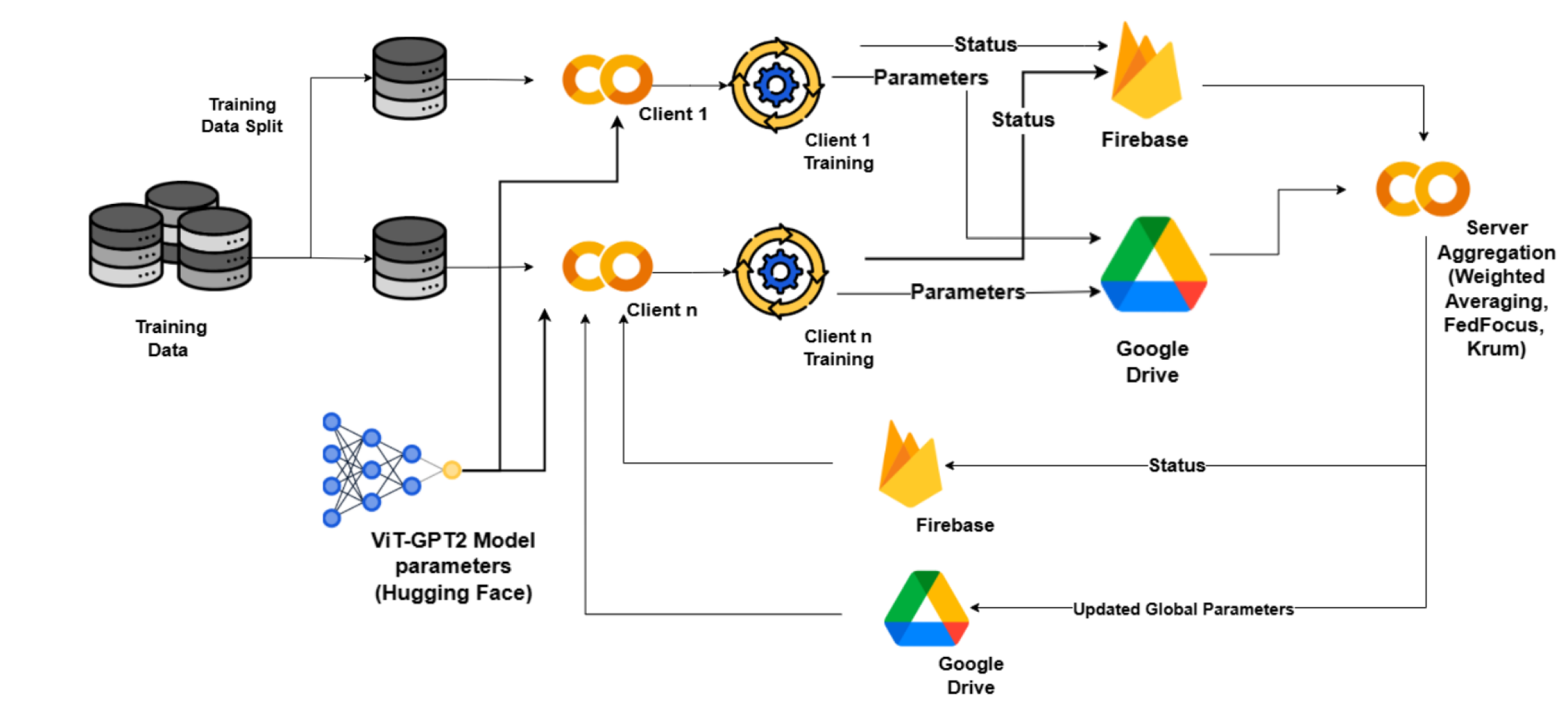

技术框架:整体框架包含以下几个主要模块:1) 数据准备:每个客户端(医疗机构)准备本地的胸部X光图像和对应的报告数据。2) 模型初始化:中心服务器初始化ViT编码器和GPT-2解码器。3) 本地训练:每个客户端使用本地数据训练ViT和GPT-2模型。4) 参数聚合:中心服务器使用FedAvg、Krum或L-FedAvg等策略聚合来自各个客户端的模型参数更新。5) 模型评估:在验证集上评估聚合后的模型性能。

关键创新:论文的关键创新在于将多模态联邦学习应用于胸部X光报告生成任务,并提出了一种损失感知的联邦平均(L-FedAvg)策略。此外,论文还比较了不同的联邦学习聚合策略(FedAvg、Krum和L-FedAvg)在报告生成任务上的性能差异。与现有方法相比,该方法能够在保护患者隐私的前提下,实现高质量的报告生成。

关键设计:ViT编码器用于提取胸部X光图像的视觉特征,GPT-2解码器用于生成报告文本。论文采用了交叉熵损失函数来训练GPT-2模型。在联邦学习聚合方面,L-FedAvg策略根据客户端的本地损失动态调整其参数更新的权重。具体来说,损失较高的客户端的权重会降低,以减少其对全局模型的影响。Krum聚合通过选择与其它客户端更新最相似的客户端进行聚合,以提高模型的鲁棒性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于联邦学习的胸部X光报告生成模型在ROUGE、BLEU、BERTScore和RaTEScore等指标上取得了与中心化模型相当甚至更好的性能。特别地,Krum聚合策略在多个指标上表现最佳,证明了其在联邦学习环境下的有效性。该研究验证了联邦学习在医疗影像报告生成任务中的可行性和优越性。

🎯 应用场景

该研究成果可应用于医疗影像诊断领域,特别是在需要保护患者隐私的场景下,例如跨医院的AI辅助诊断系统。通过联邦学习,不同医疗机构可以在不共享患者数据的前提下,共同训练高质量的报告生成模型,提高诊断效率和准确性,并促进医疗AI的协作发展。

📄 摘要(原文)

The automated generation of radiology reports from chest X-ray images holds significant promise in enhancing diagnostic workflows while preserving patient privacy. Traditional centralized approaches often require sensitive data transfer, posing privacy concerns. To address this, the study proposes a Multimodal Federated Learning framework for chest X-ray report generation using the IU-Xray dataset. The system utilizes a Vision Transformer (ViT) as the encoder and GPT-2 as the report generator, enabling decentralized training without sharing raw data. Three Federated Learning (FL) aggregation strategies: FedAvg, Krum Aggregation and a novel Loss-aware Federated Averaging (L-FedAvg) were evaluated. Among these, Krum Aggregation demonstrated superior performance across lexical and semantic evaluation metrics such as ROUGE, BLEU, BERTScore and RaTEScore. The results show that FL can match or surpass centralized models in generating clinically relevant and semantically rich radiology reports. This lightweight and privacy-preserving framework paves the way for collaborative medical AI development without compromising data confidentiality.