The Feasibility of Topic-Based Watermarking on Academic Peer Reviews

作者: Alexander Nemecek, Yuzhou Jiang, Erman Ayday

分类: cs.CR, cs.AI

发布日期: 2025-05-27 (更新: 2025-11-11)

备注: Accepted at AACL 25 Findings

💡 一句话要点

提出基于主题的水印方法,用于学术同行评议中LLM生成文本的溯源。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 主题水印 大型语言模型 同行评议 文本溯源 语义感知 LLM检测

📋 核心要点

- 同行评议中LLM的滥用引发了对保密性、内容真实性和评估一致性的担忧,亟需有效的溯源机制。

- 论文提出基于主题的水印(TBW)方法,通过语义感知的方式在LLM生成的文本中嵌入可检测的信号。

- 实验结果表明,TBW在保持评审质量的同时,能够有效检测经过释义的水印文本,具有实际应用潜力。

📝 摘要(中文)

大型语言模型(LLMs)正日益融入学术工作流程,许多会议和期刊允许将其用于语言润色和文献总结等任务。然而,由于担心泄露机密信息、产生幻觉内容以及评估不一致,LLM在同行评审中的使用仍然被禁止。随着LLM生成的文本越来越难以与人类写作区分,因此越来越需要可靠的归属机制来维护评审过程的完整性。本文评估了基于主题的水印(TBW)技术,这是一种语义感知技术,旨在将可检测的信号嵌入到LLM生成的文本中。我们使用来自学术会议的真实同行评审数据,对包括基础模型、少样本模型和微调模型在内的多种LLM配置进行了系统评估。结果表明,相对于未加水印的输出,TBW保持了评审质量,同时在释义下表现出强大的检测性能。这些发现突出了TBW作为一种对同行评审环境中LLM归属的最小侵入性和实用解决方案的可行性。

🔬 方法详解

问题定义:论文旨在解决学术同行评议中,如何可靠地识别LLM生成的文本的问题。现有方法难以区分人类撰写和LLM生成的文本,导致评审过程的公正性和可信度受到威胁。现有的水印方法可能不够鲁棒,无法抵抗释义攻击,或者会显著降低文本质量。

核心思路:论文的核心思路是利用基于主题的水印(TBW)技术,在LLM生成的文本中嵌入语义相关的、不易察觉的水印。通过分析文本的主题分布,选择特定的词语或短语来编码水印信息。这种方法旨在保持文本的流畅性和语义完整性,同时提高水印的鲁棒性。

技术框架:TBW技术框架主要包含以下几个阶段:1)文本主题分析:使用主题模型(如LDA)分析输入文本的主题分布。2)水印编码:根据预定义的水印信息和主题分布,选择合适的词语或短语进行替换或修改,以嵌入水印。3)文本生成:使用LLM生成带有水印的文本。4)水印检测:分析目标文本的主题分布,并提取水印信息。

关键创新:论文的关键创新在于将主题建模与水印技术相结合,提出了一种语义感知的水印方法。与传统的基于词汇或语法的水印方法相比,TBW能够更好地保持文本的语义一致性,并提高水印的鲁棒性。此外,该方法针对同行评议场景进行了优化,力求在不影响评审质量的前提下实现有效的溯源。

关键设计:论文中可能涉及的关键设计包括:1)主题模型的选择和参数设置(如LDA的主题数量)。2)水印编码策略,例如如何根据主题分布选择合适的词语或短语进行替换。3)水印检测算法,例如如何从文本的主题分布中提取水印信息。4)损失函数的设计,用于在微调LLM时平衡文本质量和水印强度(如果使用了微调)。具体细节可能需要在论文原文中查找。

🖼️ 关键图片

📊 实验亮点

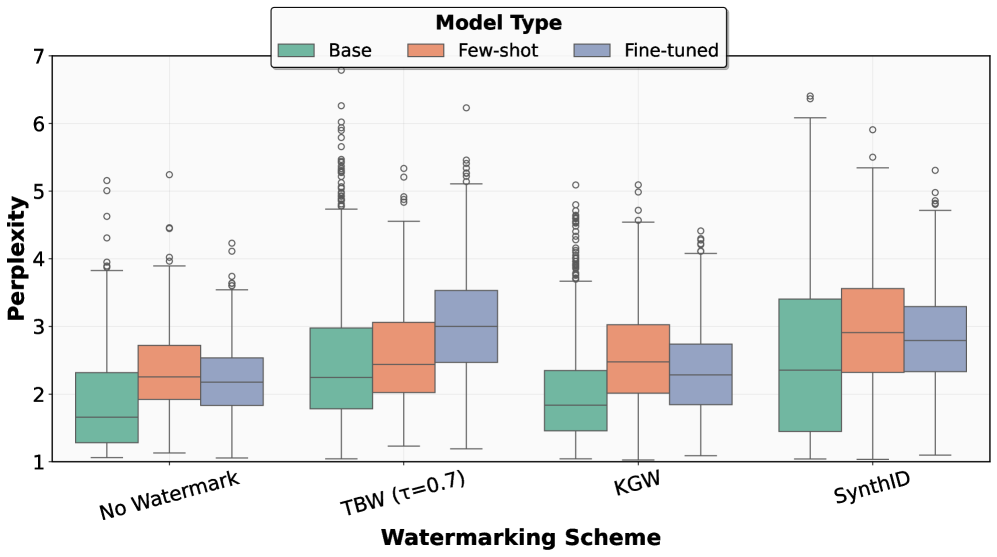

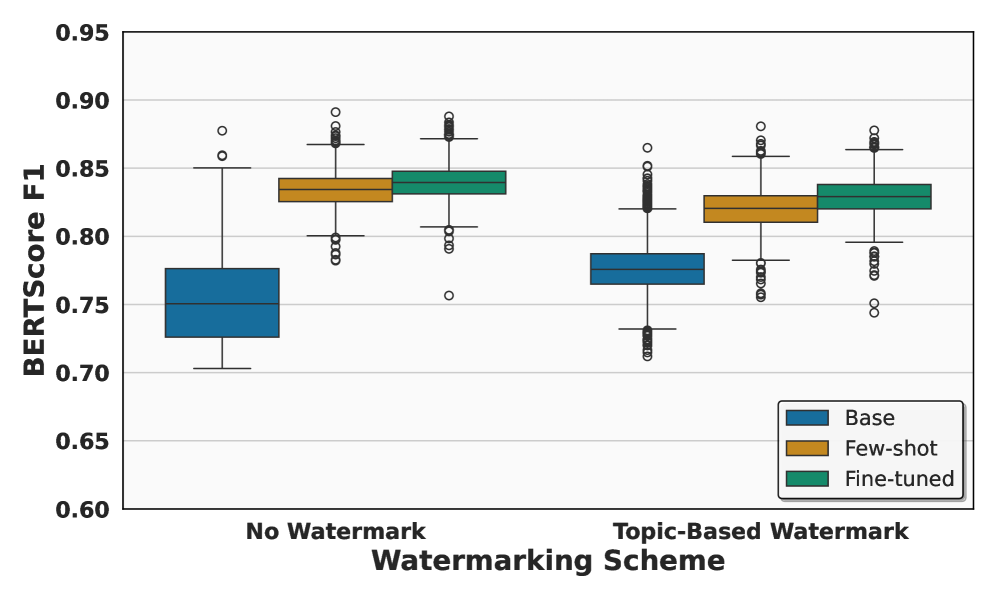

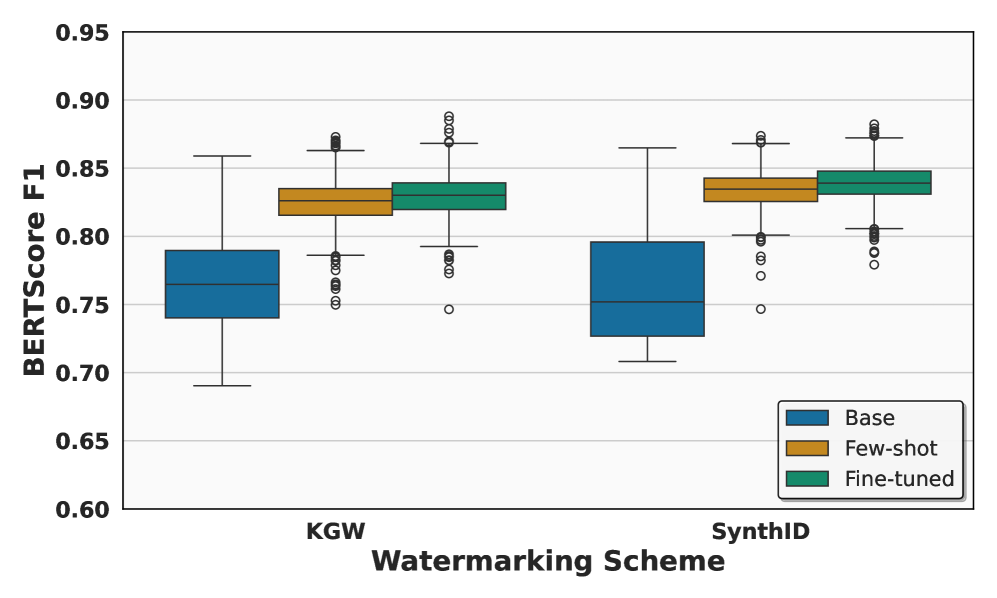

实验结果表明,TBW方法在保持评审质量的同时,能够有效检测经过释义的水印文本。具体而言,相对于未加水印的输出,TBW对评审质量的影响很小,同时在释义攻击下仍能保持较高的检测准确率。这些结果验证了TBW作为一种实用的LLM溯源解决方案的可行性。

🎯 应用场景

该研究成果可应用于学术出版、基金申请等领域,用于检测和防止LLM在同行评议中的不当使用,维护学术诚信。此外,该技术也可扩展到其他需要文本溯源的场景,如新闻报道、合同签署等,具有广泛的应用前景。

📄 摘要(原文)

Large language models (LLMs) are increasingly integrated into academic workflows, with many conferences and journals permitting their use for tasks such as language refinement and literature summarization. However, their use in peer review remains prohibited due to concerns around confidentiality breaches, hallucinated content, and inconsistent evaluations. As LLM-generated text becomes more indistinguishable from human writing, there is a growing need for reliable attribution mechanisms to preserve the integrity of the review process. In this work, we evaluate topic-based watermarking (TBW), a semantic-aware technique designed to embed detectable signals into LLM-generated text. We conduct a systematic assessment across multiple LLM configurations, including base, few-shot, and fine-tuned variants, using authentic peer review data from academic conferences. Our results show that TBW maintains review quality relative to non-watermarked outputs, while demonstrating robust detection performance under paraphrasing. These findings highlight the viability of TBW as a minimally intrusive and practical solution for LLM attribution in peer review settings.