MSEarth: A Multimodal Scientific Dataset and Benchmark for Phenomena Uncovering in Earth Science

作者: Xiangyu Zhao, Wanghan Xu, Bo Liu, Yuhao Zhou, Fenghua Ling, Ben Fei, Xiaoyu Yue, Lei Bai, Wenlong Zhang, Xiao-Ming Wu

分类: cs.AI

发布日期: 2025-05-27 (更新: 2025-10-15)

💡 一句话要点

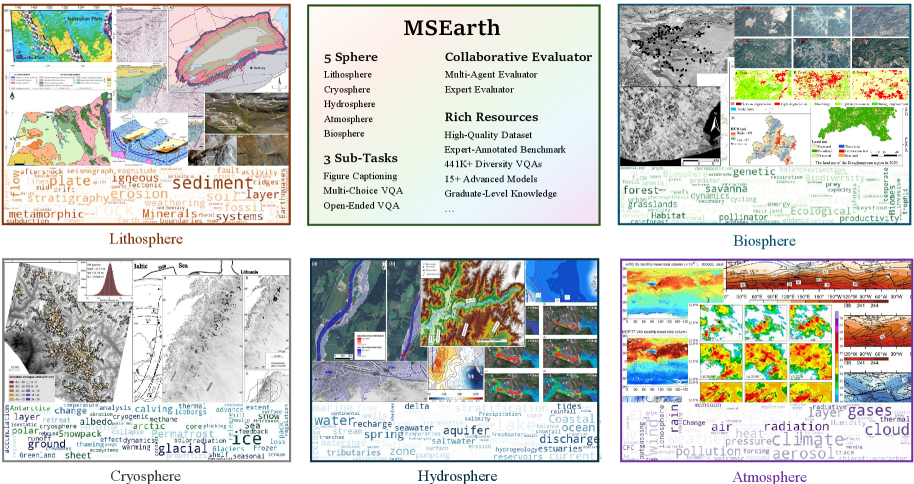

提出MSEarth:一个用于地球科学现象理解的多模态科学数据集与基准。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 地球科学 多模态学习 基准数据集 科学推理 大语言模型

📋 核心要点

- 现有地球科学基准数据集缺乏深度和上下文复杂性,无法充分评估多模态大语言模型在研究生水平的科学推理能力。

- MSEarth通过从高质量科学出版物中提取图文信息,并结合论文讨论和推理,构建了一个知识密集型、细致推理的基准。

- MSEarth支持科学图说明、多项选择题和开放式推理等多种任务,旨在促进多模态大语言模型在地球科学领域的应用。

📝 摘要(中文)

多模态大语言模型(MLLMs)的快速发展为解决复杂的科学挑战带来了新的机遇。然而,它们在地球科学问题中的应用,尤其是在研究生水平上的应用,仍未得到充分探索。一个重要的障碍是缺乏能够捕捉地球科学推理的深度和上下文复杂性的基准。当前的基准通常依赖于合成数据集或简单的图文配对,这不足以反映现实世界科学应用所需的复杂推理和领域特定见解。为了解决这些差距,我们推出了MSEarth,这是一个从高质量、开放获取的科学出版物中整理的多模态科学基准。MSEarth涵盖了地球科学的五个主要领域:大气圈、冰冻圈、水圈、岩石圈和生物圈,包含超过28.9万张带有精细说明的图。这些说明由原始图的说明改进而来,并结合了论文中的讨论和推理,确保基准能够捕捉到高级科学任务所需的细致推理和知识密集型内容。MSEarth支持各种任务,包括科学图的说明、多项选择题和开放式推理挑战。通过弥合研究生水平基准的差距,MSEarth提供了一个可扩展且高保真的资源,以加强MLLM在科学推理中的开发和评估。该基准是公开可用的,以促进该领域的进一步研究和创新。

🔬 方法详解

问题定义:现有地球科学领域的多模态学习基准数据集,要么是合成数据,要么是简单的图文配对,无法充分反映真实科研场景中复杂的推理过程和领域知识。这导致现有模型难以在实际地球科学问题中有效应用,尤其是在需要研究生水平专业知识的任务中。现有方法的痛点在于无法提供足够细粒度和上下文信息的训练数据,从而限制了模型学习复杂科学概念和推理能力。

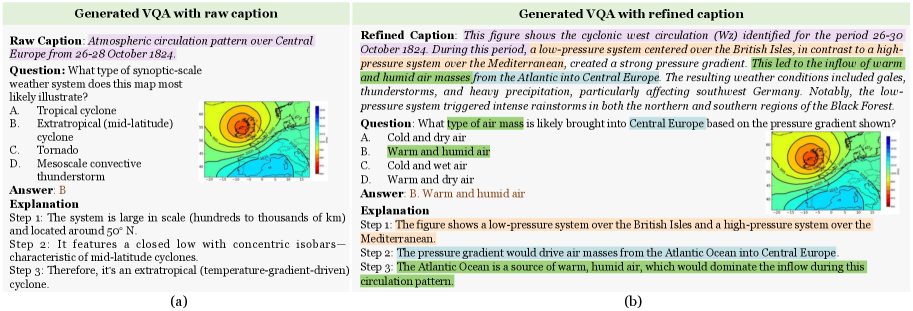

核心思路:MSEarth的核心思路是从高质量的地球科学出版物中提取图文信息,并对原始图文说明进行精细化处理,融入论文中的相关讨论和推理。通过这种方式,构建一个包含丰富领域知识和复杂推理链条的基准数据集。这样设计的目的是为了更好地模拟真实科研场景,并为多模态大语言模型提供更具挑战性和实用性的训练和评估环境。

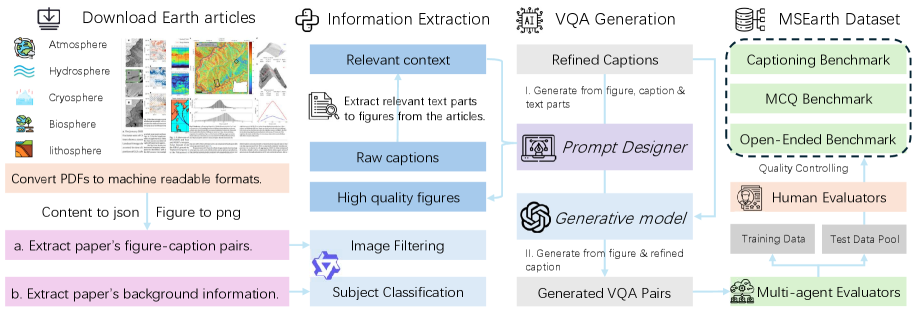

技术框架:MSEarth数据集构建流程主要包括以下几个阶段:1) 数据收集:从开放获取的地球科学出版物中收集图文数据。2) 领域划分:将数据按照地球科学的五个主要领域(大气圈、冰冻圈、水圈、岩石圈和生物圈)进行分类。3) 说明精炼:对原始图文说明进行编辑和扩展,融入论文中的相关讨论和推理,使其更具信息量和推理深度。4) 任务构建:基于数据集构建科学图说明、多项选择题和开放式推理等多种任务。整个流程旨在构建一个高质量、多样化且具有挑战性的地球科学多模态基准。

关键创新:MSEarth最重要的技术创新点在于其数据构建方法,即通过从科学出版物中提取信息并进行精细化处理,从而构建一个知识密集型、细致推理的基准数据集。与现有方法相比,MSEarth不仅提供了图文信息,还融入了论文中的相关讨论和推理,从而更好地模拟了真实科研场景,并为模型提供了更丰富的上下文信息。

关键设计:MSEarth的关键设计包括:1) 数据来源:选择高质量、开放获取的地球科学出版物,保证数据的可靠性和专业性。2) 领域划分:涵盖地球科学的五个主要领域,保证数据的多样性。3) 说明精炼:采用人工编辑和自动生成相结合的方式,对原始图文说明进行精炼和扩展,融入论文中的相关讨论和推理。4) 任务设计:设计科学图说明、多项选择题和开放式推理等多种任务,以全面评估模型的科学推理能力。

🖼️ 关键图片

📊 实验亮点

MSEarth包含超过28.9万张带有精细说明的图,涵盖地球科学的五个主要领域。通过在MSEarth上训练和评估多模态大语言模型,可以显著提升模型在科学图说明、多项选择题和开放式推理等任务上的性能,为地球科学研究提供更强大的AI工具。

🎯 应用场景

MSEarth可应用于训练和评估多模态大语言模型在地球科学领域的应用,例如自动生成科研论文摘要、辅助科研人员进行文献综述、以及开发智能地球科学助手。该研究有助于推动人工智能在地球科学领域的应用,并加速相关科研进展。

📄 摘要(原文)

The rapid advancement of multimodal large language models (MLLMs) has unlocked new opportunities to tackle complex scientific challenges. Despite this progress, their application in addressing earth science problems, especially at the graduate level, remains underexplored. A significant barrier is the absence of benchmarks that capture the depth and contextual complexity of geoscientific reasoning. Current benchmarks often rely on synthetic datasets or simplistic figure-caption pairs, which do not adequately reflect the intricate reasoning and domain-specific insights required for real-world scientific applications. To address these gaps, we introduce MSEarth, a multimodal scientific benchmark curated from high-quality, open-access scientific publications. MSEarth encompasses the five major spheres of Earth science: atmosphere, cryosphere, hydrosphere, lithosphere, and biosphere, featuring over 289K figures with refined captions. These captions are crafted from the original figure captions and enriched with discussions and reasoning from the papers, ensuring the benchmark captures the nuanced reasoning and knowledge-intensive content essential for advanced scientific tasks. MSEarth supports a variety of tasks, including scientific figure captioning, multiple choice questions, and open-ended reasoning challenges. By bridging the gap in graduate-level benchmarks, MSEarth provides a scalable and high-fidelity resource to enhance the development and evaluation of MLLMs in scientific reasoning. The benchmark is publicly available to foster further research and innovation in this field.