DCG-SQL: Enhancing In-Context Learning for Text-to-SQL with Deep Contextual Schema Link Graph

作者: Jihyung Lee, Jin-Seop Lee, Jaehoon Lee, YunSeok Choi, Jee-Hyong Lee

分类: cs.AI, cs.CL

发布日期: 2025-05-26 (更新: 2025-07-22)

🔗 代码/项目: GITHUB

💡 一句话要点

提出DCG-SQL,通过深度上下文Schema链接图增强Text-to-SQL的上下文学习能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Text-to-SQL 上下文学习 深度学习 Schema链接图 自然语言处理

📋 核心要点

- 现有Text-to-SQL方法在上下文学习中,难以有效检索有用的演示样本,导致性能提升有限。

- 构建深度上下文Schema链接图,捕捉问题和数据库Schema项之间的语义关系,用于更有效地检索演示。

- 实验表明,DCG-SQL在Spider基准测试上,能够持续提高SQL生成性能,适用于不同规模的LLMs。

📝 摘要(中文)

本文提出了一种新的方法,旨在有效检索演示并生成SQL查询,从而提升大型语言模型(LLMs)在Text-to-SQL任务中的上下文学习能力。现有方法在选择演示时效果不佳,且在小型LLMs(如Llama 3.1-8B)上性能显著下降,表明其过度依赖超大规模LLMs的固有能力。本文构建了一个深度上下文Schema链接图,该图包含问题及其数据库Schema项之间的关键信息和语义关系。这种基于图的结构能够有效地表示Text-to-SQL样本,并检索有用的演示以进行上下文学习。在Spider基准测试上的实验结果表明,该方法能够持续提高SQL生成性能和效率,适用于超大规模LLMs和小型LLMs。

🔬 方法详解

问题定义:Text-to-SQL任务旨在将自然语言问题转换为SQL查询。现有方法在上下文学习中,依赖随机选择的演示样本,导致检索到的演示与当前问题相关性低,无法有效提升性能。尤其是在小型LLMs上,性能下降更为明显,表明现有方法过度依赖大型LLMs的固有能力,缺乏有效的演示检索机制。

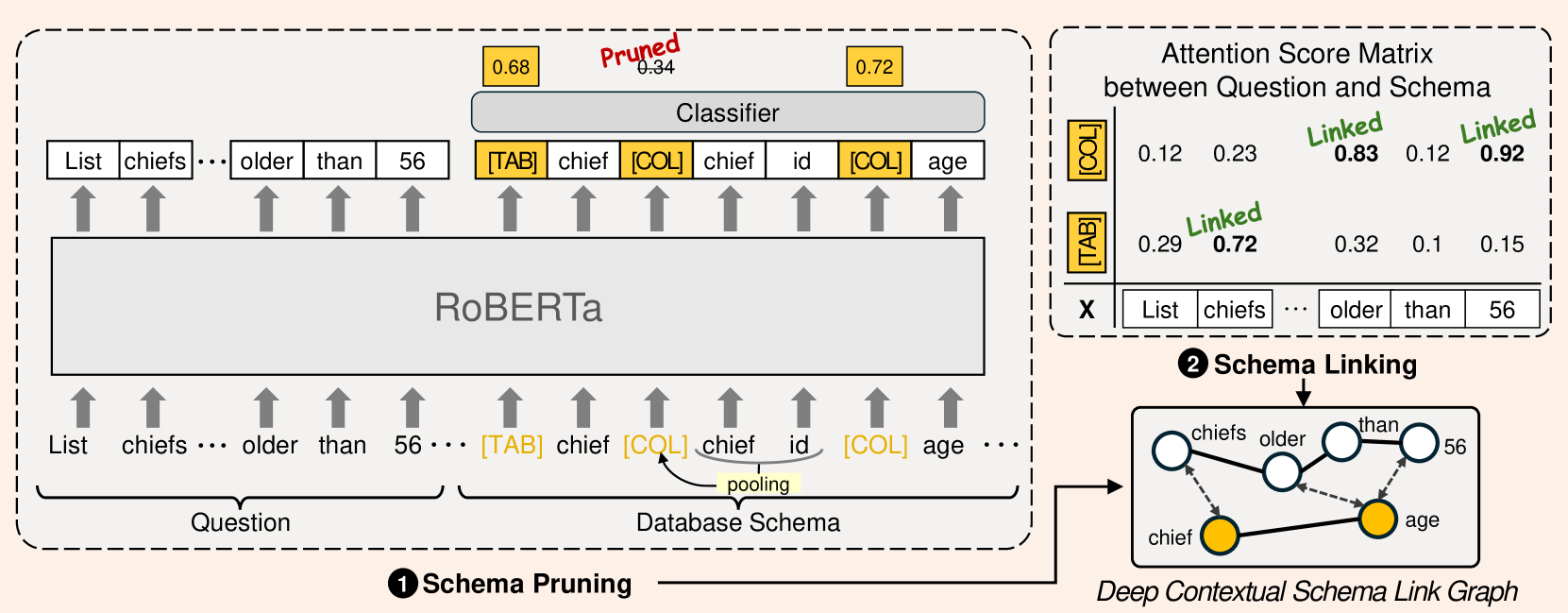

核心思路:本文的核心思路是构建一个深度上下文Schema链接图,用于更准确地表示Text-to-SQL样本,并基于该图进行演示检索。通过捕捉问题和数据库Schema项之间的语义关系,可以更有效地找到与当前问题相关的演示样本,从而提升上下文学习的效果。

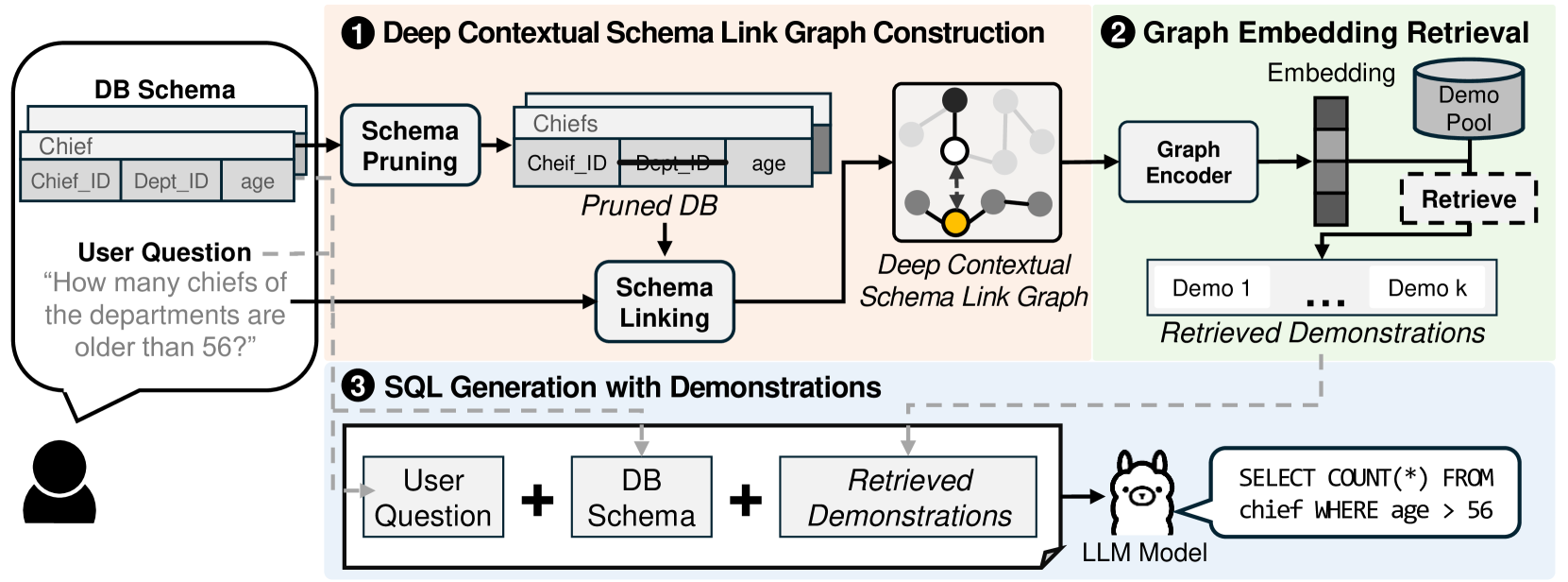

技术框架:DCG-SQL的整体框架包含以下几个主要阶段:1) 构建深度上下文Schema链接图:利用问题和数据库Schema信息,构建包含实体和关系的图结构。2) 演示检索:基于构建的图,计算问题和候选演示之间的相似度,选择最相关的演示样本。3) SQL生成:将检索到的演示样本与当前问题一起输入LLM,生成SQL查询。

关键创新:最重要的技术创新点在于深度上下文Schema链接图的构建。该图不仅包含问题和Schema项之间的表面信息,还通过深度学习模型学习了它们之间的语义关系。这种图结构能够更全面、准确地表示Text-to-SQL样本,从而提升演示检索的准确性。与现有方法相比,DCG-SQL不再依赖随机选择或简单的关键词匹配,而是基于语义关系进行演示检索。

关键设计:深度上下文Schema链接图的构建涉及多个关键设计。首先,使用预训练语言模型(如BERT)对问题和Schema项进行编码,得到它们的向量表示。然后,利用图神经网络(GNN)在图结构上进行信息传播,学习节点之间的关系表示。最后,设计一个相似度计算函数,用于衡量问题和候选演示之间的相关性。具体的参数设置、损失函数和网络结构等细节在论文中有详细描述。

🖼️ 关键图片

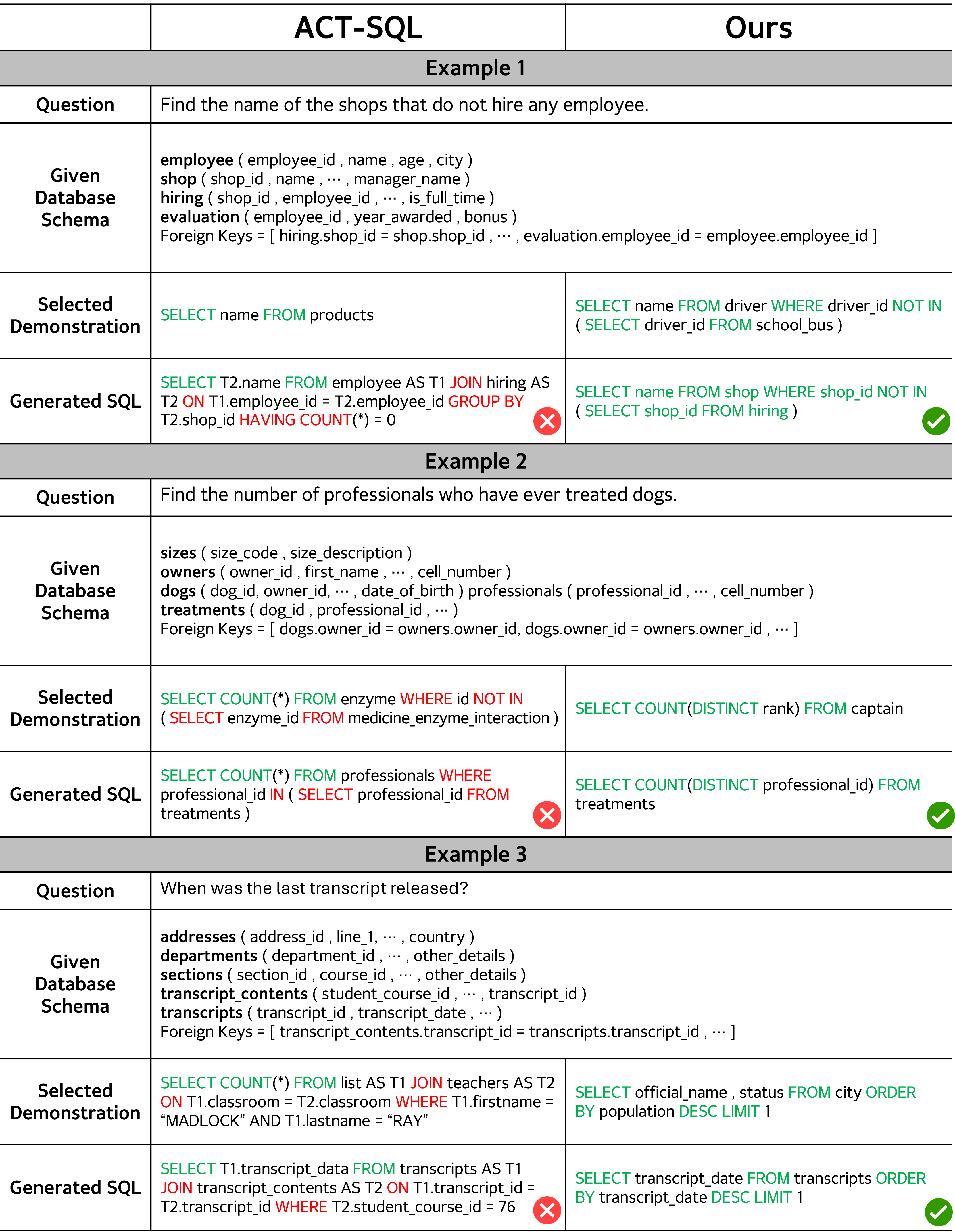

📊 实验亮点

DCG-SQL在Spider基准测试上取得了显著的性能提升。实验结果表明,DCG-SQL在不同规模的LLMs上均能持续提高SQL生成性能和效率。与现有方法相比,DCG-SQL能够更有效地检索有用的演示样本,从而提升上下文学习的效果。具体的性能数据和对比基线在论文中有详细展示。

🎯 应用场景

DCG-SQL可应用于智能数据库查询、自然语言驱动的数据分析等领域。通过将自然语言问题转化为SQL查询,用户无需掌握复杂的SQL语法即可轻松访问和分析数据库中的数据。该研究的成果有助于降低数据库的使用门槛,提高数据分析的效率,并促进数据驱动的决策。

📄 摘要(原文)

Text-to-SQL, which translates a natural language question into an SQL query, has advanced with in-context learning of Large Language Models (LLMs). However, existing methods show little improvement in performance compared to randomly chosen demonstrations, and significant performance drops when smaller LLMs (e.g., Llama 3.1-8B) are used. This indicates that these methods heavily rely on the intrinsic capabilities of hyper-scaled LLMs, rather than effectively retrieving useful demonstrations. In this paper, we propose a novel approach for effectively retrieving demonstrations and generating SQL queries. We construct a Deep Contextual Schema Link Graph, which contains key information and semantic relationship between a question and its database schema items. This graph-based structure enables effective representation of Text-to-SQL samples and retrieval of useful demonstrations for in-context learning. Experimental results on the Spider benchmark demonstrate the effectiveness of our approach, showing consistent improvements in SQL generation performance and efficiency across both hyper-scaled LLMs and small LLMs. The code is available at https://github.com/jjklle/DCG-SQL}{https://github.com/jjklle/DCG-SQL.