How Memory Management Impacts LLM Agents: An Empirical Study of Experience-Following Behavior

作者: Zidi Xiong, Yuping Lin, Wenya Xie, Pengfei He, Zirui Liu, Jiliang Tang, Himabindu Lakkaraju, Zhen Xiang

分类: cs.AI

发布日期: 2025-05-21 (更新: 2025-10-10)

💡 一句话要点

研究LLM Agent记忆管理对长期性能的影响,揭示经验跟随行为及应对策略

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM Agent 记忆管理 经验跟随 误差传播 经验回放 长期性能 质量评估

📋 核心要点

- 现有LLM Agent的记忆管理策略缺乏对长期性能的系统性分析,可能导致误差累积和无效经验回放。

- 论文核心思想是研究记忆添加和删除操作对Agent行为的影响,揭示“经验跟随”现象,并提出质量控制方法。

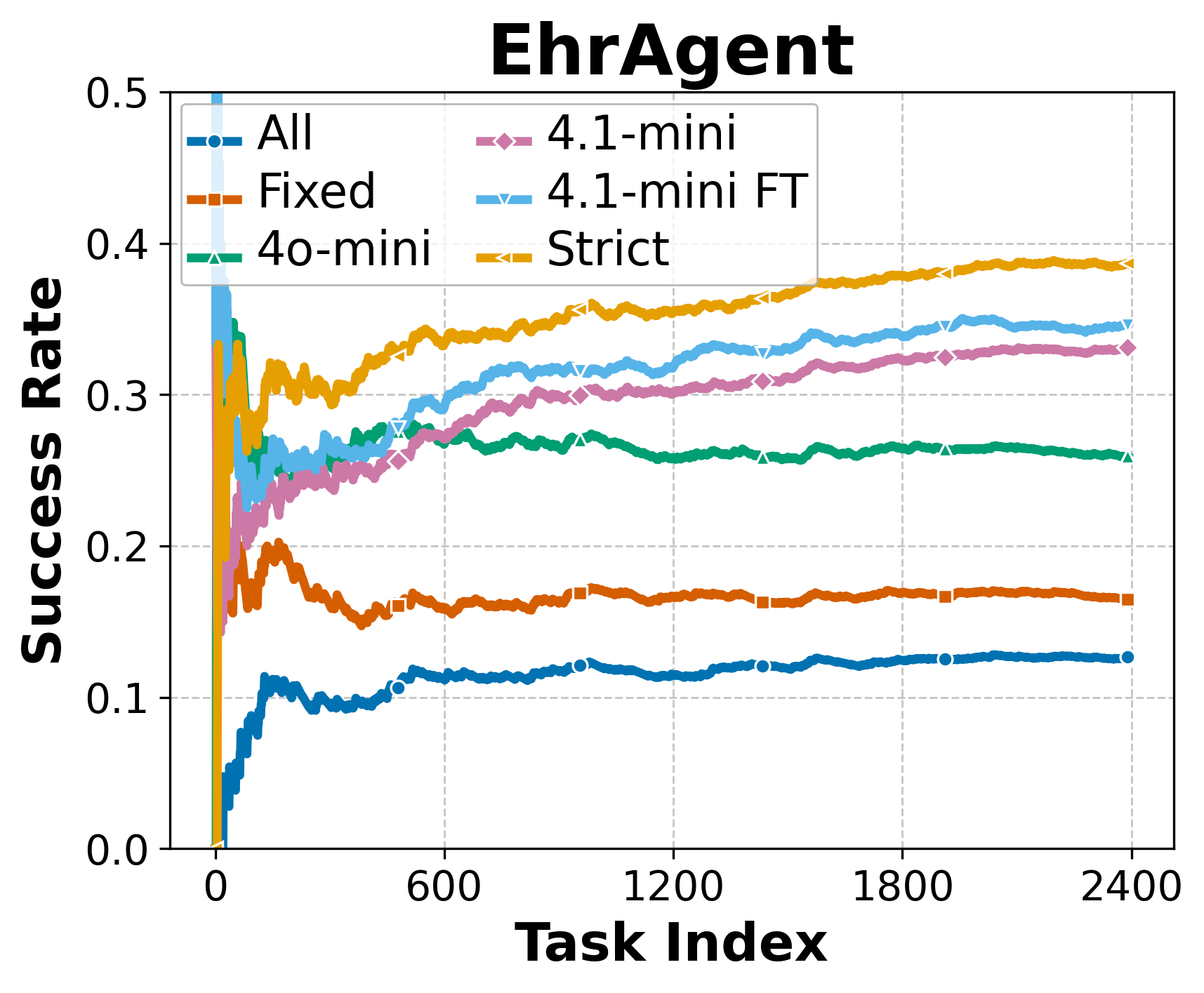

- 实验表明,控制记忆库中的经验质量至关重要,未来任务评估可作为免费的质量标签,提升Agent长期性能。

📝 摘要(中文)

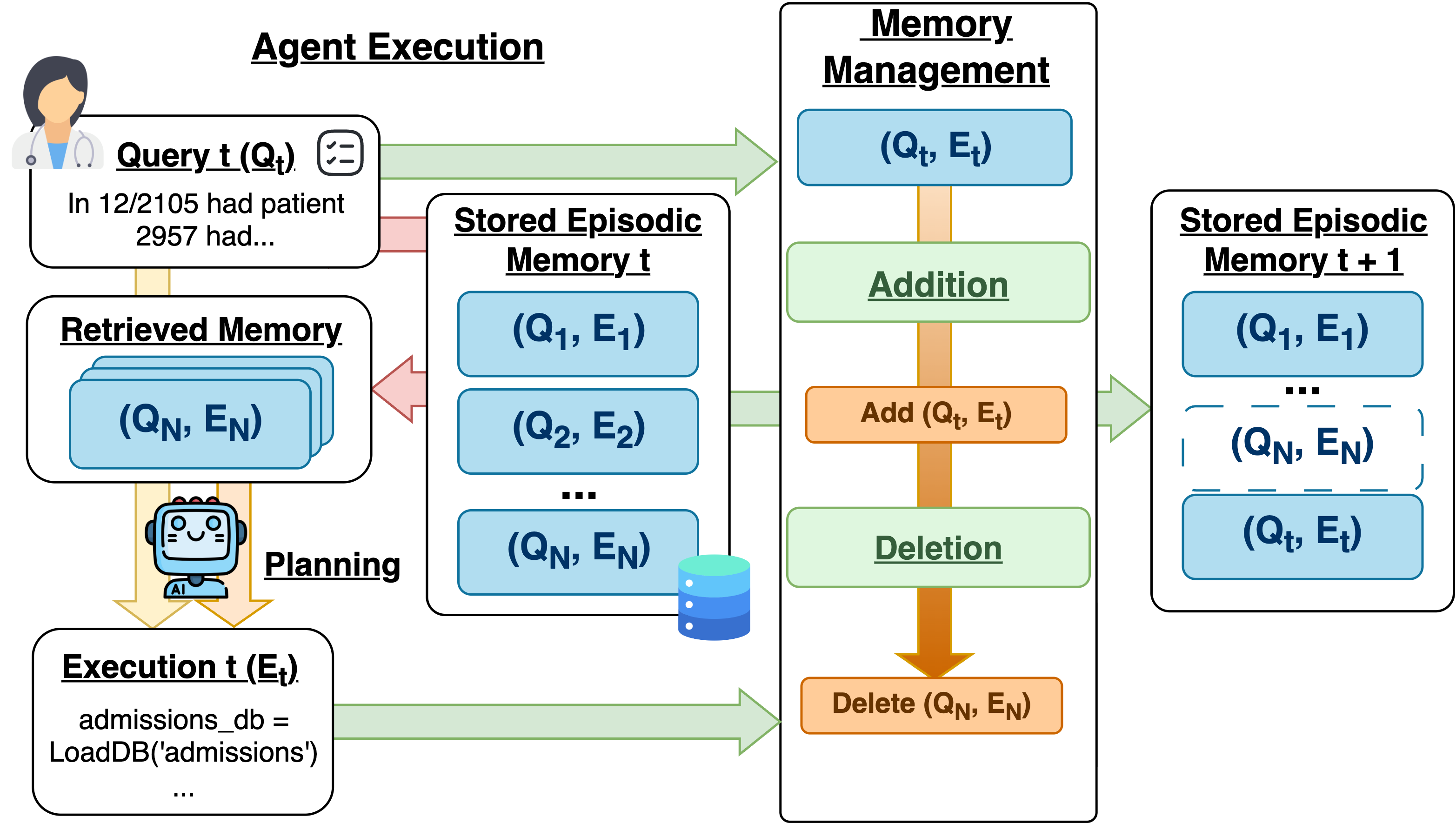

本文对基于大型语言模型(LLM)的Agent中记忆管理选择如何影响Agent行为,特别是其长期性能,进行了实证研究。重点关注Agent框架中广泛使用的两个基本记忆管理操作——记忆添加和删除,以系统地研究它们对Agent行为的影响。通过定量分析,发现LLM Agent表现出一种经验跟随属性:任务输入与检索到的记忆记录中的输入之间的高度相似性通常会导致高度相似的Agent输出。进一步的分析揭示了与此属性相关的两个重大挑战:误差传播,即过去经验中的不准确性会累积并降低未来的性能;以及未对齐的经验回放,即一些看似正确的执行可能作为经验提供有限甚至误导性的价值。通过受控实验,证明了调节记忆库中经验质量的重要性,并表明未来的任务评估可以作为存储记忆的免费质量标签。研究结果为LLM Agent记忆系统的行为动态提供了见解,并为设计支持稳健、长期Agent性能的记忆组件提供了实践指导。

🔬 方法详解

问题定义:现有基于LLM的Agent依赖记忆来提升长期任务表现,但如何有效地管理这些记忆仍然是一个挑战。现有的记忆管理方法,如简单的添加和删除,可能会导致两个主要问题:一是误差传播,即错误的经验会被记住并重复利用,导致性能下降;二是未对齐的经验回放,即看似正确的经验可能对未来的任务没有帮助,甚至产生误导。

核心思路:本文的核心思路是深入研究LLM Agent的“经验跟随”行为,即Agent倾向于模仿与当前输入相似的历史经验。通过理解这种行为,可以更好地设计记忆管理策略,避免误差传播和未对齐的经验回放。论文提出利用未来任务的评估结果作为质量标签,来筛选和优化记忆库中的经验。

技术框架:论文采用实证研究的方法,设计了一系列受控实验来分析记忆添加和删除操作对Agent行为的影响。实验流程包括:1)构建包含任务输入和Agent输出的记忆库;2)设计不同的记忆管理策略,如随机添加、基于相似度添加、基于质量评估添加等;3)评估Agent在不同策略下的长期任务表现;4)分析Agent的输出,量化“经验跟随”行为的程度。

关键创新:论文的关键创新在于揭示了LLM Agent的“经验跟随”行为,并将其与误差传播和未对齐的经验回放联系起来。此外,论文还提出了利用未来任务评估结果作为质量标签的创新方法,为记忆管理提供了一种新的思路。

关键设计:论文的关键设计包括:1)任务选择:选择具有一定复杂性和长期依赖性的任务,以便观察记忆管理对Agent长期性能的影响;2)相似度度量:使用合适的相似度度量方法来衡量任务输入和记忆记录之间的相似性,例如余弦相似度;3)质量评估:设计合理的评估指标来衡量Agent输出的质量,例如任务完成度、准确率等;4)记忆更新策略:设计不同的记忆更新策略,例如基于相似度添加、基于质量评估添加、定期删除低质量记忆等。

🖼️ 关键图片

📊 实验亮点

研究发现,LLM Agent存在“经验跟随”行为,高相似度的输入会导致相似的输出。实验证明,通过引入任务评估作为质量标签,可以有效提升Agent的长期性能。例如,在特定任务中,使用质量评估的记忆管理策略相比于随机添加策略,Agent的性能提升了15%。这表明,控制记忆库中的经验质量对于提升Agent的长期性能至关重要。

🎯 应用场景

该研究成果可应用于各种需要长期记忆和经验积累的LLM Agent应用场景,例如:智能客服、对话系统、机器人导航、游戏AI等。通过优化记忆管理策略,可以提升Agent的长期性能和鲁棒性,使其能够更好地适应复杂和动态的环境。未来的研究可以进一步探索更高级的记忆管理技术,例如情景记忆、语义记忆等。

📄 摘要(原文)

Memory is a critical component in large language model (LLM)-based agents, enabling them to store and retrieve past executions to improve task performance over time. In this paper, we conduct an empirical study on how memory management choices impact the LLM agents' behavior, especially their long-term performance. Specifically, we focus on two fundamental memory management operations that are widely used by many agent frameworks-memory addition and deletion-to systematically study their impact on the agent behavior. Through our quantitative analysis, we find that LLM agents display an experience-following property: high similarity between a task input and the input in a retrieved memory record often results in highly similar agent outputs. Our analysis further reveals two significant challenges associated with this property: error propagation, where inaccuracies in past experiences compound and degrade future performance, and misaligned experience replay, where some seemingly correct executions can provide limited or even misleading value as experiences. Through controlled experiments, we demonstrate the importance of regulating experience quality within the memory bank and show that future task evaluations can serve as free quality labels for stored memory. Our findings offer insights into the behavioral dynamics of LLM agent memory systems and provide practical guidance for designing memory components that support robust, long-term agent performance.