Towards a Foundation Model for Communication Systems

作者: Davide Buffelli, Sowmen Das, Yu-Wei Lin, Sattar Vakili, Chien-Yi Wang, Masoud Attarifar, Pritthijit Nath, Da-shan Shiu

分类: cs.AI, cs.LG, eess.SP

发布日期: 2025-05-20

💡 一句话要点

提出面向通信系统的Transformer基础模型,实现多特征估计。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 通信系统 基础模型 Transformer 多模态学习 特征估计

📋 核心要点

- 当前通信系统中的AI应用侧重于特定任务,缺乏通用性和泛化能力。

- 论文提出一种基于Transformer的多模态模型,直接处理通信数据,旨在构建通信领域的基础模型。

- 实验结果表明,该模型能够有效估计传输秩、预编码器、多普勒扩展和时延扩展等多种通信特征。

📝 摘要(中文)

人工智能(AI)在各个领域都展现了前所未有的性能,将其应用于通信系统是一个活跃的研究领域。虽然目前的方法侧重于特定任务的解决方案,但人工智能领域更广泛的趋势是转向能够支持多种应用的大型通用模型。本文旨在朝着通信数据的基础模型迈出一步——一个基于Transformer的多模态模型,设计用于直接处理通信数据。我们提出了解决关键挑战的方法,包括分词、位置嵌入、多模态、可变特征大小和归一化。此外,我们通过实验证明,该模型可以成功估计多个特征,包括传输秩、选定的预编码器、多普勒扩展和时延扩展。

🔬 方法详解

问题定义:现有通信系统中的AI方法通常针对特定任务设计,例如信道估计、信号检测等,缺乏通用性。针对不同任务需要训练不同的模型,效率较低,且难以利用跨任务的知识。因此,需要一种能够处理多种通信任务的通用模型,即通信领域的基础模型。

核心思路:论文的核心思路是借鉴自然语言处理(NLP)领域中Transformer模型的成功经验,构建一个基于Transformer的多模态模型,直接处理通信数据。通过学习大量通信数据,使模型能够提取通用的通信特征,并应用于多种通信任务。

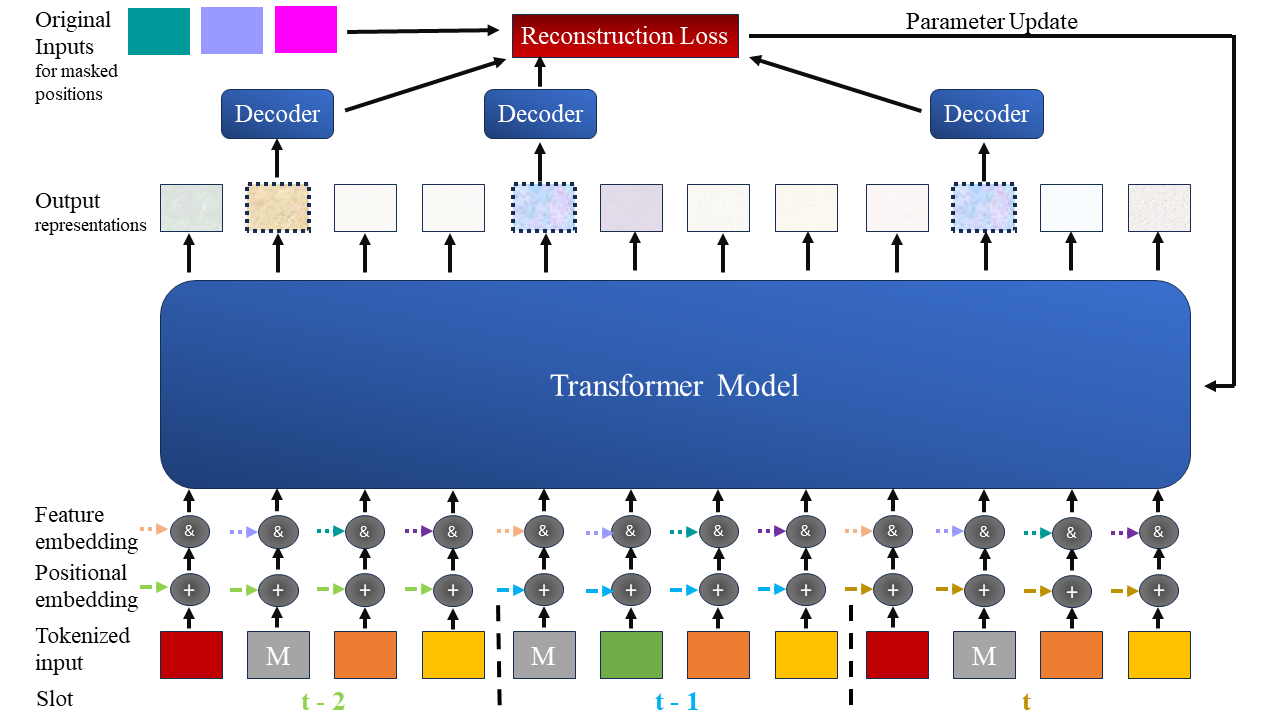

技术框架:该模型采用Transformer架构,并针对通信数据的特点进行了改进。整体框架包括以下几个主要模块:1) 数据预处理:对原始通信数据进行清洗、归一化等处理。2) 分词(Tokenization):将连续的通信数据转换为离散的token序列。3) 位置嵌入(Positional Embedding):为token序列添加位置信息。4) 多模态融合:处理来自不同模态(例如,时域、频域)的通信数据。5) Transformer编码器:提取通信数据的特征。6) 特征估计:根据提取的特征,估计所需的通信参数(例如,传输秩、预编码器)。

关键创新:该论文的关键创新在于:1) 提出了一种面向通信系统的基础模型,这是通信领域的一个新方向。2) 针对通信数据的特点,设计了专门的分词、位置嵌入和多模态融合方法。3) 验证了Transformer模型在通信领域的有效性,为未来的研究提供了新的思路。

关键设计:论文中涉及的关键设计包括:1) 分词方法:如何将连续的通信数据转换为离散的token序列,需要考虑通信信号的特性。2) 位置嵌入:如何有效地编码通信信号的位置信息,以便Transformer模型能够学习到时序关系。3) 多模态融合:如何将来自不同模态的通信数据进行融合,以便模型能够提取更全面的特征。4) 损失函数:选择合适的损失函数,以优化模型的性能。

🖼️ 关键图片

📊 实验亮点

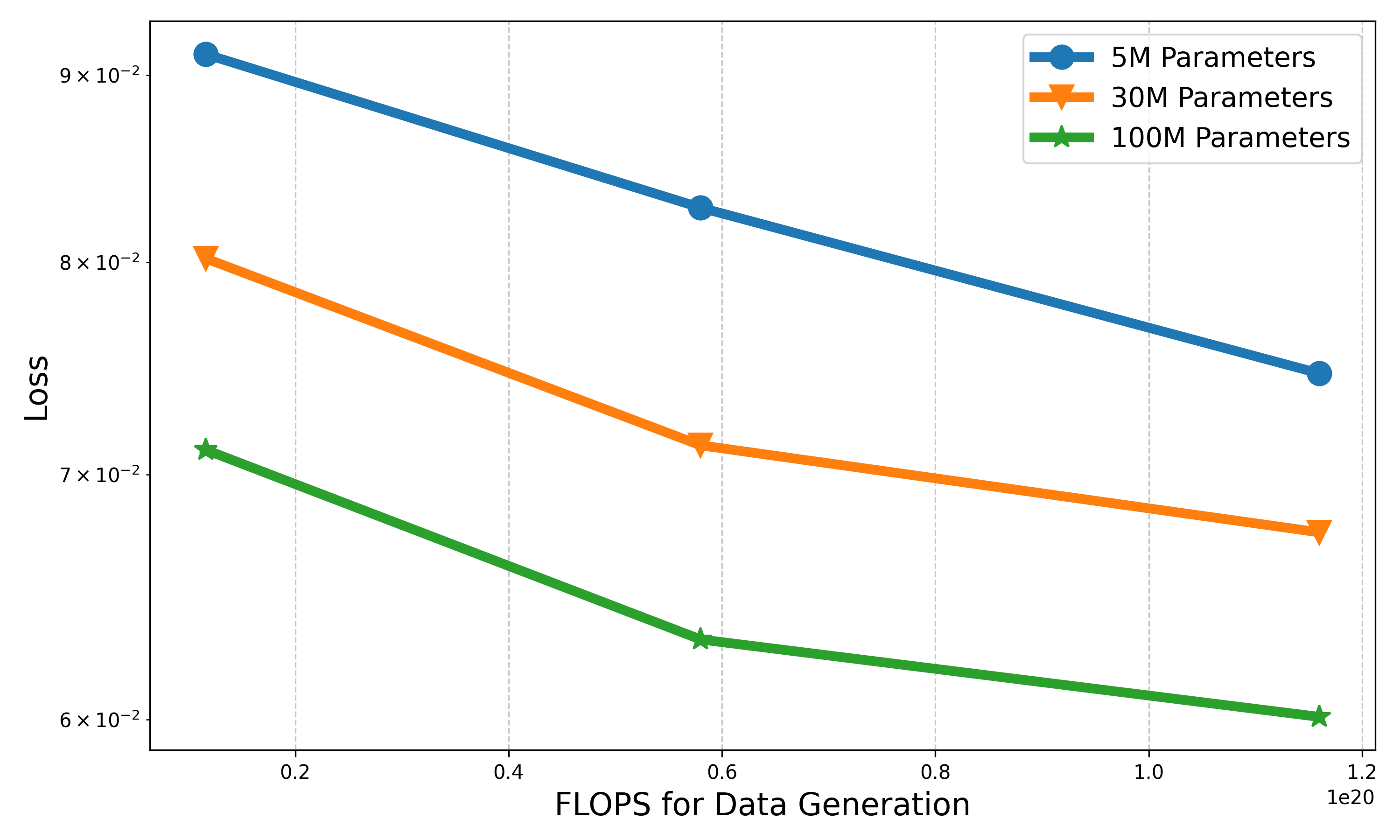

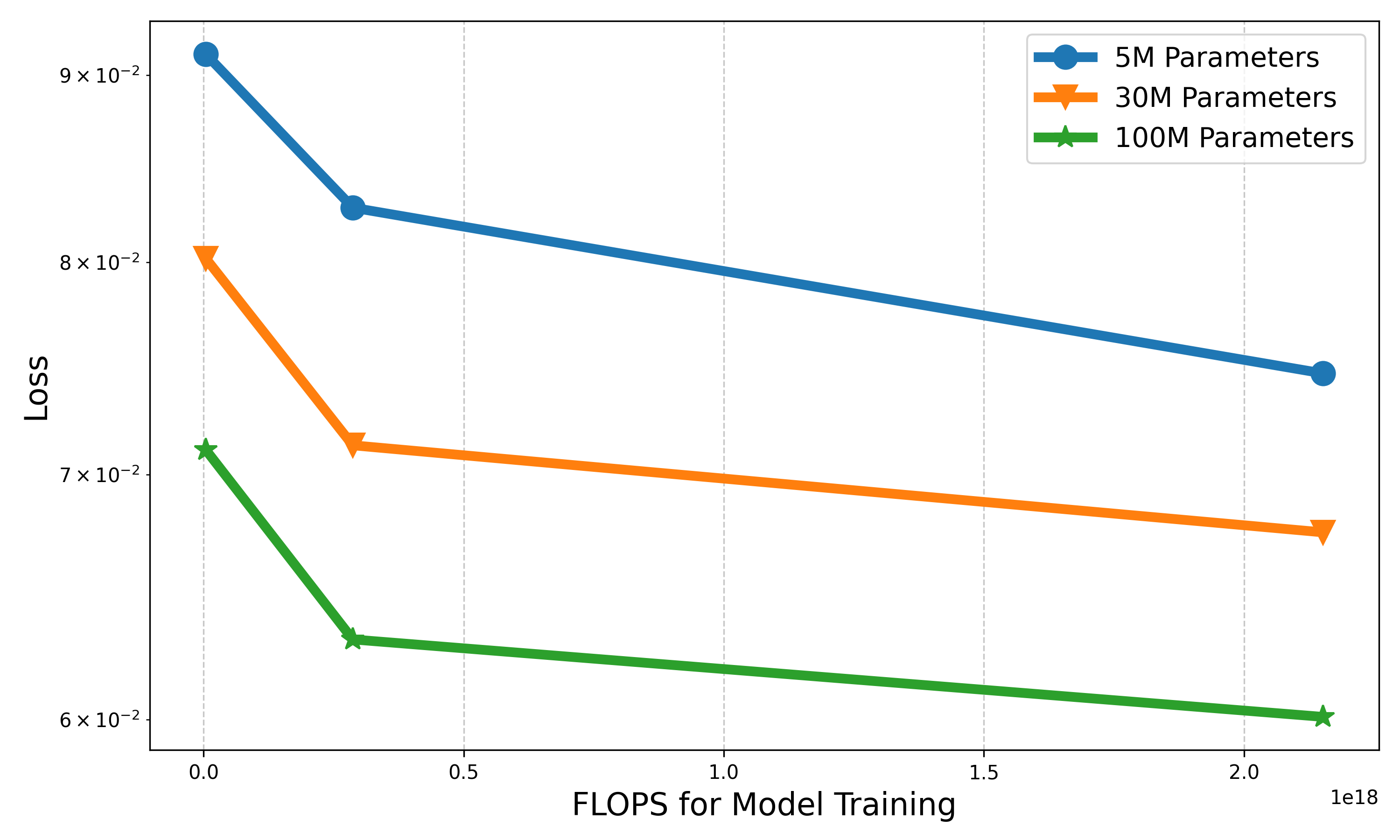

实验结果表明,该模型能够成功估计多个通信特征,包括传输秩、选定的预编码器、多普勒扩展和时延扩展。这些结果验证了Transformer模型在通信领域的有效性,并为构建通用的通信基础模型奠定了基础。具体的性能数据和对比基线在论文中进行了详细描述,但摘要中未提供具体数值。

🎯 应用场景

该研究成果可应用于多种通信场景,例如无线通信、光通信、卫星通信等。通过构建通用的通信基础模型,可以降低开发成本,提高系统性能,并促进通信技术的智能化发展。未来,该模型有望应用于智能资源分配、自适应调制编码、网络优化等领域,提升通信系统的效率和可靠性。

📄 摘要(原文)

Artificial Intelligence (AI) has demonstrated unprecedented performance across various domains, and its application to communication systems is an active area of research. While current methods focus on task-specific solutions, the broader trend in AI is shifting toward large general models capable of supporting multiple applications. In this work, we take a step toward a foundation model for communication data--a transformer-based, multi-modal model designed to operate directly on communication data. We propose methodologies to address key challenges, including tokenization, positional embedding, multimodality, variable feature sizes, and normalization. Furthermore, we empirically demonstrate that such a model can successfully estimate multiple features, including transmission rank, selected precoder, Doppler spread, and delay profile.