Towards Reliable Proof Generation with LLMs: A Neuro-Symbolic Approach

作者: Oren Sultan, Eitan Stern, Dafna Shahaf

分类: cs.AI, cs.CL

发布日期: 2025-05-20 (更新: 2025-12-13)

备注: long paper

💡 一句话要点

提出神经符号方法,提升LLM在几何证明生成中的可靠性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 神经符号推理 大型语言模型 几何证明 形式化验证 逻辑推理

📋 核心要点

- 现有LLM在需要严谨逻辑推理的数学证明等领域表现不足,缺乏可靠性。

- 该论文提出一种神经符号方法,结合LLM的生成能力与形式化验证,提升证明的正确性。

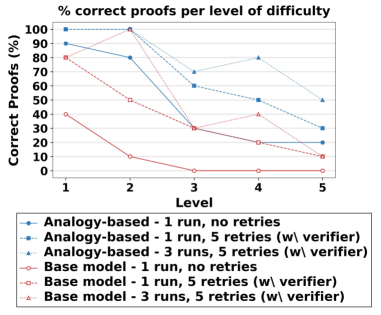

- 实验结果表明,该方法能显著提升LLM在几何证明问题上的准确率,提升幅度达58%-70%。

📝 摘要(中文)

大型语言模型(LLM)在需要严格逻辑推理和符号运算的正式领域,如数学证明生成方面表现不佳。本文提出了一种神经符号方法,结合LLM的生成能力和结构化组件来克服这一挑战。以几何问题为例,该方法包含两个方面:(1)检索相似问题,并利用其证明来指导LLM;(2)使用形式化验证器评估生成的证明并提供反馈,帮助模型修正错误证明。实验表明,该方法显著提高了OpenAI的o1模型的证明准确率(提升58%-70%);相似问题和验证器的反馈均对此有所贡献。更广泛地说,转向生成可证明正确结论的LLM可以显著提高其可靠性、准确性和一致性,从而解锁需要可信度的复杂任务和关键的实际应用。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在几何证明生成任务中表现不佳的问题。现有方法,即直接使用LLM生成证明,缺乏严谨的逻辑推理能力,容易产生错误结论,导致证明的可靠性不足。LLM难以处理需要精确符号操作和复杂逻辑链条的数学问题。

核心思路:论文的核心思路是将LLM的生成能力与符号推理的严谨性相结合,构建一个神经符号系统。具体而言,利用LLM生成证明草案,然后通过形式化验证器进行验证和纠错,并借鉴相似问题的证明过程来指导LLM的生成,从而提高证明的正确性和可靠性。

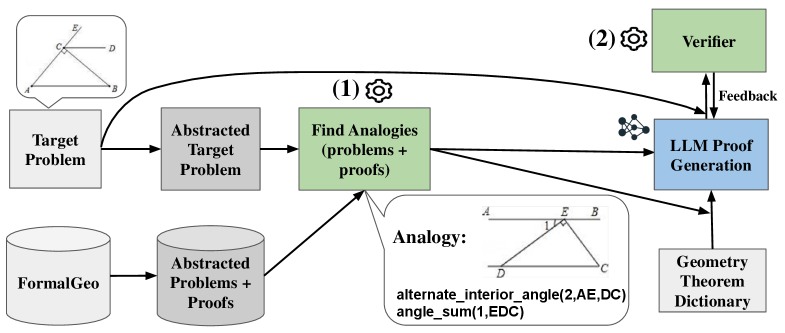

技术框架:整体框架包含三个主要模块:(1) 相似问题检索模块:从题库中检索与当前问题相似的例题及其证明;(2) LLM证明生成模块:利用检索到的相似问题及其证明,指导LLM生成当前问题的证明草案;(3) 形式化验证模块:使用形式化验证器对LLM生成的证明进行验证,并提供反馈信息,指导LLM修正错误。整个流程迭代进行,直到生成一个通过验证的正确证明。

关键创新:该方法最重要的创新点在于将神经方法(LLM)与符号方法(形式化验证)相结合,形成一个闭环反馈系统。通过形式化验证器对LLM生成的证明进行严格验证,并利用验证结果指导LLM进行修正,从而显著提高证明的正确性和可靠性。此外,借鉴相似问题的证明过程,可以有效引导LLM进行推理,减少搜索空间。

关键设计:在相似问题检索模块中,可以使用基于文本相似度的检索方法,例如TF-IDF或BERT等。在LLM证明生成模块中,可以使用Prompt Engineering技术,将相似问题的证明作为Prompt输入给LLM。在形式化验证模块中,需要设计合适的验证规则和算法,例如基于几何定理的推理规则。具体参数设置和损失函数取决于所使用的LLM和验证器的具体实现。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法显著提高了OpenAI的o1模型在几何证明生成任务中的准确率,提升幅度达到58%-70%。与直接使用LLM生成证明相比,该方法能够生成更可靠、更准确的证明。相似问题检索和形式化验证反馈均对性能提升有所贡献,表明了神经符号方法在解决复杂推理问题方面的潜力。

🎯 应用场景

该研究成果可应用于自动化定理证明、智能教育、程序验证等领域。通过提高LLM在逻辑推理方面的能力,可以使其在需要高度可靠性的任务中发挥更大的作用,例如金融风险评估、医疗诊断等。未来,该方法有望扩展到更广泛的符号推理领域,推动人工智能技术的发展。

📄 摘要(原文)

Large language models (LLMs) struggle with formal domains that require rigorous logical deduction and symbolic reasoning, such as mathematical proof generation. We propose a neuro-symbolic approach that combines LLMs' generative strengths with structured components to overcome this challenge. As a proof-of-concept, we focus on geometry problems. Our approach is two-fold: (1) we retrieve analogous problems and use their proofs to guide the LLM, and (2) a formal verifier evaluates the generated proofs and provides feedback, helping the model fix incorrect proofs. We demonstrate that our method significantly improves proof accuracy for OpenAI's o1 model (58%-70% improvement); both analogous problems and the verifier's feedback contribute to these gains. More broadly, shifting to LLMs that generate provably correct conclusions could dramatically improve their reliability, accuracy and consistency, unlocking complex tasks and critical real-world applications that require trustworthiness.