Contrastive Cross-Course Knowledge Tracing via Concept Graph Guided Knowledge Transfer

作者: Wenkang Han, Wang Lin, Liya Hu, Zhenlong Dai, Yiyun Zhou, Mengze Li, Zemin Liu, Chang Yao, Jingyuan Chen

分类: cs.AI, cs.CL

发布日期: 2025-05-14

备注: Accepted by IJCAI 2025

💡 一句话要点

TransKT:利用概念图引导知识迁移的对比跨课程知识追踪

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识追踪 跨课程学习 概念图 知识迁移 对比学习

📋 核心要点

- 现有知识追踪模型主要依赖单一课程数据,无法全面理解学习者的知识状态。

- TransKT利用概念图引导知识迁移,建模跨课程学习行为关系,增强知识状态估计。

- TransKT通过LLM提示构建概念图,并采用对比学习目标,提升知识追踪性能。

📝 摘要(中文)

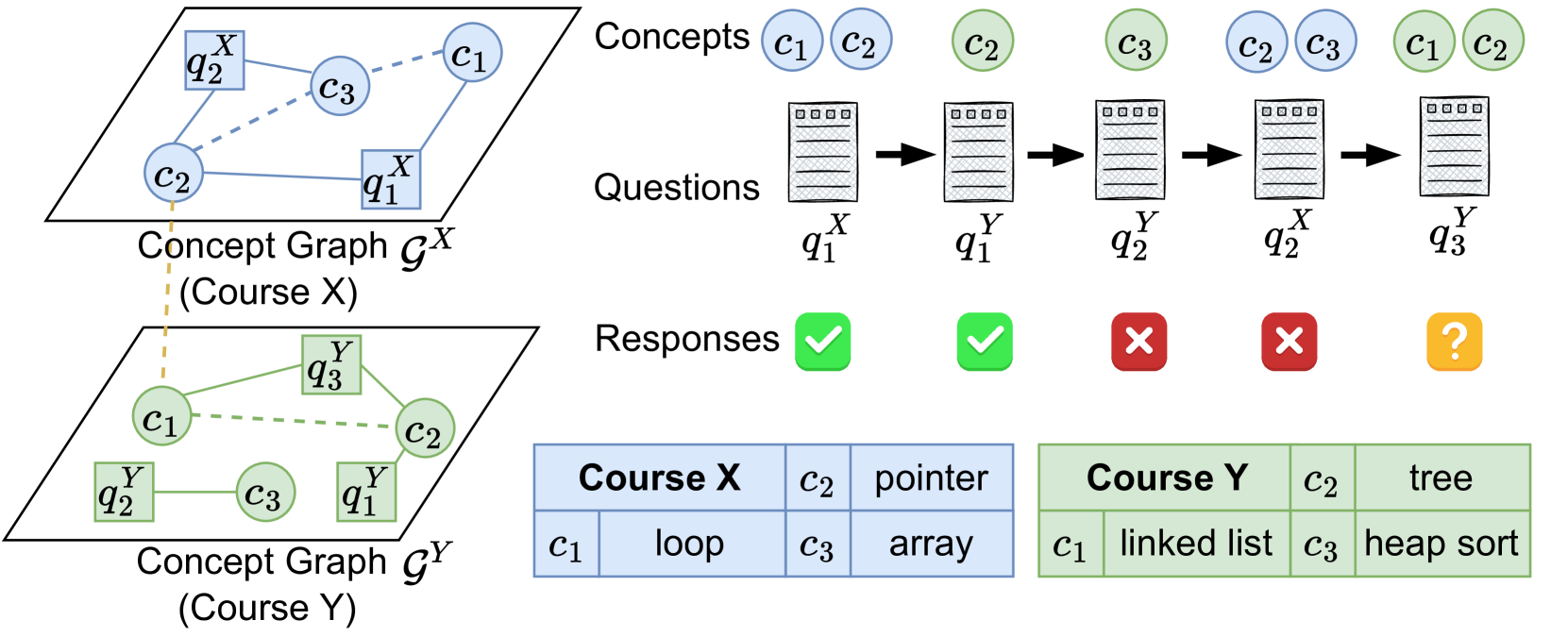

知识追踪(KT)旨在根据学习者的历史学习交互预测其未来表现。然而,现有的KT模型主要关注来自单一课程的数据,限制了它们对学习者知识状态的全面理解。本文提出TransKT,一种对比跨课程知识追踪方法,它利用概念图引导的知识迁移来建模不同课程之间的学习行为关系,从而增强知识状态估计。具体来说,TransKT通过利用零样本大型语言模型(LLM)提示来构建跨课程概念图,以建立不同课程之间相关概念的隐式链接。该图作为知识迁移的基础,使模型能够整合和增强跨课程的学习者交互的语义特征。此外,TransKT包含一个LLM-to-LM管道,用于整合总结的语义特征,这显著提高了用于知识迁移的图卷积网络(GCN)的性能。此外,TransKT采用对比目标,对齐单课程和跨课程知识状态,从而提高模型提供更鲁棒和准确的学习者整体知识状态表示的能力。

🔬 方法详解

问题定义:现有的知识追踪模型通常只关注单个课程的数据,忽略了不同课程之间知识点的关联性。这导致模型无法充分利用跨课程的学习行为来更准确地评估学习者的知识状态,从而影响预测的准确性。现有方法难以有效整合不同课程间的知识,缺乏对知识迁移的有效建模。

核心思路:TransKT的核心思路是构建一个跨课程的概念图,利用该图来指导知识在不同课程之间的迁移。通过连接不同课程中相关的概念,模型可以更好地理解学习者在不同课程中的学习行为之间的关系,从而更准确地估计其知识状态。此外,采用对比学习,对齐单课程和跨课程的知识状态,进一步提升模型的鲁棒性。

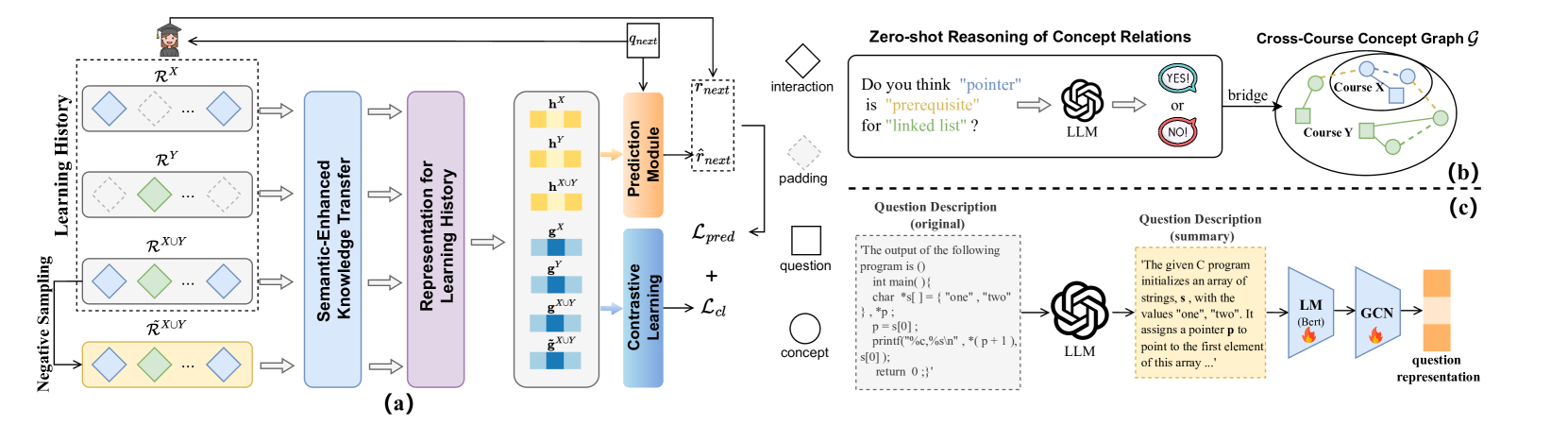

技术框架:TransKT的整体框架包括以下几个主要模块:1) 跨课程概念图构建:利用零样本LLM提示来建立不同课程之间相关概念的隐式链接,构建跨课程概念图。2) 知识迁移模块:基于构建的跨课程概念图,整合和增强跨课程的学习者交互的语义特征。3) LLM-to-LM管道:利用LLM总结语义特征,并将其融入到知识迁移过程中,提升GCN的性能。4) 对比学习模块:采用对比目标,对齐单课程和跨课程知识状态。

关键创新:TransKT的关键创新在于:1) 跨课程概念图引导的知识迁移:通过构建跨课程概念图,实现了不同课程之间知识的有效迁移,突破了传统知识追踪模型只能处理单课程数据的局限性。2) LLM-to-LM管道:利用LLM的强大语义理解能力,提升了知识迁移的性能。3) 对比学习目标:通过对齐单课程和跨课程知识状态,提高了模型的鲁棒性和准确性。

关键设计:TransKT的关键设计包括:1) 使用零样本LLM提示来构建跨课程概念图,具体的提示工程细节未知。2) 使用图卷积网络(GCN)进行知识迁移,具体的GCN结构和参数设置未知。3) 设计对比损失函数,用于对齐单课程和跨课程知识状态,损失函数的具体形式未知。

🖼️ 关键图片

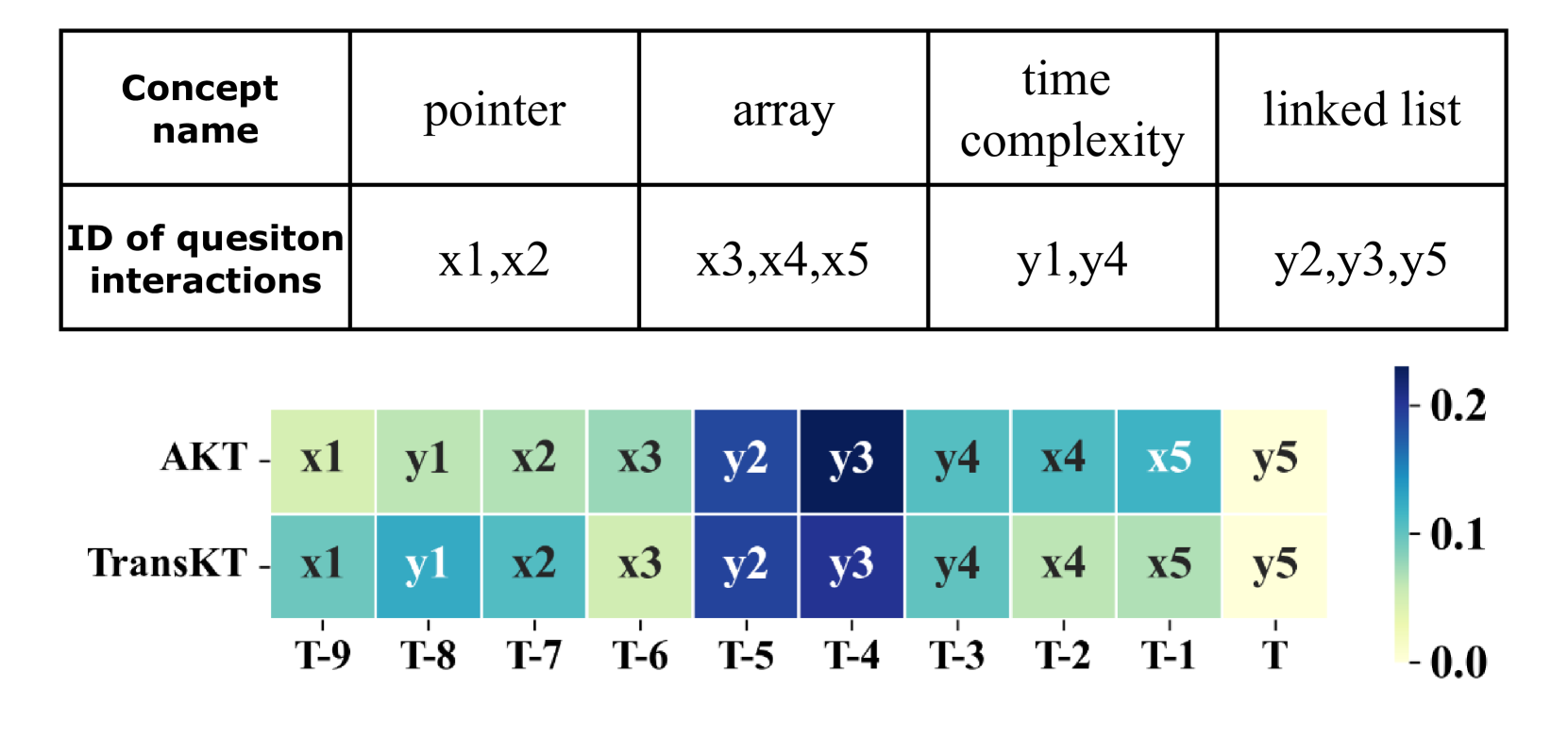

📊 实验亮点

论文提出了TransKT模型,通过跨课程概念图引导知识迁移,提升了知识追踪的准确性。具体性能提升数据未知,但通过LLM-to-LM管道和对比学习,TransKT在知识追踪任务上取得了显著的性能提升,优于传统的单课程知识追踪模型。具体的对比基线和提升幅度需要在论文中进一步查找。

🎯 应用场景

TransKT可应用于在线教育平台,为学习者提供个性化的学习路径推荐和知识诊断。通过整合不同课程的学习数据,更准确地评估学习者的知识掌握情况,从而提供更有效的学习辅导。该研究有助于提升在线教育的智能化水平,提高学习效率和学习体验。

📄 摘要(原文)

Knowledge tracing (KT) aims to predict learners' future performance based on historical learning interactions. However, existing KT models predominantly focus on data from a single course, limiting their ability to capture a comprehensive understanding of learners' knowledge states. In this paper, we propose TransKT, a contrastive cross-course knowledge tracing method that leverages concept graph guided knowledge transfer to model the relationships between learning behaviors across different courses, thereby enhancing knowledge state estimation. Specifically, TransKT constructs a cross-course concept graph by leveraging zero-shot Large Language Model (LLM) prompts to establish implicit links between related concepts across different courses. This graph serves as the foundation for knowledge transfer, enabling the model to integrate and enhance the semantic features of learners' interactions across courses. Furthermore, TransKT includes an LLM-to-LM pipeline for incorporating summarized semantic features, which significantly improves the performance of Graph Convolutional Networks (GCNs) used for knowledge transfer. Additionally, TransKT employs a contrastive objective that aligns single-course and cross-course knowledge states, thereby refining the model's ability to provide a more robust and accurate representation of learners' overall knowledge states.