Beyond the Known: Decision Making with Counterfactual Reasoning Decision Transformer

作者: Minh Hoang Nguyen, Linh Le Pham Van, Thommen George Karimpanal, Sunil Gupta, Hung Le

分类: cs.AI, cs.LG

发布日期: 2025-05-14

💡 一句话要点

提出CRDT,利用反事实推理增强Decision Transformer在有限数据下的决策能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 反事实推理 Decision Transformer 离线强化学习 数据增强 强化学习

📋 核心要点

- Decision Transformer依赖高质量离线数据,但在数据匮乏或次优数据主导的现实场景中表现受限。

- CRDT通过反事实推理生成虚拟经验,扩展DT的决策空间,使其能够更好地应对未知的环境和状态。

- 实验证明,CRDT在Atari和D4RL数据集上超越了传统DT,尤其在数据有限和环境动态变化的情况下。

📝 摘要(中文)

Decision Transformer (DT) 在现代强化学习中发挥着关键作用,它利用离线数据集在各个领域取得了显著成果。然而,DT需要高质量、全面的数据才能达到最佳性能。在实际应用中,缺乏训练数据和最优行为的稀缺性使得离线数据集上的训练充满挑战,因为次优数据会阻碍性能。为了解决这个问题,我们提出了反事实推理Decision Transformer (CRDT),这是一个受到反事实推理启发的全新框架。CRDT通过生成和利用反事实经验来增强DT在已知数据之外进行推理的能力,从而在未见过的场景中改进决策。在包括有限数据和改变动态的Atari和D4RL基准测试中的实验表明,CRDT优于传统的DT方法。此外,反事实推理使DT智能体能够获得拼接能力,组合次优轨迹,而无需修改架构。这些结果突出了反事实推理在增强强化学习智能体的性能和泛化能力方面的潜力。

🔬 方法详解

问题定义:论文旨在解决Decision Transformer (DT) 在离线强化学习中对高质量数据的高度依赖问题。在实际应用中,离线数据集往往包含大量次优数据,甚至缺乏某些关键状态的经验,这严重限制了DT的性能和泛化能力。现有方法难以有效利用这些不完整或质量不佳的数据进行训练。

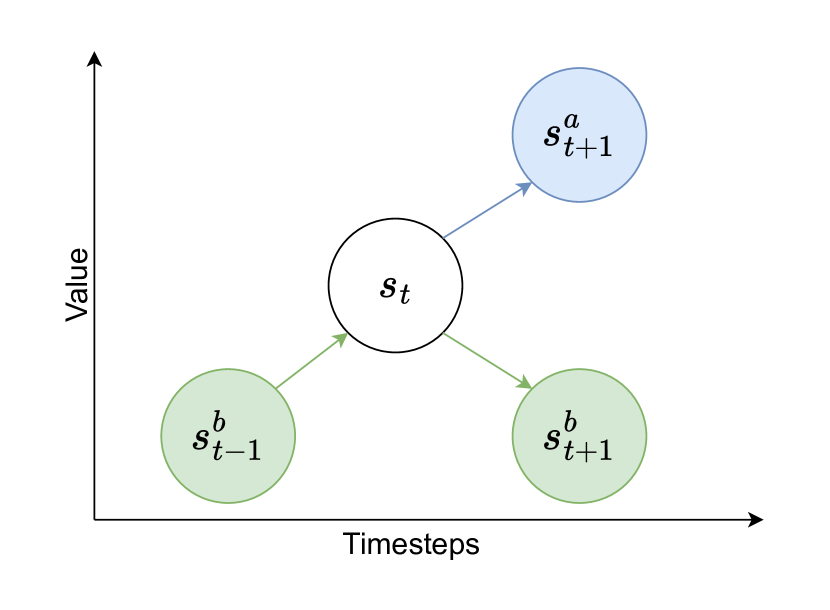

核心思路:论文的核心思路是引入反事实推理,通过生成假设性的“如果...会怎样”的经验,来扩充原始数据集,弥补数据中的不足。CRDT通过学习一个反事实模型,预测在不同决策下的可能结果,从而模拟出新的、未曾经历过的状态转移过程。这样,即使原始数据集中缺乏某些状态的经验,CRDT也能通过反事实推理来“想象”这些状态,并进行学习。

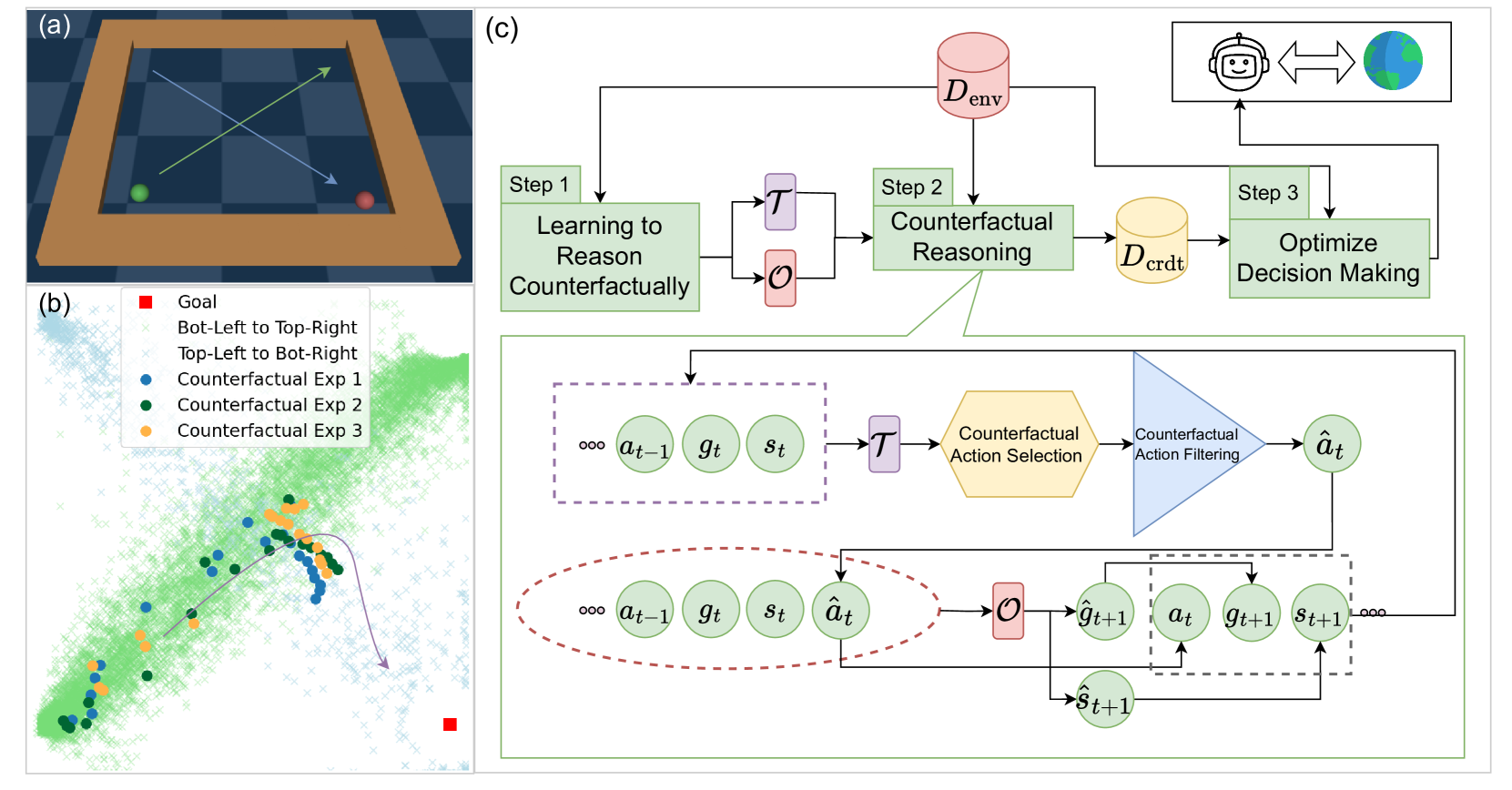

技术框架:CRDT的整体框架包括以下几个主要模块:1) 原始数据集:包含已有的离线经验数据。2) Decision Transformer (DT):作为基础的决策模型,负责根据状态和目标进行动作选择。3) 反事实模型:学习状态转移函数,预测在给定状态和动作下的下一个状态。4) 反事实经验生成器:利用反事实模型生成新的经验数据,扩充原始数据集。5) 训练过程:DT和反事实模型交替训练,DT利用原始数据和反事实数据进行学习,反事实模型则根据DT的决策结果进行更新。

关键创新:CRDT最关键的创新在于将反事实推理引入到Decision Transformer中。与传统的DT方法相比,CRDT不再仅仅依赖于原始数据集中的经验,而是能够通过反事实推理来生成新的经验,从而扩展了DT的决策空间,提高了其在未知环境中的适应能力。此外,CRDT还能够利用次优轨迹进行学习,通过反事实推理来“拼接”不同的轨迹,从而获得更好的策略。

关键设计:CRDT的关键设计包括:1) 反事实模型的选择:可以使用各种模型,如神经网络或高斯过程,来学习状态转移函数。2) 反事实经验的生成策略:可以采用不同的策略来生成反事实经验,如随机采样或基于策略的采样。3) 损失函数的设计:需要设计合适的损失函数来训练DT和反事实模型,例如,可以使用行为克隆损失来训练DT,使用均方误差损失来训练反事实模型。4) 超参数的调整:需要仔细调整超参数,如学习率、批量大小等,以获得最佳的性能。

🖼️ 关键图片

📊 实验亮点

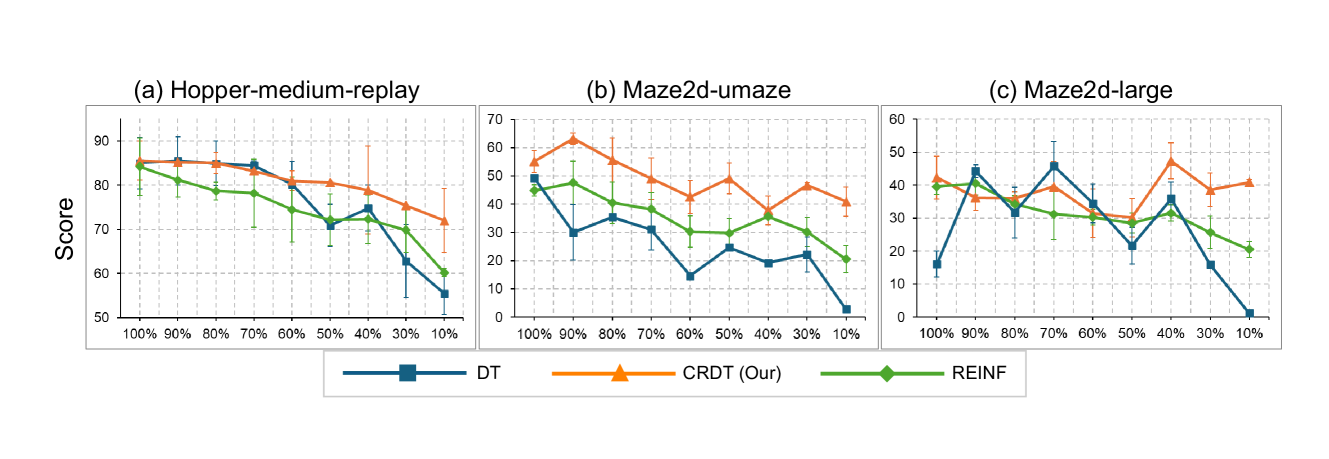

实验结果表明,CRDT在Atari和D4RL基准测试中显著优于传统的DT方法。在有限数据的情况下,CRDT的性能提升尤为明显。例如,在某些Atari游戏中,CRDT的得分比DT高出50%以上。此外,CRDT还展现出了强大的拼接能力,能够将次优轨迹组合成更优的策略,而无需修改DT的架构。

🎯 应用场景

CRDT具有广泛的应用前景,尤其是在数据稀缺或质量不高的强化学习场景中。例如,在机器人控制领域,可以利用CRDT来训练机器人完成复杂的任务,即使只有少量的人工演示数据。在医疗诊断领域,可以利用CRDT来辅助医生进行决策,即使只有有限的病例数据。此外,CRDT还可以应用于自动驾驶、金融交易等领域,提高智能体的决策能力和泛化能力。

📄 摘要(原文)

Decision Transformers (DT) play a crucial role in modern reinforcement learning, leveraging offline datasets to achieve impressive results across various domains. However, DT requires high-quality, comprehensive data to perform optimally. In real-world applications, the lack of training data and the scarcity of optimal behaviours make training on offline datasets challenging, as suboptimal data can hinder performance. To address this, we propose the Counterfactual Reasoning Decision Transformer (CRDT), a novel framework inspired by counterfactual reasoning. CRDT enhances DT ability to reason beyond known data by generating and utilizing counterfactual experiences, enabling improved decision-making in unseen scenarios. Experiments across Atari and D4RL benchmarks, including scenarios with limited data and altered dynamics, demonstrate that CRDT outperforms conventional DT approaches. Additionally, reasoning counterfactually allows the DT agent to obtain stitching abilities, combining suboptimal trajectories, without architectural modifications. These results highlight the potential of counterfactual reasoning to enhance reinforcement learning agents' performance and generalization capabilities.