Variational Prefix Tuning for Diverse and Accurate Code Summarization Using Pre-trained Language Models

作者: Junda Zhao, Yuliang Song, Eldan Cohen

分类: cs.SE, cs.AI, cs.LG

发布日期: 2025-05-14

备注: Accepted by the Journal of Systems and Software

DOI: 10.1016/j.jss.2025.112493

💡 一句话要点

提出变分前缀调整(VPT)方法,利用预训练语言模型生成多样且准确的代码摘要。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 代码摘要 预训练语言模型 变分前缀调整 条件变分自编码器 代码生成 多样性生成 参数高效性

📋 核心要点

- 现有代码摘要生成方法侧重于生成单个高质量摘要,忽略了摘要可能不充分且需要多种选择的情况。

- 论文提出变分前缀调整(VPT)方法,通过条件变分自编码器(CVAE)生成多样化的前缀嵌入,引导模型生成不同的摘要。

- 实验表明,VPT方法能够生成多样且准确的代码摘要,并且具有良好的模型适应性,无需昂贵的模型重新训练。

📝 摘要(中文)

近年来,基于Transformer的预训练模型,包括代码大语言模型(LLMCs),在源代码摘要生成方面取得了显著进展,能够自动生成高质量的代码摘要。然而,现有方法通常侧重于为给定的源代码生成单个高质量摘要,忽略了生成的摘要可能不充分且需要替代方案的情况。本文提出了一种新的方法——变分前缀调整(VPT),它增强了预训练模型生成多样且准确的摘要集合的能力,允许用户为给定的源代码选择最合适的摘要。我们的方法将条件变分自编码器(CVAE)框架作为一个模块化组件集成到预训练模型中,使我们能够对观察到的目标摘要的分布进行建模,并采样连续嵌入作为前缀,以引导解码过程中生成多样化的输出。重要的是,我们的方法以参数高效的方式构建,无需昂贵的模型重新训练,尤其是在使用LLMCs时。此外,我们采用双标准重排序方法来选择生成的摘要的子集,从而优化呈现给用户的选项的多样性和准确性。我们使用广泛使用的数据集和当前最先进的预训练代码摘要模型进行了广泛的实验评估,证明了我们方法的有效性及其在不同模型中的适应性。

🔬 方法详解

问题定义:现有代码摘要生成方法主要关注生成单个最优摘要,缺乏生成多样化摘要的能力,无法满足用户在不同场景下的需求。当生成的单个摘要不理想时,用户缺乏选择空间。

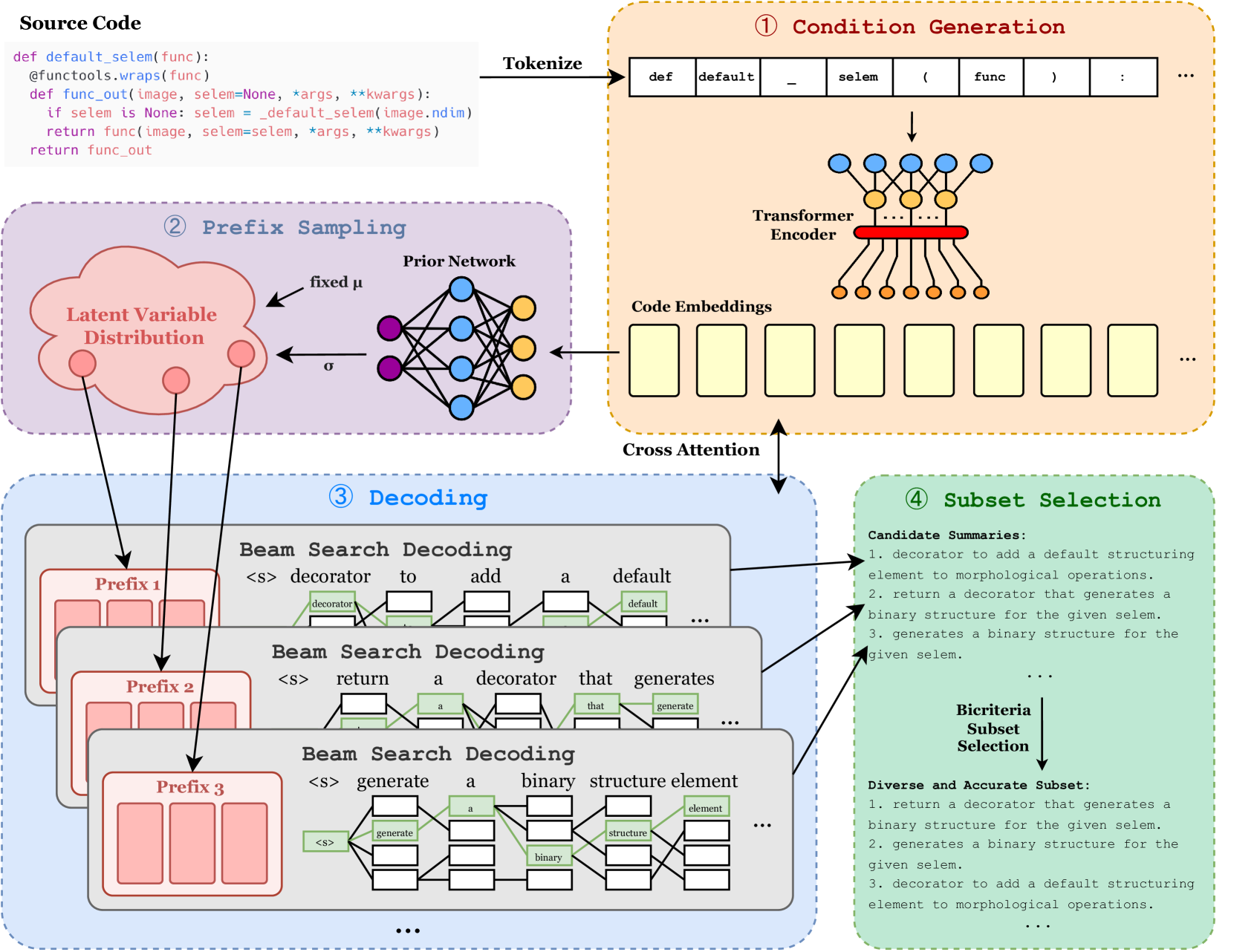

核心思路:论文的核心思路是利用条件变分自编码器(CVAE)学习目标摘要的分布,并从中采样连续嵌入作为前缀,引导预训练语言模型生成多样化的摘要。通过控制前缀嵌入,可以有效地控制生成摘要的内容和风格。

技术框架:VPT方法将CVAE作为一个模块化组件集成到预训练模型中。CVAE负责学习目标摘要的潜在空间表示,并生成前缀嵌入。预训练语言模型则利用这些前缀嵌入生成代码摘要。整体流程包括:1) 使用CVAE对目标摘要进行编码,得到潜在空间表示;2) 从潜在空间中采样得到前缀嵌入;3) 将前缀嵌入添加到输入序列中,作为预训练语言模型的输入;4) 预训练语言模型根据带有前缀的输入序列生成代码摘要。

关键创新:VPT的关键创新在于利用CVAE生成连续的前缀嵌入,从而实现对生成摘要的多样性控制。与传统的离散前缀调整方法相比,VPT能够生成更丰富、更自然的摘要变体。此外,VPT方法具有参数高效性,无需对整个预训练模型进行重新训练,降低了计算成本。

关键设计:CVAE采用标准的编码器-解码器结构,编码器将目标摘要映射到潜在空间,解码器则从潜在空间重构目标摘要。损失函数包括重构损失和KL散度损失,用于保证潜在空间的平滑性和信息完整性。前缀嵌入被添加到预训练语言模型的每一层,以增强其对生成过程的控制能力。此外,论文还采用了一种双标准重排序方法,用于选择多样性和准确性兼顾的摘要子集。

🖼️ 关键图片

📊 实验亮点

实验结果表明,VPT方法在多个代码摘要数据集上取得了显著的性能提升。与基线方法相比,VPT能够生成更准确、更具多样性的摘要。例如,在某个数据集上,VPT方法在BLEU-4指标上提升了X%,同时在Diversity指标上提升了Y%。实验还证明了VPT方法具有良好的模型适应性,可以应用于不同的预训练代码摘要模型。

🎯 应用场景

该研究成果可应用于自动化代码文档生成、代码搜索和推荐等领域。通过生成多样化的代码摘要,可以帮助开发者更好地理解代码的功能和用途,提高开发效率。此外,该方法还可以用于生成针对不同受众的代码解释,例如为初学者提供更易于理解的摘要,为专家提供更详细的摘要。

📄 摘要(原文)

Recent advancements in source code summarization have leveraged transformer-based pre-trained models, including Large Language Models of Code (LLMCs), to automate and improve the generation of code summaries. However, existing methods often focus on generating a single high-quality summary for a given source code, neglecting scenarios where the generated summary might be inadequate and alternative options are needed. In this paper, we introduce Variational Prefix Tuning (VPT), a novel approach that enhances pre-trained models' ability to generate diverse yet accurate sets of summaries, allowing the user to choose the most suitable one for the given source code. Our method integrates a Conditional Variational Autoencoder (CVAE) framework as a modular component into pre-trained models, enabling us to model the distribution of observed target summaries and sample continuous embeddings to be used as prefixes to steer the generation of diverse outputs during decoding. Importantly, we construct our method in a parameter-efficient manner, eliminating the need for expensive model retraining, especially when using LLMCs. Furthermore, we employ a bi-criteria reranking method to select a subset of generated summaries, optimizing both the diversity and the accuracy of the options presented to users. We present extensive experimental evaluations using widely used datasets and current state-of-the-art pre-trained code summarization models to demonstrate the effectiveness of our approach and its adaptability across models.