Communication Styles and Reader Preferences of LLM and Human Experts in Explaining Health Information

作者: Jiawei Zhou, Kritika Venkatachalam, Minje Choi, Koustuv Saha, Munmun De Choudhury

分类: cs.HC, cs.AI

发布日期: 2025-05-13

💡 一句话要点

研究LLM与人类专家在健康信息解释中的沟通风格差异及读者偏好

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 健康信息传播 沟通风格 读者偏好 事实核查

📋 核心要点

- 现有健康传播研究较少关注LLM与人类专家在沟通风格上的差异,以及这些差异对读者认知的影响。

- 本研究通过分析LLM和人类专家在健康信息解释中的沟通风格,评估其在信息、发送者和接收者三个方面的差异。

- 实验结果表明,读者更偏好LLM提供的健康信息解释,尽管LLM在传统质量指标上得分较低。

📝 摘要(中文)

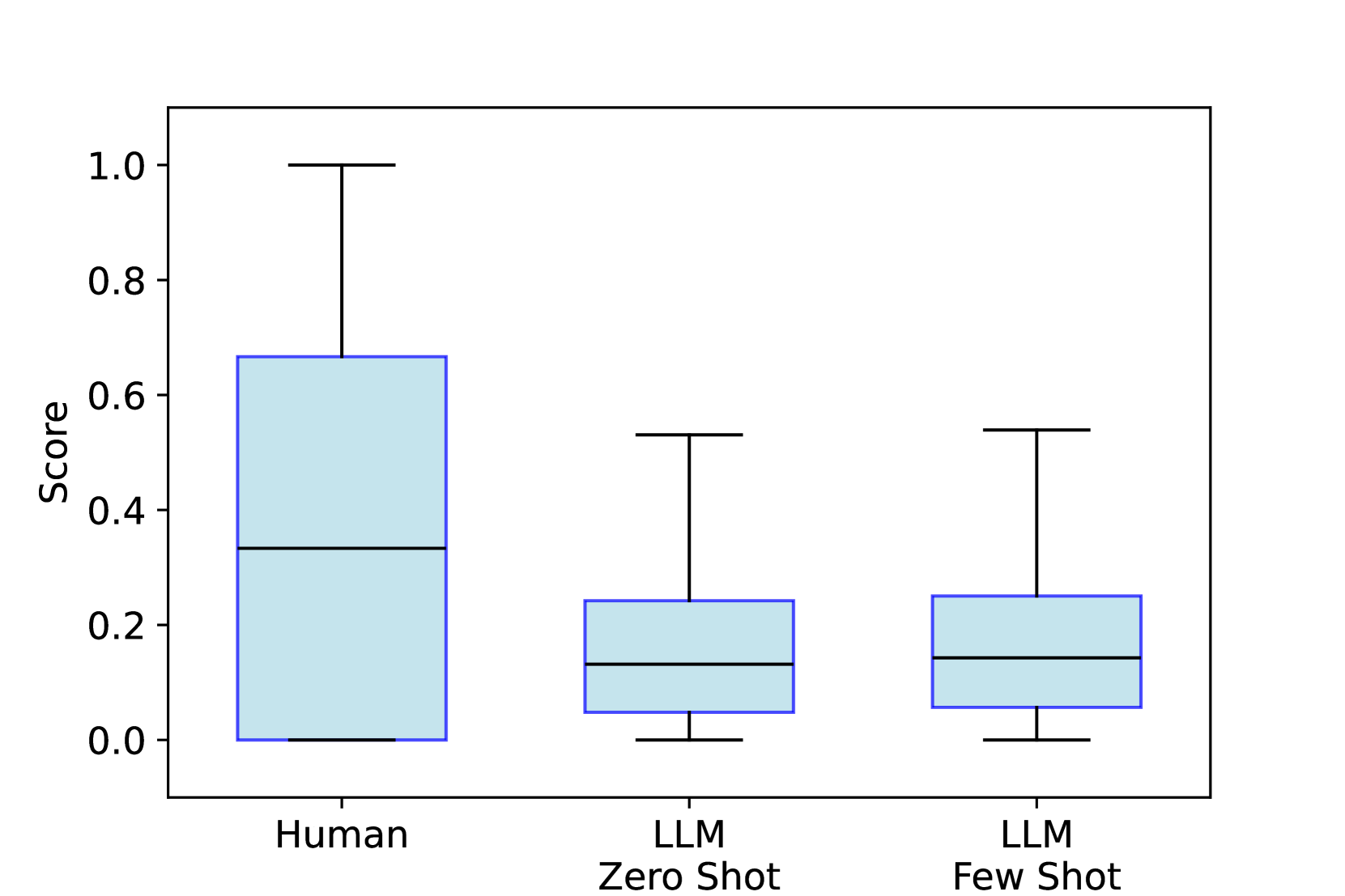

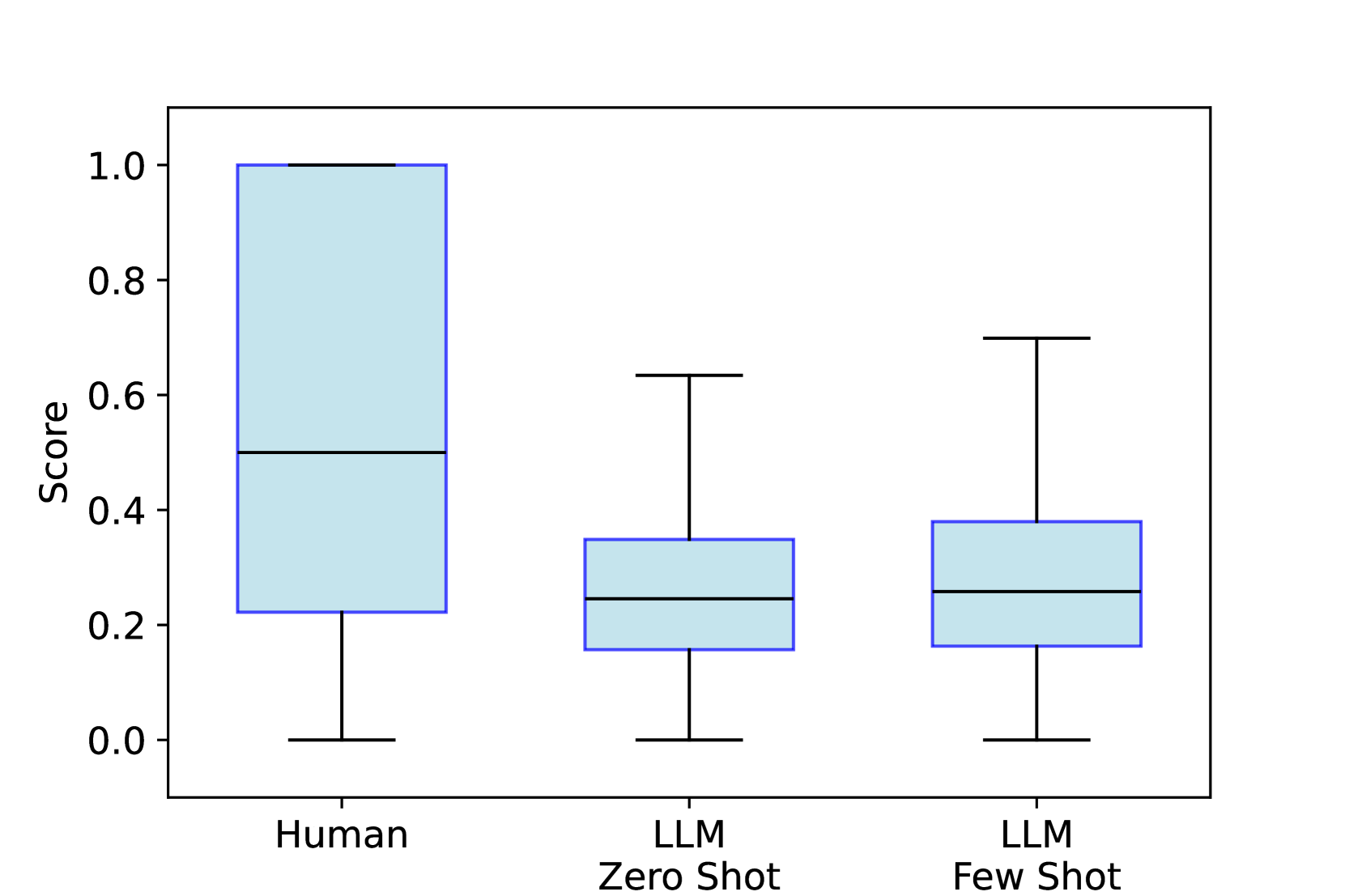

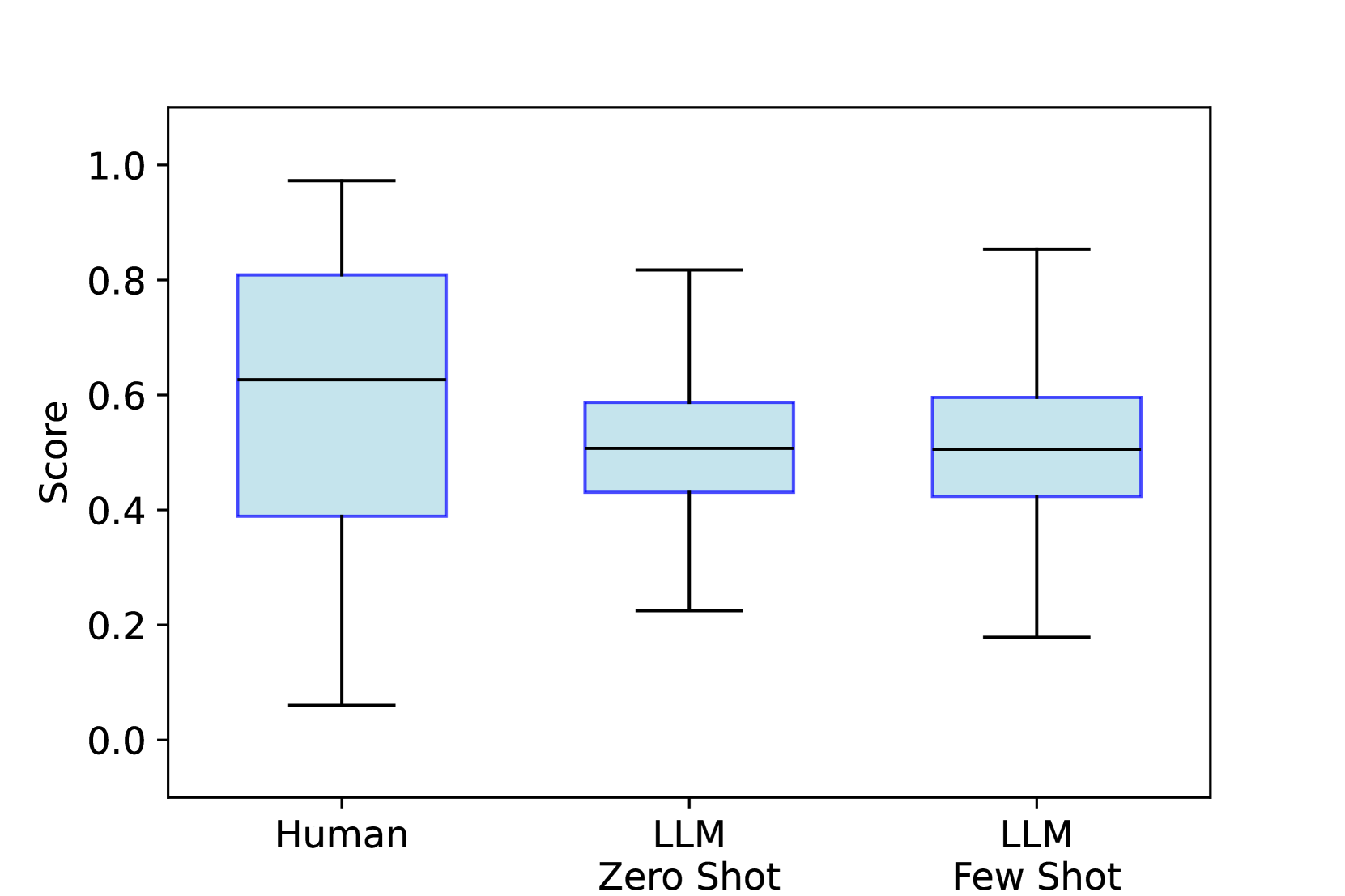

随着大型语言模型(LLM)在信息辅助领域的广泛应用,检验其与人类沟通风格和价值观的一致性至关重要。本研究聚焦于健康信息的事实核查,旨在应对纠正错误观念和建立信任的关键挑战。虽然最近的研究已经探索了LLM在健康传播方面的潜力,但LLM与人类专家之间的风格差异以及相关的读者认知仍未得到充分研究。因此,本研究评估了LLM的沟通风格,重点关注其解释与人类在健康传播的三个核心组成部分(信息、发送者和接收者)上的差异。我们汇集了来自权威事实核查机构的1498条健康错误信息解释的数据集,并生成了LLM对不准确健康信息的回复。借鉴健康传播理论,我们评估了信息语言特征、发送者说服策略和接收者价值观对齐这三个关键维度上的沟通风格。我们还通过一项有99名参与者的盲法评估来评估人类的认知。研究结果表明,LLM生成的文章在说服策略、确定性表达以及与社会价值观和道德基础的对齐方面得分显著较低。然而,人类评估表明,他们对LLM内容有很强的偏好,超过60%的回复更喜欢LLM的文章,因为它们更清晰、完整和具有说服力。我们的结果表明,尽管LLM在事实核查和健康传播的传统质量指标上得分较低,但其结构化的信息呈现方式可能更有效地吸引读者。

🔬 方法详解

问题定义:本研究旨在解决大型语言模型(LLM)在健康信息传播中,其沟通风格与人类专家的差异,以及这些差异如何影响读者对信息的接受度和信任度的问题。现有方法主要集中在评估LLM生成内容的准确性,而忽略了沟通风格对信息有效性的影响。

核心思路:本研究的核心思路是通过对比LLM和人类专家在健康信息解释中的沟通风格,识别其差异,并评估这些差异对读者偏好的影响。研究假设LLM结构化的信息呈现方式可能更有效地吸引读者,即使在传统质量指标上得分较低。

技术框架:本研究的技术框架主要包括以下几个阶段:1) 数据收集:收集来自权威事实核查机构的健康错误信息解释,并使用LLM生成相应的解释。2) 特征提取:从信息语言特征、发送者说服策略和接收者价值观对齐三个维度评估LLM和人类专家的沟通风格。3) 人工评估:通过盲法评估,收集人类参与者对LLM和人类专家生成内容的偏好。4) 统计分析:分析LLM和人类专家在不同沟通风格维度上的差异,以及这些差异与读者偏好之间的关系。

关键创新:本研究的关键创新在于:1) 首次系统地比较了LLM和人类专家在健康信息解释中的沟通风格差异。2) 提出了一个多维度的沟通风格评估框架,包括信息语言特征、发送者说服策略和接收者价值观对齐。3) 揭示了读者对LLM生成内容的偏好,即使LLM在传统质量指标上得分较低。

关键设计:在数据收集方面,研究收集了1498条健康错误信息解释。在特征提取方面,研究使用了多种自然语言处理技术,例如情感分析、确定性表达分析和社会价值观对齐分析。在人工评估方面,研究采用了盲法评估,以减少主观偏差。参与者被要求对LLM和人类专家生成的内容进行评分,并选择他们更偏好的内容。

🖼️ 关键图片

📊 实验亮点

研究发现,尽管LLM在说服策略、确定性表达和社会价值观对齐方面得分较低,但超过60%的参与者更喜欢LLM生成的健康信息解释,因为它们更清晰、完整和具有说服力。这表明LLM结构化的信息呈现方式可能更有效地吸引读者。

🎯 应用场景

该研究成果可应用于改进LLM在健康信息传播中的应用,例如优化LLM的沟通风格,使其更符合读者的偏好,从而提高健康信息的传播效果和公众的健康素养。此外,该研究也为其他领域的信息传播提供了借鉴,例如金融、法律等。

📄 摘要(原文)

With the wide adoption of large language models (LLMs) in information assistance, it is essential to examine their alignment with human communication styles and values. We situate this study within the context of fact-checking health information, given the critical challenge of rectifying conceptions and building trust. Recent studies have explored the potential of LLM for health communication, but style differences between LLMs and human experts and associated reader perceptions remain under-explored. In this light, our study evaluates the communication styles of LLMs, focusing on how their explanations differ from those of humans in three core components of health communication: information, sender, and receiver. We compiled a dataset of 1498 health misinformation explanations from authoritative fact-checking organizations and generated LLM responses to inaccurate health information. Drawing from health communication theory, we evaluate communication styles across three key dimensions of information linguistic features, sender persuasive strategies, and receiver value alignments. We further assessed human perceptions through a blinded evaluation with 99 participants. Our findings reveal that LLM-generated articles showed significantly lower scores in persuasive strategies, certainty expressions, and alignment with social values and moral foundations. However, human evaluation demonstrated a strong preference for LLM content, with over 60% responses favoring LLM articles for clarity, completeness, and persuasiveness. Our results suggest that LLMs' structured approach to presenting information may be more effective at engaging readers despite scoring lower on traditional measures of quality in fact-checking and health communication.