Can Generative AI agents behave like humans? Evidence from laboratory market experiments

作者: R. Maria del Rio-Chanona, Marco Pangallo, Cars Hommes

分类: econ.GN, cs.AI

发布日期: 2025-05-12

💡 一句话要点

利用生成式AI模拟人类经济行为:基于市场实验的LLM智能体研究

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 经济市场实验 智能体建模 行为经济学 有限理性 动态反馈 人类行为模拟

📋 核心要点

- 现有方法难以在动态市场环境中准确模拟人类经济行为,尤其是在个体决策相互影响的情况下。

- 该研究利用LLM构建智能体,通过动态反馈机制模拟市场环境,观察LLM智能体在经济实验中的行为模式。

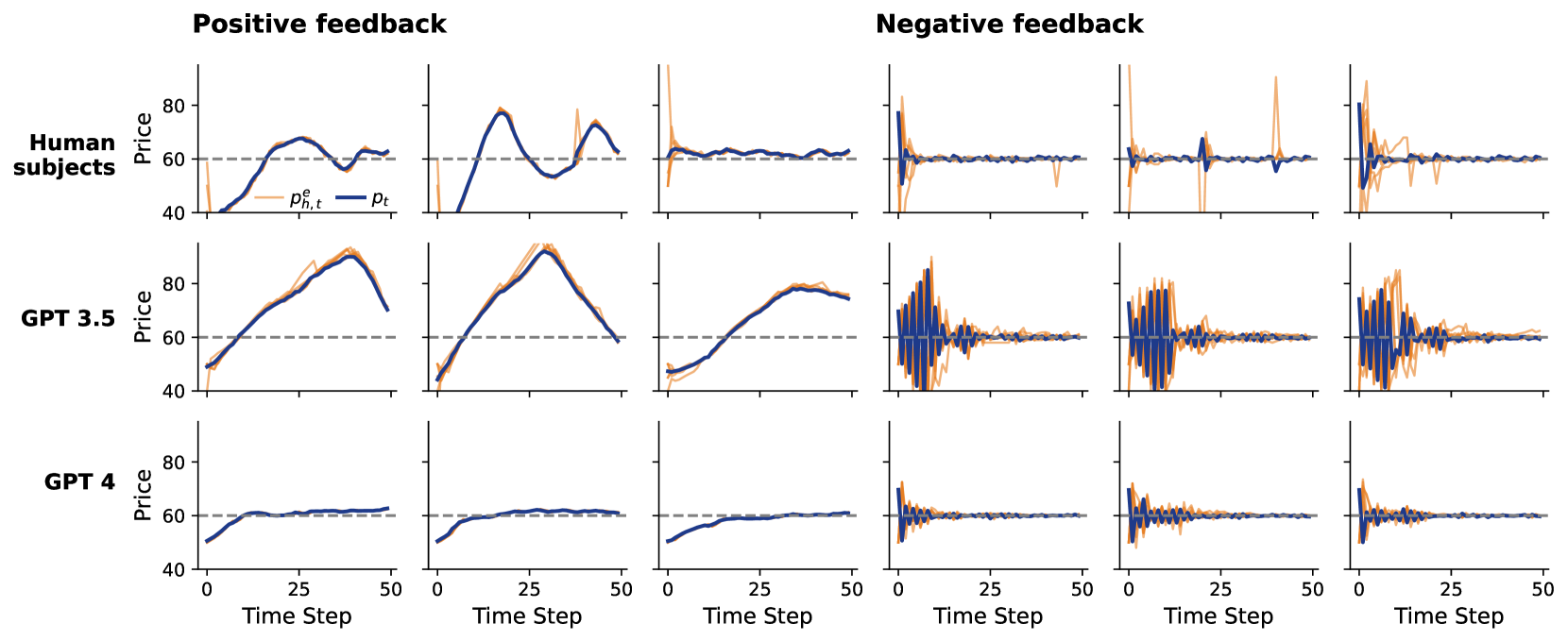

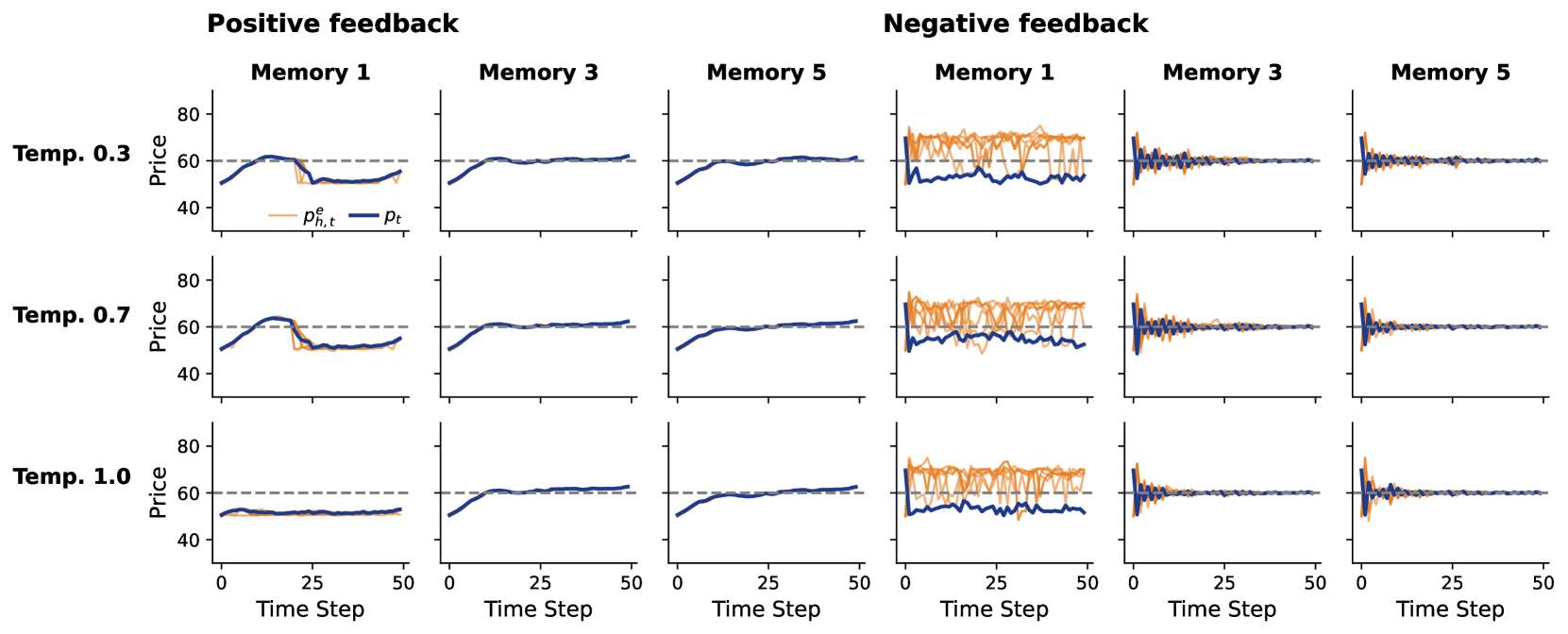

- 实验表明,LLM智能体展现出有限理性,能够复现人类在市场实验中的一些宏观趋势,但行为异质性仍有差距。

📝 摘要(中文)

本文探讨了大型语言模型(LLM)在经济市场实验中复现人类行为的潜力。与以往研究不同,本文侧重于LLM智能体之间的动态反馈:每个LLM的决策会影响当前的市场价格,进而影响其他LLM在下一步的决策。通过将LLM的行为与实验室环境中观察到的市场动态进行比较,评估它们与人类参与者行为的一致性。研究结果表明,LLM并不严格遵循理性预期,而是表现出与人类参与者相似的有限理性。提供最小的上下文窗口(即前三个时间步的记忆),并结合捕捉响应异质性的高变异性设置,使LLM能够复现人类实验中观察到的广泛趋势,例如区分正反馈和负反馈市场。然而,在细粒度层面上仍然存在差异——LLM的行为异质性低于人类。这些结果表明,LLM作为模拟经济环境中真实人类行为的工具具有潜力,但仍需进一步研究以提高其准确性并增加行为多样性。

🔬 方法详解

问题定义:现有方法在模拟人类经济行为时,难以捕捉个体决策之间的动态反馈,导致模型无法准确预测市场走势。传统的理性预期模型假设个体完全理性,与实际人类行为存在偏差。因此,需要一种能够模拟个体有限理性以及个体间相互影响的模型。

核心思路:本文的核心思路是利用大型语言模型(LLM)构建智能体,并让这些智能体在模拟的市场环境中进行交互。通过观察LLM智能体的决策行为,分析其是否能够复现人类在真实市场环境中的行为模式。这种方法允许研究者探索LLM在模拟复杂社会经济系统中的潜力。

技术框架:该研究的技术框架主要包括以下几个部分:1)构建基于LLM的智能体,这些智能体可以根据市场信息做出决策;2)设计模拟市场环境,允许LLM智能体之间进行交互,并产生动态反馈;3)收集LLM智能体的决策数据,并与人类参与者在类似市场实验中的数据进行比较;4)分析LLM智能体的行为模式,评估其与人类行为的相似程度。

关键创新:该研究的关键创新在于将LLM应用于模拟动态市场环境中的人类行为。与以往研究不同,该研究关注LLM智能体之间的动态反馈,以及LLM在有限理性条件下的决策行为。此外,该研究还探索了不同上下文窗口大小和变异性设置对LLM行为的影响。

关键设计:研究中,上下文窗口大小被设置为3个时间步,以模拟有限记忆。高变异性设置旨在捕捉个体响应的异质性。实验比较了LLM在正反馈和负反馈市场中的行为,并与人类参与者的行为进行了对比。具体参数设置和损失函数(如果使用)在论文正文中应该有更详细的描述,此处未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM智能体在一定程度上能够复现人类在市场实验中的宏观趋势,例如区分正反馈和负反馈市场。尽管LLM的行为异质性低于人类,但通过调整上下文窗口大小和变异性设置,可以提高LLM模拟人类行为的准确性。这些发现表明,LLM在模拟人类经济行为方面具有潜力。

🎯 应用场景

该研究成果可应用于经济政策模拟、金融市场预测、行为经济学研究等领域。通过构建基于LLM的智能体,可以更准确地模拟市场参与者的行为,从而为政策制定者提供更可靠的决策依据。此外,该研究还可以帮助我们更好地理解人类在复杂经济系统中的行为模式。

📄 摘要(原文)

We explore the potential of Large Language Models (LLMs) to replicate human behavior in economic market experiments. Compared to previous studies, we focus on dynamic feedback between LLM agents: the decisions of each LLM impact the market price at the current step, and so affect the decisions of the other LLMs at the next step. We compare LLM behavior to market dynamics observed in laboratory settings and assess their alignment with human participants' behavior. Our findings indicate that LLMs do not adhere strictly to rational expectations, displaying instead bounded rationality, similarly to human participants. Providing a minimal context window i.e. memory of three previous time steps, combined with a high variability setting capturing response heterogeneity, allows LLMs to replicate broad trends seen in human experiments, such as the distinction between positive and negative feedback markets. However, differences remain at a granular level--LLMs exhibit less heterogeneity in behavior than humans. These results suggest that LLMs hold promise as tools for simulating realistic human behavior in economic contexts, though further research is needed to refine their accuracy and increase behavioral diversity.