LLMs' Suitability for Network Security: A Case Study of STRIDE Threat Modeling

作者: AbdulAziz AbdulGhaffar, Ashraf Matrawy

分类: cs.CR, cs.AI, cs.NI

发布日期: 2025-05-07 (更新: 2025-10-15)

备注: Conference paper, 6 pages, 4 figures, 1 table

💡 一句话要点

评估LLM在网络安全中的适用性:基于STRIDE威胁建模的案例研究

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 网络安全 威胁建模 STRIDE 5G网络

📋 核心要点

- 现有研究缺乏对LLM在网络安全领域适用性的深入分析,尤其是在威胁建模等关键任务中。

- 该研究通过案例分析,探索了利用LLM进行STRIDE威胁建模的可行性,并分析了不同提示策略对模型性能的影响。

- 实验结果揭示了LLM在网络安全应用中的优势与局限性,强调了针对特定安全场景进行LLM调整和优化的必要性。

📝 摘要(中文)

人工智能(AI)预计将成为下一代AI原生6G网络不可或缺的一部分。随着AI的普及,研究人员已经确定了AI在网络安全中的许多用例。然而,分析大型语言模型(LLM)在网络安全中的适用性的研究非常少。为了填补这一空白,我们研究了LLM在网络安全中的适用性,特别是以STRIDE威胁建模为例。我们利用四种提示技术和五种LLM来执行5G威胁的STRIDE分类。从我们的评估结果中,我们指出了关键发现和详细的见解,并解释了可能影响LLM在某些威胁建模中行为的潜在因素。数值结果和见解支持了为网络安全用例调整和微调LLM的必要性。

🔬 方法详解

问题定义:论文旨在评估大型语言模型(LLM)在网络安全领域的适用性,具体聚焦于STRIDE威胁建模任务。现有方法在自动化威胁建模方面存在不足,依赖人工专家,效率低且成本高。LLM有望通过其强大的自然语言处理能力,自动识别和分类潜在威胁,但其在网络安全领域的性能尚未得到充分评估。

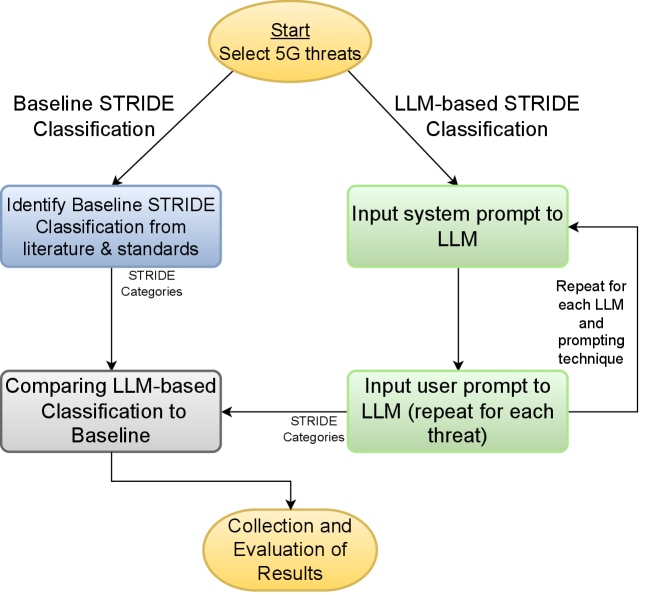

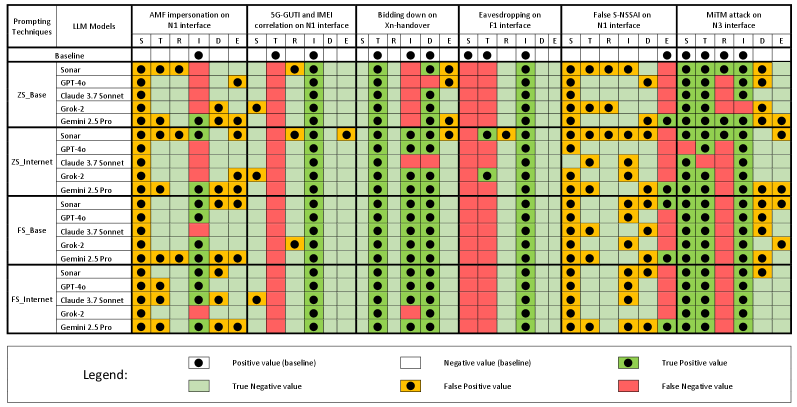

核心思路:论文的核心思路是利用LLM的文本理解和生成能力,将威胁建模问题转化为文本分类问题。通过设计合适的提示(Prompt),引导LLM分析给定的网络安全场景,并根据STRIDE模型(Spoofing, Tampering, Repudiation, Information Disclosure, Denial of Service, Elevation of Privilege)对潜在威胁进行分类。

技术框架:该研究的技术框架主要包括以下几个步骤:1) 选择合适的LLM模型;2) 设计不同的提示策略,以引导LLM进行威胁分类;3) 构建包含5G网络威胁的测试数据集;4) 使用不同的LLM和提示策略对测试数据进行评估;5) 分析实验结果,总结LLM在STRIDE威胁建模中的优势和局限性。

关键创新:该研究的关键创新在于首次系统性地评估了LLM在STRIDE威胁建模中的适用性。通过对比不同的LLM和提示策略,揭示了LLM在网络安全领域的潜在应用价值,并指出了需要进一步研究和改进的方向。

关键设计:论文使用了四种不同的提示技术,旨在探索不同提示方式对LLM性能的影响。同时,选择了五种不同的LLM模型,以评估不同模型在威胁建模任务中的表现。实验中,研究人员分析了LLM在不同威胁类别上的分类准确率,并探讨了影响LLM性能的潜在因素。

🖼️ 关键图片

📊 实验亮点

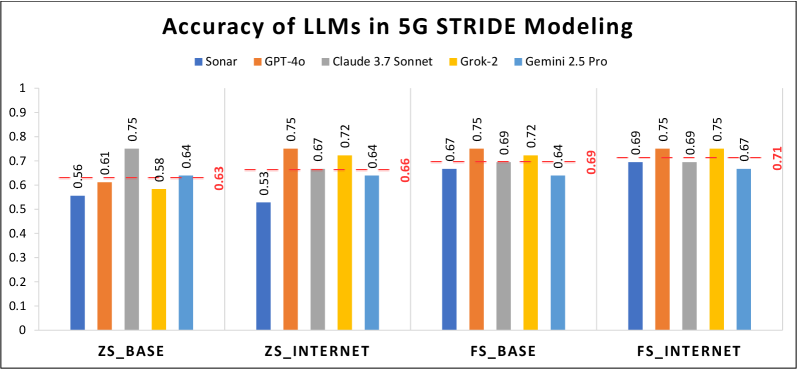

实验结果表明,LLM在STRIDE威胁建模中具有一定的潜力,但性能受提示策略和模型选择的影响较大。不同LLM在不同威胁类别上的表现存在差异,表明需要针对特定安全场景进行LLM的调整和优化。该研究为LLM在网络安全领域的应用提供了宝贵的经验和指导。

🎯 应用场景

该研究成果可应用于自动化网络安全威胁建模,辅助安全专家快速识别和评估潜在风险。通过集成LLM到安全工具中,可以提高威胁建模的效率和准确性,降低安全风险。未来,该研究可扩展到其他网络安全领域,如漏洞分析、入侵检测等,推动AI在网络安全领域的广泛应用。

📄 摘要(原文)

Artificial Intelligence (AI) is expected to be an integral part of next-generation AI-native 6G networks. With the prevalence of AI, researchers have identified numerous use cases of AI in network security. However, there are very few studies that analyze the suitability of Large Language Models (LLMs) in network security. To fill this gap, we examine the suitability of LLMs in network security, particularly with the case study of STRIDE threat modeling. We utilize four prompting techniques with five LLMs to perform STRIDE classification of 5G threats. From our evaluation results, we point out key findings and detailed insights along with the explanation of the possible underlying factors influencing the behavior of LLMs in the modeling of certain threats. The numerical results and the insights support the necessity for adjusting and fine-tuning LLMs for network security use cases.