Decentralized Distributed Proximal Policy Optimization (DD-PPO) for High Performance Computing Scheduling on Multi-User Systems

作者: Matthew Sgambati, Aleksandar Vakanski, Matthew Anderson

分类: cs.DC, cs.AI

发布日期: 2025-05-06

💡 一句话要点

提出DD-PPO算法,用于多用户HPC系统高性能计算任务调度,提升效率。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 高性能计算调度 强化学习 分布式训练 近端策略优化 DD-PPO 资源分配 作业调度

📋 核心要点

- 现有HPC调度算法难以适应系统日益增长的异构性和规模,导致作业等待时间长,系统利用率低。

- 论文提出基于DD-PPO的调度器,利用去中心化分布式训练,提高可扩展性和样本利用率,优化调度策略。

- 实验结果表明,DD-PPO在包含1150万作业轨迹的数据集上,优于传统规则和现有RL调度算法。

📝 摘要(中文)

本文针对高性能计算(HPC)环境中作业调度算法面临的复杂资源分配问题,提出了一种基于强化学习(RL)的调度器,该调度器采用去中心化分布式近端策略优化(DD-PPO)算法。传统基于规则的调度算法在日益异构和大规模的HPC系统中面临效率和灵活性挑战。DD-PPO通过支持大规模分布式训练,无需每步参数同步,从而增强了可扩展性、训练效率和样本利用率。实验结果表明,在超过1150万个真实HPC作业轨迹的验证数据集上,与传统和先进的调度方法相比,DD-PPO调度器表现出改进的调度性能。

🔬 方法详解

问题定义:论文旨在解决高性能计算(HPC)系统中作业调度算法的资源分配问题。现有基于规则的调度算法难以适应HPC系统日益增长的异构性和规模,导致作业等待时间长,系统利用率低。现有的基于强化学习的调度方法依赖于相对较小的数据集,并且在使用大型数据集时面临可扩展性问题。

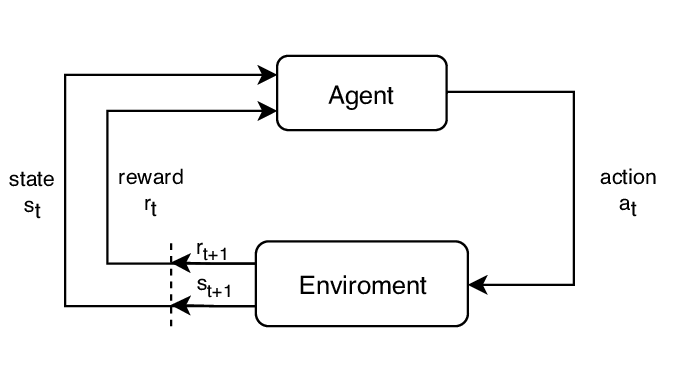

核心思路:论文的核心思路是利用去中心化分布式近端策略优化(DD-PPO)算法进行强化学习训练,从而克服传统RL方法在处理大规模HPC调度问题时遇到的可扩展性瓶颈。通过去中心化的训练方式,避免了集中式参数同步带来的通信开销,提高了训练效率和样本利用率。

技术框架:DD-PPO调度器的整体框架包括多个worker节点,每个worker节点独立地与HPC环境交互,收集经验数据,并计算策略梯度。这些梯度用于更新本地策略,而无需在每个步骤都与中央服务器同步参数。最终,通过某种聚合机制(具体机制未知)将各个worker的策略进行整合,得到全局策略。

关键创新:最重要的技术创新点是采用了去中心化的分布式训练方式,避免了集中式参数同步,从而提高了算法的可扩展性和训练效率。与传统的PPO算法相比,DD-PPO更适合处理大规模数据集和复杂的HPC调度环境。

关键设计:论文中关于DD-PPO的具体参数设置、损失函数和网络结构等技术细节描述不足,具体实现未知。但可以推测,损失函数仍然基于PPO的裁剪目标函数,网络结构可能采用深度神经网络或图神经网络,以捕捉HPC作业之间的复杂关系。具体的worker数量、学习率、折扣因子等超参数的选择可能需要根据具体的HPC环境进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,DD-PPO调度器在包含超过1150万个真实HPC作业轨迹的数据集上,与传统的基于规则的调度器和现有的基于强化学习的调度算法相比,表现出改进的调度性能。具体的性能提升幅度未知,但论文强调了DD-PPO在处理大规模数据集方面的优势。

🎯 应用场景

该研究成果可应用于各种高性能计算中心和云计算平台,用于优化作业调度,缩短作业等待时间,提高系统资源利用率。通过更智能的资源分配,可以提升科研效率,加速科学发现,并降低运营成本。未来,该方法有望推广到其他资源调度领域,如数据中心管理和边缘计算。

📄 摘要(原文)

Resource allocation in High Performance Computing (HPC) environments presents a complex and multifaceted challenge for job scheduling algorithms. Beyond the efficient allocation of system resources, schedulers must account for and optimize multiple performance metrics, including job wait time and system utilization. While traditional rule-based scheduling algorithms dominate the current deployments of HPC systems, the increasing heterogeneity and scale of those systems is expected to challenge the efficiency and flexibility of those algorithms in minimizing job wait time and maximizing utilization. Recent research efforts have focused on leveraging advancements in Reinforcement Learning (RL) to develop more adaptable and intelligent scheduling strategies. Recent RL-based scheduling approaches have explored a range of algorithms, from Deep Q-Networks (DQN) to Proximal Policy Optimization (PPO), and more recently, hybrid methods that integrate Graph Neural Networks with RL techniques. However, a common limitation across these methods is their reliance on relatively small datasets, and these methods face scalability issues when using large datasets. This study introduces a novel RL-based scheduler utilizing the Decentralized Distributed Proximal Policy Optimization (DD-PPO) algorithm, which supports large-scale distributed training across multiple workers without requiring parameter synchronization at every step. By eliminating reliance on centralized updates to a shared policy, the DD-PPO scheduler enhances scalability, training efficiency, and sample utilization. The validation dataset leveraged over 11.5 million real HPC job traces for comparing DD-PPO performance between traditional and advanced scheduling approaches, and the experimental results demonstrate improved scheduling performance in comparison to both rule-based schedulers and existing RL-based scheduling algorithms.