Beyond Retrieval: Improving Evidence Quality for LLM-based Multimodal Fact-Checking

作者: Haoran Ou, Gelei Deng, Xingshuo Han, Jie Zhang, Han Qiu, Shangwei Guo, Tianwei Zhang

分类: cs.AI

发布日期: 2025-05-06 (更新: 2026-01-08)

💡 一句话要点

Aletheia:提升证据质量,增强LLM在多模态事实核查中的表现

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态事实核查 大型语言模型 证据检索 虚假信息检测 信息过滤 开放域检索 证据质量

📋 核心要点

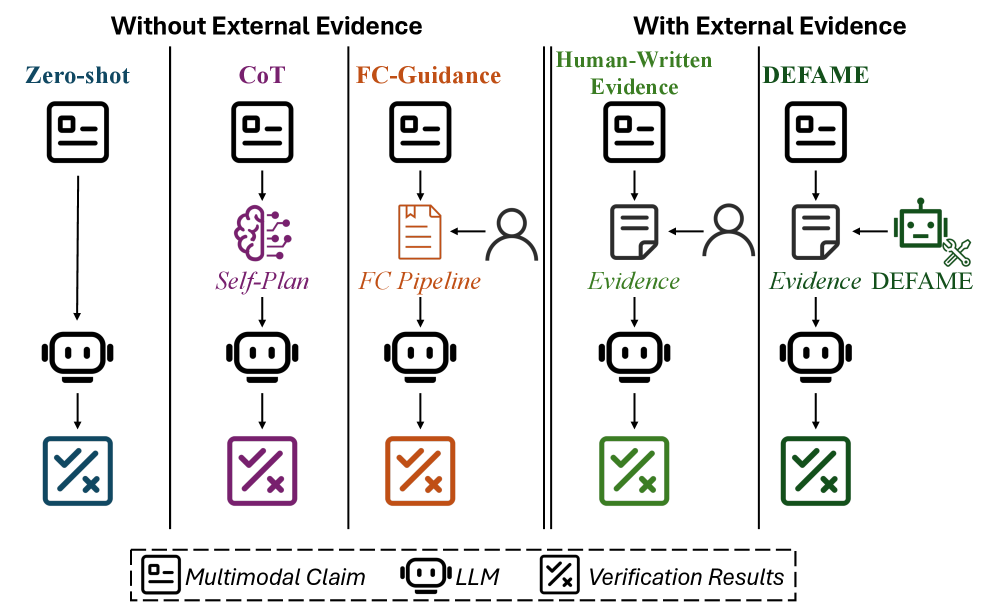

- 现有基于LLM的多模态事实核查方法在外部搜索覆盖率和证据质量评估方面存在不足,影响了核查的准确性。

- Aletheia框架通过新颖的证据检索策略,提高证据覆盖率并过滤无用信息,从而提取高质量的证据用于验证。

- 实验结果表明,Aletheia在多模态虚假信息数据集上显著提高了事实核查的准确率,最高提升达30.8%。

📝 摘要(中文)

多模态虚假信息日益增多,其中欺骗性声明通过协调的文本和视觉内容得到加强,这对自动事实核查提出了重大挑战。最近的研究利用大型语言模型(LLM)的强大推理和多模态理解能力来解决这个问题。新兴的检索增强框架进一步使LLM能够访问开放域的外部信息,从而实现基于证据的验证,超越其内部知识。尽管取得了可喜的进展,但我们的实证研究揭示了外部搜索覆盖范围和证据质量评估方面的显著缺陷。为了缓解这些限制,我们提出了Aletheia,一个用于自动多模态事实核查的端到端框架。它引入了一种新颖的证据检索策略,可以提高证据覆盖率并过滤来自开放域来源的无用信息,从而能够提取用于验证的高质量证据。大量的实验表明,Aletheia在两个公共多模态虚假信息数据集上实现了88.3%的准确率,在新出现的声明上实现了90.2%的准确率。与现有的证据检索策略相比,我们的方法将验证准确率提高了高达30.8%,突出了证据质量在基于LLM的虚假信息验证中的关键作用。

🔬 方法详解

问题定义:论文旨在解决基于LLM的多模态事实核查中,由于外部证据检索覆盖率不足和证据质量不高,导致的事实核查准确率低的问题。现有方法在检索相关证据时,容易遗漏关键信息或引入噪声,从而影响LLM的判断。

核心思路:论文的核心思路是通过改进证据检索策略,提高检索到的证据的覆盖率和质量。具体来说,就是设计一种能够更全面地搜索相关信息,并有效过滤掉无关或误导性信息的检索方法,从而为LLM提供更可靠的证据基础。

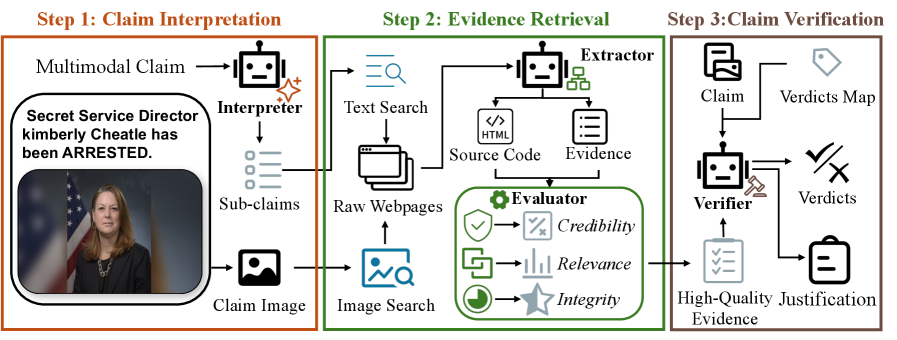

技术框架:Aletheia是一个端到端的框架,主要包含以下几个阶段:1) 声明输入:接收待验证的多模态声明(文本和图像);2) 证据检索:使用改进的证据检索策略从开放域资源中检索相关证据;3) 证据过滤:过滤掉检索到的无用或低质量证据;4) LLM验证:利用LLM对过滤后的高质量证据进行推理和验证,输出事实核查结果。

关键创新:论文的关键创新在于提出了一种新颖的证据检索策略,该策略能够更有效地覆盖相关信息,并过滤掉无用信息。这种策略可能结合了多种技术,例如更精细的查询构建、更有效的排序算法,以及基于语义理解的过滤机制。与现有方法相比,该策略能够为LLM提供更高质量的证据,从而提高事实核查的准确率。

关键设计:具体的技术细节(例如参数设置、损失函数、网络结构等)在摘要中没有明确说明,属于未知信息。但可以推测,证据检索策略可能涉及对查询语句的优化,例如使用关键词扩展、语义相似度匹配等技术。证据过滤可能采用基于规则的方法,或者训练一个分类器来区分有用和无用的证据。LLM验证阶段可能使用微调后的LLM模型,并采用特定的提示工程技术来引导LLM进行推理。

🖼️ 关键图片

📊 实验亮点

Aletheia在两个公共多模态虚假信息数据集上实现了88.3%的准确率,在新出现的声明上实现了90.2%的准确率。与现有的证据检索策略相比,Aletheia将验证准确率提高了高达30.8%,显著提升了基于LLM的多模态事实核查性能,证明了高质量证据在其中的关键作用。

🎯 应用场景

该研究成果可应用于自动化的多模态虚假信息检测平台,帮助用户识别和抵制网络上的谣言和不实信息。在新闻媒体、社交平台等领域具有重要的应用价值,有助于维护网络信息环境的健康和安全,减少虚假信息对社会造成的负面影响。未来可以扩展到更多语言和模态,提升系统的通用性和鲁棒性。

📄 摘要(原文)

The increasing multimodal disinformation, where deceptive claims are reinforced through coordinated text and visual content, poses significant challenges to automated fact-checking. Recent efforts leverage Large Language Models (LLMs) for this task, capitalizing on their strong reasoning and multimodal understanding capabilities. Emerging retrieval-augmented frameworks further equip LLMs with access to open-domain external information, enabling evidence-based verification beyond their internal knowledge. Despite their promising gains, our empirical study reveals notable shortcomings in the external search coverage and evidence quality evaluation. To mitigate those limitations, we propose Aletheia, an end-to-end framework for automated multimodal fact-checking. It introduces a novel evidence retrieval strategy that improves evidence coverage and filters useless information from open-domain sources, enabling the extraction of high-quality evidence for verification. Extensive experiments demonstrate that Aletheia achieves an accuracy of 88.3% on two public multimodal disinformation datasets and 90.2% on newly emerging claims. Compared with existing evidence retrieval strategies, our approach improves verification accuracy by up to 30.8%, highlighting the critical role of evidence quality in LLM-based disinformation verification.