Assessing and Enhancing the Robustness of LLM-based Multi-Agent Systems Through Chaos Engineering

作者: Joshua Owotogbe

分类: cs.MA, cs.AI, cs.SE

发布日期: 2025-05-06

💡 一句话要点

提出基于混沌工程的框架,提升LLM多智能体系统在真实环境下的鲁棒性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 混沌工程 多智能体系统 大型语言模型 鲁棒性 故障注入

📋 核心要点

- LLM多智能体系统在实际部署中面临幻觉、智能体失效、通信故障等挑战,影响系统稳定性。

- 论文提出混沌工程框架,通过主动注入故障来识别LLM-MAS的潜在脆弱点,增强系统韧性。

- 该框架旨在评估LLM-MAS在真实场景下的可靠性,并为关键应用提供稳定保障。

📝 摘要(中文)

本研究探索了混沌工程在提升基于大型语言模型的多智能体系统(LLM-MAS)在类生产环境下、真实条件下的鲁棒性的应用。LLM-MAS有潜力改进广泛的任务,从回答问题、生成内容到自动化客户支持和改进决策过程。然而,生产或预生产环境中的LLM-MAS可能容易受到涌现错误或中断的影响,例如幻觉、智能体故障和智能体通信故障。本研究提出了一个混沌工程框架,以主动识别LLM-MAS中的此类漏洞,评估并建立针对它们的弹性,并确保关键应用中的可靠性能。

🔬 方法详解

问题定义:论文旨在解决LLM多智能体系统在实际部署中鲁棒性不足的问题。现有方法难以应对生产环境中可能出现的各种突发错误,例如智能体幻觉、智能体崩溃以及智能体间通信中断等问题,这些问题会导致系统性能下降甚至完全失效。

核心思路:论文的核心思路是借鉴混沌工程的思想,通过在LLM-MAS中主动注入各种类型的故障,模拟真实世界中可能发生的异常情况,从而暴露系统中的潜在脆弱点。通过观察系统在故障注入下的表现,可以评估系统的鲁棒性,并针对性地进行改进。

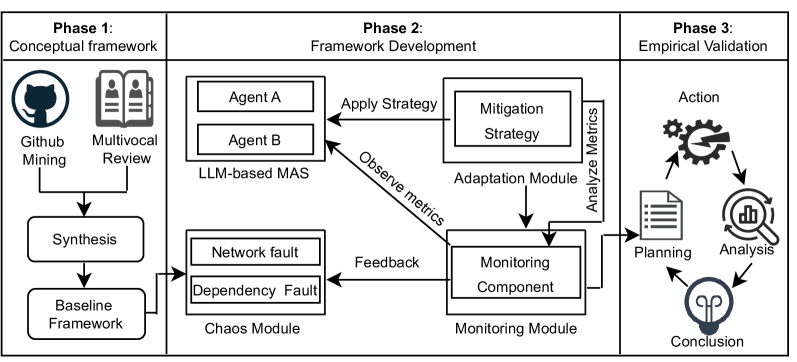

技术框架:论文提出了一个混沌工程框架,该框架包含以下主要阶段:1) 定义实验范围:确定需要测试的LLM-MAS组件和性能指标。2) 制定混沌实验:设计具体的故障注入策略,例如随机关闭智能体、延迟智能体通信、篡改智能体输入等。3) 执行混沌实验:在受控环境下运行LLM-MAS,并按照预定的策略注入故障。4) 监控和分析:实时监控系统的性能指标,并分析故障对系统的影响。5) 改进和优化:根据实验结果,调整系统架构、参数配置或代码实现,以提高系统的鲁棒性。

关键创新:论文的关键创新在于将混沌工程的思想引入到LLM多智能体系统的鲁棒性评估中。与传统的测试方法相比,混沌工程能够更主动、更全面地发现系统中的潜在问题,从而更有效地提高系统的可靠性。

关键设计:论文中涉及的关键设计包括:1) 故障注入策略的设计:需要根据具体的应用场景和系统架构,选择合适的故障类型和注入强度。2) 性能指标的选择:需要选择能够反映系统关键性能的指标,例如任务完成率、响应时间、错误率等。3) 监控和分析工具的开发:需要开发能够实时监控系统性能并自动分析故障影响的工具。

🖼️ 关键图片

📊 实验亮点

由于论文仅为摘要,未提供具体的实验结果。但根据摘要描述,该研究旨在通过混沌工程框架,主动识别LLM-MAS中的漏洞,评估并建立针对它们的弹性,并确保关键应用中的可靠性能。未来的实验结果将展示该框架在提升LLM-MAS鲁棒性方面的具体性能数据和提升幅度。

🎯 应用场景

该研究成果可应用于各种基于LLM的多智能体系统,例如智能客服、自动化决策系统、内容生成平台等。通过混沌工程,可以有效提升这些系统在复杂和不可预测环境下的稳定性和可靠性,降低因系统故障造成的损失,并提高用户满意度。未来,该方法可以扩展到更复杂的AI系统中,为AI系统的安全可靠运行提供保障。

📄 摘要(原文)

This study explores the application of chaos engineering to enhance the robustness of Large Language Model-Based Multi-Agent Systems (LLM-MAS) in production-like environments under real-world conditions. LLM-MAS can potentially improve a wide range of tasks, from answering questions and generating content to automating customer support and improving decision-making processes. However, LLM-MAS in production or preproduction environments can be vulnerable to emergent errors or disruptions, such as hallucinations, agent failures, and agent communication failures. This study proposes a chaos engineering framework to proactively identify such vulnerabilities in LLM-MAS, assess and build resilience against them, and ensure reliable performance in critical applications.