Reinforced MLLM: A Survey on RL-Based Reasoning in Multimodal Large Language Models

作者: Guanghao Zhou, Panjia Qiu, Cen Chen, Jie Wang, Zheming Yang, Jian Xu, Minghui Qiu

分类: cs.AI

发布日期: 2025-04-30 (更新: 2025-05-21)

💡 一句话要点

综述:强化学习驱动多模态大语言模型推理能力提升

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 强化学习 跨模态推理 奖励机制 推理轨迹

📋 核心要点

- 多模态大语言模型在跨模态推理方面面临挑战,现有方法难以有效对齐不同模态的信息。

- 论文综述了利用强化学习优化MLLM推理轨迹的方法,通过奖励机制引导模型学习更有效的推理策略。

- 论文分析了价值模型无关和价值模型两种RL范式在MLLM推理中的应用,并探讨了未来研究方向。

📝 摘要(中文)

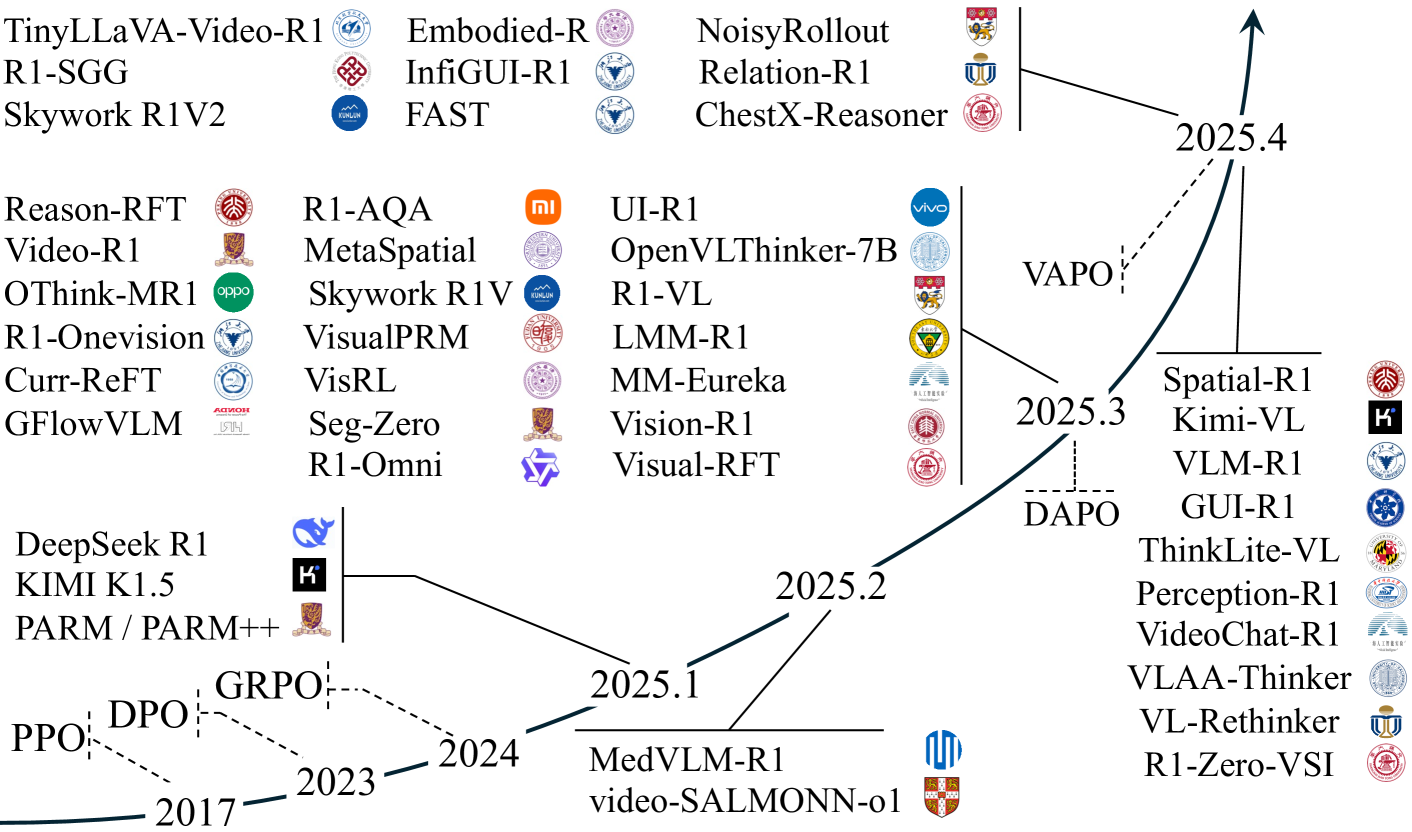

本研究对利用强化学习(RL)增强多模态大语言模型(MLLM)推理能力这一快速发展的研究领域进行了系统性回顾。MLLM将大型语言模型(LLM)扩展到视觉、音频和视频等多种模态,但实现跨模态输入的鲁棒推理仍然具有挑战性。本文涵盖了基于RL的MLLM推理的最新进展,包括关键的算法设计、奖励机制创新和实际应用。我们重点介绍了两种主要的RL范式:价值模型无关方法和价值模型方法,并分析了RL如何通过优化推理轨迹和对齐多模态信息来增强推理能力。此外,我们还广泛概述了基准数据集、评估协议和当前局限性,并提出了未来的研究方向,以解决诸如稀疏奖励、低效的跨模态推理和实际部署约束等挑战。我们的目标是为基于RL的多模态推理提供全面而结构化的指南。

🔬 方法详解

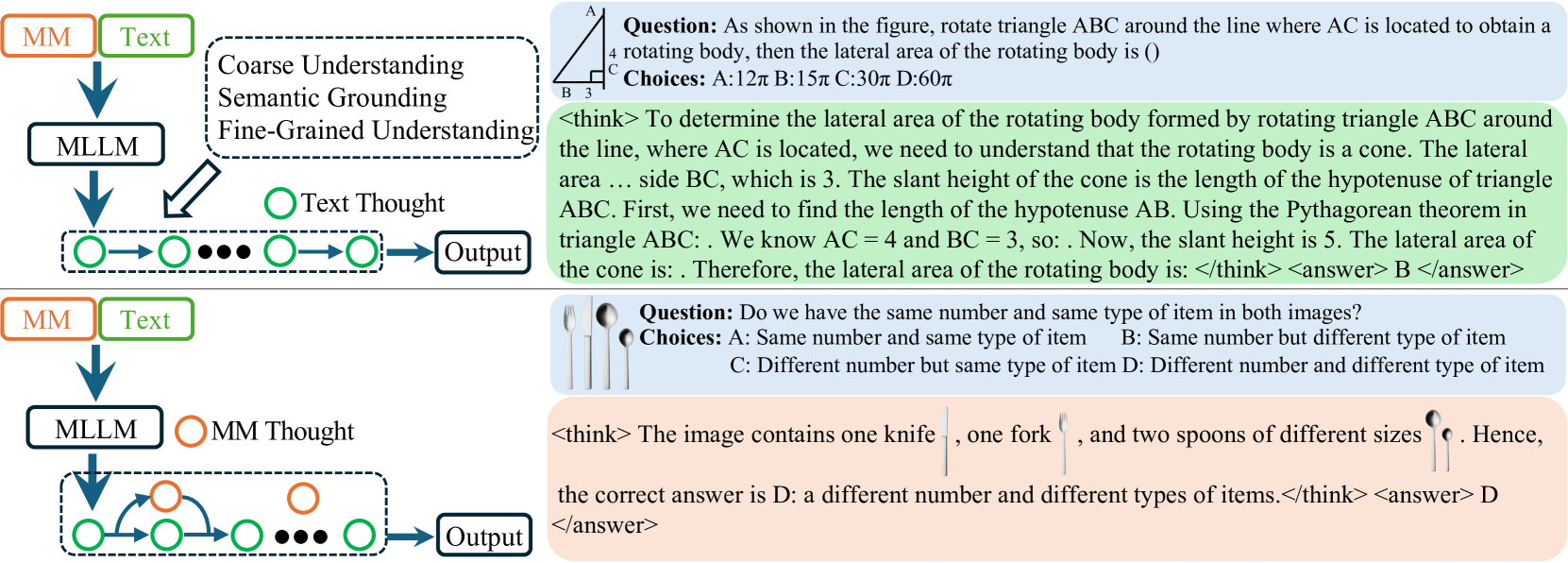

问题定义:论文旨在解决多模态大语言模型(MLLM)在跨模态推理中面临的挑战。现有的MLLM在处理多种模态输入时,难以有效地进行信息融合和推理,导致性能瓶颈。痛点在于如何设计有效的算法和奖励机制,使MLLM能够更好地理解和利用不同模态的信息进行推理。

核心思路:论文的核心思路是利用强化学习(RL)来优化MLLM的推理过程。通过将MLLM的推理过程建模为一个马尔可夫决策过程(MDP),并使用RL算法来学习最优的推理策略。这种方法允许模型通过试错来学习如何更好地利用多模态信息,从而提高推理性能。

技术框架:整体框架包括以下几个主要模块:1) MLLM作为智能体(Agent),负责接收多模态输入并生成推理步骤;2) 环境(Environment)模拟推理过程,并根据智能体的行为给出反馈;3) 奖励函数(Reward Function)用于评估智能体的行为,并引导其学习最优策略;4) RL算法(如Policy Gradient或Q-learning)用于更新智能体的策略。整个流程是一个循环迭代的过程,智能体不断与环境交互,并根据奖励信号调整策略。

关键创新:最重要的技术创新点在于将强化学习与多模态大语言模型相结合,通过优化推理轨迹来提高跨模态推理能力。与传统的监督学习方法不同,RL方法允许模型通过试错来学习,从而更好地适应复杂的跨模态推理任务。此外,论文还关注了奖励机制的设计,提出了多种有效的奖励函数,以引导模型学习更有效的推理策略。

关键设计:关键设计包括:1) 奖励函数的设计,例如使用推理结果的准确性、推理步骤的效率等作为奖励信号;2) RL算法的选择,例如使用Policy Gradient算法来直接优化策略,或使用Q-learning算法来学习价值函数;3) MLLM的架构设计,例如使用Transformer模型来处理多模态输入,并使用注意力机制来融合不同模态的信息。

🖼️ 关键图片

📊 实验亮点

论文对基于强化学习的多模态大语言模型推理进行了全面的综述,总结了现有方法的优缺点,并提出了未来的研究方向。虽然没有提供具体的实验数据,但论文系统性地分析了RL在MLLM推理中的应用,为相关研究人员提供了有价值的参考。

🎯 应用场景

该研究成果可广泛应用于智能问答、图像描述、视频理解等领域。通过提升MLLM的推理能力,可以实现更智能、更自然的跨模态人机交互。例如,在医疗诊断领域,可以利用MLLM分析医学影像和文本报告,辅助医生进行诊断。在自动驾驶领域,可以利用MLLM理解车辆周围环境的多模态信息,提高驾驶安全性。

📄 摘要(原文)

The application of reinforcement learning (RL) to enhance the reasoning capabilities of Multimodal Large Language Models (MLLMs) constitutes a rapidly advancing research area. While MLLMs extend Large Language Models (LLMs) to handle diverse modalities such as vision, audio, and video, enabling robust reasoning across multimodal inputs remains challenging. This paper provides a systematic review of recent advances in RL-based reasoning for MLLMs, covering key algorithmic designs, reward mechanism innovations, and practical applications. We highlight two main RL paradigms, value-model-free and value-model-based methods, and analyze how RL enhances reasoning abilities by optimizing reasoning trajectories and aligning multimodal information. Additionally, we provide an extensive overview of benchmark datasets, evaluation protocols, and current limitations, and propose future research directions to address challenges such as sparse rewards, inefficient cross-modal reasoning, and real-world deployment constraints. Our goal is to provide a comprehensive and structured guide to RL-based multimodal reasoning.