MultiMind: Enhancing Werewolf Agents with Multimodal Reasoning and Theory of Mind

作者: Zheng Zhang, Nuoqian Xiao, Qi Chai, Deheng Ye, Hao Wang

分类: cs.AI

发布日期: 2025-04-25 (更新: 2025-09-14)

备注: Accepted by ACMMM 2025

💡 一句话要点

MultiMind:融合多模态推理和心智理论增强狼人杀AI智能体

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态融合 心智理论 社交推理 狼人杀 大型语言模型

📋 核心要点

- 现有狼人杀AI智能体主要依赖文本信息,忽略了人类交流中重要的面部表情和语调等多模态线索。

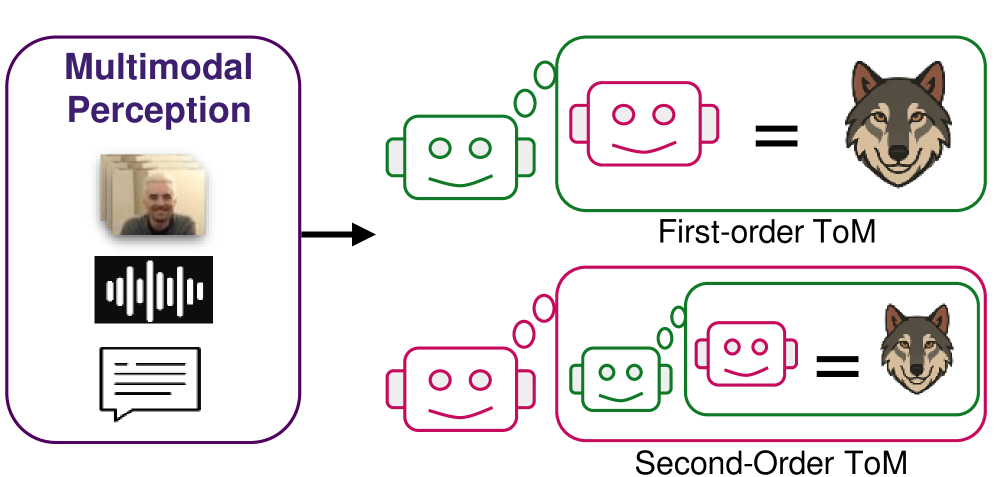

- MultiMind框架融合了面部表情、语调等信息,并结合心智理论建模玩家间的怀疑关系,辅助决策。

- 实验表明,MultiMind在智能体对智能体模拟和与人类玩家的对战中均表现出更优的游戏性能。

📝 摘要(中文)

大型语言模型(LLM)智能体在狼人杀等社交推理游戏中展现了令人印象深刻的能力,这类游戏需要战略推理和社会欺骗。然而,当前的方法主要依赖于文本信息,忽略了人类交流中自然使用的面部表情和语调等关键多模态线索。此外,现有的社交推理游戏智能体主要关注于推断其他玩家的身份,而没有建模其他人如何看待自己或同伴。为了解决这些局限性,我们以“一夜终极狼人杀”(ONUW)为测试平台,提出了MultiMind,这是第一个将多模态信息集成到社交推理游戏智能体中的框架。MultiMind处理面部表情和声音语调以及口头内容,同时采用心智理论(ToM)模型来表示每个玩家对其他人的怀疑程度。通过将此ToM模型与蒙特卡洛树搜索(MCTS)相结合,我们的智能体能够识别出最小化自身被怀疑程度的沟通策略。通过在智能体对智能体模拟和与人类玩家的研究中进行的全面评估,我们证明了MultiMind在游戏玩法中的卓越性能。我们的工作代表了LLM智能体朝着能够在多模态领域进行类人社交推理的重大进步。

🔬 方法详解

问题定义:现有狼人杀AI智能体主要依赖文本信息进行推理,忽略了人类交流中至关重要的多模态信息,如面部表情和语调。此外,现有智能体主要关注于身份推断,缺乏对其他玩家心理状态(即心智理论)的建模,导致策略制定不够完善。

核心思路:MultiMind的核心思路是将多模态信息(面部表情、语调)与文本信息融合,并利用心智理论(Theory of Mind, ToM)建模玩家之间的相互怀疑关系。通过这种方式,智能体可以更全面地理解游戏状态,并制定更有效的沟通策略,从而降低自身被怀疑的概率。

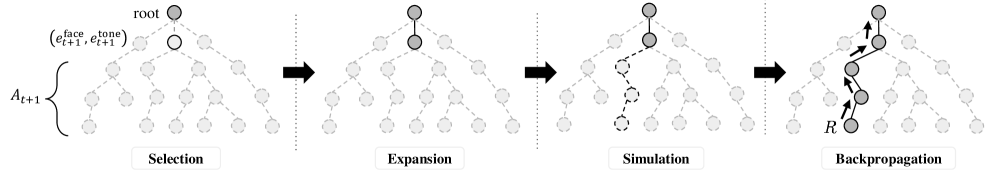

技术框架:MultiMind框架包含以下几个主要模块:1) 多模态信息处理模块:用于提取和处理面部表情和语调等信息。2) 心智理论建模模块:用于构建玩家之间的怀疑关系模型。3) 蒙特卡洛树搜索(MCTS)模块:用于搜索最佳的沟通策略,目标是最小化自身被怀疑的程度。整体流程是,首先通过多模态信息处理模块提取相关特征,然后利用心智理论建模模块更新玩家之间的怀疑关系,最后通过MCTS搜索最佳策略。

关键创新:MultiMind的关键创新在于首次将多模态信息和心智理论结合应用于社交推理游戏智能体。与现有方法相比,MultiMind能够更全面地理解游戏状态,并制定更具策略性的沟通方案。此外,将心智理论与MCTS相结合,使得智能体能够主动地影响其他玩家的心理状态,从而提高胜率。

关键设计:在多模态信息处理方面,具体采用何种模型提取面部表情和语调特征,论文中未详细说明,属于未知信息。心智理论建模模块的具体实现方式也未详细说明,属于未知信息。MCTS模块的关键在于奖励函数的设计,奖励函数的目标是最小化自身被怀疑的程度,具体如何量化怀疑程度,论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

MultiMind在智能体对智能体模拟和与人类玩家的对战中均表现出显著的性能提升。具体提升幅度未给出明确数据,属于未知信息。与仅使用文本信息的基线方法相比,MultiMind能够更有效地欺骗其他玩家,并降低自身被怀疑的概率。与人类玩家的实验结果表明,MultiMind能够更好地理解人类的社交行为,并制定更有效的沟通策略。

🎯 应用场景

MultiMind的研究成果可应用于各种需要社交推理和欺骗的场景,例如人机交互、智能客服、谈判协商等。通过融合多模态信息和心智理论,可以提升AI智能体在复杂社交环境中的表现,使其更具人情味和竞争力。未来,该技术有望应用于更广泛的领域,例如教育、医疗等,辅助人类进行决策和沟通。

📄 摘要(原文)

Large Language Model (LLM) agents have demonstrated impressive capabilities in social deduction games (SDGs) like Werewolf, where strategic reasoning and social deception are essential. However, current approaches remain limited to textual information, ignoring crucial multimodal cues such as facial expressions and tone of voice that humans naturally use to communicate. Moreover, existing SDG agents primarily focus on inferring other players' identities without modeling how others perceive themselves or fellow players. To address these limitations, we use One Night Ultimate Werewolf (ONUW) as a testbed and present MultiMind, the first framework integrating multimodal information into SDG agents. MultiMind processes facial expressions and vocal tones alongside verbal content, while employing a Theory of Mind (ToM) model to represent each player's suspicion levels toward others. By combining this ToM model with Monte Carlo Tree Search (MCTS), our agent identifies communication strategies that minimize suspicion directed at itself. Through comprehensive evaluation in both agent-versus-agent simulations and studies with human players, we demonstrate MultiMind's superior performance in gameplay. Our work presents a significant advancement toward LLM agents capable of human-like social reasoning across multimodal domains.