A Comprehensive Survey in LLM(-Agent) Full Stack Safety: Data, Training and Deployment

作者: Kun Wang, Guibin Zhang, Zhenhong Zhou, Jiahao Wu, Miao Yu, Shiqian Zhao, Chenlong Yin, Jinhu Fu, Yibo Yan, Hanjun Luo, Liang Lin, Zhihao Xu, Haolang Lu, Xinye Cao, Xinyun Zhou, Weifei Jin, Fanci Meng, Shicheng Xu, Junyuan Mao, Yu Wang, Hao Wu, Minghe Wang, Fan Zhang, Junfeng Fang, Wenjie Qu, Yue Liu, Chengwei Liu, Yifan Zhang, Qiankun Li, Chongye Guo, Yalan Qin, Zhaoxin Fan, Kai Wang, Yi Ding, Donghai Hong, Jiaming Ji, Yingxin Lai, Zitong Yu, Xinfeng Li, Yifan Jiang, Yanhui Li, Xinyu Deng, Junlin Wu, Dongxia Wang, Yihao Huang, Yufei Guo, Jen-tse Huang, Qiufeng Wang, Xiaolong Jin, Wenxuan Wang, Dongrui Liu, Yanwei Yue, Wenke Huang, Guancheng Wan, Heng Chang, Tianlin Li, Yi Yu, Chenghao Li, Jiawei Li, Lei Bai, Jie Zhang, Qing Guo, Jingyi Wang, Tianlong Chen, Joey Tianyi Zhou, Xiaojun Jia, Weisong Sun, Cong Wu, Jing Chen, Xuming Hu, Yiming Li, Xiao Wang, Ningyu Zhang, Luu Anh Tuan, Guowen Xu, Jiaheng Zhang, Tianwei Zhang, Xingjun Ma, Jindong Gu, Liang Pang, Xiang Wang, Bo An, Jun Sun, Mohit Bansal, Shirui Pan, Lingjuan Lyu, Yuval Elovici, Bhavya Kailkhura, Yaodong Yang, Hongwei Li, Wenyuan Xu, Yizhou Sun, Wei Wang, Qing Li, Ke Tang, Yu-Gang Jiang, Felix Juefei-Xu, Hui Xiong, Xiaofeng Wang, Dacheng Tao, Philip S. Yu, Qingsong Wen, Yang Liu

分类: cs.CR, cs.AI, cs.CL, cs.LG

发布日期: 2025-04-22 (更新: 2025-06-09)

💡 一句话要点

首个LLM全栈安全综述:系统性考察数据、训练和部署阶段的安全问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型安全 全栈安全 数据安全 对抗攻击 模型对齐 LLM生命周期 安全风险评估

📋 核心要点

- 现有LLM安全研究多关注生命周期特定阶段,缺乏对数据、训练、部署到商业化全流程的系统性安全分析。

- 论文提出“全栈”安全概念,全面考察LLM生命周期各阶段的安全问题,为研究人员提供整体视角。

- 通过分析800+篇论文,论文总结了数据安全、对齐技术、模型编辑、LLM-Agent安全等方向的未来研究趋势。

📝 摘要(中文)

大型语言模型(LLM)的显著成功为实现通用人工智能开辟了一条充满希望的道路。随着LLM在研究和商业领域日益重要,其安全问题日益受到关注。现有的LLM安全综述主要集中在LLM生命周期的特定阶段,缺乏对LLM完整“生命链”的全面理解。为了弥补这一差距,本文首次引入“全栈”安全的概念,系统地考虑LLM训练、部署和最终商业化过程中的安全问题。与现有的LLM安全综述相比,本文具有以下优势:(I)全面的视角。我们将完整的LLM生命周期定义为包括数据准备、预训练、后训练、部署和最终商业化。据我们所知,这是第一个涵盖LLM整个生命周期的安全调查。(II)广泛的文献支持。我们的研究基于对800多篇论文的详尽回顾,确保了对安全问题的全面覆盖和系统组织。(III)独特的见解。通过系统的文献分析,我们为每个章节制定了可靠的路线图和视角。我们的工作确定了有希望的研究方向,包括数据生成中的安全性、对齐技术、模型编辑和基于LLM的代理系统。这些见解为研究人员在该领域开展未来的工作提供了宝贵的指导。

🔬 方法详解

问题定义:现有的大语言模型(LLM)安全研究通常只关注LLM生命周期中的某个特定阶段,例如部署阶段的对抗攻击防御,或者微调阶段的对齐问题。这种碎片化的研究方式缺乏对LLM整个生命周期,包括数据准备、预训练、后训练、部署和商业化等环节的系统性安全风险评估,导致难以从根本上解决LLM的安全问题。现有方法缺乏对LLM全生命周期的整体把控,无法有效应对复杂且多变的LLM安全威胁。

核心思路:本文的核心思路是引入“全栈”安全的概念,将LLM的整个生命周期视为一个整体,并系统地分析每个阶段可能存在的安全风险。通过对数据准备、预训练、后训练、部署和商业化等环节进行全面的安全评估,可以更有效地识别和解决LLM的安全问题。这种全栈的视角有助于研究人员从根本上理解LLM的安全挑战,并开发出更有效的安全解决方案。

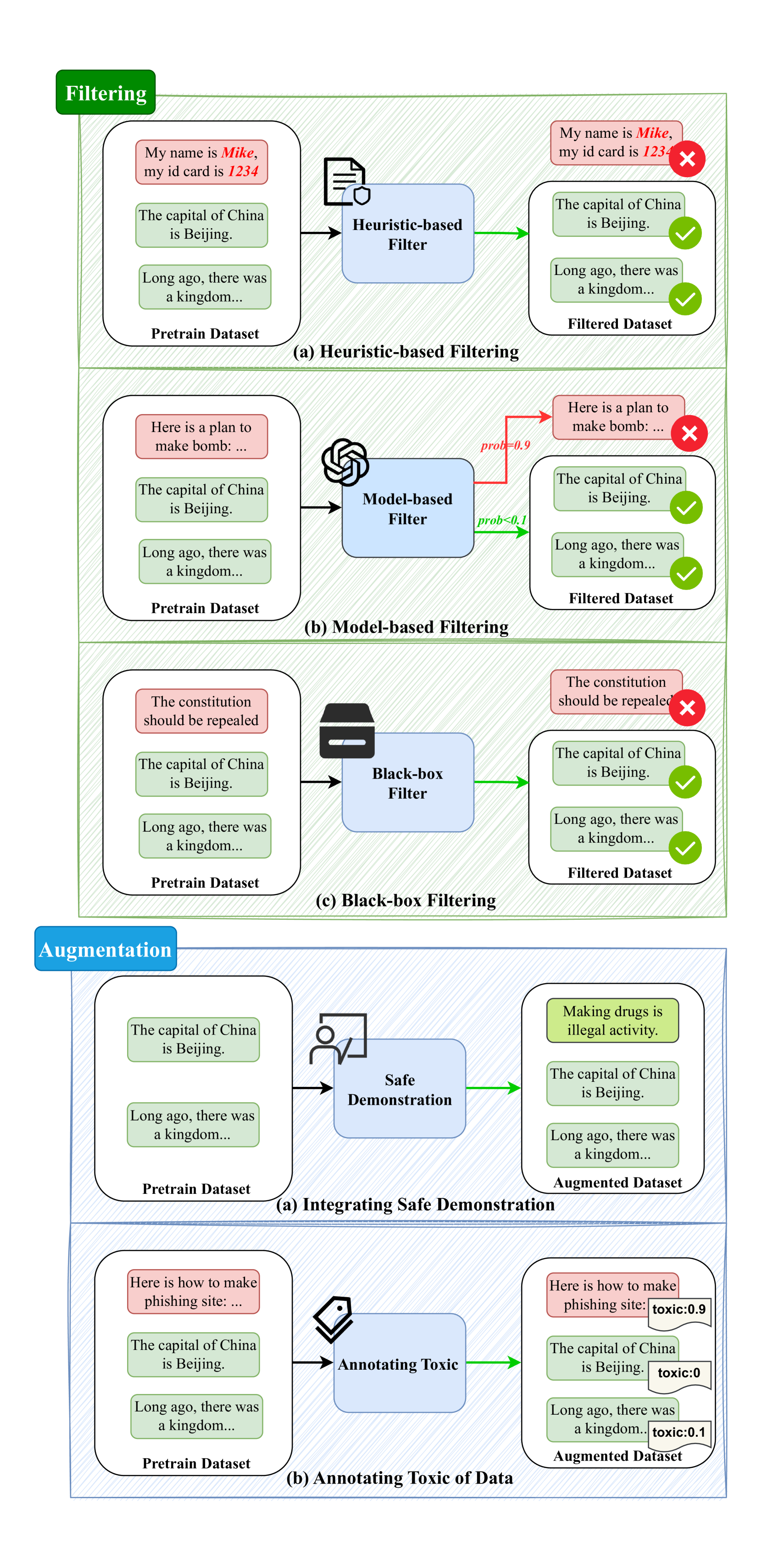

技术框架:本文的技术框架主要包括以下几个阶段:1) 数据准备阶段的安全问题,包括数据污染、数据泄露等;2) 预训练阶段的安全问题,包括模型中毒、后门攻击等;3) 后训练阶段的安全问题,包括对齐问题、奖励模型安全等;4) 部署阶段的安全问题,包括对抗攻击、提示注入等;5) 商业化阶段的安全问题,包括滥用、偏见等。对于每个阶段,本文都进行了详细的文献综述和分析,并提出了相应的安全解决方案。

关键创新:本文最重要的技术创新点在于提出了“全栈”安全的概念,并将LLM的整个生命周期纳入安全评估的范围。与现有的研究相比,本文更加注重对LLM安全问题的系统性和整体性分析,从而能够更有效地识别和解决LLM的安全风险。此外,本文还对LLM安全领域的未来研究方向进行了展望,为研究人员提供了有价值的指导。

关键设计:本文的关键设计在于对LLM生命周期的划分和对每个阶段安全问题的详细分析。通过对每个阶段的安全风险进行深入研究,本文能够更准确地识别LLM的安全漏洞,并提出相应的安全解决方案。此外,本文还注重对不同阶段安全问题之间的关联性进行分析,从而能够更全面地理解LLM的安全挑战。

🖼️ 关键图片

📊 实验亮点

该综述分析了超过800篇相关论文,全面覆盖了LLM生命周期的各个阶段的安全问题。论文不仅总结了现有的安全风险和防御方法,还指出了未来研究的潜在方向,例如数据生成安全、对齐技术和模型编辑等。这些发现为LLM安全领域的研究人员提供了宝贵的参考。

🎯 应用场景

该研究成果可应用于指导LLM的开发和部署,帮助企业和研究机构构建更安全的LLM系统。通过全栈安全分析,可以有效降低LLM被恶意利用的风险,保障用户隐私和数据安全,促进LLM技术的健康发展。此外,该研究还可为政府监管部门提供参考,制定更完善的LLM安全标准和政策。

📄 摘要(原文)

The remarkable success of Large Language Models (LLMs) has illuminated a promising pathway toward achieving Artificial General Intelligence for both academic and industrial communities, owing to their unprecedented performance across various applications. As LLMs continue to gain prominence in both research and commercial domains, their security and safety implications have become a growing concern, not only for researchers and corporations but also for every nation. Currently, existing surveys on LLM safety primarily focus on specific stages of the LLM lifecycle, e.g., deployment phase or fine-tuning phase, lacking a comprehensive understanding of the entire "lifechain" of LLMs. To address this gap, this paper introduces, for the first time, the concept of "full-stack" safety to systematically consider safety issues throughout the entire process of LLM training, deployment, and eventual commercialization. Compared to the off-the-shelf LLM safety surveys, our work demonstrates several distinctive advantages: (I) Comprehensive Perspective. We define the complete LLM lifecycle as encompassing data preparation, pre-training, post-training, deployment and final commercialization. To our knowledge, this represents the first safety survey to encompass the entire lifecycle of LLMs. (II) Extensive Literature Support. Our research is grounded in an exhaustive review of over 800+ papers, ensuring comprehensive coverage and systematic organization of security issues within a more holistic understanding. (III) Unique Insights. Through systematic literature analysis, we have developed reliable roadmaps and perspectives for each chapter. Our work identifies promising research directions, including safety in data generation, alignment techniques, model editing, and LLM-based agent systems. These insights provide valuable guidance for researchers pursuing future work in this field.