Mitigating Degree Bias in Graph Representation Learning with Learnable Structural Augmentation and Structural Self-Attention

作者: Van Thuy Hoang, Hyeon-Ju Jeon, O-Joun Lee

分类: cs.AI, cs.LG

发布日期: 2025-04-21

备注: Accepted at IEEE TNSE

💡 一句话要点

DegFairGT:通过可学习结构增强和结构自注意力缓解图表示学习中的度偏差

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 图神经网络 度偏差 图表示学习 结构增强 自注意力机制 自监督学习 长尾分布

📋 核心要点

- 图神经网络在处理长尾度分布图时,由于高学位节点主导消息传递,导致低学位节点表示不足,产生度偏差。

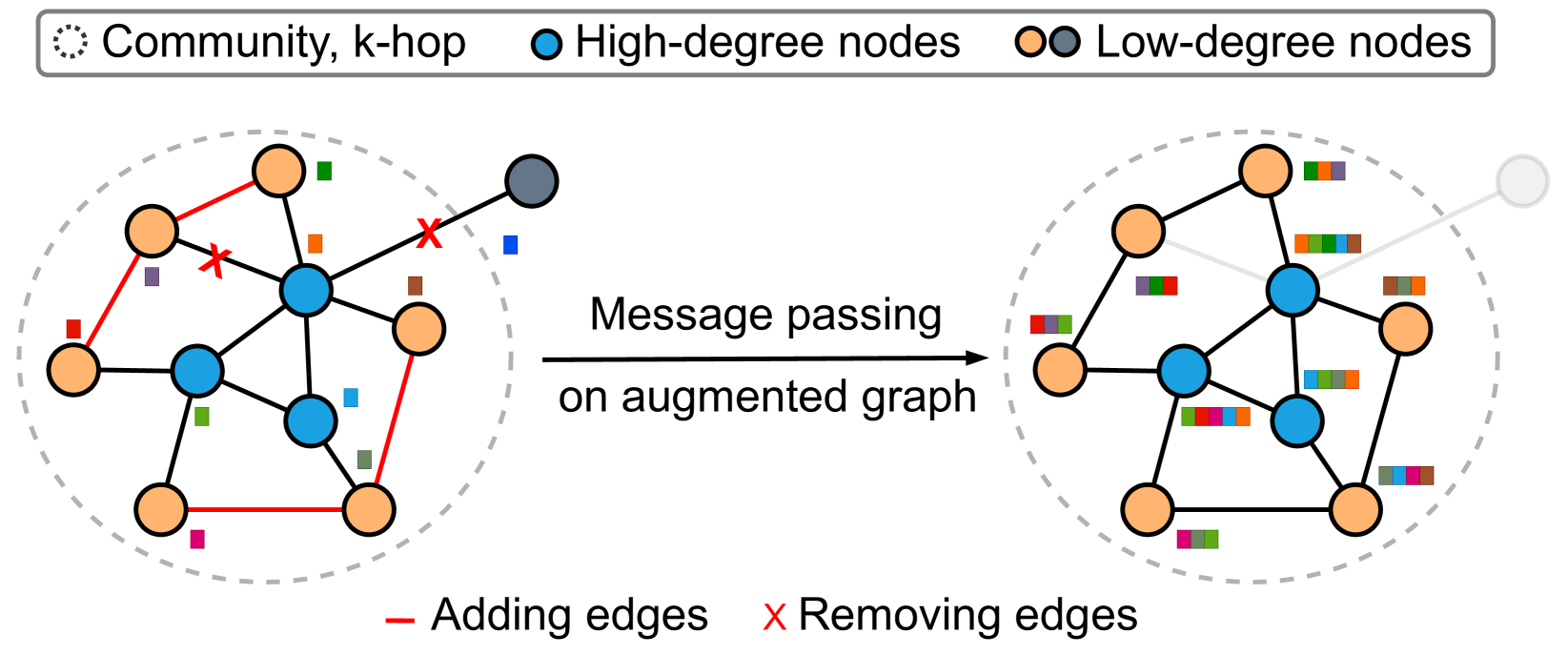

- DegFairGT通过可学习的结构增强发现非相邻节点间的结构相似性,为低学位节点提供信息丰富的消息,同时减少高学位节点的过度消息。

- 实验结果表明,DegFairGT在度公平性、节点分类和节点聚类任务中均优于现有方法,证明了其有效性。

📝 摘要(中文)

图神经网络(GNNs)通过消息传递更新节点表示,主要基于同质性原则,假设相邻节点具有相似的特征。然而,在具有长尾度分布的真实世界图中,高学位节点主导消息传递,导致度偏差,低学位节点由于消息不足而表示不足。解决度偏差的主要挑战是如何发现非相邻节点,为低学位节点提供额外的消息,同时减少高学位节点的过度消息。然而,利用非相邻节点来提供有价值的消息具有挑战性,因为它可能产生噪声信息并破坏原始图结构。为了解决这个问题,我们提出了一种新的度公平图Transformer,名为DegFairGT,通过可学习的结构增强和结构自注意力来缓解度偏差,通过发现非相邻节点之间的结构相似性。我们的核心思想是利用在同一社区中具有相似角色的非相邻节点,在我们的增强下生成信息丰富的边,这可以在具有相似角色的节点之间提供信息丰富的消息,同时确保同质性原则在社区内得到维护。为了使DegFairGT能够学习这种结构相似性,我们提出了一种结构自注意力来捕获节点对之间的相似性。为了保持全局图结构并防止图增强阻碍图结构,我们提出了一种自监督学习任务来保持p步转移概率并规范图增强。在六个数据集上的大量实验表明,DegFairGT在度公平性分析、节点分类和节点聚类任务中优于最先进的基线。

🔬 方法详解

问题定义:图神经网络在处理具有长尾度分布的图数据时,存在严重的度偏差问题。高学位节点接收和传递大量信息,导致其表示过度优化,而低学位节点由于接收到的信息不足,表示学习不充分。现有方法难以有效平衡不同度节点之间的信息传递,导致模型性能下降,尤其是在需要公平对待所有节点的任务中。

核心思路:DegFairGT的核心思路是通过学习图的结构信息,在非相邻节点之间建立联系,从而为低学位节点引入更多信息。该方法认为,即使两个节点不直接相连,如果它们在图结构中扮演相似的角色(例如,在同一社区中),它们之间也可能存在有用的信息。通过增强图结构,可以缓解度偏差,提高模型性能。

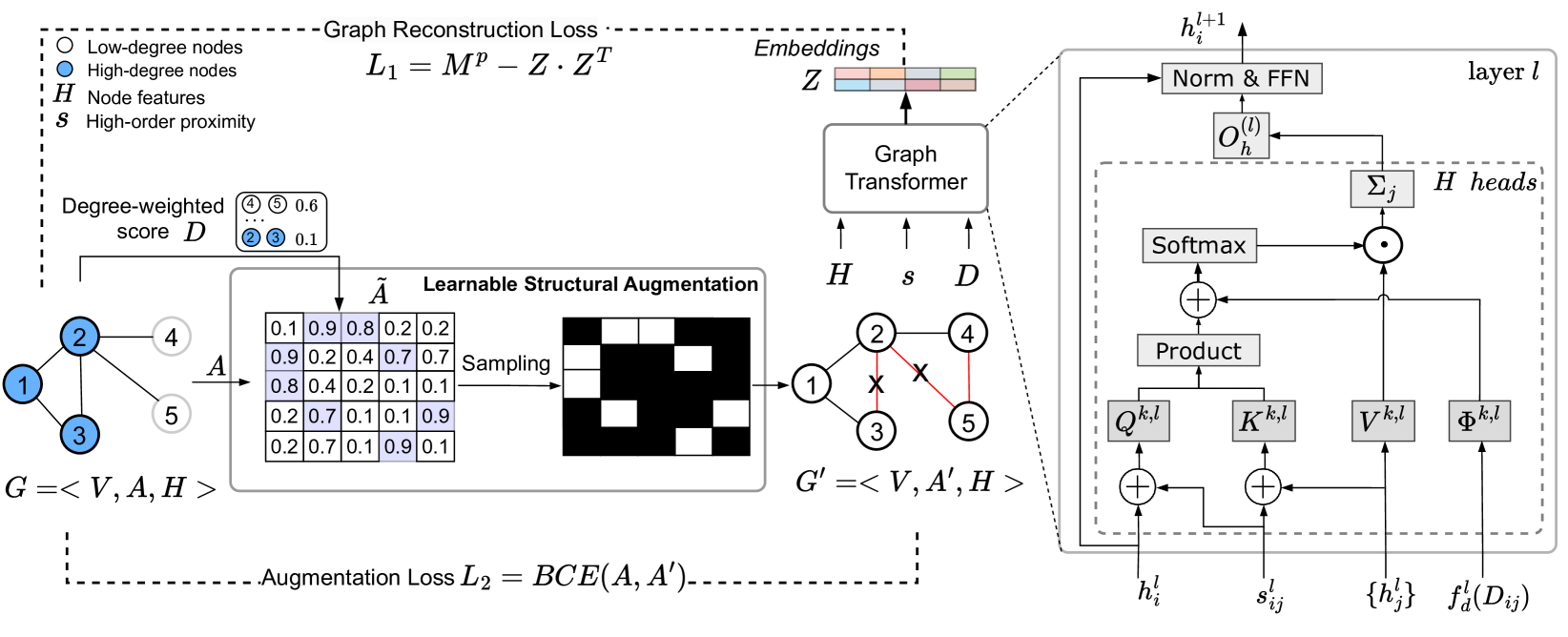

技术框架:DegFairGT包含以下主要模块:1) 可学习结构增强:学习如何添加新的边,连接在结构上相似但非相邻的节点。2) 结构自注意力:用于学习节点对之间的结构相似性,指导结构增强过程。3) 图神经网络层:利用增强后的图结构进行节点表示学习。4) 自监督学习:通过保持p步转移概率来约束图增强,防止破坏原始图结构。

关键创新:DegFairGT的关键创新在于其可学习的结构增强方法和结构自注意力机制。与传统的图增强方法不同,DegFairGT不是随机地添加边,而是根据节点之间的结构相似性来添加边,从而更有针对性地为低学位节点引入信息。结构自注意力机制能够有效地学习节点之间的结构关系,指导结构增强过程。

关键设计:DegFairGT使用一个可学习的矩阵来表示节点之间的结构相似性。结构自注意力机制基于该矩阵计算节点之间的注意力权重,用于指导消息传递和结构增强。自监督学习任务通过最小化增强前后图的p步转移概率之间的差异来约束图增强。损失函数包括节点分类损失、自监督学习损失和正则化项。

🖼️ 关键图片

📊 实验亮点

DegFairGT在六个数据集上进行了广泛的实验,包括度公平性分析、节点分类和节点聚类任务。实验结果表明,DegFairGT在所有任务中均优于最先进的基线方法。例如,在节点分类任务中,DegFairGT相比于表现最佳的基线方法,平均提升了2-5%。度公平性分析表明,DegFairGT能够有效缓解度偏差,提高低学位节点的表示质量。

🎯 应用场景

DegFairGT可应用于各种图结构数据分析任务,例如社交网络分析、推荐系统、生物信息学等。在社交网络中,可以用于识别社区结构和影响力传播;在推荐系统中,可以用于提高对冷启动用户的推荐准确率;在生物信息学中,可以用于预测蛋白质之间的相互作用。该研究有助于提升图神经网络在处理不平衡图数据时的性能和公平性。

📄 摘要(原文)

Graph Neural Networks (GNNs) update node representations through message passing, which is primarily based on the homophily principle, assuming that adjacent nodes share similar features. However, in real-world graphs with long-tailed degree distributions, high-degree nodes dominate message passing, causing a degree bias where low-degree nodes remain under-represented due to inadequate messages. The main challenge in addressing degree bias is how to discover non-adjacent nodes to provide additional messages to low-degree nodes while reducing excessive messages for high-degree nodes. Nevertheless, exploiting non-adjacent nodes to provide valuable messages is challenging, as it could generate noisy information and disrupt the original graph structures. To solve it, we propose a novel Degree Fairness Graph Transformer, named DegFairGT, to mitigate degree bias by discovering structural similarities between non-adjacent nodes through learnable structural augmentation and structural self-attention. Our key idea is to exploit non-adjacent nodes with similar roles in the same community to generate informative edges under our augmentation, which could provide informative messages between nodes with similar roles while ensuring that the homophily principle is maintained within the community. To enable DegFairGT to learn such structural similarities, we then propose a structural self-attention to capture the similarities between node pairs. To preserve global graph structures and prevent graph augmentation from hindering graph structure, we propose a Self-Supervised Learning task to preserve p-step transition probability and regularize graph augmentation. Extensive experiments on six datasets showed that DegFairGT outperformed state-of-the-art baselines in degree fairness analysis, node classification, and node clustering tasks.