High-Throughput LLM inference on Heterogeneous Clusters

作者: Yi Xiong, Jinqi Huang, Wenjie Huang, Xuebing Yu, Entong Li, Zhixiong Ning, Jinhua Zhou, Li Zeng, Xin Chen

分类: cs.DC, cs.AI

发布日期: 2025-04-18

💡 一句话要点

提出异构集群上的高吞吐量LLM推理服务系统,优化部署配置和请求调度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 异构集群 LLM推理 高吞吐量 请求调度 资源优化

📋 核心要点

- 异构集群上LLM推理面临配置优化和请求调度两大难题,现有方法难以兼顾性能和效率。

- 通过建模资源和吞吐量,采用穷举搜索优化配置,并设计考虑实例能力的请求调度机制。

- 实验表明,该系统在异构集群上显著提升了LLM推理的吞吐量,最高提升达122.5%。

📝 摘要(中文)

本文提出了一种在异构集群上实现高吞吐量大型语言模型(LLM)推理服务的系统。该系统旨在有效利用各种类型的AI加速器,从而降低成本并加速任务处理。异构集群上的LLM推理面临两大挑战:一是不同部署配置导致性能差异巨大,难以找到最优配置;二是集群内推理实例的处理能力各异,难以设计充分利用每个实例潜力的请求调度算法。本文通过建模资源量和预期吞吐量,并采用穷举搜索方法优化部署配置。此外,还提出了一种新的请求调度机制,充分考虑了不同实例的处理能力。实验结果表明,所提出的调度器在两个异构集群上分别提高了122.5%和33.6%的吞吐量。

🔬 方法详解

问题定义:论文旨在解决异构集群上LLM推理服务中,如何最大化吞吐量的问题。现有方法在异构环境下难以找到最优的部署配置,并且无法充分利用不同实例的处理能力,导致资源浪费和性能瓶颈。寻找最优配置的搜索空间巨大,评估特定配置的有效性也很复杂。

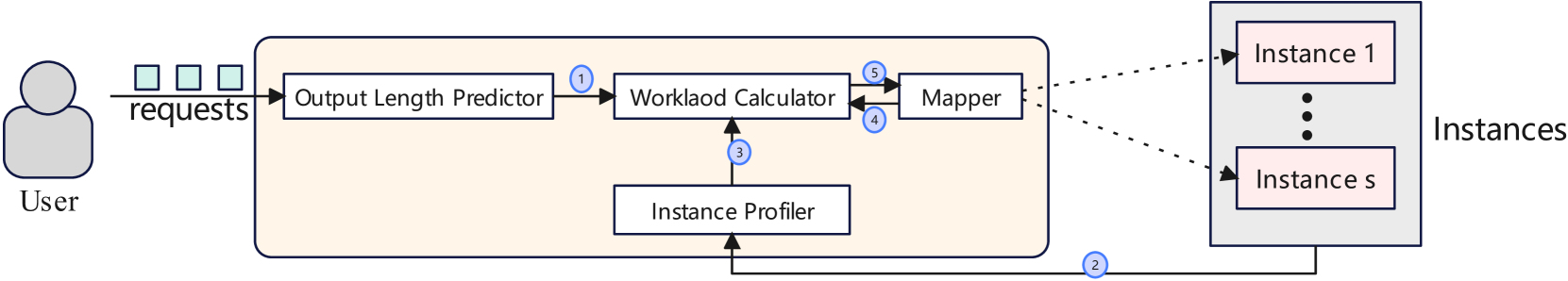

核心思路:论文的核心思路是首先通过建模资源量和预期吞吐量来优化部署配置,然后设计一种新的请求调度机制,该机制能够根据不同实例的处理能力动态地分配推理请求,从而充分利用异构集群的计算资源。

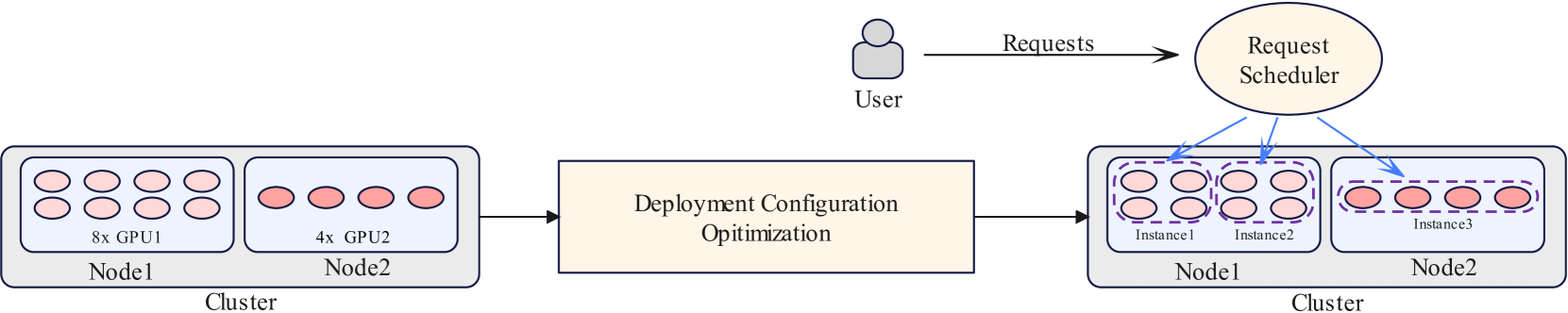

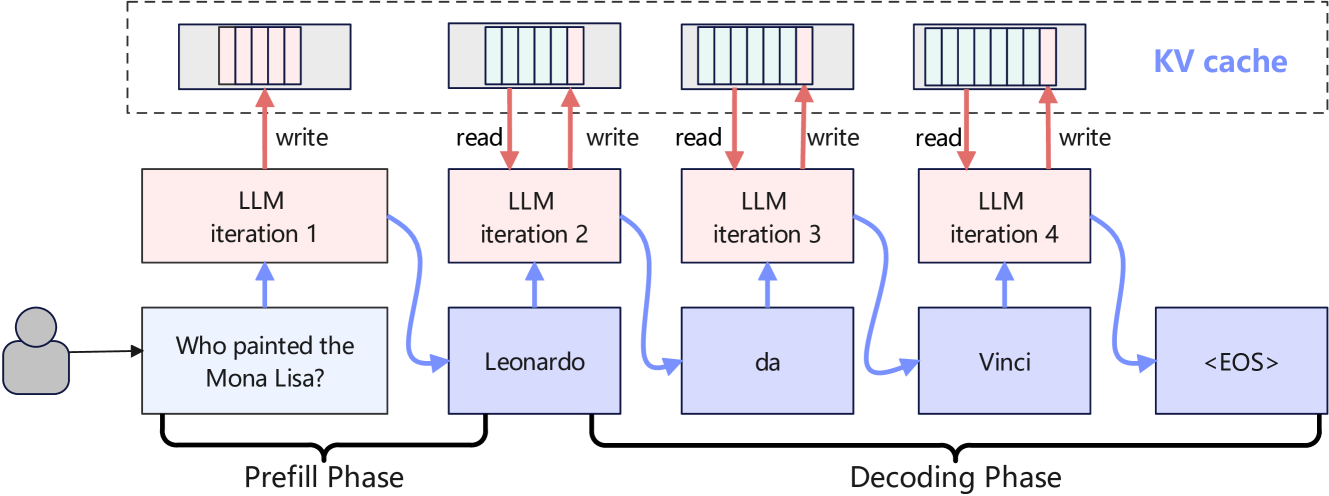

技术框架:该系统主要包含两个阶段:部署配置优化和请求调度。在部署配置优化阶段,系统会根据集群的资源情况,通过穷举搜索的方式,找到最优的部署方案。在请求调度阶段,系统会根据各个实例的处理能力,动态地将推理请求分配给不同的实例。整体流程是先确定最佳部署,再根据实例能力智能调度请求。

关键创新:该论文的关键创新在于提出了一种新的请求调度机制,该机制能够充分考虑不同实例的处理能力。传统的调度方法通常假设所有实例的处理能力相同,或者简单地根据实例的负载情况进行调度,而该论文提出的方法能够更准确地评估每个实例的处理能力,并根据评估结果进行调度。

关键设计:在部署配置优化阶段,论文通过建模资源量(例如GPU数量、内存大小)和预期吞吐量之间的关系,构建了一个优化问题。然后,采用穷举搜索的方法,找到最优的部署配置。在请求调度阶段,论文设计了一种基于实例处理能力的调度算法,该算法会根据每个实例的处理能力动态地调整请求分配比例。具体的参数设置和损失函数等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该系统在两个不同的异构集群上分别实现了122.5%和33.6%的吞吐量提升。与传统的调度方法相比,该系统能够更有效地利用异构集群的计算资源,从而显著提升LLM推理的性能。这些结果验证了所提出的部署配置优化和请求调度机制的有效性。

🎯 应用场景

该研究成果可应用于各种拥有异构计算集群的企业和研究机构,用于部署高性能、低成本的LLM推理服务。通过优化资源配置和请求调度,可以显著提升LLM的应用效率,加速AI在各个领域的落地,例如智能客服、内容生成、代码辅助等。

📄 摘要(原文)

Nowadays, many companies possess various types of AI accelerators, forming heterogeneous clusters. Efficiently leveraging these clusters for high-throughput large language model (LLM) inference services can significantly reduce costs and expedite task processing. However, LLM inference on heterogeneous clusters presents two main challenges. Firstly, different deployment configurations can result in vastly different performance. The number of possible configurations is large, and evaluating the effectiveness of a specific setup is complex. Thus, finding an optimal configuration is not an easy task. Secondly, LLM inference instances within a heterogeneous cluster possess varying processing capacities, leading to different processing speeds for handling inference requests. Evaluating these capacities and designing a request scheduling algorithm that fully maximizes the potential of each instance is challenging. In this paper, we propose a high-throughput inference service system on heterogeneous clusters. First, the deployment configuration is optimized by modeling the resource amount and expected throughput and using the exhaustive search method. Second, a novel mechanism is proposed to schedule requests among instances, which fully considers the different processing capabilities of various instances. Extensive experiments show that the proposed scheduler improves throughput by 122.5% and 33.6% on two heterogeneous clusters, respectively.