Think Deep, Think Fast: Investigating Efficiency of Verifier-free Inference-time-scaling Methods

作者: Junlin Wang, Shang Zhu, Jon Saad-Falcon, Ben Athiwaratkun, Qingyang Wu, Jue Wang, Shuaiwen Leon Song, Ce Zhang, Bhuwan Dhingra, James Zou

分类: cs.AI

发布日期: 2025-04-18

💡 一句话要点

研究无验证器推理时缩放方法在LLM推理和非推理模型上的效率

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 推理时计算 推理能力 无验证器 帕累托前沿

📋 核心要点

- 现有推理时计算方法缺乏对不同模型和推理任务的深入分析,难以指导LLM的进一步发展。

- 本文通过构建质量和效率的帕累托前沿,研究了无验证器的推理时缩放方法在推理和非推理模型上的表现。

- 实验表明,多数投票法在推理模型中表现稳健,且响应特征与质量相关,可用于改进现有方法。

📝 摘要(中文)

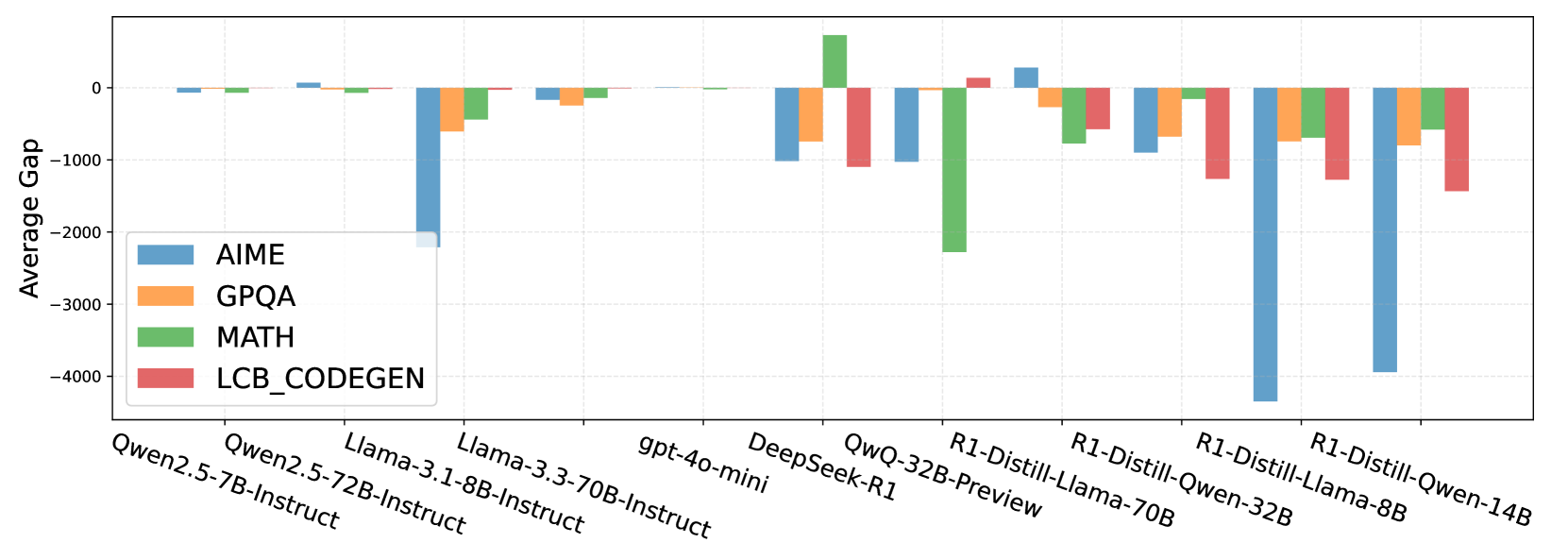

本文深入研究了推理时计算(ITC)(例如,重复采样、改进等)如何提升大型语言模型(LLM)的能力。同时,诸如Deepseek-R1等推理模型的突破,为利用强化学习提升LLM的推理能力提供了机会。深入理解ITC如何与不同模型的推理能力相互作用,对进一步推进LLM的发展至关重要。本文对推理和非推理模型在具有挑战性的推理任务上,进行了全面的推理时缩放方法分析。特别地,我们关注于无需验证器的推理时缩放方法,因为它具有更强的泛化能力,无需奖励模型。我们构建了质量和效率的帕累托前沿。研究发现,即使具有极高的推理预算,非推理模型仍然远落后于推理模型。对于推理模型,多数投票法是一种稳健的推理策略,通常与其他更复杂的ITC方法(如best-of-N和顺序修订)相比具有竞争力或更优,而额外的推理计算提供的改进最小。我们进一步深入分析了关键响应特征(长度和语言标记)与响应质量之间的关联,并利用这些关联来改进现有的ITC方法。我们发现,推理模型的正确响应通常比不正确的响应更短,并且具有更少的对冲和思考标记(但具有更多的语篇标记)。

🔬 方法详解

问题定义:论文旨在研究如何通过推理时计算(ITC)方法,提升大型语言模型(LLM)在推理任务上的性能。现有方法的痛点在于,缺乏对不同模型(推理模型和非推理模型)以及不同ITC策略的系统性分析,难以确定最佳的推理策略和计算预算,并且很多方法依赖于奖励模型进行验证,泛化性较差。

核心思路:论文的核心思路是通过构建质量和效率的帕累托前沿,来评估不同ITC方法在不同模型上的表现。重点关注无需验证器的ITC方法,避免对奖励模型的依赖。通过分析响应的长度、语言标记等特征与响应质量的关联,来改进现有的ITC方法。

技术框架:论文的整体框架包括以下几个步骤:1)选择推理和非推理LLM;2)在具有挑战性的推理任务上评估不同的ITC方法,包括多数投票、best-of-N和顺序修订等;3)构建质量和效率的帕累托前沿,分析不同模型的性能;4)分析响应的长度、语言标记等特征与响应质量的关联;5)利用这些关联来改进现有的ITC方法。

关键创新:论文的关键创新点在于:1)系统性地比较了不同ITC方法在推理和非推理模型上的表现,揭示了推理模型在推理任务上的优势;2)提出了基于响应特征的ITC方法改进策略,无需依赖奖励模型;3)强调了多数投票法在推理模型中的稳健性。

关键设计:论文的关键设计包括:1)选择具有代表性的推理模型(如Deepseek-R1)和非推理模型;2)使用具有挑战性的推理任务,例如需要多步推理的数学问题;3)采用无需验证器的ITC方法,例如多数投票、best-of-N和顺序修订;4)分析响应的长度、对冲标记、思考标记和语篇标记等特征与响应质量的关联;5)使用帕累托前沿来评估不同ITC方法的质量和效率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,非推理模型即使在极高的推理预算下,性能仍然远低于推理模型。对于推理模型,多数投票法是一种稳健的推理策略,与其他更复杂的ITC方法相比具有竞争力或更优。此外,研究发现推理模型的正确响应通常比不正确的响应更短,并且具有更少的对冲和思考标记,但具有更多的语篇标记。利用这些特征可以改进现有的ITC方法。

🎯 应用场景

该研究成果可应用于提升大型语言模型在各种推理任务中的性能,例如数学问题求解、逻辑推理、常识推理等。通过选择合适的推理策略和计算预算,可以提高LLM的准确性和效率。此外,基于响应特征的ITC方法改进策略,可以降低对奖励模型的依赖,提高模型的泛化能力。未来的研究可以探索更多有效的响应特征和更智能的ITC策略。

📄 摘要(原文)

There is intense interest in investigating how inference time compute (ITC) (e.g. repeated sampling, refinements, etc) can improve large language model (LLM) capabilities. At the same time, recent breakthroughs in reasoning models, such as Deepseek-R1, unlock the opportunity for reinforcement learning to improve LLM reasoning skills. An in-depth understanding of how ITC interacts with reasoning across different models could provide important guidance on how to further advance the LLM frontier. This work conducts a comprehensive analysis of inference-time scaling methods for both reasoning and non-reasoning models on challenging reasoning tasks. Specifically, we focus our research on verifier-free inference time-scaling methods due to its generalizability without needing a reward model. We construct the Pareto frontier of quality and efficiency. We find that non-reasoning models, even with an extremely high inference budget, still fall substantially behind reasoning models. For reasoning models, majority voting proves to be a robust inference strategy, generally competitive or outperforming other more sophisticated ITC methods like best-of-N and sequential revisions, while the additional inference compute offers minimal improvements. We further perform in-depth analyses of the association of key response features (length and linguistic markers) with response quality, with which we can improve the existing ITC methods. We find that correct responses from reasoning models are typically shorter and have fewer hedging and thinking markers (but more discourse markers) than the incorrect responses.