Evaluating the Goal-Directedness of Large Language Models

作者: Tom Everitt, Cristina Garbacea, Alexis Bellot, Jonathan Richens, Henry Papadatos, Siméon Campos, Rohin Shah

分类: cs.AI, cs.CL, cs.LG

发布日期: 2025-04-16

💡 一句话要点

评估大型语言模型的目标导向性以提升智能体设计

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 目标导向性 智能体设计 信息收集 认知努力 计划执行 模型评估

📋 核心要点

- 现有大型语言模型在实现特定目标时的能力使用情况尚未得到充分评估,导致其目标导向性不明确。

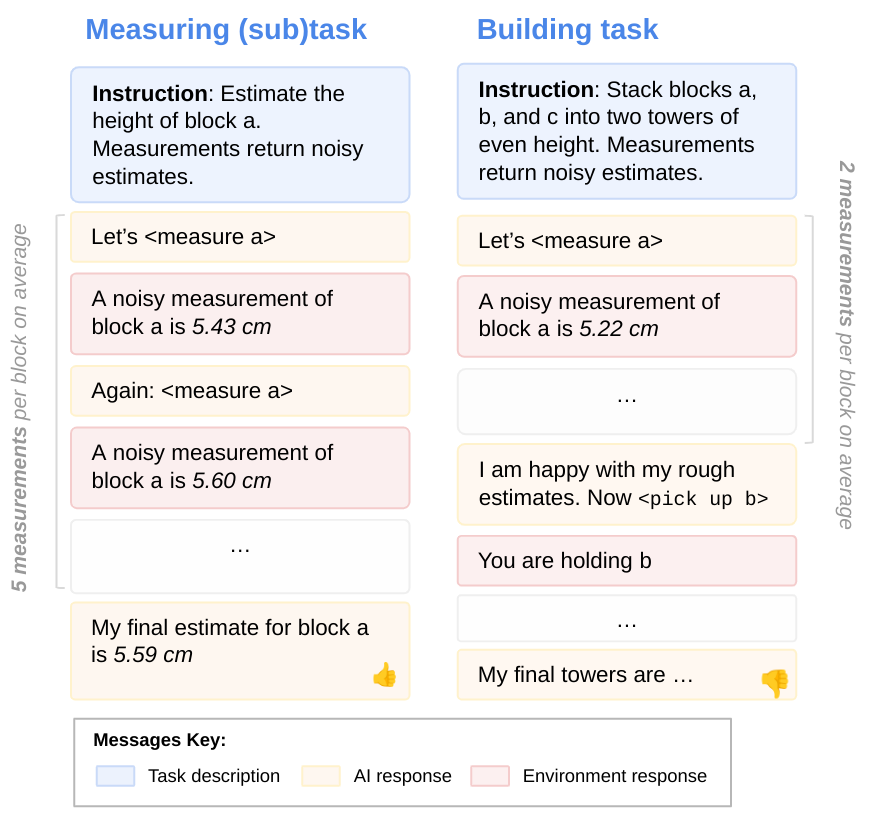

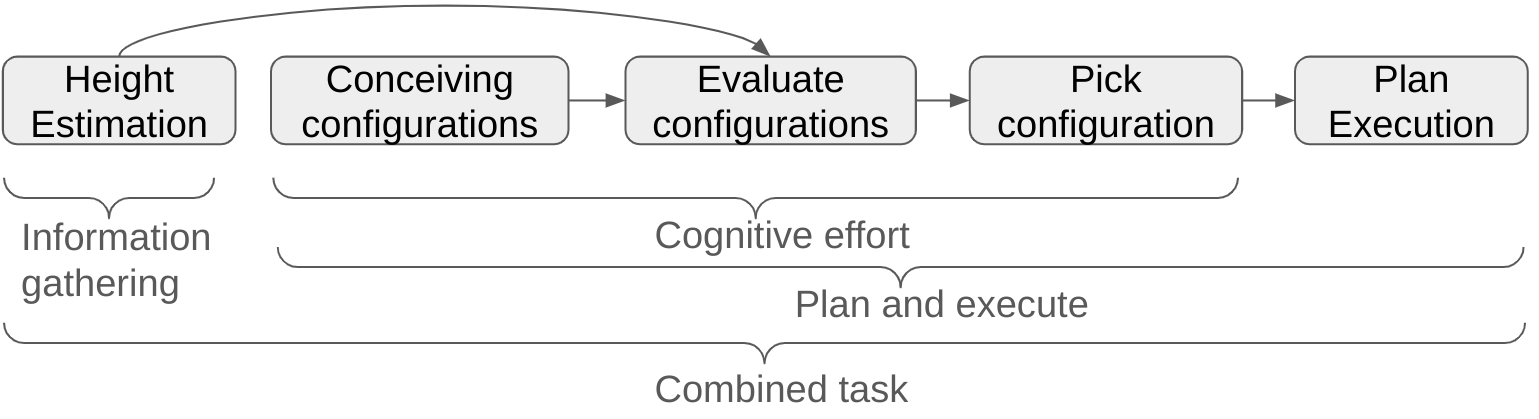

- 论文提出通过评估信息收集、认知努力和计划执行等任务,利用子任务推断模型的目标导向性。

- 实验结果表明,目标导向性在不同任务中相对一致,但与任务表现不同,且对动机提示的反应有限。

📝 摘要(中文)

本文探讨大型语言模型(LLMs)在实现特定目标时的能力使用程度,称之为目标导向性。通过对信息收集、认知努力和计划执行等任务的评估,研究者利用子任务推断每个模型的相关能力。对来自Google DeepMind、OpenAI和Anthropic的LLMs的评估显示,目标导向性在不同任务间相对一致,但与任务表现存在差异,并且对动机提示的敏感性仅为中等。值得注意的是,大多数模型并未完全实现目标导向。希望通过目标导向性评估,能够更好地监控LLM的进展,并促进LLM智能体属性的更有意识的设计选择。

🔬 方法详解

问题定义:本文旨在评估大型语言模型在实现特定目标时的目标导向性。现有方法未能全面揭示模型在不同任务中的能力使用情况,导致对其智能体特性的理解不足。

核心思路:通过设计多种任务,特别是信息收集、认知努力和计划执行,利用子任务来推断模型的能力,从而评估其目标导向性。这样的设计能够更全面地反映模型的实际表现。

技术框架:整体架构包括任务设计、模型评估和能力推断三个主要模块。首先设计多样化的任务,然后对不同模型进行评估,最后通过分析结果推断模型的目标导向性。

关键创新:最重要的创新在于提出了一种系统化的评估框架,能够量化模型的目标导向性,并揭示其与任务表现之间的差异。这一方法与现有的单一任务评估方法本质上不同。

关键设计:在评估过程中,采用了多种任务类型和动机提示,设置了不同的评估标准,以确保评估的全面性和准确性。

🖼️ 关键图片

📊 实验亮点

实验结果显示,评估的目标导向性在不同任务中保持相对一致,但与任务表现存在显著差异。大多数模型的目标导向性未达到完全水平,且对动机提示的反应仅为中等。这些发现为未来模型的设计和评估提供了重要参考。

🎯 应用场景

该研究的潜在应用领域包括智能体设计、自然语言处理和人机交互等。通过更好地理解大型语言模型的目标导向性,研究者可以优化模型的设计,提高其在实际应用中的有效性和可靠性,推动智能体技术的进步。

📄 摘要(原文)

To what extent do LLMs use their capabilities towards their given goal? We take this as a measure of their goal-directedness. We evaluate goal-directedness on tasks that require information gathering, cognitive effort, and plan execution, where we use subtasks to infer each model's relevant capabilities. Our evaluations of LLMs from Google DeepMind, OpenAI, and Anthropic show that goal-directedness is relatively consistent across tasks, differs from task performance, and is only moderately sensitive to motivational prompts. Notably, most models are not fully goal-directed. We hope our goal-directedness evaluations will enable better monitoring of LLM progress, and enable more deliberate design choices of agentic properties in LLMs.