Hierarchical Knowledge Graphs for Story Understanding in Visual Narratives

作者: Yi-Chun Chen

分类: cs.MM, cs.AI, cs.CV

发布日期: 2025-04-14 (更新: 2025-11-15)

备注: Updated with the ICIDS 2025 camera-ready version. This revision includes the final title, updated abstract, improved explanations of the narrative coherence framework, and minor editorial changes. Figures and examples have been refined for clarity. No new experiments were added

💡 一句话要点

提出层级知识图谱框架,用于视觉叙事中的故事结构化语义理解

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉叙事 知识图谱 层级结构 漫画理解 语义理解

📋 核心要点

- 现有方法在视觉叙事理解中缺乏对故事结构化语义的有效建模,难以进行深层次的推理和分析。

- 构建层级知识图谱,从面板、事件到宏事件,整合语义、空间和时间关系,实现多层次的叙事内容表示。

- 在漫画数据集上验证了框架在动作检索、对话追踪等任务中的有效性,强调可解释性和与认知理论的对齐。

📝 摘要(中文)

本文提出了一种层级知识图谱框架,用于对视觉叙事进行结构化的语义理解,以漫画作为多模态故事讲述的代表领域。该框架通过整合编码语义、空间和时间关系的符号图,在三个层级(面板、事件和宏事件)组织叙事内容。在面板层,它对视觉元素(如人物、物体和动作)以及文本组件(包括对话和叙述)进行建模。这些元素系统地连接到更高层级的图,以捕获叙事序列和抽象的故事结构。该框架应用于Manga109数据集的手动标注子集,支持跨四个代表性任务的可解释符号推理:动作检索、对话追踪、人物外观映射和时间线重建。该系统侧重于叙事建模的透明性,并支持与事件分割和视觉故事讲述的认知理论相一致的结构化推理,而非优先考虑预测性能。这项工作有助于可解释的叙事分析,并为创作工具、叙事理解系统和交互式媒体应用奠定基础。

🔬 方法详解

问题定义:现有视觉叙事理解方法难以捕捉故事的深层语义结构和事件之间的关系,导致在复杂推理任务中表现不佳。缺乏对叙事内容的多层次抽象表示,限制了对故事整体理解的深度。现有方法通常侧重于预测性能,而忽略了模型的可解释性和与人类认知过程的对齐。

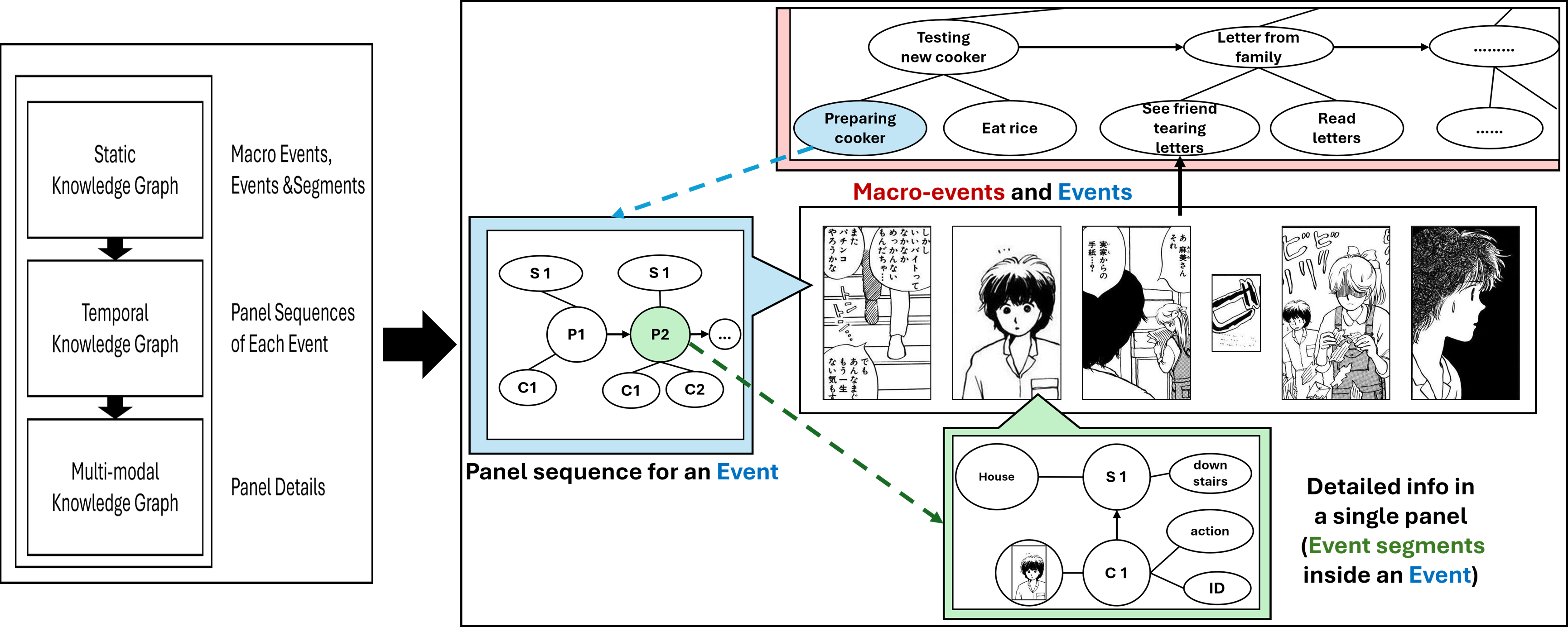

核心思路:通过构建层级知识图谱,将视觉叙事分解为面板、事件和宏事件三个层级,并在每个层级上构建符号图来表示语义、空间和时间关系。这种分层结构能够捕捉不同粒度的叙事信息,并支持跨层级的推理和分析。强调知识图谱的符号表示,以提高模型的可解释性和透明度。

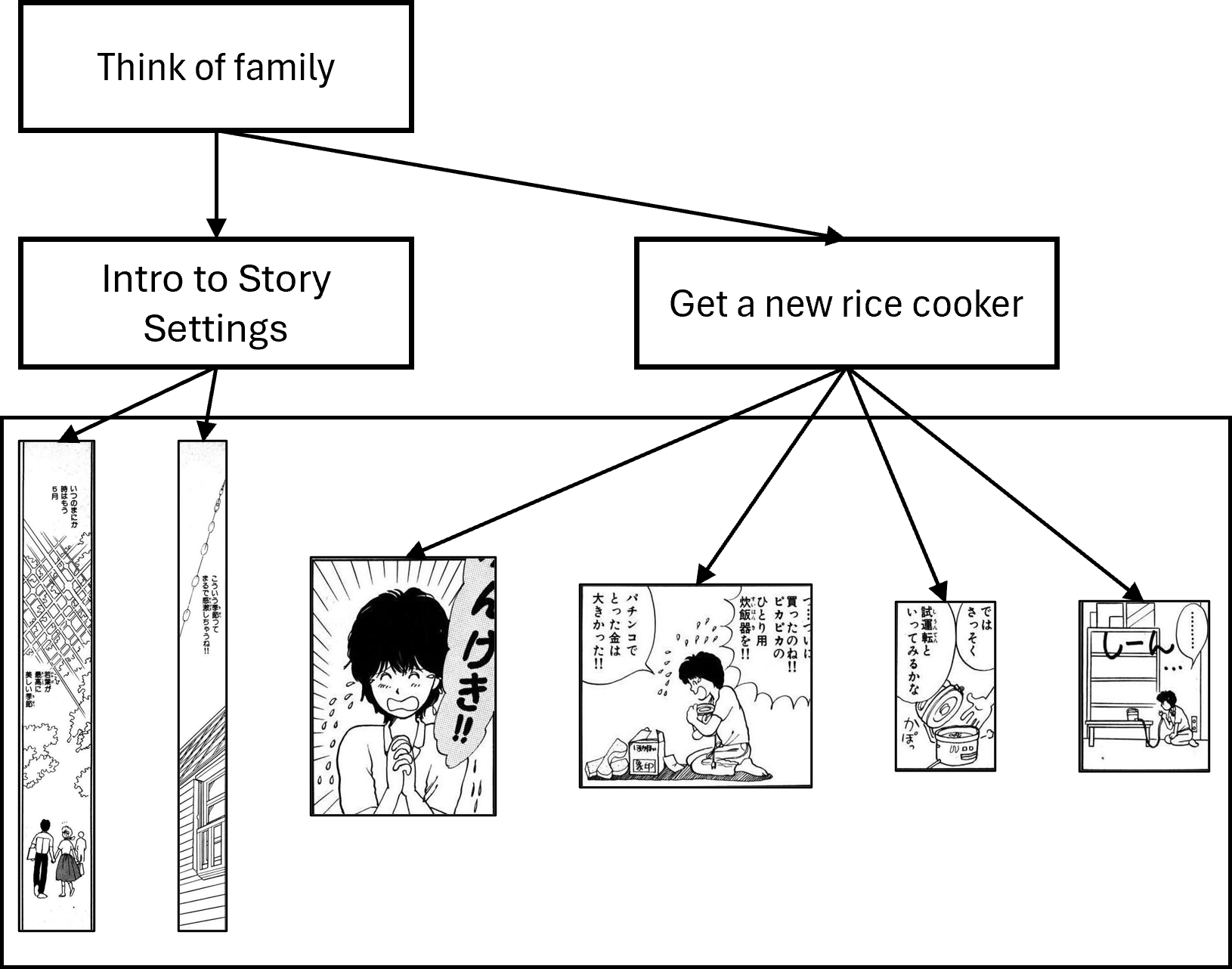

技术框架:该框架包含三个主要层级:面板层、事件层和宏事件层。面板层对单个漫画面板中的视觉元素(人物、物体、动作)和文本元素(对话、叙述)进行建模。事件层将多个相关的面板组织成一个事件,并表示事件之间的因果关系和时间顺序。宏事件层则将多个事件组织成一个宏观的故事结构,例如情节或主题。每个层级都使用符号图来表示知识,并通过链接将不同层级的图连接起来。

关键创新:该方法的核心创新在于提出了一个层级知识图谱框架,能够对视觉叙事进行多层次的结构化语义表示。与传统的扁平化知识图谱相比,该框架能够更好地捕捉故事的复杂性和层次性。此外,该方法强调知识图谱的符号表示,从而提高了模型的可解释性和透明度,使其更易于理解和调试。

关键设计:该框架的关键设计包括:1) 使用符号图来表示知识,每个节点代表一个实体或概念,每条边代表一种关系;2) 设计了专门的图构建算法,用于从视觉和文本数据中提取知识并构建知识图谱;3) 定义了跨层级的链接,用于连接不同层级的知识图谱,实现跨层级的推理和分析;4) 使用手动标注的数据集来训练和评估模型,以确保模型的准确性和可靠性。

🖼️ 关键图片

📊 实验亮点

该框架在Manga109数据集的手动标注子集上进行了评估,并在四个代表性任务中取得了良好的效果:动作检索、对话追踪、人物外观映射和时间线重建。虽然论文更侧重于可解释性和结构化推理,而非预测性能,但实验结果表明,该框架能够有效地捕捉故事的语义结构,并支持复杂的推理任务。

🎯 应用场景

该研究成果可应用于多种场景,包括:漫画创作辅助工具,帮助作者更好地组织故事结构和情节;叙事理解系统,用于自动分析和理解视觉叙事作品;交互式媒体应用,例如根据用户选择动态生成故事情节的漫画游戏。此外,该方法还可以推广到其他类型的视觉叙事,如电影和动画。

📄 摘要(原文)

We present a hierarchical knowledge graph framework for the structured semantic understanding of visual narratives, using comics as a representative domain for multimodal storytelling. The framework organizes narrative content across three levels-panel, event, and macro-event, by integrating symbolic graphs that encode semantic, spatial, and temporal relationships. At the panel level, it models visual elements such as characters, objects, and actions alongside textual components including dialogue and narration. These are systematically connected to higher-level graphs that capture narrative sequences and abstract story structures. Applied to a manually annotated subset of the Manga109 dataset, the framework supports interpretable symbolic reasoning across four representative tasks: action retrieval, dialogue tracing, character appearance mapping, and timeline reconstruction. Rather than prioritizing predictive performance, the system emphasizes transparency in narrative modeling and enables structured inference aligned with cognitive theories of event segmentation and visual storytelling. This work contributes to explainable narrative analysis and offers a foundation for authoring tools, narrative comprehension systems, and interactive media applications.