Working with Large Language Models to Enhance Messaging Effectiveness for Vaccine Confidence

作者: Lucinda Gullison, Feng Fu

分类: cs.CY, cs.AI, physics.soc-ph

发布日期: 2025-04-14

💡 一句话要点

利用大型语言模型增强疫苗信任信息的有效性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 疫苗信任 信息传递 ChatGPT 公共卫生 人机协作 说服力评估

📋 核心要点

- 疫苗犹豫和错误信息阻碍疫苗接种,小型公共卫生部门缺乏有效信息传递的资源。

- 利用ChatGPT增强疫苗信息,旨在提高信息传递的说服力,从而增强公众对疫苗的信心。

- 实验表明,ChatGPT增强的信息评分略高于原始信息,且受访者对ChatGPT生成内容没有明显担忧。

📝 摘要(中文)

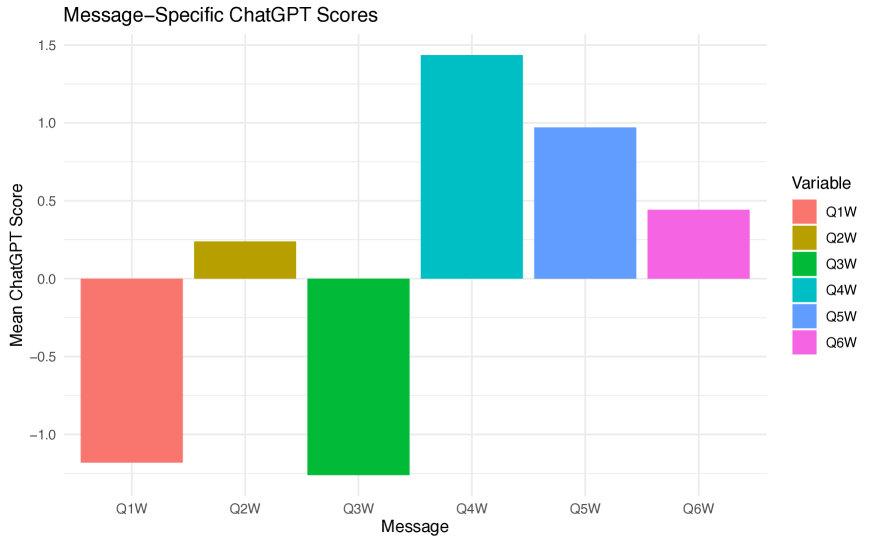

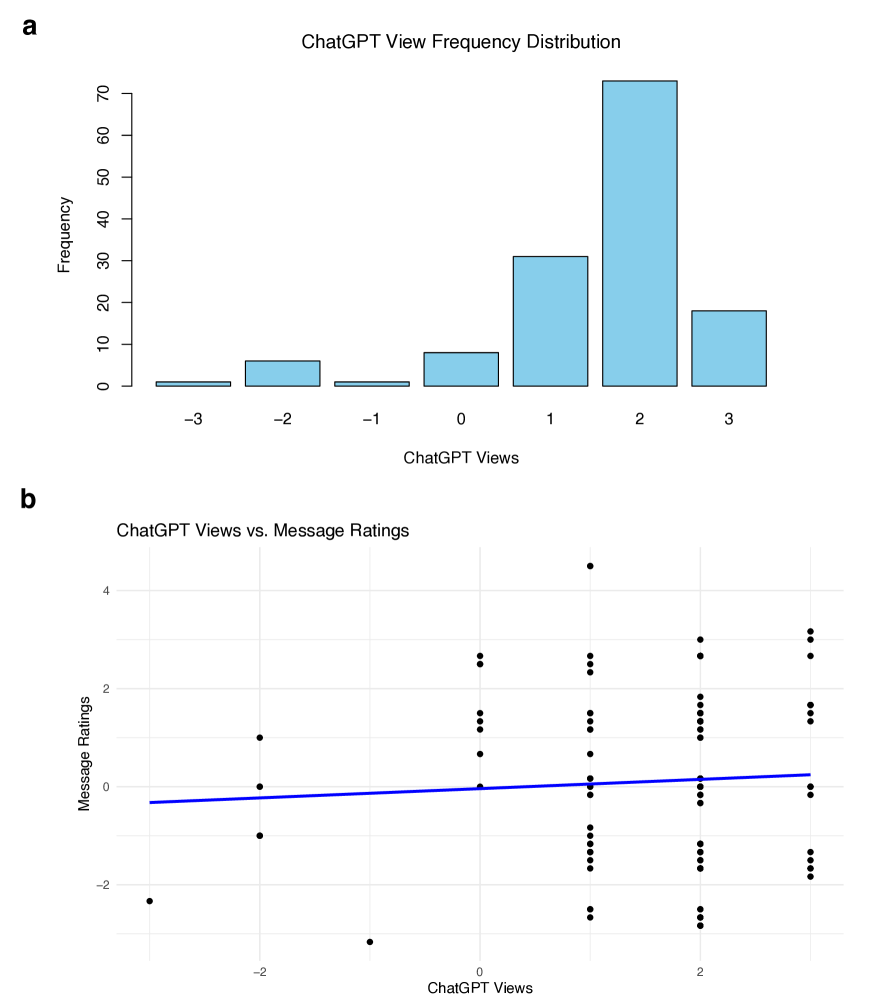

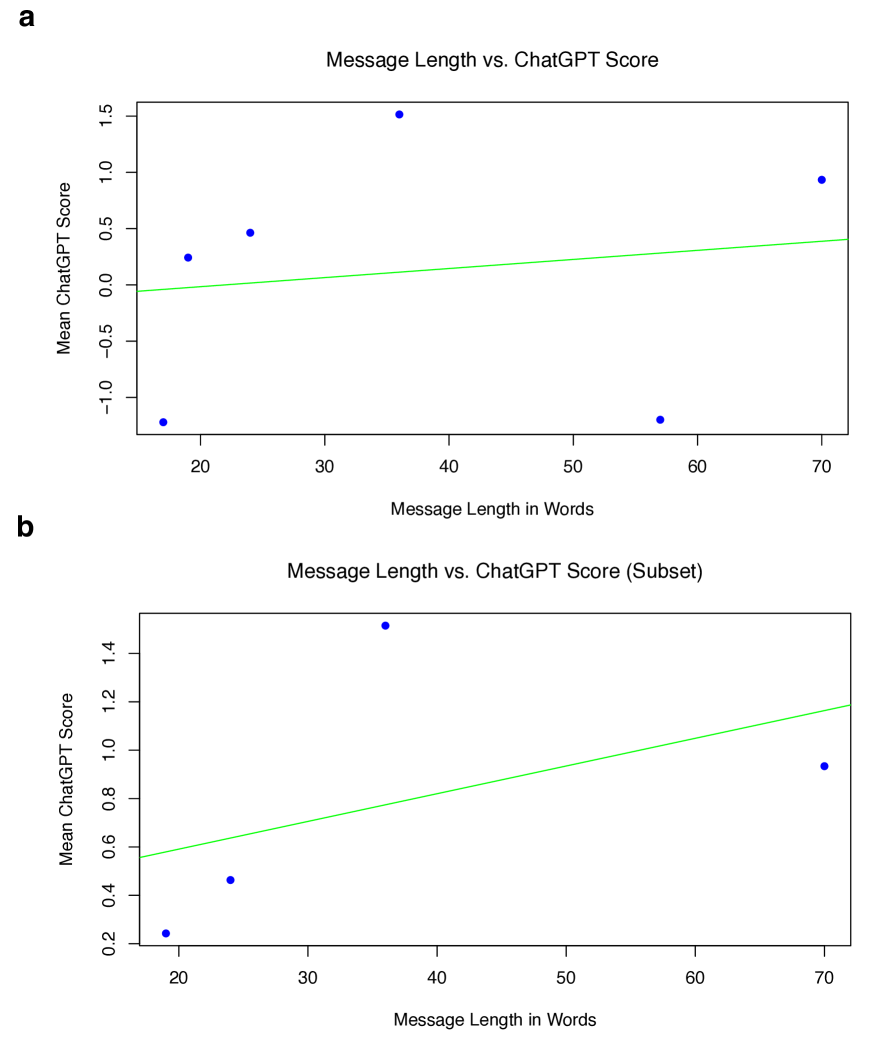

疫苗犹豫和错误信息是实现广泛疫苗接种覆盖率的重大障碍。小型公共卫生部门可能缺乏专业知识或资源来制作有效的疫苗信息。本文探讨了ChatGPT增强的信息传递在促进疫苗接种信心方面的潜力。我们进行了一项调查,参与者在成对的疫苗信息中进行选择,并评估哪个更具说服力以及说服程度。在每对信息中,一条是原始信息,另一条是经过ChatGPT增强的信息。在调查结束时,参与者被告知一半的信息是由ChatGPT生成的。然后,他们被要求提供关于了解信息的ChatGPT来源如何影响他们印象的定量和定性反馈。总体而言,ChatGPT增强的信息的评分略高于原始信息。这些信息通常在较长时得分更高。受访者没有对ChatGPT生成的内容表示重大担忧,参与者对ChatGPT的看法与其信息评分之间也没有显著关系。值得注意的是,信息在配对中出现的先后顺序与其得分之间存在相关性。这些结果表明ChatGPT具有增强疫苗信息的潜力,为未来公共卫生传播中人机协作的研究指明了一个有希望的方向。

🔬 方法详解

问题定义:论文旨在解决公共卫生部门在疫苗推广中,由于资源和专业知识的限制,难以有效传递疫苗信息,从而导致疫苗犹豫的问题。现有方法的痛点在于信息传递效果不佳,无法有效提升公众对疫苗的信任度。

核心思路:论文的核心思路是利用大型语言模型ChatGPT的强大文本生成能力,辅助生成更具说服力的疫苗信息,并通过实验评估其有效性。通过人机协作的方式,弥补小型公共卫生部门在信息传递方面的不足。

技术框架:该研究的技术框架主要包括以下几个阶段:1) 使用ChatGPT生成增强的疫苗信息;2) 设计调查问卷,将原始信息和ChatGPT增强的信息配对呈现给参与者;3) 收集参与者对每对信息的说服力评估;4) 分析数据,比较原始信息和ChatGPT增强信息的得分,并评估ChatGPT来源对参与者印象的影响。

关键创新:该研究的关键创新在于探索了大型语言模型在公共卫生传播领域的应用潜力,特别是利用ChatGPT增强疫苗信息传递效果。与传统的信息传递方法相比,该方法能够更高效地生成多样化的信息内容,并根据反馈进行优化。

关键设计:研究的关键设计包括:1) 信息配对方式,确保每对信息中只有一条是ChatGPT增强的,另一条是原始信息;2) 调查问卷的设计,包括对信息说服力的定量评估和对ChatGPT来源的定性反馈;3) 数据分析方法,包括比较不同信息类型的得分,以及评估ChatGPT来源对参与者印象的影响。此外,研究还考虑了信息呈现顺序对得分的影响。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ChatGPT增强的信息在说服力方面略优于原始信息。参与者对ChatGPT生成的内容没有表现出明显的担忧,并且他们对ChatGPT的看法与信息评分之间没有显著关联。研究还发现,信息在配对中出现的先后顺序会影响其得分。

🎯 应用场景

该研究成果可应用于公共卫生领域,辅助卫生部门更有效地传递疫苗接种、疾病预防等健康信息,提高公众健康意识和行为改变。未来,可扩展到其他公共服务领域,例如灾害预警、安全教育等,提升信息传递的有效性和覆盖面,促进社会福祉。

📄 摘要(原文)

Vaccine hesitancy and misinformation are significant barriers to achieving widespread vaccination coverage. Smaller public health departments may lack the expertise or resources to craft effective vaccine messaging. This paper explores the potential of ChatGPT-augmented messaging to promote confidence in vaccination uptake. We conducted a survey in which participants chose between pairs of vaccination messages and assessed which was more persuasive and to what extent. In each pair, one message was the original, and the other was augmented by ChatGPT. At the end of the survey, participants were informed that half of the messages had been generated by ChatGPT. They were then asked to provide both quantitative and qualitative responses regarding how knowledge of a message's ChatGPT origin affected their impressions. Overall, ChatGPT-augmented messages were rated slightly higher than the original messages. These messages generally scored better when they were longer. Respondents did not express major concerns about ChatGPT-generated content, nor was there a significant relationship between participants' views on ChatGPT and their message ratings. Notably, there was a correlation between whether a message appeared first or second in a pair and its score. These results point to the potential of ChatGPT to enhance vaccine messaging, suggesting a promising direction for future research on human-AI collaboration in public health communication.