Multi-Modal Hypergraph Enhanced LLM Learning for Recommendation

作者: Xu Guo, Tong Zhang, Yuanzhi Wang, Chenxu Wang, Fuyun Wang, Xudong Wang, Xiaoya Zhang, Xin Liu, Zhen Cui

分类: cs.IR, cs.AI

发布日期: 2025-04-13 (更新: 2025-07-29)

备注: 12 pages, 4 figures, submitted to IEEE Transactions on Knowledge and Data Engineering

💡 一句话要点

提出HeLLM框架,融合超图结构与序列行为增强LLM推荐能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 推荐系统 大型语言模型 超图 多模态学习 对比学习 图神经网络 序列建模

📋 核心要点

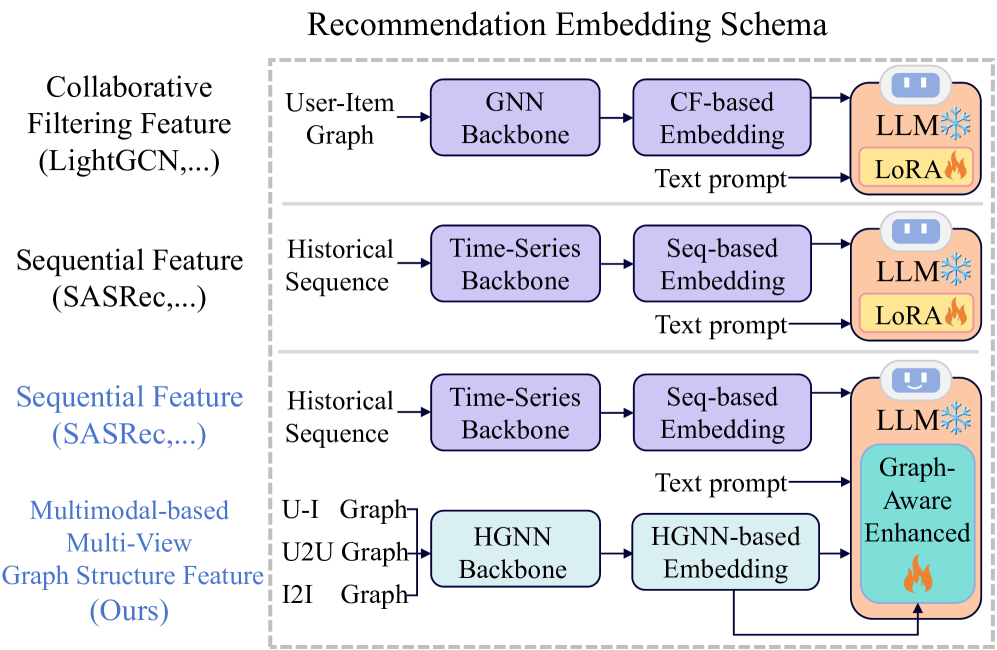

- 现有基于LLM的推荐方法未能充分挖掘推荐场景中多视角图结构蕴含的复杂关联。

- 提出HeLLM框架,通过构建用户和物品超图,融合图级上下文和序列行为模式,增强LLM对高阶语义相关性的理解。

- 实验结果表明,HeLLM显著优于现有方法,验证了融合超图上下文和序列用户行为在LLM推荐中的有效性。

📝 摘要(中文)

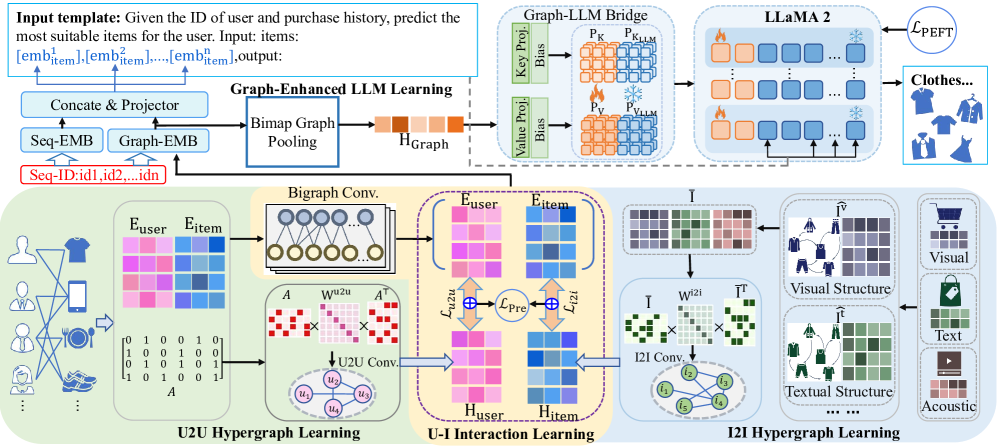

大型语言模型(LLM)的兴起推动了个性化推荐系统的发展。现有基于LLM的方法未能充分探索推荐场景中固有的多视角图结构相关性。为此,我们提出了一个新颖的框架,即用于多模态推荐的超图增强LLM学习(HeLLM),旨在通过融合图级上下文信号与序列级行为模式,使LLM具备捕获复杂高阶语义相关性的能力。在推荐预训练阶段,我们设计了一个用户超图来揭示用户之间共享的兴趣偏好,以及一个项目超图来捕获项目之间多模态相似性中的相关性。引入了超图卷积和协同对比学习机制,以增强学习到的表征的可区分性。在LLM微调阶段,我们将学习到的图结构嵌入直接注入到LLM的架构中,并整合捕获每个用户时间行为的序列特征。此过程使超图能够利用图结构信息作为全局上下文,从而增强LLM感知复杂关系模式和整合多模态信息的能力,同时对局部时间动态进行建模。大量实验表明,我们提出的方法优于最先进的基线,证实了在LLM推荐中融合基于超图的上下文与序列用户行为的优势。

🔬 方法详解

问题定义:现有基于LLM的推荐方法通常忽略了推荐场景中用户和物品之间复杂的高阶关系,以及物品的多模态特征之间的关联。这些方法未能充分利用图结构信息,导致LLM无法有效地捕捉用户兴趣和物品特性,从而影响推荐效果。

核心思路:HeLLM的核心思路是通过构建用户超图和物品超图,显式地建模用户之间的共同兴趣偏好和物品之间的多模态相似性。然后,将学习到的超图嵌入注入到LLM中,作为全局上下文信息,指导LLM更好地理解用户行为序列,从而提升推荐性能。这样设计的目的是为了弥补现有方法在图结构信息利用上的不足,使LLM能够感知更复杂的关系模式。

技术框架:HeLLM框架包含两个主要阶段:推荐预训练阶段和LLM微调阶段。在预训练阶段,首先构建用户超图和物品超图,然后使用超图卷积和协同对比学习来学习增强的节点表示。在微调阶段,将学习到的超图嵌入和用户行为序列特征输入到LLM中进行微调,从而使LLM能够利用图结构信息和序列行为模式进行推荐。

关键创新:HeLLM的关键创新在于将超图结构引入到LLM推荐中,并设计了相应的预训练和微调策略。通过超图建模用户和物品之间的高阶关系,并将其融入LLM的学习过程中,从而提升了LLM对复杂关系模式的感知能力。此外,协同对比学习机制进一步增强了学习到的表征的可区分性。

关键设计:在用户超图和物品超图的构建中,需要选择合适的超边构建策略,例如基于共同行为或多模态相似性。超图卷积操作可以选择不同的聚合函数和更新规则。协同对比学习的目标是最大化正样本对之间的相似性,同时最小化负样本对之间的相似性。在LLM微调阶段,需要设计合适的输入格式,将超图嵌入和用户行为序列有效地输入到LLM中。

🖼️ 关键图片

📊 实验亮点

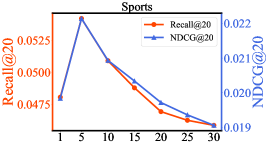

实验结果表明,HeLLM在多个数据集上显著优于现有最先进的推荐模型。例如,在某电商数据集上,HeLLM相比于最佳基线模型,在Recall@20指标上提升了5%以上,证明了其有效性。

🎯 应用场景

HeLLM框架可应用于各种需要个性化推荐的场景,例如电商、在线视频、新闻推荐等。通过融合用户和物品之间的复杂关系以及物品的多模态信息,可以提升推荐的准确性和多样性,从而改善用户体验,提高平台收益。该研究对于提升LLM在推荐系统中的应用具有重要意义。

📄 摘要(原文)

The burgeoning presence of Large Language Models (LLM) is propelling the development of personalized recommender systems. Most existing LLM-based methods fail to sufficiently explore the multi-view graph structure correlations inherent in recommendation scenarios. To this end, we propose a novel framework, Hypergraph Enhanced LLM Learning for multimodal Recommendation (HeLLM), designed to equip LLMs with the capability to capture intricate higher-order semantic correlations by fusing graph-level contextual signals with sequence-level behavioral patterns. In the recommender pre-training phase, we design a user hypergraph to uncover shared interest preferences among users and an item hypergraph to capture correlations within multimodal similarities among items. The hypergraph convolution and synergistic contrastive learning mechanism are introduced to enhance the distinguishability of learned representations. In the LLM fine-tuning phase, we inject the learned graph-structured embeddings directly into the LLM's architecture and integrate sequential features capturing each user's chronological behavior. This process enables hypergraphs to leverage graph-structured information as global context, enhancing the LLM's ability to perceive complex relational patterns and integrate multimodal information, while also modeling local temporal dynamics. Extensive experiments demonstrate the superiority of our proposed method over state-of-the-art baselines, confirming the advantages of fusing hypergraph-based context with sequential user behavior in LLMs for recommendation.