Distilling Transitional Pattern to Large Language Models for Multimodal Session-based Recommendation

作者: Jiajie Su, Qiyong Zhong, Yunshan Ma, Weiming Liu, Chaochao Chen, Xiaolin Zheng, Jianwei Yin, Tat-Seng Chua

分类: cs.IR, cs.AI

发布日期: 2025-04-13

💡 一句话要点

提出TPAD框架,利用LLM蒸馏过渡模式,提升多模态会话推荐性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 会话推荐 多模态学习 大语言模型 知识蒸馏 互信息估计

📋 核心要点

- 传统会话推荐方法依赖ID协同或辅助内容,而多模态会话推荐(MSBR)使用简单的预训练模型,语义丰富度不足,难以有效缓解数据稀疏和冷启动问题。

- TPAD框架通过知识MLLM和转移MLLM并行提取项目知识和会话过渡特征,并使用过渡模式对齐模块,将两者信息蒸馏到统一的模态表示中。

- 实验结果表明,TPAD框架在真实数据集上表现出优异的性能,验证了其在多模态会话推荐任务中的有效性。

📝 摘要(中文)

本文提出了一种基于大语言模型(LLM)增强的多模态会话推荐(MSBR)框架TPAD,旨在利用LLM的认知能力生成全面的多模态表示,从而提升下游MSBR的性能,缓解数据稀疏和冷启动问题。该框架面临两个挑战:如何获取LLM对过渡模式和固有模态知识的认知,以及如何将这些特征对齐到统一的LLM中,在最小化差异的同时最大化表示效用。TPAD通过解耦和对齐过渡模式来扩展蒸馏范式,促进MSBR。它建立了并行的知识MLLM和转移MLLM,前者解释项目知识相关的特征,后者提取会话下的过渡感知特征。一个利用互信息估计理论的过渡模式对齐模块联合了两个MLLM,缓解了分布差异,并将过渡模式提炼到模态表示中。在真实数据集上的大量实验证明了该框架的有效性。

🔬 方法详解

问题定义:现有的多模态会话推荐(MSBR)方法通常使用简单的预训练模型进行模态学习,这限制了语义信息的丰富性,无法充分利用多模态数据中的知识。此外,数据稀疏性和冷启动问题仍然是MSBR面临的挑战。因此,论文旨在利用大语言模型(LLM)的强大语义推理能力,为MSBR生成更全面的多模态表示,从而提升推荐性能。

核心思路:论文的核心思路是将LLM的知识迁移到MSBR任务中,具体来说,通过蒸馏过渡模式来实现。该方法将LLM的知识解耦为两部分:项目知识和会话过渡知识,分别由两个MLLM(知识MLLM和转移MLLM)进行学习。然后,通过一个过渡模式对齐模块,将这两个MLLM学习到的知识对齐并融合,从而得到更有效的多模态表示。这样设计的目的是为了充分利用LLM的知识,同时避免直接使用LLM带来的计算成本和部署难度。

技术框架:TPAD框架包含三个主要模块:知识MLLM、转移MLLM和过渡模式对齐模块。知识MLLM负责学习项目相关的知识,例如商品的属性、描述等。转移MLLM负责学习会话中的过渡模式,例如用户在会话中依次点击的商品之间的关系。过渡模式对齐模块利用互信息估计理论,将两个MLLM学习到的知识对齐并融合,生成最终的多模态表示。整个框架采用蒸馏范式,将LLM的知识迁移到下游的MSBR模型中。

关键创新:该论文的关键创新在于提出了一个基于蒸馏的框架,用于将LLM的知识迁移到MSBR任务中。与以往直接使用LLM的方法不同,该方法通过解耦和对齐过渡模式,更有效地利用了LLM的知识,同时避免了直接使用LLM带来的计算成本和部署难度。此外,该论文还提出了一个过渡模式对齐模块,利用互信息估计理论,实现了两个MLLM学习到的知识的有效融合。

关键设计:在知识MLLM和转移MLLM中,使用了预训练的语言模型作为基础模型,并针对MSBR任务进行了微调。过渡模式对齐模块使用了互信息神经网络估计器(MINE)来估计两个MLLM输出之间的互信息,并使用该互信息作为损失函数,来指导两个MLLM的学习。此外,论文还设计了一个对比学习损失函数,用于增强多模态表示的区分性。

🖼️ 关键图片

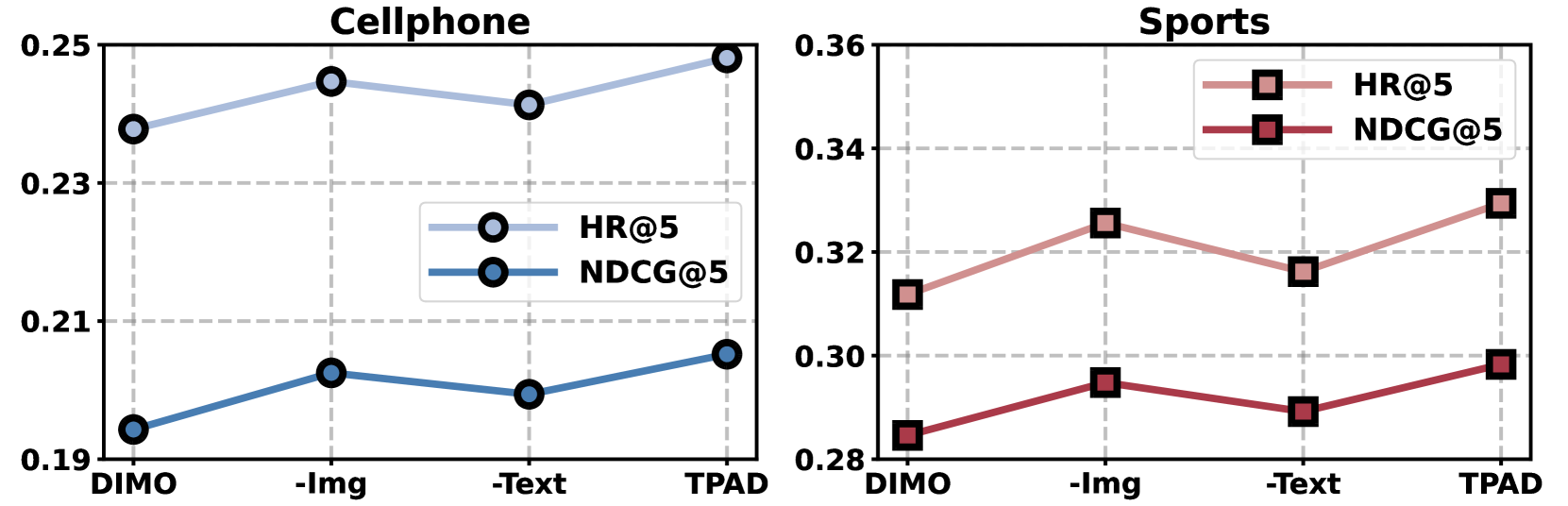

📊 实验亮点

实验结果表明,TPAD框架在两个真实数据集上均取得了显著的性能提升。例如,在某个数据集上,TPAD框架相比于最先进的基线方法,在Recall@20指标上提升了超过5%。这些结果验证了TPAD框架在多模态会话推荐任务中的有效性,并表明利用LLM的知识可以显著提升推荐性能。

🎯 应用场景

该研究成果可应用于电商、在线视频、音乐等领域的个性化推荐系统。通过利用LLM的知识,可以更准确地理解用户的意图和偏好,从而提供更精准、更个性化的推荐服务,提升用户体验和平台收益。未来,该方法还可以扩展到其他需要利用多模态信息的推荐场景,例如社交媒体推荐、新闻推荐等。

📄 摘要(原文)

Session-based recommendation (SBR) predicts the next item based on anonymous sessions. Traditional SBR explores user intents based on ID collaborations or auxiliary content. To further alleviate data sparsity and cold-start issues, recent Multimodal SBR (MSBR) methods utilize simplistic pre-trained models for modality learning but have limitations in semantic richness. Considering semantic reasoning abilities of Large Language Models (LLM), we focus on the LLM-enhanced MSBR scenario in this paper, which leverages LLM cognition for comprehensive multimodal representation generation, to enhance downstream MSBR. Tackling this problem faces two challenges: i) how to obtain LLM cognition on both transitional patterns and inherent multimodal knowledge, ii) how to align both features into one unified LLM, minimize discrepancy while maximizing representation utility. To this end, we propose a multimodal LLM-enhanced framework TPAD, which extends a distillation paradigm to decouple and align transitional patterns for promoting MSBR. TPAD establishes parallel Knowledge-MLLM and Transfer-MLLM, where the former interprets item knowledge-reflected features and the latter extracts transition-aware features underneath sessions. A transitional pattern alignment module harnessing mutual information estimation theory unites two MLLMs, alleviating distribution discrepancy and distilling transitional patterns into modal representations. Extensive experiments on real-world datasets demonstrate the effectiveness of our framework.