MigGPT: Harnessing Large Language Models for Automated Migration of Out-of-Tree Linux Kernel Patches Across Versions

作者: Pucheng Dang, Di Huang, Dong Li, Kang Chen, Yuanbo Wen, Qi Guo, Xing Hu

分类: cs.SE, cs.AI, cs.OS

发布日期: 2025-04-13 (更新: 2025-11-26)

💡 一句话要点

MigGPT:利用大语言模型自动迁移不同Linux内核版本的外部补丁

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Linux内核 代码迁移 大语言模型 外部补丁 自动化

📋 核心要点

- 维护和更新外部Linux内核补丁以适应新硬件或功能,需要大量人工干预和专业知识。

- MigGPT通过代码指纹结构保留代码片段信息,并设计模块来提升LLM在补丁迁移中的准确性和效率。

- 实验结果表明,MigGPT在外部内核补丁迁移任务中,相比直接使用LLM,平均完成率提升至74.07%。

📝 摘要(中文)

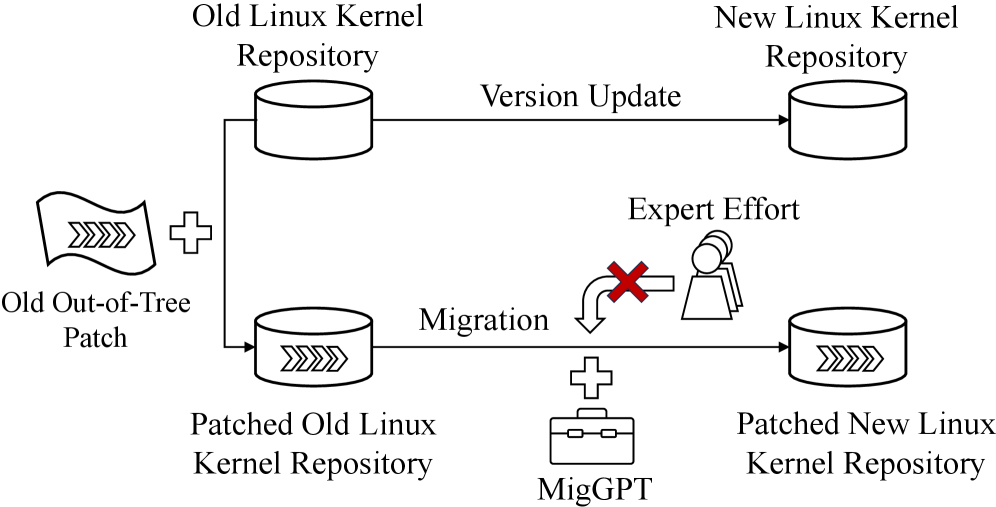

外部内核补丁对于将Linux内核适配到新硬件或启用特定功能至关重要。在不同内核版本之间维护和更新这些补丁需要经验丰富的工程师付出大量努力。大语言模型(LLM)在各个领域都取得了显著进展,表明它们有潜力自动执行外部内核补丁的迁移。然而,我们的研究表明,LLM虽然有前景,但在理解不完整的代码上下文和识别不准确的迁移点方面存在困难。在这项工作中,我们提出了MigGPT,一个采用新型代码指纹结构来保留代码片段信息的框架,并结合了三个精心设计的模块,以提高外部内核补丁的迁移准确性和效率。此外,我们使用真实的外部内核补丁项目建立了一个强大的基准来评估LLM的能力。评估表明,MigGPT显著优于直接应用原始LLM,在迁移任务中实现了平均74.07%的完成率。

🔬 方法详解

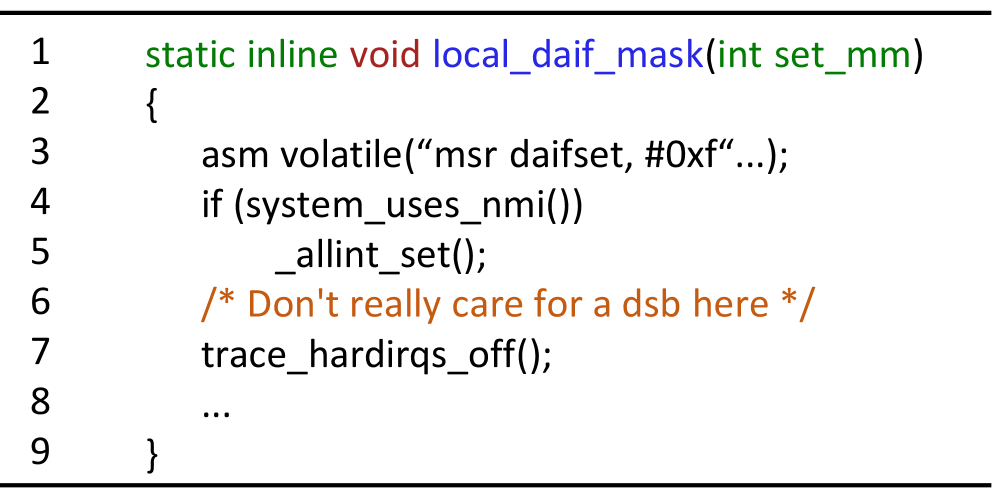

问题定义:论文旨在解决将外部Linux内核补丁自动迁移到不同内核版本的问题。现有方法,特别是直接使用大型语言模型(LLM),在理解不完整的代码上下文和识别准确的迁移点方面存在困难,导致迁移的准确性和效率低下。工程师需要花费大量时间手动调整和验证LLM的输出。

核心思路:论文的核心思路是利用一种新型的代码指纹结构来增强LLM对代码上下文的理解,并结合精心设计的模块来提高迁移的准确性和效率。通过保留代码片段的详细信息,并利用这些信息来指导LLM的迁移过程,从而克服了LLM在处理不完整代码上下文时的局限性。

技术框架:MigGPT框架主要包含以下几个模块:代码指纹提取模块,用于提取和存储代码片段的指纹信息;迁移点识别模块,用于识别需要进行迁移的代码位置;代码迁移模块,利用LLM和代码指纹信息生成迁移后的代码。整体流程是从原始补丁和目标内核版本中提取代码指纹,然后利用这些指纹信息来指导LLM进行代码迁移,最后对迁移结果进行验证和调整。

关键创新:最重要的技术创新点在于提出的代码指纹结构,它能够有效地保留代码片段的上下文信息,并用于指导LLM进行代码迁移。与现有方法相比,MigGPT的代码指纹结构能够更全面地捕捉代码的语义信息,从而提高迁移的准确性。此外,框架中精心设计的模块也针对LLM在补丁迁移中的弱点进行了优化。

关键设计:代码指纹结构的设计是关键。具体实现细节未知,但可以推测其可能包含代码的抽象语法树(AST)表示、代码的语义信息以及代码的依赖关系等。迁移点识别模块可能使用了基于相似度的匹配算法,将原始补丁中的代码片段与目标内核版本中的代码片段进行匹配,从而确定需要进行迁移的代码位置。代码迁移模块则利用LLM和代码指纹信息生成迁移后的代码,并可能使用一些后处理技术来提高代码的质量。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MigGPT在外部内核补丁迁移任务中显著优于直接应用原始LLM,平均完成率达到74.07%。这表明MigGPT提出的代码指纹结构和模块设计能够有效提高LLM在代码迁移任务中的准确性和效率。具体的基线模型和数据集细节未知,但74.07%的完成率是一个显著的提升。

🎯 应用场景

该研究成果可应用于自动化Linux内核补丁的维护和更新,降低维护成本,提高开发效率。尤其是在嵌入式系统、物联网设备等需要定制内核的场景下,可以显著减少人工干预,加速产品迭代。未来,该技术有望扩展到其他软件系统的代码迁移和升级。

📄 摘要(原文)

Out-of-tree kernel patches are essential for adapting the Linux kernel to new hardware or enabling specific functionalities. Maintaining and updating these patches across different kernel versions demands significant effort from experienced engineers. Large language models (LLMs) have shown remarkable progress across various domains, suggesting their potential for automating out-of-tree kernel patch migration. However, our findings reveal that LLMs, while promising, struggle with incomplete code context understanding and inaccurate migration point identification. In this work, we propose MigGPT, a framework that employs a novel code fingerprint structure to retain code snippet information and incorporates three meticulously designed modules to improve the migration accuracy and efficiency of out-of-tree kernel patches. Furthermore, we establish a robust benchmark using real-world out-of-tree kernel patch projects to evaluate LLM capabilities. Evaluations show that MigGPT significantly outperforms the direct application of vanilla LLMs, achieving an average completion rate of 74.07 for migration tasks.